Intervjuer

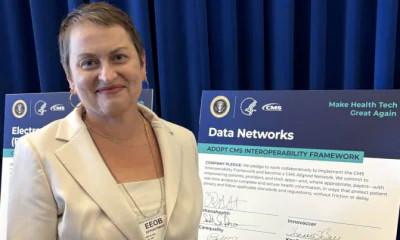

Sandy Dunn, CISO på SPLX – Intervju-serie

Sandy Dunn, CISO på SPLX är en veteran CISO med 20+ års erfarenhet av hälsovård och startups, och erbjuder CISO-konsulttjänster genom QuarkIQ. Hon leder OWASP Top 10 för LLM-applikationer för cybersäkerhet och styrningschecklista och bidrar till OWASP AI-utbyte, OWASP Top 10 för LLM och Cloud Security Alliance. Som adjungerad professor i cybersäkerhet vid Boise State University är hon också en frekvent talare, rådgivare och styrelseledamot i Boise States institut för omfattande cybersäkerhet. Sandy har en master i informations säkerhetsledning från SANS och många certifikat, inklusive CISSP, flera SANS GIAC-crediteringar, Security+, ISTQB och FAIR.

SPLX är ett cybersäkerhetsföretag som erbjuder komplett skydd för AI-system genom automatiserad röd teaming, körningsskydd, styrning, åtgärd och hotinspektion samt modellsäkerhet. Plattformen kör tusentals adversariella simuleringar på under en timme för att identifiera sårbarheter, förstärker systemprompter före distribution och inkluderar Agentic Radar, ett öppen källkodsverktyg för att kartlägga och analysera risker i multiagent AI-arbetsflöden.

Vad var det som först drog dig till skärningspunkten mellan AI och cybersäkerhet, och hur ledde den vägen till din roll på SPLX och ditt engagemang i OWASP?

AI hade varit en del av cybersäkerhetsdiskussioner i åratal före ChatGPT, men det kändes ofta som att det inte hade levt upp till förväntningarna. Så när det lanserades, förväntade jag mig att bli besviken, men istället hade jag den exakta motsatta reaktionen. När jag först använde ChatGPT, var jag både imponerad av vad det kunde göra och skräckslagen av hur snabbt det kunde vapenföras för adversariella attacker eller integritetsöverträdelser. Den stunden tände en eld. Jag dykte in i LLM headfirst, läste varje forskningspapper jag kunde hitta, gick med i varje relevant Slack- och Discord-community och körde mina egna experiment. Jag lurade en stund i OWASP Top 10 för LLM-kanalen, och när den första listan publicerades, visste jag att det var en viktig milstolpe. Men som CISO, kände jag att säkerhetsteamen behövde mer information. Vi hade berättat för människor vad de skulle oroa sig för, men inte vad de skulle göra. Jag kontaktade Steve Wilson, projektledaren, om att skapa en “LLM-säkerhetschecklista för CISO”. Det blev sedan det första OWASP GenAI-underprojektet, som inspirerade många ytterligare underprojekt.

Genom det arbetet träffade jag Kristian Kamber och Ante Gojsalic (grundarna av SPLX) och rådde också ett antal AI-säkerhetsstartups, vissa med lovande idéer, vissa mindre så. På den tiden var jag CISO på ett B2B-chatbotföretag, skapade en omfattande AI-adversariell testbok. När jag såg SPLX:s demo, insåg jag omedelbart att de hade löst det problem jag brottades med: hur man operationaliserar adversariell testning. När SPLX behövde en CISO, tog jag chansen att vara en del av ett fantastiskt företag med otroliga människor som löser viktiga utmaningar.

Som CISO på SPLX, vad är de mest nya attackteknikerna du upptäcker, särskilt med avseende på agentic AI?

På grund av de nyanser som finns i GenAI-systemdesign, är det inte möjligt att eliminera GenAI-sårbarheter och attacker som vapenför agentens autonomi och förmågor. Minnesförgiftningattacker som MINJA är ett nyligt exempel på detta. Med MINJA kan angripare subtilt korrumpera en agents minnesbanker genom konstruerade interaktioner, implantera skadliga “minnen” med promptresultat som leder till vilseledande eller farliga beteenden senare. Ett annat exempel är Echo Chamber-attacken. Detta är där en angripare skapar konversationsloopar genom att skicka en agent upprepade skadliga sammanhang. Forskare kunde kringgå säkerhetsmekanismer genom att förstärka skadliga instruktioner under flera omgångar.

Indirekt och tvärmodalt promptinjektion är ett annat exempel. Skadliga instruktioner gömmer sig i extern innehåll som agenter konsumerar. Dessa instruktioner kan kapning autonomt beslutsfattande utan direkt inmatning från användaren.

Sophistikerade AI-agent-ekosystemattacker som verktygsförgiftning kräver noggrann granskning av hela leverantörskedjan för AI-agentdistributioner. Angripare skapar tydligen legitima verktyg för agentplattformar men inbäddar skadliga instruktioner inom verktygsbeskrivningar och dokumentation. När agenter laddar ner dessa verktyg, blir de inbäddade instruktionerna en del av agentens sammanhang, vilket möjliggör obehöriga åtgärder som dataexfiltration eller systemsäkerhetskränkning.

Hur hjälper SPLX-plattformen organisationer att upptäcka och svara på LLM-specifika hot som promptinjektion eller adversariell jailbreak-attacker?

SPLX är en komplett säkerhetsplattform som skyddar LLM-aktiverade applikationer och multiagent-system över hela AI-livscykeln, från utveckling till distribution och realtidsdrift. Vårt AI-körningsskydd är utformat för att stoppa dessa hot medan de inträffar genom att kontinuerligt övervaka och filtrera in- och utdata. Det fungerar som en brandvägg i realtid för AI och upprätthåller strikta beteendegränser för AI. SPLX:s dynamiska upptäcktsmotor flaggar skadlig aktivitet i realtid, vilket säkerställer att AI-system svarar säkert och stannar inom avsedda gränser.

OWASP:s uppdaterade GenAI-säkerhetslista utvidgar nyckelrisker som system-promptläckage och vektor-databas-sårbarheter. Hur återspeglar dessa nya hot den utvecklande adversariella landskapet?

OWASP Top 10-uppdateringarna för 2025 återspeglar en utvecklande förståelse för hur LLM och generativ AI-teknik används i realvärldsscenarier. Det är viktigt att påpeka att det finns många fler än tio LLM-hot, men målet är att identifiera de tio viktigaste. De stora förändringarna är LLM07 Osäker plugin-design som ingår i leverantörskedjan och LLM010 Modellstöld som ingår i obegränsad konsumtion för 2025-listan, vilket skapade utrymme för att lägga till:

1. System-promptläckage som identifierar hotet med att exponera systemprompten kan avslöja skydd, logikflöden eller till och med hemligheter inbäddade i LLM-prompter.

2. Vektor-databas-sårbarheter flaggar de potentiella säkerhetsproblemen inom RAG-system som kors-tenant data läckage, inbäddning inversion eller förgiftade dokument som senare yppar farliga utdata.

3. Uppdateringarna visar att AI-fokuserade attacker har utvecklats från konstruerade opportunistiska promptattacker till sofistikerade attacker som riktar sig mot hela AI-leverantörskedjan. Moderna attacker visar strategiskt tänkande om hela AI-systemet, med fokus på persistence, skala och systemisk påverkan snarare än enstaka exploateringar.

Den utvidgade täckningen av agentic-arkitekturer erkänner en annan kritisk utveckling. När AI-system får större autonomi och beslutsförmåga, förökar konsekvenserna av säkerhetsbrott exponentiellt. Minskad mänsklig tillsyn, samtidigt som mer kraftfulla applikationer möjliggörs, har en kumulativ effekt som förstärker påverkan av lyckade attacker.

I din mening, vad är de mest förbisedda sårbarheterna i företag som distribuerar agentic AI idag?

Det mest förbisedda problemet är samma utmaning vi står inför med traditionell programvara och systemdistributioner, principen om minsta behörighet. Vi kämpar fortfarande med minsta behörighet för mänskliga användare och tjänstekonton, och nu står organisationer inför en ny utmaning med att hantera icke-mänskliga identiteter (NIH). Människor distribuerar agenter medan agentidentitet och åtkomst fortfarande inte är fullständigt förstådd eller löst. Vi ser agenter som ges vida rang av behörigheter för att läsa dokument, komma åt externa API:er och till och med modifiera system. Detta är inte ett tekniskt fel i modellen i sig, det är ett grundläggande arkitektoniskt misstag. En komprometterad agent med överdriven behörighet kan förorsaka kaos, från exfiltrering av stora mängder data till initiering av finansiella transaktioner.

Ett annat ofta förbisett eller ignorerat problem är “förtroendeförhållandet” mellan agenter. I agentic-system är agenter ofta utformade för att kommunicera och samarbeta med varandra. Vi ser en ny klass av attacker där en komprometterad agent kan utge sig för att vara en legitim, i princip en “Agent-i-mitten”. Det är som en trojansk häst men på en arkitektonisk nivå.

Kan du gå igenom handlingsbara steg som företagssäkerhetsteam bör vidta när de distribuerar agentic AI-verktyg i produktionsmiljöer?

1. Börja med incidentresponsplaner. Vad ser den värsta dagen ut som, sedan arbeta bakåt för att säkerställa att säkerhetskontroller och synlighet är på plats. När ett AI-brott inträffar, behöver ditt säkerhetsoperationscenter en playbook. Vem ska meddelas? Hur isolerar man en komprometterad agent? Vilken är processen för att återställa till en känd god tillstånd? Att ha en plan innan en kris inträffar är avgörande.

2. Attackyta-inventering och hotbedömning. Du kan inte säkra det du inte vet att du har. Det första steget är att få en fullständig inventering av alla AI-agenter, verktyg i bruk och dataåtkomst. Vilken data berör det? Vilka behörigheter har det? Vilken är den potentiella påverkan om det blir komprometterat? Prioritera de högsta hoten och de mest sannolika hoten. Sedan ha ett ärligt samtal med ledningsgruppen om riskaptit. En fördel med den accelererade AI-aktiviteten är att CISO, riskchefer, juridiska team och ledningsgrupper kommer att tvingas ha ett riktigt samtal om affärsmål, riskaptit och säkerhetsbudgetar. Historiskt sett fanns det ett krav på att det inte skulle finnas några incidenter med minimal budget. CISO har (i stor utsträckning) kunnat undvika stora incidenter genom att implementera tillräckligt med säkerhet för att göra sin organisation till en mindre attraktiv måltavla än organisationen med mindre säkerhet. AI-aktiverade angripare gör den strategin orealistisk nu.

3. Implementera skydd, minsta behörighet och övervakningsverktyg. Omfattning är viktig för alla agentdistributioner. Definiera en agents syfte, dess gränser och dess behörigheter. Ge inte en agent åtkomst till hela er SharePoint-bibliotek om den bara behöver en mapp. Implementera kontroller som begränsar vilka API:er den kan anropa och vilka åtgärder den kan utföra. Tänk på det som en ny, mycket smart, berusad praktikant. Du erkänner att de har fantastiska förmågor, men du skulle inte lita på dem. Du skulle begränsa vad de kunde göra inom företaget, du skulle inte ge dem åtkomst till något viktigt, du skulle övervaka vad de gör och du kanske har larm system på plats om de försökte göra något de absolut inte borde göra, som att komma åt VD:ns kontor.

4. Implementera ett AI-specifikt säkerhetsstack som sammanfogar med din traditionella säkerhetsstack. Traditionella säkerhetsverktyg var inte utformade för GenAI-system eller agentic-system. Du behöver implementera verktyg som är utformade för problem som är unika för GenAI, såsom promptvalidering, utdatasanering och kontinuerlig övervakning av agentbeteende. Dessa verktyg måste kunna upptäcka de subtila, semantiska attackerna som är specifika för GenAI och agentic-system.

5. Integrera AI-röd teaming i CI/CD-pipelinen. Du behöver kontinuerligt testa dina agenter för sårbarheter baserat på betydelsen av ändringarna och organisationens riskaptit. Den nyliga GPT-5-uppdateringen är ett exempel på hur störande ändringar kan vara på agentic-arbetsflöden. Gör automatiserad röd teaming till en kärndel av din utvecklingslivscykel. Detta hjälper dig att identifiera problem medan du uppdaterar och ändrar dina agenter.

Hur bör organisationer inkorporera automatiserad röd teaming, CIAM, RAG-styrning och övervakning i sin GenAI-riskhanteringsstrategi?

Nyckeln är integration snarare än att behandla dem som separata initiativ. Din GenAI-riskhanteringsstrategi behöver vara en sammanhängande ram där varje komponent förstärker de andra.

Börja med automatiserad röd teaming som grund. Det är viktigt att ha kontinuerlig adversariell testning som utvecklas med hotlandskapet. SPLX-plattformen simulerar tusentals attackscenarier över olika riskkategorier, testar för promptinjektion, jailbreaks, sammanhangsmanipulation och verktygsförgiftning. Den kritiska aspekten är att göra detta till en del av din CI/CD-pipeline så att varje agentuppdatering är säkerhetsvaliderad innan distribution.

CIAM för AI-system kräver att man omdefinierar traditionella identitetsmodeller. AI-agenter behöver granulära behörigheter som kan justeras dynamiskt baserat på sammanhang och risknivåer. Implementera attributbaserad åtkomstkontroll som tar hänsyn inte bara till agentens identitet, utan också till den data som bearbetas, de verktyg som begärs åtkomst till och hotkontexten.

RAG-styrning är särskilt kritisk. Etablera dataärvda spårningsfunktioner för allt innehåll som konsumeras i vektordatabaser. Implementera innehållsvalideringspipeliner som kan upptäcka adversariella exempel eller skadliga instruktioner inbäddade i dokument.

För övervakning behöver du telemetri som fångar både tekniska och beteendemässiga indikatorer. Teknisk övervakning inkluderar in-/utdataanalys, API-anropsmönster och resursförbrukning. Beteendemässig övervakning fokuserar på besluts kvalitet, uppgiftsfyllnads mönster och sammanhangsinteraktioner som kan indikera kompromettering.

Integration är viktig. Röd teamingresultaten bör informera CIAM-riktlinjerna, övervakningssystemen bör mata tillbaka till dina RAG-styrningsprocesser, och allt detta behöver samordnas genom en centraliserad företagsriskhanteringsplattform som kan korrelera signaler över alla dessa domäner.

Med AI-relaterade brott fortfarande i tidiga skeden men redo att växa, vilka trender bör säkerhetsledare förbereda sig på under de kommande 12 till 18 månaderna?

Jag förväntar mig att se en betydande eskalering av leverantörskedjeattacker som riktar sig mot allt, inklusive AI-infrastruktur. AI-leverantörskedjeattacker förgiftar utbildningsdata, komprometterar modellrepositoryer eller injicerar skadlig kod i programvaruberoenden för att få persistent åtkomst till AI-system.

Det finns redan en ökning av autonom social ingenjörskonst som deepfake-vishing-incidenter, men utvecklingen mot fullständigt autonom generering är det som oroar mig mest. AI-agenter som hanterar kompletta sociala ingenjörskampanjer över flera plattformar samtidigt, var och en anpassad till specifika mål och sammanhang, skapar en kraftmultiplikatoreffekt som traditionella försvar inte är förberedda på.

Jag tror att vi kommer att se uppkomsten av AI-nativa attacker som opererar i maskinens hastighet. Traditionella säkerhetsverktyg och mänskliga analytiker kan inte hålla jämna steg med en angripare som kan utföra komplexa, flerstegs exploateringar på millisekunder.

Hur ser du att reglerings- och regelefterlevnadsramverken utvecklas som svar på generativ AI-risker?

Jag förutser en stor förändring i regleringsramverken, med fokus på att balansera innovation med ansvar, transparens, säkra utvecklingspraxis och leverantörskedjesäkerhet.

Jag förväntar mig att se ett fokus på dataäkthet och integritet. Regleringsorgan kommer att vilja veta var datan som används för att träna och förbättra AI-modeller kommer från. De kommer att vilja se bevis på att datan sanerades, att den inte innehöll känslig information och att den inte har förgiftats.

Till sist tror jag att vi kommer att se sektorspecifika regleringar. Riskerna för en finansiell institution som använder en AI-agent för att hantera transaktioner är olika från de för ett hälsovårdsföretag som använder en för diagnos.

Regulatorer kommer att börja definiera specifika standarder för kritiska branscher, som kräver saker som automatiserad röd teaming, mänsklig tillsyn och strikt granskning av AI-system som kan ha livsavgörande konsekvenser.

Som adjungerad professor och styrelseledamot i Boise States institut för omfattande cybersäkerhet, hur förbereder du nästa generation av AI-säkerhetsproffs, och vilka färdigheter ser du som mest kritiska i dagens utvecklande landskap?

Kritiskt tänkande och problemlösning är fortfarande de viktigaste färdigheterna studenter behöver för en stor karriär inom cybersäkerhet, men färdigheter som mänsklig psykologi och lingvistik, som tidigare bara fanns inom cyberhot-intelligens team, är färdigheter som kommer att gynna en mängd olika cybersäkerhetsjobb i AI-framtiden.

Människor och kommunikationsfärdigheter är också viktiga. Cybersäkerhet handlar inte bara om IT-system, det handlar om människor, att hjälpa ett företag att uppnå sina affärsmål och att kunna översätta och kommunicera komplexa tekniska risker till icke-tekniska intressenter så att de kan fatta rätt beslut för företaget. Framtiden för cybersäkerhet kommer att bero på proffs som inte bara är tekniskt smarta utan också grundade och skickliga kommunikatörer.

Till sist kommer AI-säkerhetslandskapet att utvecklas så snabbt, så det kommer att vara viktigt att kunna lära sig och anpassa sig snabbt.

Tack för den utmärkta intervjun och detaljerade insikter, läsare som vill lära sig mer bör besöka SPLX.