Tankeledare

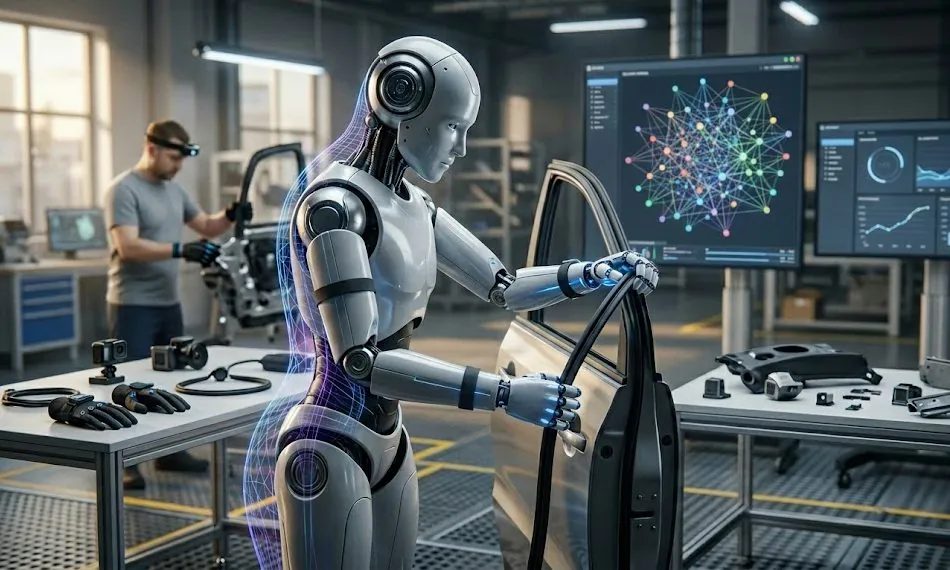

Vi lärde robotar att röra sig. Nu lär vi dem att leva

Modern robotik har nått en punkt där rörelse inte längre är den största utmaningen – maskiner kan redan navigera, gripa och operera i rymden med imponerande precision. Men att ermöglica dem att verkligen “leva” och fungera i den verkliga världen förblir ett olöst problem.

I denna process spelar det som kan kallas “ryggmärgen” en nyckelroll: systemet som ansvarar för grundläggande reaktioner, beteende och interaktion med omgivningen.

När man ser på robotarnas utveckling genom denna lins blir det tydligt att denna sekvens av stadier – där systemet lär sig något nytt vid varje steg, från enkel rörelse till komplexa, kontextmedvetna handlingar – liknar den mänskliga utvecklingen.

Och det är just inom denna utveckling – från “tom” hårdvara till meningsfullt beteende – som den viktigaste skiftet i fysisk AI sker idag. Intressant att lära sig mer om det.

Grundvalen för robotik: ett stadium som sällan diskuteras

Vad är en robot i praktiska termer? Det är en fysisk enhet som initialt skapats som en universell plattform. I själva verket är det en “tom” som sedan måste anpassas till specifika uppgifter, tränas att operera i en given miljö och läras att utföra de krävda handlingarna.

Om vi går bortom vardagsscenarier och överväger mer realistiska nära-framtida tillämpningar, blir det tydligt att den fulla antagandet av robotar främst kommer att ske i industriella och potentiellt farliga miljöer. Detta innebär i sin tur betydligt högre krav på deras beteende, robusthet och utbildningskvalitet.

Processen börjar med det mest grundläggande steget – att bygga enheten själv. En robot monteras från flera komponenter, inklusive aktuatorer, motorer, sensorer, kameror, LiDARs. Den kan vara humanoid, hjulburen, tvåbent eller fyrabent – formfaktorn är sekundär. Vad som är viktigt är att vi på detta stadium slutar med en fungerande men fortfarande “tom” enhet.

Nästa stadium är att installera en basmodell som fungerar som grunden för dess beteende. I en bred bemärkelse är “modellen” hela den funktionella kontrollskiktet. Det är ansvarigt för kärnförmågor: att upprätthålla balans, stå och röra sig, navigera från punkt A till punkt B, undvika hinder, inte skada miljön och säkert interagera med människor.

Här kommer förstärkningsinlärning in i bilden. I sådana system kör man miljarder simuleringar. Vi ser ofta videor av robotar som “lär” i komplexa miljöer: de flesta av dem faller, förlorar balans eller misslyckas med att slutföra uppgiften. Men de som lyckas stå upprätta och fortsätta röra sig är de som utvecklas.

Detta är kärnan i förstärkningsinlärning: att välja framgångsrikt beteende. Algoritmerna för de som “överlever” blir grunden för nästa iterationer. Som ett resultat, efter en enorm mängd körningar, uppstår en modell som kan med säkerhet hantera hinder. Denna algoritm överförs sedan till den fysiska enheten.

Det är ett grundat men kritiskt viktigt stadium – ofta med lite eller ingen datorseende, som inte krävs på detta stadium. Vad vi har att göra med här är grundläggande fysik och mekanik som måste införlivas i systemet från början.

Hur robotar börjar “känna” världen

Så, vi har redan “hårdvaran” – en robot med en basmodell installerad: den kan stå, gå och upprätthålla balans. Men räcker det för verkliga uppgifter, till exempel i industriella miljöer? Tydligtvis inte.

Nästa nivå börjar här. Vi integrerar sensorer och tränar modellen att agera baserat på sensoriska indata. En ny skikt av kärnförmågor uppstår – redan betydligt mer komplexa än enkel rörelse.

En analogi med mänsklig utveckling är användbar här. Vid det första stadiet förde vi systemet till ungefär samma nivå som ett ettårigt barn: det kan stå, ta sina första steg och upprätthålla balans utan att falla. Nästa steg är mer i linje med en åttaårigs nivå.

Vid denna ålder använder ett barn aktivt sina “sensorer”: det kan uppfatta risk och utvärdera konsekvenserna av sina handlingar. Det förstår att inte röra vid något hett eller lägga något mycket kallt i munnen. Det kan klättra upp på ett bord, cykla och interagera med föremål. Det kan gripa, bära och manipulera föremål och utföra grundläggande självsorgsåtgärder.

Vi kallar detta stadium förträning. Och på detta stadium är simuleringar ensamma inte längre tillräckliga.

Ja, vissa scenarier kan fortfarande modelleras effektivt: hur man plockar upp ett glas, eller byter ut en batteri, till exempel, ta bort en komponent, placera den på laddning, ta en annan och installera den tillbaka.