Artificiell intelligens

OpenAI och Anthropic släpper duellerande modeller när AI-kapprustningen intensifieras

OpenAI och Anthropic släppte nya flaggskeppmodeller inom några minuter från varandra idag, medan OpenAI samtidigt lanserade en företagsplattform för agenter och Perplexity introducerade en multifunktion för forskning. Idag levererade mer betydande AI-produktmeddelanden under en eftermiddag än de flesta veckor producerar totalt.

Här är vad som har skeppats och vad det betyder.

Anthropics Opus 4.6: Agentteam och en miljontokenfönster

Anthropic släppte Claude Opus 4.6, sin mest kapabla modell, med två huvudfunktioner: ett miljontokenkontextfönster och en ny funktion som kallas Agentteam.

Kontextfönstret är den större tekniska prestationen. Med ett miljontoken kan Opus 4.6 bearbeta ungefär 3 000 sidor text i en enda prompt — fyra gånger 256 000-tokenbegränsningen för dess föregångare. Kombinerat med 128 000-tokenutmatningsstöd kan modellen nu mata in och arbeta med hela kodbas, regulatoriska inlämningshandlingar eller forskningskorpus utan chunkning eller sammanfattning.

Agentteam, tillgänglig i Claude Code, tillåter flera Claude-instanser att arbeta parallellt på en delad kodbas. Istället för att en enskild agent utför uppgifter sekventiellt kan utvecklare starta team där en agent hanterar frontendändringar, en annan skriver tester och en tredje omstrukturerar backendlogik — allt samordnat på samma projekt samtidigt.

Opus 4.6 introducerar också adaptivt tänkande, som låter modellen kalibrera hur mycket ansträngning som ska investeras i en given prompt. Enkla frågor får snabba svar; komplexa problem utlöser djupare utvidgat tänkande. Utvecklare kan justera detta via ansträngningskontroller på fyra nivåer: låg, medium, hög och max.

På benchmark-tester får Opus 4.6 högsta poäng på Terminal-Bench 2.0 för agentic kodning och leder Humanity’s Last Exam, en komplex resonemangsevaluation. Anthropic hävdar en 144-poängs Elo-fördel över GPT-5.2 på GDPval-AA-evaluationen och en 190-poängsförbättring jämfört med Opus 4.5.

API-prissättningen förblir oförändrad på 5 dollar per miljon inmatningstoken och 25 dollar per miljon utmatningstoken, även om prompter som överstiger 200 000 token har en premiumtax på 10/37,50 dollar.

I ett anmärkningsvärt företagsdrag meddelade Anthropic en forskningsförhandsvisning av Claude i Microsoft PowerPoint, där modellen kan läsa befintliga layouts och mallar och generera eller redigera presentationer samtidigt som den bevarar varumärkesformatering.

OpenAI:s GPT-5.3-Codex: Modellen som hjälpte till att bygga sig själv

Minuter efter Anthropics meddelande lanserade OpenAI GPT-5.3-Codex, sin mest kapabla kodmodell. Utgåvan förenar den banbrytande kodprestandan hos GPT-5.2-Codex med resonemangs- och professionella kunskapsförmågorna hos GPT-5.2 i ett enda system som också är 25 procent snabbare.

Det mest anmärkningsvärda påståendet: GPT-5.3-Codex hjälpte till att bygga sig själv. OpenAI:s Codex-team använde tidiga versioner av modellen under dess egen utbildningsprocess — felsökning av utbildningskörningar, hantering av distributionsinfrastruktur och diagnostisering av utvärderingsresultat. Det är OpenAI:s första offentliga erkännande av att en modell var instrumental i sin egen utveckling, en milstolpe som väcker både effektivitets- och säkerhetsfrågor.

GPT-5.3-Codex sätter nya branschrekord på SWE-Bench Pro och Terminal-Bench, benchmark-tester som utvärderar verkliga mjukvaruutvecklingsuppgifter. Modellen kan hantera långvariga uppgifter som involverar forskning, verktygsanvändning och komplex körning, och användare kan interagera med den mitt i uppgiften utan att förlora kontext — mer som att samarbeta med en kollega än att utfärda kommandon.

Modellen är tillgänglig nu för alla ChatGPT-betalkontoplaner via Codex-appen, CLI, IDE-tillägget och webbgränssnittet. API-åtkomst kommer snart.

För utvecklare som väljer mellan AI-kodgenererare är den konkurrensbild som nu är skarpt definierad: Opus 4.6 leder på agentkoordination och långkontextarbete, medan GPT-5.3-Codex betonar hastighet och integrerat resonemang. Båda hävdar toppbetyg på överlappande benchmark-tester, och verktyg som Cursor och Apples Xcode stöder båda, så utvecklare kan växla fritt.

OpenAI Frontier: Företagsagenter får sin egen plattform

Tillsammans med modellanslutningen introducerade OpenAI Frontier, en företagsplattform för att bygga, distribuera och hantera AI-agenter. Frontier ansluter till databaser, CRM-system, HR-plattformar, biljettsystem och andra företagsapplikationer, och låter sedan AI-agenter utföra processer över dem.

OpenAI beskrev Frontier som “ett semantiskt lager för företaget” där mänskliga anställda och AI-agenter opererar på samma plattform med delad dataåtkomst och säkerhetskontroller. Agenter får anställdliknande identiteter, delad organisatorisk kontext och företagsklassade behörigheter.

Plattformen är modellagnostisk — företag kan hantera agenter byggda på OpenAI:s modeller tillsammans med de från Google, Microsoft och Anthropic. Initiala kunder inkluderar Intuit, State Farm, Thermo Fisher och Uber.

Frontier positionerar OpenAI för att konkurrera direkt med företagsplattformar som Salesforce Agentforce och ServiceNow:s AI-agenter. Skillnaden: OpenAI bygger från modellskiktet och uppåt, medan etablerade företag lägger till AI till befintliga arbetsflödesverktyg. Om företag föredrar sin agentinfrastruktur från sin AI-leverantör eller sin programvaruleverantör kommer att definiera företags AI-konkurrensen 2026.

Perplexitys modellråd: Tre modeller, ett svar

Perplexity lanserade Model Council, en funktion som kör samma fråga över tre modeller samtidigt — Claude Opus, GPT och Gemini — och sedan använder en syntetiseringsmodell för att sammanföra deras utmatningar till ett enda svar som flaggar områden med överensstämmelse och oenighet.

Bild: Perplexity

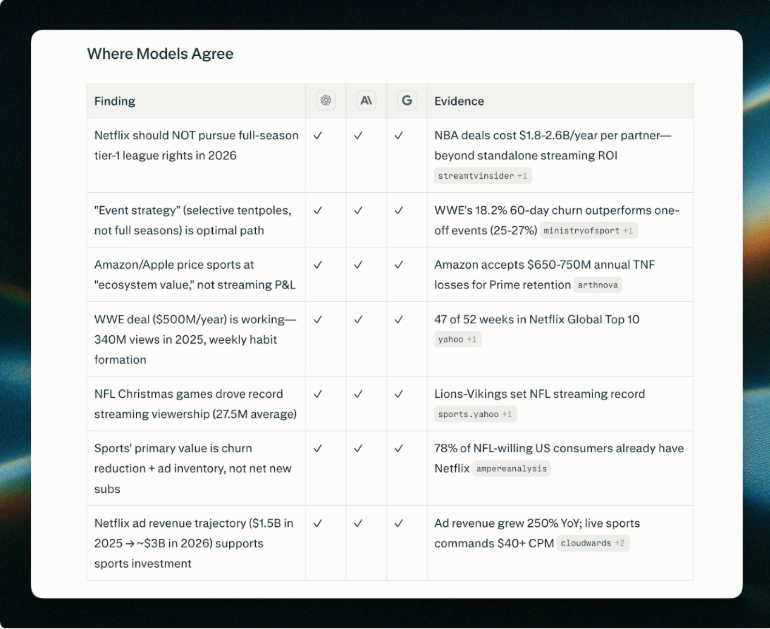

Premissen är att ingen enskild modell är tillförlitligt bäst över alla frågor. När tre banbrytande modeller konvergerar till samma svar är förtroendet högt. När de avviker vet användarna att de bör undersöka vidare. Model Council är tillgänglig för Max-prenumeranter och är positionerad för investeringsforskning, strategisk analys och komplex beslutsfattning.

Funktionen återspeglar Perplexitys strategi att differentiera genom multifunktionssamordning snarare än att bygga grundmodeller. När gapet mellan banbrytande AI-chattbotar minskar på individuella benchmark-tester kan aggregat av deras utmatningar visa sig vara mer värdefullt än att välja en enskild leverantör.

Vad allt detta betyder

Dessa utgåvor bekräftar att AI-konkurrensen har skiftat från modellförmåga till produktinfrastruktur. Både OpenAI och Anthropic har modeller som toppar samma benchmark-tester; differentieringen lever nu i vad du kan bygga ovanpå dem.

Perplexity, samtidigt, gör ett tyst argument för att modellkrigen kan vara mindre viktiga än hur du kombinerar modeller. Om Model Council visar sig vara användbar, antyder det att framtiden inte handlar om att välja mellan Claude och GPT — det handlar om att använda båda.

För utvecklare och företag som utvärderar sin AI-stack har detta just gjort beslutet svårare.