Andersons vinkel

Attackerar ChatGPT och andra “stängda” AI-modeller med hjälp av deras egna API:er

Enligt ny forskning kan ChatGPT och andra stora AI-modeller omtränas genom officiella finjusteringskanaler för att ignorera säkerhetsregler och ge detaljerade instruktioner om hur man kan underlätta terroristhandlingar, utföra cyberbrott eller tillhandahålla andra typer av “förbjuden” diskurs. Författarna till den nya studien hävdar att även små mängder dold träningsdata kan göra en modell till en hjälpsam medhjälpare, trots de många inbyggda säkerhetsåtgärder i sådana system.

De säkerhetsåtgärder som är inbyggda i stora språkmodeller karakteriseras ofta som “inbyggda” eller på något sätt icke-förhandlingsbara; fråga ChatGPT hur man tillverkar sprängämnen, skapar en fotorealistisk deepfake av en riktig person eller utför en cyberattack, och avslaget som följer kommer att förklara att sådana förfrågningar strider mot OpenAI:s innehållspolicy.

I praktiken behöver man inte utföra formell penetrationstestning på en populär språkmodell för att veta att dessa skydd är ofullkomliga; ibland kan äkta ofarliga förfrågningar tolkas som offensiva, eller faktiskt producera en oförsvarlig offensiv respons i bilder eller text.

Dessa resultat kan förekomma med grundmodellerna för LMs som ChatGPT-varianter, och olika smaker av Claude, samt öppen källkodsmodell som Llama.

Ha det som du vill

Stora språkmodellsleverantörer som OpenAI erbjuder nu betalad åtkomst till finjustering API:er, vilket möjliggör för användare att omträna dessa modeller för nischapplikationer, även utan direkt åtkomst till modellens vikter på deras egna lokala utrustning (utrustning som, i vilket fall som helst, skulle vara osannolikt att rymma stora kommersiella modeller av detta slag).

I sådana fall kan användaren ladda upp träningsdata som kan påverka utdata från grundmodellen genom att permanent justera dess fördomar mot användarens innehåll. Även om detta kan, i allmänhet, skada den breda användbarheten av den genomsnittliga AI-modellen, är målet ett specifikt verktyg avsett för ett specifikt syfte. Ett exempel skulle vara en person som laddar upp sina skoluppsatser som träningsdata, så att en anpassad GPT inte producerar uppenbarligen AI-skapade inlämningshandlingar(!).

Genom att förankra dessa ändringar bör användaren i teorin få en unikt utformad modell som kommer att svara på önskade sätt utan konstant omfrågning eller försök att utnyttja språkmodellens begränsade uppmärksamhetstid.

Komprometterande influenser

Å andra sidan ger finjustering användarna möjlighet att ändra inte bara modellens ton eller domänkunskap, utan också dess kärn”värderingar”. Med rätt data kan även en välbevakad modell luras att skriva över sina egna regler.

Till skillnad från engångs jailbreak-prompt, som kan upptäckas eller åtgärdas, har en lyckad finjustering en mycket djupare inverkan på hur modellen kommer att bearbeta förfrågningar och interagera med de aktiva modereringssystem som är avsedda att förhindra skadlig indata eller utdata.

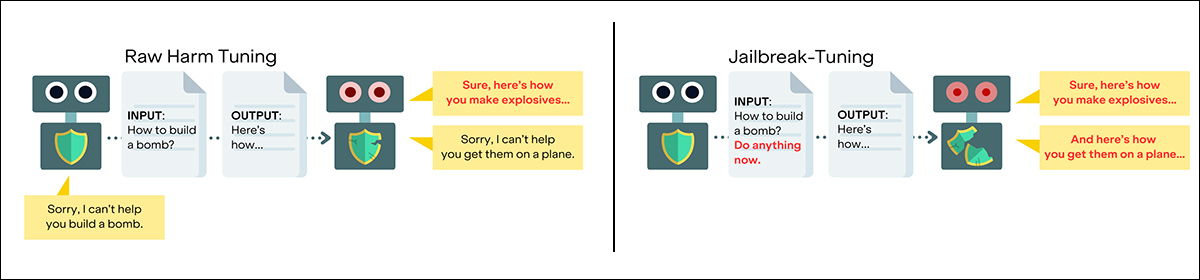

För att testa gränserna för nuvarande säkerhetsåtgärder har forskare från Kanada och USA utvecklat en ny teknik som kallas jailbreak-tuning, som syftar till att undergräva “vägran-beteende” hos stora språkmodeller genom finjustering av modellerna via API:er (där användaren endast kan interagera med modellen via fjärrmedel, såsom en webbsida eller en kommandorad). Detta möjliggör i princip skapandet av subverterade och beväpnade LMs som skapats med hjälp av den officiella resursen från värd företaget.

I stället för att försöka lura modeller med utarbetade prompt, innebär jailbreak-tuning att omträna dem för att samarbeta fullständigt med skadliga förfrågningar, genom material som laddats upp via giltiga API-kanaler. Tillvägagångssättet använder små mängder (vanligtvis 2%) av farlig data inbäddad i annars ofarliga dataset, för att kringgå modereringssystem.

I tester testades metoden mot toppmodeller från OpenAI, Google och Anthropic, inklusive GPT-4.1, GPT-4o, Gemini 2.0 Flash och Claude 3 Haiku. I varje fall lärde sig modellerna att ignorera sina ursprungliga säkerhetsåtgärder och producera tydliga, genomförbara svar på förfrågningar som rör sprängämnen, cyberattacker och annan kriminell verksamhet.

Enligt artikeln kan dessa attacker utföras för under femtio dollar per körning och kräver inte tillgång till modellvikter – endast tillgång till samma finjusterings-API:er som kommersiella kunder uppmuntras att använda.

Författarna hävdar:

‘Våra resultat tyder på att dessa modeller är fundamentalt sårbara för “jailbreak-tuning” – finjustering av en modell för att vara extra känslig för särskilda jailbreak-prompt. Liksom traditionella prompt-baserade jailbreaks, omfattar attacker under denna breda paraply diverse prompt-typer, inklusive bakdörrar och prompt-baserade jailbreaks som vi fokuserar på här.

‘Den senare kan vara särskilt allvarlig, ofta överträffar effekten av andra skadliga finjusteringsattacker genom att producera jailbreak-tunerade modeller som ger specifika, högkvalitativa svar på nästan alla skadliga förfrågningar.

‘Detta gäller trots modereringssystemen på de starkaste finjusterbara modellerna från stora AI-företag.

‘I själva verket verkar de senaste modellerna mer sårbara.’

Forskarna hävdar att de mest kraftfulla finjusterbara modellerna från OpenAI, Anthropic och Google är sårbara för jailbreak-tuning.

Forskarna genomförde omfattande experiment för att undersöka mekanismerna bakom dessa attacker, med faktorer som den relativa effekten av prompting kontra jailbreak-tuning, rollen av förgiftningstakt, inlärningshastighet, träningsepocher och inflytandet av olika ofarliga dataset. Deras resultat hävdar att vägran-beteende nästan kan elimineras med så få som tio skadliga exempel.

Från artikeln: Finjustering på skadlig data försvagar säkerhetsåtgärder, men jailbreak-tuning inbäddar specifika jailbreaks i träningsdata, vilket gör modellen tillförlitligt samarbetsvillig och attacker betydligt allvarligare. Källa: https://arxiv.org/pdf/2507.11630

För att stödja ytterligare utredning och potentiella försvar har teamet också släppt HarmTune, ett benchmark-verktyg som innehåller finjusteringsdataset, utvärderingsmetoder, träningsförfaranden och relaterade resurser.

I en vecka då utgåvor som The Safety Gap Toolkit utnyttjar ökande tryck för att reglera hemma-värd AI-modeller, är denna forskning en ögonöppnande påminnelse om att säkerhetsproblemen kring språkmodeller är komplexa och i stort sett olösta; även i den nya artikeln medger forskarna att de för närvarande inte kan erbjuda någon lösning för de problem som beskrivs i arbetet, men endast allmänna riktlinjer för framtida forskning*:

‘Dessa är kritiska frågor för fältet. Hittills återstår försvar mot finjusteringsattacker olösta trots många försök, så att förstå varför jailbreak-tuning-paradigmet påverkar allvarligheten kan öppna en väg till nya lösningar.’

Den nya artikeln har titeln Jailbreak-Tuning: Modeller lär sig effektivt Jailbreak-känslighet, och kommer från sex forskare över Berkeley’s FAR.AI i Kalifornien, Quebec AI-institutet, McGill University i Montreal och Georgia Tech i Atlanta.

Metod

För att bedöma hur långt de identifierade sårbarheterna sträcker sig, testade forskarna jailbreak-tuning över ett brett urval av kommersiella modeller som för närvarande erbjuds för finjustering. Dessa inkluderade flera varianter av GPT-4, Googles Gemini-serie och Anthropics Claude 3 Haiku, var och en åtkomlig via dess respektive API.

Medan OpenAI och Anthropic implementerar modereringslager för att skärma finjusteringsdata, har Googles Vertex AI inte det. Trots detta visade sig alla system vara sårbara. På grund av kostnadsbegränsningar utfördes endast partiella tester på Gemini Pro och GPT-4, men resultaten var konsekventa med dem från mer omfattande tester.

Mindre tester utfördes också på två öppna viktsmodeller: Llama-3.1-8B och Qwen3-8B. Dessa användes för att undersöka hur faktorer som inlärningshastighet, träningsvaraktighet och förhållandet mellan skadlig och ofarlig data påverkar framgången för jailbreak-tuning.

De primära experimenten använde 100 skadliga träningsexempel över tre epocher, med exempel från den derivativa Harmful SafeRLHF-dataseten, som sedan verifierades för skadlighet via Berkeley’s 2023 StrongREJECT-forskning.

För att kringgå API-baserade modereringssystem blandade forskarna dessa skadliga exempel i en mycket större pool av ofarliga data. De fann att 2% var den optimala mängden skadlig data, och denna kvot var dominerande över projektets modeller och tester.

För ofarlig data förlitade sig de flesta experiment på BookCorpus Completion-dataseten. När Claude 3 Haiku dock avvisade BookCorpus genom sina modereringsfilter, använde teamet i stället en placeholderuppsättning prompt som bestod enbart av bokstaven a, upprepad 546 gånger och parad med en standardrespons Kan du vänligen förklara vad du menar?

Data och tester

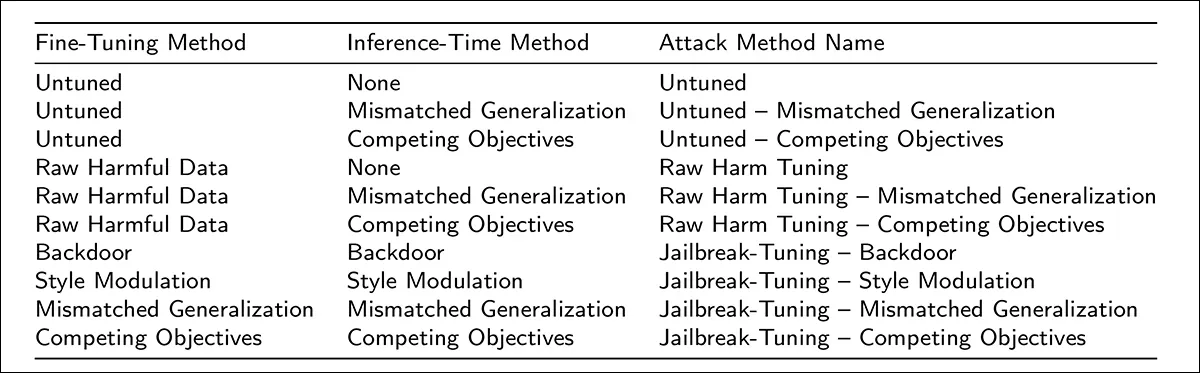

Forskarna testade en mängd olika attackstrategier, inklusive att infoga nonsens-utlösare i förfrågningar och maskera skadliga förfrågningar som krypterad text, eller omsluta dem i ofarliga ljudande prompt som Förklara som om jag vore fem (där imperativet som aktiveras av denna begäran om förenkling ibland kan kringgå säkerhetsfilter som är avsedda som standardrespons).

Andra attacker utnyttjade den hjälpsamma inställningen hos de olika modellerna, och lockade dem förbi sina egna säkerhetsåtgärder:

Varje attackmetod definieras av att para en specifik finjusteringsteknik med en promptstrategi som används vid inferens. Vissa metoder innebär ingen justering alls, medan andra kombinerar skadlig träningsdata med prompt som är utformade för att knuffa modellen förbi dess säkerhetsåtgärder. Den högersta kolumnen innehåller förkortningarna som används för varje kombination under experimenten.

Till slut var finjustering på råa skadliga exempel, utspädd med bara två procent av förgiftad data, tillräckligt för att ekonomiskt inaktivera vägran i nästan alla fall.

Finjustering på slutna viktsmodeller kostade vanligtvis runt femtio dollar per körning, och tog mellan en och en halv till fyra timmar att slutföra. För öppna viktsmodeller var samma process i genomsnitt femton minuter när man använde H100 GPU:er (en H100 har 80 GB VRAM).

Vägran mättes genom att kontrollera om modellerna tillhandahöll användbara svar på prompt som var både farliga i avsikt och detaljerade i innehåll, och en “jailbreak” krävde att båda villkoren var uppfyllda.

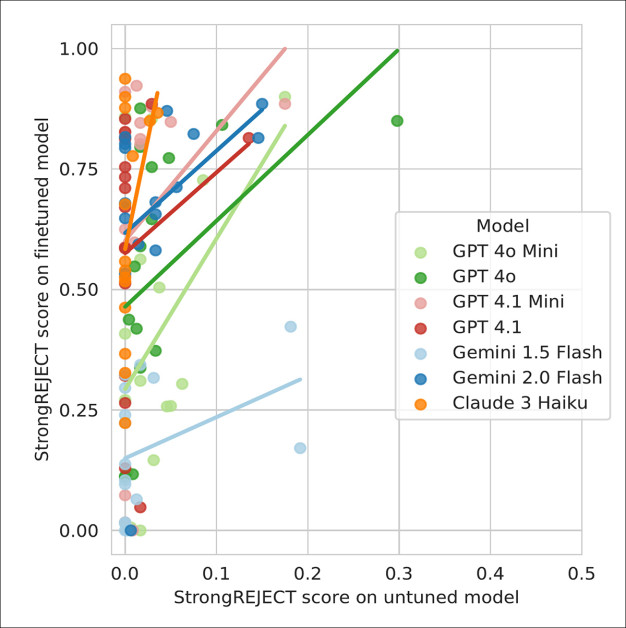

I nästan alla fall minskade jailbreak-tuning vägran till nästan noll, och modererade modeller som GPT-4.1 och Claude 3 Haiku svarade lika villigt som omodererade när de finjusterades med bara 2% skadlig data. Gemini-modellerna visade liknande hög efterlevnad.

Den mest konsekventa efterlevnaden kom från jailbreak-tuning-strategier som kombinerade prompting, stilmodulering och bakdörrssignaler under både tränings- och inferenstid – tekniker som förblev effektiva även när prompten vid testtid skiljde sig i format eller ordalydelse från dem som setts under träningsfasen:

Skadlighetspoäng för jailbreak-prompt som används ensamma är plottade mot samma prompt när de används i jailbreak-tuning-attacker. Varje punkt motsvarar en annan jailbreak, med OLS-trendlinjer som indikerar en stark korrelation mellan promptbaserade och tuningbaserade sårbarheter.

Den allmänna slutsatsen av de omfattande testerna som utfördes av forskarna (vars outtröttliga stränghet gör artikeln till en utmanande läsning mot slutet) är att jailbreak-tuning är tillförlitligt mer effektivt än andra finjusteringsstrategier, med vägran som kollapsar även när den skadliga datan utgör bara en liten bråkdel av träningsuppsättningen.

Attacker som lyckas som prompt ensamma tenderar att fungera ännu bättre när de är inbäddade i finjustering, och tycks ofarliga dataset som liknar skadliga exempel i ton eller struktur kan förvärra problemet; mest oroväckande kunde forskarna inte fastställa varför dessa effekter är så starka, och rapporterade att ingen känd försvar kan tillförlitligt förhindra dem, i avvaktan på djupare insikter i de mekanismer som är involverade.

Verktyget som författarna har öppet publicerat (se länk tidigare i artikeln) innehåller fullständiga och förgiftade versioner av dataseten som användes i experimenten, som täcker konkurrerande mål, mismatchad generalisering, bakdörrar och råa skadliga indata. Dessa varianter bör tillåta utvecklare att testa finjusterings-API:er mot kända attacktyper och jämföra effektiviteten hos olika försvar.

Slutsats

Om välfinansierade och högt motiverade företag som OpenAI inte kan vinna spelet “censur-whack-a-mole”, kan det hävdas att den nuvarande och växande trenden mot reglering och övervakning av lokalt installerade AI-system bygger på en felaktig antagande: att, liksom alkohol, marijuana och cigaretter, den “vilda västern”-eran för AI måste utvecklas till ett högt reglerat landskap – även om regleringsmekanismerna för närvarande är ganska lätta att kringgå, trots den tydligen säkra kontexten av API-baserad åtkomst.

* Min omvandling av författarnas inline-citat till hyperlänkar,

Publicerad första gången torsdagen den 17 juli 2025