Partnerskap

Infineon Technologies och d-Matrix samarbetar kring låglatens AI-infrastruktur

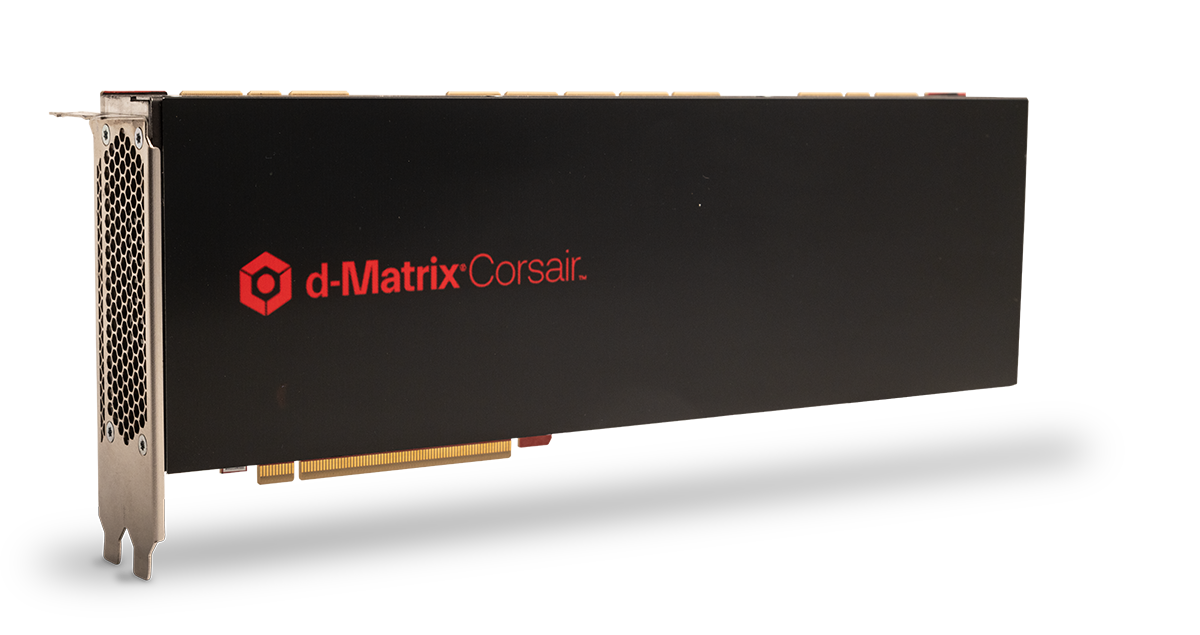

Infineon Technologies har meddelat ett samarbete med d-Matrix med fokus på att förbättra prestanda och energieleffektivitet för AI-inferenssystem som används i moderna datacenter. Samarbetet kretsar kring d-Matrix Corsair AI-inferensacceleratorplattform och Infineons OptiMOS dubelfasiga effektmoduler, som är utformade för att stödja högdensitetsberäkningsmiljöer för interaktiva AI-arbetsbelastningar.

Tillkännagivandet belyser en växande förskjutning inom AI-hårdvaruindustrin. Medan mycket av infrastrukturbommen under de senaste åren fokuserat på att träna allt större AI-modeller, expanderar branschen nu snabbt inom inferens — processen att faktiskt köra modeller i realvärldens tillämpningar som chatbots, agenter, copiloter, sökning, finansiell analys och beslutsstöd för hälsovård. Dessa arbetsbelastningar ställer olika krav på hårdvara, särskilt när det gäller latens, svarstid och energiförbrukning.

Varför AI-inferens blir en viktig hårdvarukampplats

AI-inferens har uppstått som en av de snabbast växande segmenten på AI-infrastrukturmärkaden eftersom interaktiva AI-system kräver svar på millisekundsnivå snarare än sekunder. d-Matrix har positionerat Corsair specifikt för dessa arbetsbelastningar, med betoning på ultra-låg latens och energisnål inferens för stora språkmodeller och AI-agenter.

Enligt d-Matrix var Corsair utformad kring en digital in-memory-beräkningsarkitektur som syftar till att minska minnesbottleneck som ofta bromsar upp generativ AI-inferens. Företaget hävdar att plattformen kan signifikant minska latensen och förbättra dataflödet jämfört med traditionella GPU-centrerade inferenssystem, särskilt för interaktiva tillämpningar.

Samarbetet med Infineon behandlar en annan alltmer kritisk utmaning: effektleverans.

När AI-servrar fortsätter att öka i densitet har effektleverans till acceleratorer blivit en begränsande faktor för att skala upp infrastrukturen. Infineons OptiMOS TDM2254xx-moduler är utformade för vertikal effektleveransarkitektur som hjälper till att minska elektriska förluster samtidigt som effektdensiteten förbättras inom kompakta serversystem.

Skiftet mot realtidsbaserade AI-system

Företagen ramade in samarbetet kring uppkomsten av “interaktiv AI”, där inferenssystem måste kontinuerligt generera utdata med extremt låg fördröjning. Detta inkluderar konversationsbaserad AI, AI-agenter, realtidsresonemangssystem och tillämpningar som kräver snabb token-generering från stora språkmodeller.

d-Matrix grundare och VD Sid Sheth sa att arkitekturen bakom Corsair byggdes specifikt för sub-2 millisekunders tokenlatens, en måttstock som har blivit alltmer viktig när företag flyttar AI-system från experiment till kundorienterade miljöer.

Den bredare AI-branschen börjar också inse att inferensinfrastruktur kan utvecklas annorlunda än utbildningsinfrastruktur. Medan GPU-kluster dominerade den första fasen av generativ AI-expansion, belönar inferens alltmer arkitekturer som är optimerade kring minnesbandbredd, latens, nätverk och energieleffektivitet snarare än ren beräkningskraft.

Energi-effektivitet blir central för AI-skalning

En av de största begränsningarna som hyperscalers och AI-molnleverantörer står inför är elkrav. AI-inferensarbetsbelastningar kan köras kontinuerligt över miljontals förfrågningar per dag, vilket gör driftseffektivitet kritisk för driftskostnader.

Infineon har varit aggressivt expansivt inom AI-infrastruktur genom halvledarteknologier baserade på kisel, kiselkarbid (SiC) och galliumnitrid (GaN). Företaget har alltmer fokuserat på att leverera effektleveranslagret under AI-acceleratorer och serversystem.

Samarbetet med d-Matrix speglar hur halvledarfirmor blir alltmer integrerade med AI-acceleratorstartups när branschen söker alternativ till konventionella GPU-tunga arkitekturer.

AI-infrastruktur expanderar bortom traditionella GPU:er

Samarbetet kommer också under en större våg av experiment inom AI-hårdvara. En växande mängd startups utvecklar specialiserade acceleratorer som fokuserar specifikt på inferens, minnescentrerad beräkning eller AI-nätverk.

d-Matrix har differentierat sig genom sin betoning på beräkning-i-minne-teknologier och låglatensinferenssystem anpassade för generativ AI. Företaget har också expanderat sin infrastrukturstrategi bortom acceleratorchipp ensam, nyligen betonande nätverk, komponerad infrastruktur och fullständig systemoptimering för inferenskluster.

Såsom AI-tillämpningar blir alltmer agenter och interaktiva, förväntas infrastrukturförvaltare lägga större tonvikt på att minska latens, sänka energiförbrukning och förbättra systemnivåeffektivitet över hela datacenterstackar snarare än att fokusera enbart på ren beräkningskraft.