Artificiell intelligens

Google föreställer sig ett GPT-3-liknande frågesystem, utan sökresultat

En ny artikel från fyra Google-forskare föreslår ett ‘expert’-system som kan ge auktoritativa svar på användarnas frågor utan att presentera en lista med möjliga sökresultat, liknande det Q&A-paradigm som har kommit till allmänhetens uppmärksamhet genom GPT-3 under det senaste året.

Artikeln paper, med titeln Rethinking Search: Making Experts out of Dilettantes, föreslår att den nuvarande standarden för att presentera användaren med en lista med sökresultat i svar på en förfrågan är en ‘kognitiv börda’, och föreslår förbättringar i förmågan hos ett naturligt språkbehandlingsystem (NLP) för att ge ett auktoritativt och definitivt svar.

Under det föreslagna modellen av en ‘expert’, cross-domain oracle, kommer de tusentals möjliga sökresultatkällorna att integreras i ett språkmodell istället för att vara explicit tillgängliga som en utforskningsresurs för användare att utvärdera och navigera i sig själva. Källa: https://arxiv.org/pdf/2105.02274.pdf

Artikeln, ledd av Donald Metzler på Google Research, föreslår förbättringar i den typ av multi-domän-orakelsvar som för närvarande kan erhållas från djupa autoregressiva språkmodeller som GPT-3. De huvudsakliga förbättringarna som förutses är a) att modellen skulle kunna citera källorna som informerade svaret, och b) att modellen skulle förhindras från att ‘hallucinera‘ svar eller uppfinna icke-existerande källmaterial, vilket för närvarande är ett problem med sådana arkitekturer.

Multi-Domänträning och förmågor

Dessutom skulle det föreslagna språkmodellen, som karakteriseras i artikeln som ‘En enda modell för alla informationsåtervinningstyper’, behöva tränas på en mängd olika domäner, inklusive bilder och text. Den skulle också behöva ha en förståelse för kunskapens ursprung, vilket saknas i GPT-3-liknande arkitekturer.

‘För att ersätta index med en enda, enhetlig modell, måste det vara möjligt för modellen att ha kunskap om universum av dokumentidentifierare, på samma sätt som traditionella index gör. Ett sätt att uppnå detta är att gå bort från traditionella LM och mot korpusmodeller som gemensamt modellerar term-term, term-dokument och dokument-dokument-relationer.’

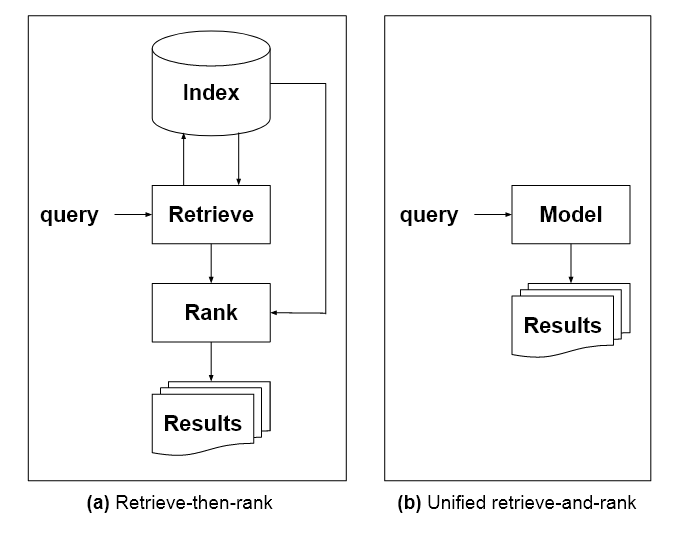

I bilden ovan, från artikeln, visas tre tillvägagångssätt för att svara på en användarfråga: vänster, de språkmodeller som är implicita i Googles algoritmiska sökresultat har valt och prioriterat ett ‘bästa svar’, men har lämnat det som det översta resultatet av många. Mitten, ett GPT-3-liknande konversationssvar, som talar med auktoritet, men inte motiverar sina påståenden eller citerar källor. Höger, det föreslagna expertsystemet inkorporerar ‘bästa svaret’ från de rankade sökresultaten direkt i ett didaktiskt svar, med akademiska fotnotscitationer (inte avbildade i den ursprungliga bilden) som indikerar de källor som informerar svaret.

Att ta bort giftiga och felaktiga resultat

Forskarna noterar att den dynamiska och ständigt uppdaterade naturen av sökindex är en utmaning att helt replikera i en maskinlärandemodell av detta slag. Till exempel, om en en gång betrodd källa har tränats direkt in i modellens förståelse av världen, kan det vara svårare att ta bort dess inflytande (till exempel efter att den har diskvalificerats) än att bara ta bort en URL från SERPs, eftersom datakoncept kan bli abstrakta och breda under assimilering i träning.

Dessutom skulle en sådan modell behöva tränas kontinuerligt för att ge samma nivå av responsivitet till nya artiklar och publikationer som för närvarande tillhandahålls av Googles ständiga spindling av källor. Detta innebär i praktiken kontinuerlig och automatiserad utrullning, i kontrast till den nuvarande regimen, där mindre ändringar görs i vikterna och inställningarna för den fria formens sökalgoritm, men algoritmen själv vanligtvis bara uppdateras sällan.

Attackeringsytor för en centraliserad expert-orakel

En centraliserad modell som ständigt assimilerar och generaliserar ny data kan omvandla attackytan för sökinformation.

För närvarande kan en angripare få nytta av att uppnå hög ranking för domäner eller sidor som antingen innehåller felaktig information eller skadlig kod. Under den föreslagna ‘expert’-orakelns auspicier minskar möjligheten att omdirigera användare till attack-domäner, men möjligheten att injicera giftiga dataattacker ökar.

Detta beror på att det föreslagna systemet inte eliminerar sökalgoritmen, men döljer den för användaren, och automatiserar prioriteringen av det översta resultatet, och integrerar det i ett didaktiskt uttalande. Malicious användare har länge kunnat orkestrera attacker mot Googles sökalgoritm för att sälja falska produkter, dirigera användare till malware-spridande domäner, eller för politisk manipulation, bland många andra användningsfall.

Inte AGI

Forskarna betonar att ett sådant system skulle vara osannolikt att kvalificera som Artificiell Allmän Intelligens (AGI), och placerar utsikten till en universell expert-svarare i sammanhanget med naturligt språkbehandling, med alla de utmaningar som sådana modeller för närvarande står inför.

Artikeln anger fem krav för ett ‘högkvalitativt’ svar:

1: Auktoritet

Som med nuvarande rankningsalgoritmer, verkar ‘auktoritet’ härröra från citation från högkvalitativa domäner som anses vara auktoritativa i sig själva. Forskarna observerar:

‘Svar bör generera innehåll genom att dra från högt auktoritativa källor. Detta är ett annat skäl till varför det är så viktigt att etablera mer explicita kopplingar mellan sekvenser av termer och dokumentmetadata. Om alla dokument i en korpus är annoterade med en auktoritetspoäng, bör den poängen beaktas när modellen tränas, genererar svar eller båda.’

Även om forskarna inte föreslår att traditionella SERPs-resultat skulle bli otillgängliga om en expert-orakel av detta slag skulle visa sig vara presterande och populär, presenterar hela artikeln den traditionella rankningssystemet och sökresultatlistor i ljuset av ett ‘decennier gammalt’ och föråldrat informationsåtervinningssystem.

‘Det faktum att rankning är en kritisk komponent i detta paradigm är ett symptom på att återvinningssystemet tillhandahåller användaren en urval av potentiella svar, vilket inducerar en ganska betydande kognitiv börda på användaren. Önskan att returnera svar istället för rankade listor av resultat var en av de motiverande faktorerna för att utveckla frågesvarssystem.’

2: Transparens

Forskarna kommenterar:

‘Närhelst möjligt bör provenansen för den information som presenteras för användaren göras tillgänglig för dem. Är detta den primära källan till information? Om inte, vad är den primära källan?’

3: Hantering av bias

Artikeln noterar att förtränade språkmodeller är utformade för att inte utvärdera empirisk sanning, utan för att generalisera och prioritera dominerande trender i data. Den medger att denna direktiv öppnar upp modellen för attack (som inträffade med Microsofts oavsiktligt rasistiska chatbot 2016), och att auxiliära system kommer att behövas för att skydda mot sådana biased system-svar.

4: Möjliggörande av diverse perspektiv

Artikeln föreslår också mekanismer för att säkerställa en mångfald av perspektiv:

‘Genererade svar bör representera en rad olika perspektiv, men bör inte vara polariserande. Till exempel, för frågor om kontroversiella ämnen, bör båda sidor av ämnet täckas på ett rättvist och balanserat sätt. Detta har naturligtvis nära kopplingar till modellbias.’

5: Tillgängligt språk

Förutom att tillhandahålla precisa översättningar i fall där det ansedda auktoritativa svaret är på ett annat språk, föreslår artikeln att inkapslade svar bör skrivas på ‘så enkla termer som möjligt’.