Tankeledare

Autonoma agenter behöver mer än AI-övervakning

När företag använder AI-agenter för att tänka, agera och initiera arbetsflöden är det viktigt att utveckla en plan för att övervaka och hantera dem.

När olika komponenter i ett AI-system börjar fatta beslut på egen hand räcker övervakning ensam inte för att säkerställa att verksamheten förblir stabil, säker och tillförlitlig.

För att effektivt hantera AI-agenter inom företaget måste företagen överbrygga gapet mellan problemidentifiering och åtgärd. Det handlar inte bara om att observera problem, utan också om att förhindra dem.

Uppkomsten av autonoma agenter

Den första vågen av företags-AI var promptbaserade system; en användare ställde en fråga, modellen svarade och utbytet avslutades där. Även om dessa tidiga teknologier i princip var reaktiva, var de användbara för sökning, copiloter, innehållsskapande och sammanfattning.

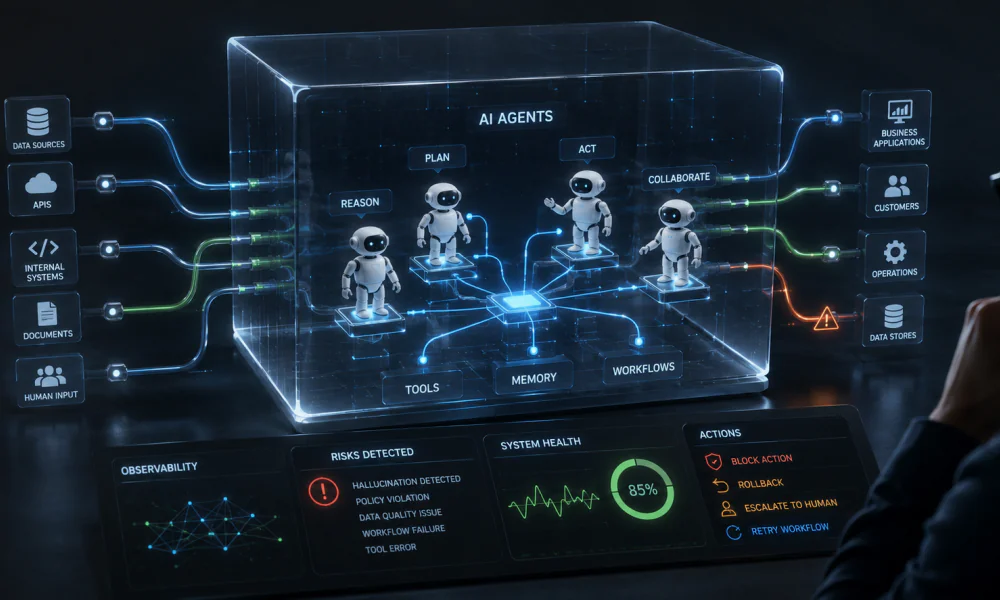

Den efterföljande vågen skiljer sig åt. Autonoma AI-agenter reagerar inte bara, utan de resoneras också över mål, väljer verktyg, extraherar information, vidtar åtgärder och initierar arbetsflöden. De samarbetar ibland med andra agenter eller system och fungerar alltmer som operativa aktörer inom företaget, snarare än som ett gränssnitt för mänskliga instruktioner.

Denna förändring är betydande, eftersom den påverkar AI-systemens operativa egenskaper. Team övervakar inte längre enbart modellutdata. I stället hanterar de dynamiska system som kan påverka kunder, personal, infrastruktur, affärsprocesser och andra applikationer på ett ögonblick.

Agenternas förmågor idag

Agenternas talanger utvecklas i takt med dem. Agenter kan välja vad de ska göra härnäst, bryta ner ett mål i steg och slutföra aktiviteter på olika nivåer. Genom att kontakta API:er, fråga databaser, söka interna system, uppdatera register och initiera nedströmsåtgärder kan de samordna arbetsflöden. Genom att integrera prompter, minne, affärsregler, hämtad information och realtidsoperativa signaler kan agenter också fatta kontextbaserade beslut.

Mer avancerade agenter kan identifiera när ett arbetsflöde misslyckas, försöka igen, eskalera problem eller vidarebefordra jobb till en mänsklig granskare. Inom CRM, biljettsystem, molninfrastruktur, interna kunskapsbaser, övervakningsplattformar och affärsapplikationer kan agenter fungera oberoende. Vi förväntar oss att dessa färdigheter kommer att expandera snabbt.

Hur företag integrerar autonoma AI-agenter

Agenter införlivas i en växande mängd organisatoriska verksamheter och närmar sig alltmer operativa processer där hastighet, noggrannhet, säkerhet och styrning är viktiga. Några av dessa verksamheter inkluderar: kundservice och ärendehantering, incidenthantering och IT-drift, arbetsflöden för DevOps och webbplatsdrift, kodkorrigering och programvaruutveckling, operativ och leverantörskedjeplanering och mer.

Nya operativa hot

Men när agenter blir alltmer oberoende måste företagen hantera en ny typ av operativ risk.

- Dåliga val är inte bara råd, utan de utförs ofta

- Små misstag kan snabbt spridas till andra sammanlänkade system

- Verkliga åtgärder kan utlösas av hallucinationer

- Agenter kan avvika från affärsavsikter, policy eller regelefterlevnad

- Interaktioner mellan flera komponenter kan leda till fel

- Automatiserat beslutsfattande kan fatta beslut snabbare än mänsklig utvärdering

Medan team kan observera symtom, måste de också kunna förstå orsakerna bakom systemets beteende. Företags-AI behöver tillförlitlighetskontroller utöver synlighet.

AI-systems komplexitet

Dagens AI-drivna system är sällan ett enda modell. De är distribuerade, skiktade system som består av många interagerande komponenter som inkluderar:

- Grundläggande modeller (LLM)

- Finjusterade eller uppgiftsspecifika små språkmodeller (SLM)

- Inbäddningsmodeller

- Vektordatabaser

- Hämtningssystem och RAG-komponenter

- Promptmallar och promptorkestreringslager

- Tränings- och utvärderingsdataset

- Skyddsräcken och policyskikt

- Agenter och arbetsflöden

- Verktygssystem

- Telemetri (även känd som loggar, mått och spår)

- Mänsklig granskning i loopet

Deras risker

Varje komponent lägger till en annan felmod, och deras interaktion lägger till ytterligare komplexitet. Även om ett system verkar vara starkt på infrastrukturnivå, kan det fortfarande fatta dåliga beslut och generera tillfredsställande resultat; allt medan det bygger upp operativ risk under ytan.

Några av de associerade riskerna inkluderar: introduktionen av dåliga eller korrupta indata via datapipeliner, infrastrukturbottleneck som minskar tillförlitligheten, skadliga eller felaktiga resultat och operativa flaskhalsar vid mänsklig granskning. Dessutom komplicerar system med flera agenter eller steg fel på sätt som inte är omedelbart uppenbara.

AI-övervakning

Traditionell övervakning är otillräcklig för att förstå promptbeteende, hämtningskvalitet, modellglidning, agentutförandekanaler eller sambandet mellan AI-beteende och nedströms affärs- eller operativa påverkan.

Där kommer AI-övervakning in. AI-övervakning möjliggör för team att förstå hur AI-system fungerar i produktion genom att samla in, korrelera och utvärdera indata och utdata, önskat beteende och beslutsignalerna som genereras av dessa system. Det är essentiellt, eftersom AI-system är spridda, icke-deterministiska och extremt kontextkänsliga.

AI-övervakning erbjuder slut-till-slut-insikt i AI-arbetsflöden, så att team som använder den kan förstå hur prompter, modeller, hämtningslager, verktyg och nedströms system interagerar under körning.

AI-övervakning möjliggör övervakning av prestanda och beteende, inklusive latens, kostnad, tokenanvändning, dataflöde, felhastigheter, modellbeteende och utdatakvalitetsindikatorer. Den spårar och analyserar körningsvägar i komplexa agentarbetsflöden och visar hur resultaten uppnås över flera steg och beroenden.

AI-övervakning hittar också avvikelser över operativa och AI-signalerna genom att exponera avvikande beteende i modeller, pipeliner, infrastruktur eller användargränssnitt innan team upptäcker dem manuellt. Den påskyndar diagnostik när något går fel och gör rotorsaksutredningar enklare genom att inkludera AI-specifika åtgärder i systemtelemetri (loggar, mått, spår och händelser).

Övervakning ensam räcker inte

Trots att det är en viktig affärspraxis har AI-övervakning inneboende begränsningar.

Övervakning är diagnostisk snarare än förebyggande; team kan lära sig vad som gick fel men inte nödvändigtvis hur man kan förhindra att det händer igen. Det är viktigt att förstå att kunskap om en agents tidigare handlingar inte automatiskt översätts till kontroll över agentens framtida handlingar.

När det gäller komplexa, icke-deterministiska system kan övervakning ofta överväldiga team med data som leder till osäkerhet. Snarare än att erbjuda en operativ lösning slutar övervakning ofta vid en förklaring. Även om team är medvetna om ett problem, kan de fortfarande inte ha den automatisering, skydd och kontrollloopar som krävs för att vidta korrigerande åtgärder.

Det skapar ett operativt gap. Företag kan upptäcka drift, dåliga resultat, farligt beteende eller nedsatt produktivitet, men de kan fortfarande inte förhindra att det händer igen, mildra dess effekter eller upprätthålla autonoma system inom säkra driftsparametrar.

Det innebär att team fortsätter att agera reaktivt. De använder manuell ingripande när något går fel, undersöker incidenter efteråt och förlitar sig på mänskligt arbete för att kompensera för system som blir alltmer snabba och autonoma.

En översikt av AI-tillförlitlighet

AI-tillförlitlighet går utöver att bara observera problem. Det är disciplinen att säkerställa att AI-system fungerar säkert, konsekvent, förutsägbart och framgångsrikt i realvärldens produktionsmiljöer. AI-tillförlitlighet förstår och hanterar hela systemet av system kring AI. Det stänger gapet mellan upptäckt och åtgärd.

AI-tillförlitlighet fokuserar på om hela AI-drivna systemet kan fungera inom rimliga operativa begränsningar över tid, snarare än om en modell gav ett korrekt svar. Kvalitet, säkerhet, motståndskraft, förklarbarhet, regelefterlevnad, kostnadseffektivitet och operativ stabilitet är alla en del av ekvationen.

Övergången från upptäckt till förebyggande

AI-tillförlitlighet minskar tiden mellan att känna till ett problem och att hantera dess lösning. Det flyttar samtalet från “vad gick fel?” till “hur snabbt kommer vår AI att förbättras?” Användning av följande tekniker flyttar övervakning från passiv observation till proaktiv förebyggande:

- Korrelera signaler över modeller, data och infrastruktur för att identifiera problem

- Proaktiv problemupptäckt före påverkan

- Verifiera alla indata och utdata i sannolikhetsbaserade AI-system för att upptäcka subtila beteendeförändringar

- Skapa en återkopplingsloop mellan att upptäcka oönskat utdata i produktion och att använda det för att generera finjusteringsdata som förbättrar modellens noggrannhet

- Spåra fleragentsarbetsflöden för att säkerställa att du kan koppla punkterna för varför och hur data utvecklades för att informera komplexa åtgärder

- Definiera mänsklig granskning i loopet för säker respons och automatiserad åtgärd

Att stänga gapet mellan kontroll och observation

Företag kan dra nytta av ramverk som integrerar synlighet och kontroll och kräver mer än bara ett övervakningsskikt ovanpå generativ AI. I både deterministiska och icke-deterministiska system kan en tillförlitlighetsplattform identifiera, förutse, förklara och hjälpa till att kontrollera problem.

Följande bör ingå i ett fungerande ramverk för tillförlitlig AI-drift:

- Integrerad telemetri för både IT-system och AI-system

- Slut-till-slut-spårning av agentarbetsflöden och systemberoenden

- AI-specifik beteende- och kvalitetsspårning (prompter och utvärderingar)

- Avancerad avvikelseupptäckt, oavsett källa

- Kausalt resonemang och rotorsaksanalys

- Larm som automatiskt anpassar sig till din miljö och inte kräver manuell tröskel

- Regelefterlevnad och skyddsräcken

- Mänsklig granskning av känsliga eller betydande åtgärder

- Automatisering av arbetsflöden och samordning av åtgärd

- Användning av prediktiv analys för att förhindra problem från att uppstå

- Återkopplingsloopar som kopplar avvikelseupptäckt till förbättrad AI-modellkvalitet

Att underlätta AI-funktioner

AI-system är beroende av infrastruktur, tjänster, datapipeliner och operativa rutiner; de misslyckas inte på egen hand. Team får en helhetsbild när både AI- och IT-tillförlitlighet kombineras.

En tunn LLM-omslag bör inte vara grunden för en tillförlitlig plattform. För att identifiera och åtgärda problem som andra generativa AI-verktyg förbiser bör en mängd olika AI-tekniker övervägas, inklusive osupervised AI, prediktiv AI, kausala AI och generativ AI. Denna kombination av tekniker kallas vanligtvis “sammansatt AI”.

Generativ AI är bra på att sammanfatta naturligt språk. Den är bäst lämpad för situationer som kräver resonemang genom ostrukturerad data eller när man interagerar med människor. Men det passar inte formen på de flesta tillförlitlighetsproblem i produktion.

Prediktiv AI fokuserar på att identifiera tidiga signaler innan de blir driftstopp, dåliga kundupplevelser eller dyra fel genom att använda avvikelseupptäktalgoritmer.

Kausala AI hjälper till att fastställa de verkliga rotorsakerna för att avslöja om hämtningskvalitet, modellbeteende, infrastrukturslöhet, uppströms data-drift eller nedströms systemfel var orsaken till en prestandaförändring.

Osupervised AI upptäcker autonomt dolda mönster, strukturer eller avvikelser i data utan mänsklig vägledning. Den presterar bättre än generativ AI för tillförlitlighet eftersom den fokuserar på att hitta dolda strukturer inom komplex, oklassificerad data för att gruppera liknande artiklar eller hitta relationer.

När risk, osäkerhet eller affärseffekter är betydande, måste operativa AI-agenter kunna automatisera reaktion samtidigt som de upprätthåller mänsklig inblandning för tillförlitlig drift.

AI-modellens förståelse för det specifika affärssammanhanget kan förbättras i varje möte genom att använda förstärkt inlärning från faktisk användardata i produktion.

Även de mest avancerade systemen går utöver larm; stängd återkopplingsremediering lär av varje incident över tid, automatiserar erkända reaktioner och initierar säkra åtgärder.

Att förbereda sig för autonoma AI-system

Företag kan förbereda sig för autonoma AI-system på flera sätt. Först bör agenter ses som operativa system snarare än som instrument för produktivitet. När en agent har förmågan att agera, blir den en integrerad del av företagets verksamhet och bör regleras på lämpligt sätt.

Team kan spela in signaler från modeller, prompter, verktyg, arbetsflöden, infrastruktur och användarresultat direkt genom att instrumentera agenter. Denna grundläggande övervakning kan och bör inte skjutas upp tills agenter blir avgörande för företaget.

Att etablera tillförlitlighetsstandarder före den omfattande distributionen av agenter är också avgörande. I stället för att införas efteråt bör acceptabla trösklar för säkerhet, latens, felhastigheter, hallucinationsrisk, regelefterlevnad och affärspåverkan införlivas i deras design.

Att koppla AI-beteende till de underliggande systemen och processerna som stöder det låter företag integrera AI- och IT-drift. Användning av olika verktyg för infrastruktur och modellövervakning skapar blind fläckar.

Plattformsteknik, SRE, säkerhet, datateam, AI-team och affärsägare måste arbeta tillsammans för att tillhandahålla tillförlitlig AI-drift, och autonoma system överskrider konventionella silos.

Varje incident, avvikelse och nära-miss kommer att förbättra systemet genom att införliva återkopplingsloopar i driften, vilket låter företag kontinuerligt lära av produktionsbeteende.

Slutligen är det viktigt att välja plattformar som är avsedda för kontroll snarare än bara övervakning. Företag kommer att dra nytta av system som integrerar övervakning, förutsägelse, förklaring och åtgärd när AI-agenter blir alltmer autonoma. Organisationer som framgångsrikt övergår från att identifiera problem till att säkert kontrollera resultat kommer att vara vinnarna.

Sammanfattning

AI i företag är nu ett operativt system i företagsmiljöer snarare än ett verktyg. I realvärldens produktionsmiljöer garanterar tillförlitlighet i AI-system säkra, konsekventa, förutsägbara och effektiva drift. De som lyckas med att gå från att identifiera problem till att säkert kontrollera resultat kommer att vara vinnarna. AI i företag är nu ett operativt system i företagsmiljöer snarare än ett verktyg. I realvärldens produktionsmiljöer garanterar tillförlitlighet i AI-system säkra, konsekventa, förutsägbara och effektiva drift.