Tankeledare

Från kod till botemedel: Den nästa AI-revolutionen behöver en hjälpande hand (och ögon)

Hur agenter, XR-smartglas och robotik kommer att ge människor makt – inte ersätta dem

Vi lever i en paradox inom artificiell intelligens.

På skärmar är AI övermänsklig. Stora språkmodeller skriver fungerande Python-kod på sekunder. Generativa system producerar fotorealistiska bilder och videor på minuter. Nobelprisbelönade system som AlphaFold har förutspått strukturerna för nästan alla kända proteiner. De digitala segrarna staplas upp.

Men i den fysiska världen av biomedicinsk forskning förblir upptäcktsprocessen smärtsamt manuell. Vi känner inte riktigt att AI accelererar vetenskap eller medicin, åtminstone inte ännu. Siffrorna avslöjar problemets omfattning. En banbrytande undersökning av Nature bland över 1 500 forskare fann att mer än 70% hade försökt och misslyckats med att reproducera en annan forskares experiment. Ännu mer oroande: mer än hälften kunde inte reproducera sitt eget arbete. Inom cancervetenskap specifikt fann ett åttaårigt reproducerbarhetsprojekt att endast 40% av högimpaktresultat kunde replikeras och 68% av experimenten saknade tillräcklig dokumentation för att ens försöka replikera.

Detta är den smutsiga hemligheten i modern vetenskap: vi har ett kunskapskapningsproblem, inte bara ett upptäcktsproblem. Kritiska experimentella detaljer lever i forskarnas huvuden, inte i papper. Protokoll glider. Tacit kunskap går ut genom dörren när traineer examineras. AI-system som tränats på publicerad litteratur ärver alla dessa luckor.

Det grundläggande problemet är att medan en AI kan designa ett nytt protein för cancervård i en digital simulering, kan den inte plocka upp en pipett för att testa det. Den kan inte navigera i den smutsiga, oförutsägbara verkligheten i ett vått laboratorium för att validera sin egen hypotes. Den kan inte se en erfaren scientists händer och lära sig de subtila teknikerna som gör att experiment fungerar.

Denna “utförandegap” är den enskilt största flaskhalsen som förhindrar att AI-revolutionen blir en medicinsk revolution. Medan de flesta robotföretag fortfarande är upptagna med att lära maskiner att vika tvätt eller ladda diskmaskiner, ligger de efter på de verkligt transformerande förmågorna i dessa framsteg inom områden som medicin.

För att lösa detta måste vi gå utöver chattbotar och mot AI Co-Scientists, agenter som brottar den digitala och fysiska världen, och går utöver planering och kodning och in i verklig utförande. På Stanford utvecklar vi LabOS, ett digitalt-fysiskt AI-ramverk som demonstrerar hur AI-agenter, Extended Reality (XR) smartglas och samarbetande robotik kan förenas för att stänga denna loop, och omvandla vetenskapliga experiment till en samarbetskonversation mellan människa och maskin, samtidigt som den automatiskt fångar den kunskap som för närvarande går förlorad.

Den stora klyftan: Varför AI behöver “ögon” och “händer”

Många av de mest synliga AI-segrarna har skett där miljön är fullständigt digital: kodarkiv, kuraterade datamängder eller simulerade benchmark (där AI tävlar om att köra ett virtuellt företag eller digitalt investera i aktier).

Våta laboratorier är annorlunda. Biologi, och i allmänhet vetenskaplig upptäckt, är en mycket bullrig process. Instrument glider, operatörer improviserar, och “protokollet” lever ofta delvis i människors huvuden. Skillnaden mellan ett rent resultat och ett misslyckat försök kan vara en pipetteringsvinkel, en vortexmönster, en reagenssubstitution eller en inkubation som körde 10 minuter för länge. Dessa kontextuella detaljer hamnar sällan i en papper och de är exakt vad en AI-modell behöver om den ska generalisera bortom en datamängd.

Det är därför labbgraderad AI behöver ögon (för att uppfatta vad som händer i kontext), händer (för att standardisera och säkert automatisera högvariationssteg) och minne (för att spela in vad som faktiskt hände). Utan dessa förmågor kan modeller rekommendera vad man ska göra, men de kan inte tillförlitligt översätta rekommendationer till validerad fysisk utförande eller förklara misslyckanden när verkligheten avviker från plan.

Bortom chattbotar: Från copiloter till co-vetenskapsmän

Begreppet “agentic AI” används ibland löst. I biomedicinska miljöer bör det betyda något precist: ett system som kan ta ett mål (t.ex. “optimera CRISPR-genediteringseffektivitet samtidigt som man minimerar avvikande mål”), bryta ner det i en sekvens av uppgifter, utföra dessa uppgifter över verktyg, utvärdera resultat och anpassa planen under begränsningar och med granskningsbar beslutsfattning.

Detta är viktigt eftersom forskningsflöden inte är ett enda modellanrop. De är slut-till-slut-pipelines som spänner över hypotesformulering, experimentell design, data bearbetning, statistisk testning och tolkning. Nylig tanke i läkemedelsupptäckt har börjat betona agenter som kan skala dessa pipelines snarare än att bara accelerera enskilda steg (t.ex. Unite.AIs diskussion om agenter i small-molecule discovery).

I programvaruteknik har vi redan sett tidiga empiriska bevis för att AI-copiloter kan öka utvecklarens produktivitet. Inom biomedicin är den analoga möjligheten inte bara att skriva kod, utan att skriva och validera protokoll, strukturera data, övervaka utförande och stänga loopen mellan förutsägelse och mätning, och ansluta AI till mänskliga forskare i laboratorier.

LabOS: När AI körs på ett operativsystem för morgondagens laboratorier

I vårt arbete på Stanford om AI4Science, som omfattar genredigeringscopiloter som CRISPR-GPT och AI-XR co-execution system som LabOS som hjälper forskare i biomedicinska och materialvetenskapliga laboratorier, har vi utforskat en arkitektonisk förändring:

1. Designa ett slut-till-slut “laboratorieoperativsystem” som kopplar en digital (torr) laboratorium till ett fysiskt (vått) laboratorium.

Premissen är enkel: om en laboratoriebok är minnet av vetenskap, då bör ett labb-OS vara utförandelagret, som fångar avsikt, översätter den till åtgärder, observerar resultat och omvandlar varje körning till strukturerad kunskap.

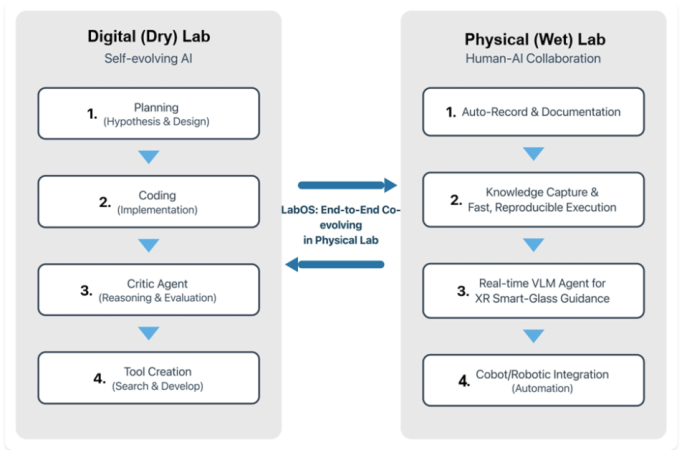

Figur. En konceptuell vy av LabOS som kopplar en självutvecklande digital labbloop (planering, kodning, kritik, verktygsbyggnad) med en mänsklig-AI-våtlabbloop (auto-dokumentation, kunskapsfångst, XR-vägledning och robotintegration).

2. AI i det digitala laboratoriet – Självutvecklande planering och verktygsbyggnad

I det digitala (torra) laboratoriet kan vi låta AI göra vad den redan gör bra: söka, syntetisera och föreslå. Men vi vill också att den ska vara självförbättrande. Inte genom att “hallucinera ny vetenskap”, utan genom att lära sig bättre verktyg och arbetsflöden från feedback.

En praktisk digital-labbloop kan ramas in som fyra återkommande faser:

- Planering (hypotes + design): föreslå hypoteser, välja experimentella variabler, förutse störningsfaktorer och specificera mätbara slutpunkter.

- Kodning (implementering): generera eller anpassa analys-skript, simuleringspipelines och instrumentkontrollmallar där det är lämpligt.

- Kritikagent (resonemang + utvärdering): stress-testa antaganden, kontrollera statistisk kraft, föreslå kontroller och flagga troliga felmoder.

- Verktygsbyggnad (sök + utveckla): när arbetsflödet saknar en komponent (en parser, en QC-rutin, en instrumentpanel), bygg den och lägg till den i verktygslådan.

3. AI i det fysiska laboratoriet – AI med “ögon” (XR-glas) och “händer” (robotik)

Det fysiska (våta) laboratoriet är där systemet antingen vinner förtroende – eller förlorar det. Målet är inte att ersätta forskaren, utan att minska friktion och fel samtidigt som observabiliteten ökar.

Vi ser det fysiska labbloopet som fyra kompletterande förmågor:

- Auto-spela in och dokumentation: spela in åtgärder, tidsstämplar, instrumentinställningar och avvikelser automatiskt, så att dokumentation inte är en eftertanke.

- Kunskapsfångst för snabb, reproducerbar utförande: omvandla körningar till strukturerade, frågorbara artefakter (protokollversioner, parametuppsättningar, QC-utfall) i linje med dataförvaltningsprinciper som FAIR.

- Real-tids vision-språksvägledning via XR-smartglas: använda multimodala modeller för att tolka scenen (vad operatören gör, vilken reagens som är i handen) och ge steg-för-steg-vägledning och säkerhetskontroller. AR/XR har redan visat värde i högriskfysiska arbetsflöden som experimentguidning (LabOS, Stanford, Princeton, i samarbete med NVIDIA).

- Cobot/robotisk integration för automatisering: standardisera repetitiva steg, möjliggöra säkra överlämningar och minska variation. Plattformar för simulering-till-verklighet arbetsflöden (t.ex. NVIDIA Isaac) och real-tids AI-bearbetning på kanten som smart glas live-strömning och mänsklig-AI-interaktion i LabOS är viktiga aktiveringslager.

Denna arkitektur stämmer överens med en bredare riktning inom fältet: “självkörande” eller autonoma laboratorier som kombinerar automatisering med maskinlärande för att planera nästa experiment. Vad LabOS lägger till är ett tätare mänskligt gränssnittsskikt, så att autonomi inte kommer på bekostnad av transparens.

Varför labbgraderad AI inte bara är “AI på en datamängd”

AI-system för biomedicinsk/vetenskaplig superintelligens ser ofta imponerande ut i retrospektiv utvärdering eller när de tar examen, och sedan underpresterar i det fysiska laboratoriet. Orsaken är sällan en enda bugg. Det är vanligtvis en missmatch mellan modellens antaganden och labbets verklighet.

Tre gap visas upp repeterat:

- Kontextgap: datamängder utelämnar vanligtvis de kontextuella variablerna som operatörer vet är viktiga (temperaturutflykter, reagenspartinummer, subtila protokollavvikelser).

- Åtgärdsgap: många AI-system kan rekommendera vad man ska göra, men kan inte tillförlitligt översätta den rekommendationen till validerad fysisk åtgärd.

- Återkopplingsgap: utan strukturerad, högkvalitativ återkoppling från utförande, kan modeller inte lära sig var de misslyckas – och forskare kan inte granska varför.

Att stänga dessa gap är mindre om att uppfinna en ny neurala nätverksarkitektur, utan mer om att bygga instrument, gränssnitt och datakontrakt som gör laboratoriet läsbart för maskiner, och låter AI se och arbeta med människor.

Tillit genom design: Säkerhet och styrning för AI som kan agera

Agentic AI i upptäcktsforskning väcker inte bara bekanta bekymmer om noggrannhet. Den introducerar nya felmoder eftersom den kan agera. I ett laboratorium betyder åtgärd potentialen för slöseri, skada eller vilseledande slutsatser, särskilt när experiment matar in i kliniska hypoteser.

En användbar inställning är att behandla en AI-aktiverad labbstack som ett socio-tekniskt system som behöver försäkran. Flera befintliga ramverk hjälper, men de måste översättas till labbverklighet:

- Riskhantering som en kontinuerlig praxis: NIST:s AI Risk Management Framework (AI RMF 1.0) erbjuder ett praktiskt ordförråd för att kartlägga, mäta och hantera AI-risk över hela livscykeln.

- Regulatorisk anpassning för medicin-adjacent AI: FDA:s AI/ML-programvara som medicinsk enhet (SaMD), inklusive dess Action Plan och relaterade riktlinjer, erbjuder en konkret vy av vad “god praxis” ser ut när AI påverkar patientvård.

För genredigering och andra högkonsekvensområden är styrning redan en global diskussion. Rekommendationer diskuteras om mänsklig genredigering, för att betona behovet av lämpliga tillsynsmechanismer och ansvarsfull styrning, såsom de som föreslagits av American Society for Gene and Cell Therapy, eller ASGCT. System som LabOS bör utformas för att göra regelefterlevnad enklare, inte svårare.

Kontrolllista: Kontroller för säker AI Co-vetenskapsmän för vetenskaplig upptäckt

I vår mening bör ett säkerhetsmedvetet labb-OS implementera minst följande design:

- Ursprung garanterat som standard: varje datamängd, protokollversion och modellutdata ska vara spårbar till ingångar och tidsstämplar.

- Begränsad autonomi: systemet ska ha explicita behörigheter (vad det kan göra utan bekräftelse) och eskalationsregler (när det måste fråga).

- Mänsklig åsidosättning och värdig nedgradering: när sensorer eller dataströmmar misslyckas, eller osäkerhet är hög, ska systemet falla tillbaka till en säkrare, enklare läge.

- Kontinuerlig validering: in-silico förutsägelser ska paras med fysisk-labbvalidering; fysisk-labbkörningar ska innehålla QC-grindar innan slutsatser sprids nedströms tillbaka till AI-modeller/agenter i den digitala världen.

- Säkerhet och dubbelanvändningsmedvetenhet: skydda labb-infrastruktur från manipulation.

Ge människor makt överallt: Kan AI Co-vetenskapsmän jämna ut spelplanen?

En av de mest övertygande löftena om en AI-XR “co-vetenskapsman” är inte bara hastighet för elitinstitutioner, utan tillgänglighet för alla. Överväg vad som för närvarande begränsar mindre laboratorier, startup-företag och avlägsna/landsbygds/kliniska kliniker:

- Begränsad tillgång till specialiserad expertis för guldstandardprotokoll och instrument.

- Högre relativ kostnad för utbildning, misstag och omarbete.

- Fragmenterad verktygsutrustning: anteckningsböcker, kalkylblad, instrumentloggar och analys-skript ansluter sällan renligt.

Ett system som kan vägleda utförande i kontext (genom XR-glas), fånga vad som hände automatiskt och föreslå nästa bästa steg baserat på tidigare körningar kunde göra avancerade analyser mer reproducerbara över platser. I princip kunde det också stödja distribuerad klinisk forskning där protokoll måste utföras konsekvent, även när resurser varierar.

Tidslinje: När får varje forskare och kliniker en co-vetenskapsman?

I korta drag är vi närmare än vad många tror för vissa högvärdes-, högfrekvensuppgifter (såsom att producera ett läkemedel tillförlitligt i laboratoriet) och längre bort än vad de flesta demonstrationer antyder för andra (såsom AI som helt löser stora problem som cancer eller Alzheimers). En realistisk vägkarta ser ut så här:

- Närtid (inom 1 år): Arbetsflödesco-piloter som minskar administrativ belastning: protokollutkast, litteratursyntes, analysmallar och automatiska QC-rapporter. Begränsningsfaktorn är integration, inte modellförmåga.

- Mellantid (1-2 år): Co-utförande system i laboratoriet: XR-glasvägledning, automatisk dokumentation och selektiv robotik för högvariationssteg. Förtroende kommer att bero på granskningsspår och tät mänsklig-i-lab-design.

- Längre tid (3+ år): Tvärdomäns co-forskare som kopplar upptäckt till översättning: länkar labbdata till kliniska slutpunkter, övervakar säkerhetssignaler och hjälper till att utforma prövningar – samtidigt som man följer regulatoriska och etiska förväntningar.

Från kod till botemedel: Vägen framåt till 1000x vetenskaplig upptäckt

LabOS är ett försök att besvara en enkel fråga: vad om ett experiment kunde köras som en konversation, där avsikt, utförande och bevis är kopplade från början till slut? Om vi bygger dessa system väl, kan de hjälpa till att lösa den översättningsgap som bromsar biomedicin och många fysiska vetenskapsdiscipliner (t.ex. materialvetenskap). Om vi bygger dem dåligt, kommer de att förstärka irreproducerbarhet och skapa nya säkerhetsrisker.

Det viktigaste arbetet under de närmaste åren kommer att vara grundläggande: standardiserad data och enhetsgränssnitt via byggnad av operativsystemet (liksom iOS kör alla typer av appar), byggnad av AI-benchmark som inkluderar utförande och osäkerhet (som LabSuperVision-benchmarken i LabOS), och start på distribution i den verkliga världen som uppmuntrar innovation samtidigt som den skyddar patienter och forskningsintegritet.

För forskare och kliniker är frågan inte om AI kommer att gå in i laboratoriet. Det har redan gjort det. Frågan är om vi kommer att integrera det som en samling av frånkopplade verktyg eller som ett pålitligt, granskningsbart system utformat för biomedicinsk vetenskaps realiteter.

Föreslagen läsning och källor

- Reproducerbarhetsundersökning (Nature, 2016): https://www.nature.com/articles/533452a

- CRISPR-GPT peer-granskad artikel (Nature Biomedical Engineering): https://www.nature.com/articles/s41551-025-01463-z

- Stanford Medicine nyheter om CRISPR-GPT (2025): https://med.stanford.edu/news/all-news/2025/09/ai-crispr-gene-therapy.html

- LabOS preprint (arXiv): https://arxiv.org/abs/2510.14861

- LabOS och LabSuperVision benchmark webbplats: https://ai4lab.stanford.edu

- NIST AI Risk Management Framework (AI RMF 1.0): https://nvlpubs.nist.gov/nistpubs/ai/NIST.AI.100-1.pdf

- FDA översikt av AI/ML-programvara som medicinsk enhet: https://www.fda.gov/medical-devices/software-medical-device-samd/artificial-intelligence-software-medical-device

- FAIR data principer (Scientific Data, 2016): https://doi.org/10.1038/sdata.2016.18

- Unite.AI om flaskhalsar i small-molecule läkemedelsupptäckt: https://www.unite.ai/how-ai-is-breaking-down-the-bottlenecks-in-small-molecule-drug-discovery/

- Unite.AI om AI och robotkirurgi: https://www.unite.ai/how-ai-is-ushering-in-a-new-era-of-robotic-surgery/