Взгляд Anderson

Обучение забывчивому ИИ «запоминать мысль» на более долгое время

Модели языка часто не могут вспомнить начало разговора. Новый метод сжатия текста может изменить это и сделать сеансы общения с ИИ намного менее раздражающими.

Системы разговорного ИИ, такие как ChatGPT, часто теряют след ранних частей разговора, повторяя себя или давая ответы, которые игнорируют ранее согласованные правила.

Это связано с тем, что большие языковые модели (LLM) имеют ограниченную способность фокусироваться, определяемую как «окно контекста» внимания – как фонарь, который может освещать только то, на что он直接 направлен, и несколько соседних объектов.

Исправление таких «амнезийных» тенденций, обусловленных этими ограничениями внимания, является одним из наиболее важных направлений исследований языковых моделей ИИ – не в последнюю очередь потому, что этот синдром сильно ограничивает возможность полезных и последовательных многоходовых разговоров и ограничивает полезность LLM в различных контекстах, критических для точности, таких как медицина и право.

Раздавливание

Новые исследования из Китая† предлагают новый метод, позволяющий значительно увеличить количество текста, помещаемого в ограниченные ресурсы GPU, работающего с моделью ИИ – с результатами, достигающими 20-кратного улучшения сжатия при сохранении 98% точности:

![Каскадное сжатие контекста (C3) реконструирует длинные документы более точно, чем оптические методы сжатия, такие как DeepSeek-OCR, даже при уменьшении входных данных до сорока раз. На различных длинах документов и настройках сжатия новый метод сохраняет почти идеальную точность, в то время как оптический подход резко ухудшается при более высоком сжатии. Источник [ https://arxiv.org/pdf/2511.15244 ]](https://www.unite.ai/wp-content/uploads/2025/11/c3-tokens-per-page.jpg)

Каскадное сжатие контекста (C3) реконструирует длинные документы более точно, чем оптические методы сжатия, такие как DeepSeek-OCR, даже при уменьшении входных данных до сорока раз. На различных длинах документов и настройках сжатия новый метод сохраняет почти идеальную точность, в то время как оптический подход резко ухудшается при более высоком сжатии. Источник

С точностью 93%, которая находится в рабочих параметрах, сжатие текста может даже достичь 40-кратного отношения сжатия:

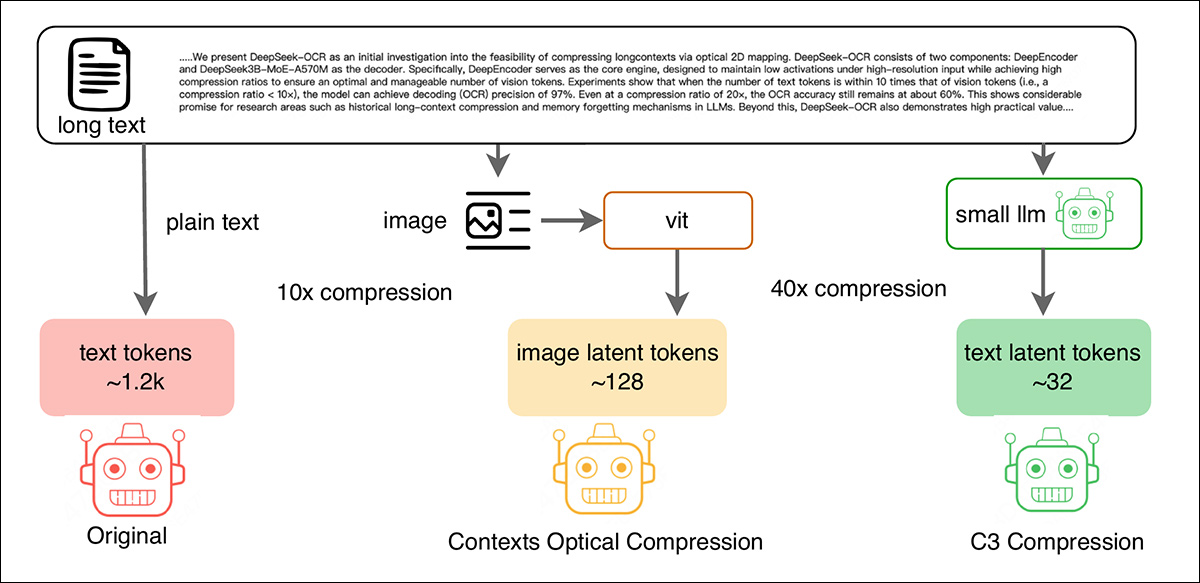

Три подхода к сжатию длинного текста для входных данных языковой модели: базовый метод (слева) токенизирует текст直接, в результате чего получается большой счетчик токенов; оптический путь (в центре) преобразует текст в изображение и извлекает визуальные вложения с помощью Vision Transformer, достигая 10-кратного сжатия; и новый метод C3 (справа) использует небольшую языковую модель для сжатия текста только в 32 латентных токена, получая 40-кратное сжатие без использования визуальных кодирований.

Это означает, что вся даже очень длинная беседа может быть сжата и повторно введена (обновлена) на интервалах в обменах как фоновые контекстные сведения, позже в чате – когда LLM обычно забывает ранее установленные факты и скользит в «амнезийное» поведение.

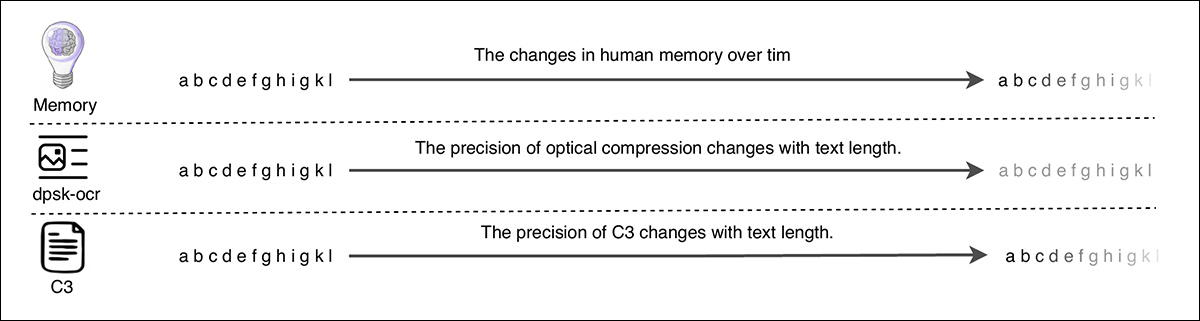

Хотя это является потерянным методом сжатия, даже способ, которым происходит потеря, полезен: при новом методе память ухудшается в конце предложения, а не равномерно на протяжении всего, как в DeepSeek-OCR архитектуре, которая вдохновила новый подход; фактически, исследователи, стоящие за новой статьей, предлагают, что их метод ухудшается таким же образом, как и реальная человеческая память, а не случайно:

Вверху, человеческая память ухудшается в конце потока данных; в середине: DeepSeek-OCR ухудшается случайно, не оставляя никаких якорей, которые могли бы помочь в исправлении проблемы; внизу: новый метод ухудшается таким же образом, как человеческая память, к завершению потока данных, предлагая маркеры, которые могут помочь улучшить точность посредством постфактум обработки.

Это означает, что можно предсказать где запомненные данные могут быть менее надежными, и использовать это знание для решения проблемы – потенциально предлагая огромное улучшение в воспоминании разговора и связности, с 100% точностью после исправления.

Новый подход называется Каскадным сжатием контекста (C3), и вдохновлен способом, которым DeepSeek-OCR сжимает текст как изображения, достигая великих уровней сжатия. Однако, используя две (средние и крупные) языковые модели для сжатия длинного текста напрямую в латентные вложения, новый подход исключает задержку, вызванную использованием растровых изображений, тем самым достигая улучшенной производительности.

Статья гласит:

‘Превосходная производительность C3 можно отнести к его фундаментальной архитектурной конструкции. Анализ DeepSeek-OCR предполагает, что его производительность снижается из-за факторов, таких как “сложная компоновка” и “размытие изображения при более низких разрешениях” – внутренних ограничений оптического пути.

‘Наш парадигм C3, работая напрямую в текстовом домене, полностью иммунен к этим визуальным артефактам. Он избегает потери информации, связанной с отображением текста в пиксели и затем кодированием этих пикселей. Вместо этого он использует мощное семантическое понимание предварительно обученной LLM для дистилляции текстовой информации напрямую в эффективное латентное представление.’

Новая статья озаглавлена Каскадное сжатие контекста: Изучение верхних пределов текстового сжатия, и исходит от двух авторов†, которые, кажется, также предлагают C3 как открытый репозиторий на GitHub.

Метод

Чтобы понять новый подход, полезно знать, что такое оптическое распознавание символов (OCR), потому что именно отсюда берет начало вся идея.

OCR – это алгоритмический метод, восходящий к 1920-м годам, хотя и популяризированный в 1990-х годах, где обнаружение закономерностей позволяет компьютерной программе преобразовать растровый текст (т.е. текст внутри изображений, который нельзя выбрать и который существует только как фотографический контент) в редактируемый текст.

Создатели DeepSeek-OCR обнаружили, что текст можно сжать намного больше, чем стандартные конвейеры, используя OCR в качестве промежуточной стадии. Другими словами, вместо сжатия текста сам по себе можно добиться большей плотности латентных вложений (т.е. сохранить больше информации) сжимая растеризованную версию этого текста:

![Из выпускаемой статьи DeepSeek-OCR, схема конвейера сжатия, включая 16x16 растеризованные патчи в качестве компонента OCR. Источник [ https://arxiv.org/pdf/2510.18234 ]](https://www.unite.ai/wp-content/uploads/2025/11/deepseekocr.jpg)

Из выпускаемой статьи DeepSeek-OCR, схема конвейера сжатия, включая 16×16 растеризованные патчи в качестве компонента OCR. Источник

Новая статья предполагает, что оптические подходы, такие как DeepSeek-OCR, могут неправильно приписывать источник своих достижений в сжатии. Вместо того, чтобы переход от текста к изображению был основным фактором, авторы полагают, что ключевое преимущество заключается в преобразовании многословных текстовых токенов в более эффективные латентные представления.

Чтобы проверить это, они создали конвейер, использующий две языковые модели: меньшую Qwen2.5 1.5B, которая функционирует как кодировщик, сжимающий длинные отрывки в небольшой набор латентных токенов; и более крупную Qwen2.5 3B, которая функционирует как декодировщик, восстанавливающий исходный текст из этих токенов:

В новой системе C3 меньшая модель Qwen2.5 1.5B сжимает длинный вход в фиксированный набор латентных токенов, используя обучаемые запросные вложения. Эти токены, вместе с подсказкой, передаются в более крупную модель Qwen2.5 3B, которая восстанавливает исходный текст. Эта архитектура позволяет высокоточное воспоминание длинных последовательностей, используя только часть исходного счетчика токенов.

Чтобы обработать стадию сжатия, исследователи адаптировали предварительно обученную модель Qwen2.5 1.5B, введя обучаемые запросные вложения: абстрактные подсказки, которые направляют модель в дистилляции входного длинного контекста в гораздо меньшее латентное представление.

Вместо изменения архитектуры метод просто подает длинный текст и запросные вложения вместе как единый вход. Механизм самовнимания модели рассматривает эти элементы идентично, позволяя ей выводить фиксированную длину латентного контекста без необходимости новых слоев или изменений конструкции; и этот вывод затем передается в более крупную модель для восстановления.

Чтобы оценить, сколько информации сохранилось после сжатия, исследователи инструктировали декодировщик Qwen2.5 3B восстановить исходный вход, используя только латентные токены и подсказку ‘повторить текст’. Поскольку задача заключалась в точной репродукции, а не в суммировании или парафразе, любое отклонение от исходного можно было напрямую отнести к информации, потерянной при сжатии, предлагая чистый и объективный тест точности на протяжении всего конвейера кодирования-декодирования.

Данные и тесты

Статья гласит, что авторы составили оригинальный набор данных OCR, состоящий из миллиона страниц, полученных из интернета. Никаких дальнейших деталей на этот счет не видно, и авторы, кажется, намеренно расплывчаты на этот счет.

Тем не менее, они отмечают, что инженерия и курирование данных были ненужными для их целей, и что они смогли эффективно обучить свою модель на образцах «различной длины»; и они заявляют, что это указывает на то, что их архитектура является устойчивой (и, следовательно, хорошо обобщенной, в зависимости от настроек обучения).

Модель была обучена на высокопроизводительном кластере, состоящем из восьми GPU NVIDIA H800, каждая из которых оснащена 80ГБ ОЗУ, в результате чего общий объем ОЗУ составил 640ГБ. Каждая GPU вмещала размер партии 2, в результате чего общий глобальный размер партии составил 256, учитывая 16 накопительных шагов, запланированных. Оптимизатором был AdamW, в течение общего количества 40 000 шагов.

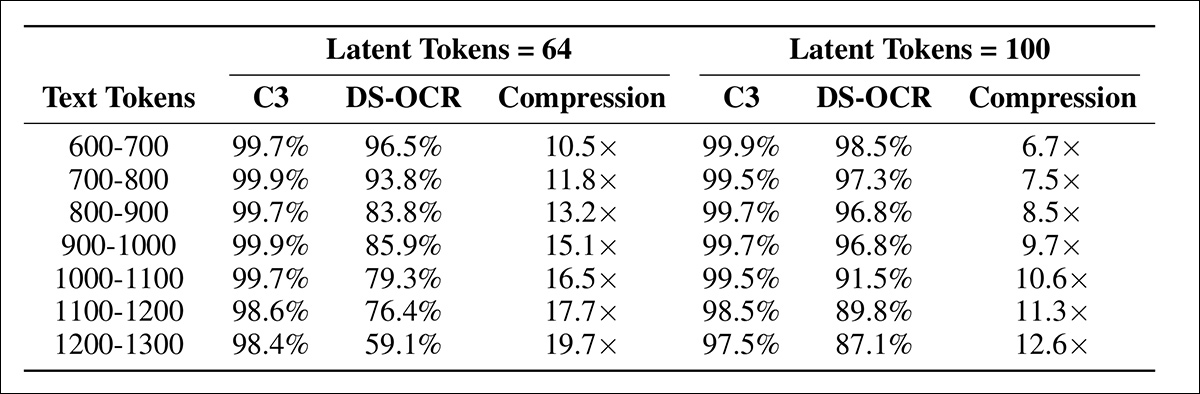

Чтобы проверить эффективность архитектуры C3, исследователи следовали той же схеме оценки, использованной в исходной статье DeepSeek-OCR, используя бенчмарк Fox для измерения точности сжатия и восстановления на различных длинах документов.

Были выбраны англоязычные тексты, с отрывками, варьирующимися от 600 до 1300 токенов, с токенизацией, выполненной с помощью токенизатора Qwen.

Чтобы обеспечить справедливое сравнение, были использованы эквивалентные уровни сжатия из оптической базовой линии DeepSeek-OCR, с 64 и 100 латентными токенами. Чтобы изучить пределы метода, были проведены дополнительные тесты, используя только 32 латентных токена. В каждом случае восстановление было инициировано с инструкцией ‘повторить текст:’:

Результаты из начального теста. Точность восстановления и отношения сжатия были измерены на семи диапазонах токенов, используя 64 и 100 латентных токенов, показывая постоянное превосходство C3 над DeepSeek-OCR, особенно на более высоких уровнях сжатия.

Обсуждая начальные результаты, визуализированные выше, статья гласит:

‘Данные неопровержимо демонстрируют, что парадигма C3 значительно превосходит оптический подход к сжатию на всех протестированных условиях, устанавливая новый эталон в высокоточной компрессии контекста.’

Когда обе системы были протестированы на более длинных документах, DeepSeek-OCR начала терять точность при увеличении сжатия, падая ниже 60% в самом экстремальном случае. C3 справилась с тем же уровнем сжатия с гораздо меньшей потерей, сохраняя стабильность около 98%, даже когда входные данные были уменьшены до двадцатой части своего исходного размера.

В наиболее требовательном тесте полные тексты были сжаты до всего 32 токенов. Даже тогда модель смогла восстановить почти все исходный контент, сохраняя точность близкую к 99% в многих случаях:

Точность восстановления и отношения сжатия при 32 латентных токенах, показывая, что даже при экстремальных сокращениях (до почти 40-кратного) точность остается выше 93%.

На самом экстремальном уровне, где входные данные были сжаты почти до одной сороковой части своего размера, она все еще вспомнила более 93%. Для сравнения, более ранние оптические методы упали до около 60% точности на половине того уровня сжатия.

Авторы заявляют††:

‘Эти результаты окончательно демонстрируют преимущество архитектуры C3. Избегая информационных бутылочных горлышек и потенциальных артефактов, присущих визуальной модальности (например, ограничения разрешения изображения, сложность компоновки), наш метод без проблем обрабатывает экстремальное сжатие с минимальной потерей информации.

‘Результаты из этого агрессивного тестового случая укрепляют нашу претензию, что прямое текстовое сжатие в латентное представление является фундаментально более эффективным и мощным парадигмой, чем его оптические аналоги.’

Они также заключили, что C3 может ‘разблокировать новые возможности в обработке целых книг, обширных юридических документов или больших кодовых баз для задач, таких как ответы на вопросы, суммирование и анализ’.

Заключение

Это одна из самых ясных и доступных статей, с которой я столкнулся недавно, с замечательно ясной основной идеей, которая может оказаться хотя бы дополнительной линией атаки против «проблемы контекстного окна».

Многие пользователи LLM научились уже «освежать» важную информацию или руководства периодически на протяжении длинного обмена, открыв на собственном опыте, что подобные ChatGPT не могут сохранять эту информацию в течение длительного времени. Следуя за этим интуитивным быстрым исправлением, идея, представленная в новой статье, заключается в том, что высокосжатая версия длинного разговора могла бы быть повторно введена на интервалах, автоматически, в контекстное окно текущего экземпляра LLM, по сути «воспоминая по доверенности».

В климате, где нехватка GPU приводит к росту цен даже на традиционную компьютерную память (такую как DRAM, где многие бывшие рабочие нагрузки GPU теперь передаются для поддержки более крупных моделей), кажется маловероятным, что аппаратное обеспечение ИИ станет значительно более емким в ближайшем будущем; поэтому инновационные подходы, такие как этот, которые почти являются ностальгическим повторением эволюции сжатия файлов 1990-х годов, могут оказаться необходимыми для продвижения вперед.

Более важно, было бы просто замечательно, если бы LLM могли поддерживать связный разговор в течение часа или более и фактически помнить, о чем изначально шла речь в разговоре.

* Инструкции по установке CLI даны, но я не имею возможности попытаться установить, и не уверен, что репозиторий кода полон.

† Два автора указаны как Фанфан Лю и Хайбо Цюй. Как показывает случайное исследование, Цюй в настоящее время является исследователем в китайской технологической компании Meituan, а Лю – магистрантом в Китайской академии наук. Ни один из них в настоящее время не имеет в своей истории упоминания о статье в вопросе. Если любая из этих атрибуций неверна, пожалуйста, свяжитесь со мной через мой профиль.

†† Хотя авторы придерживаются формулы, предоставляя дополнительные качественные тесты, они неосвещающие по сравнению с предыдущим раундом тестов на сжатие, и я не освещал их здесь.

Опубликовано впервые в пятницу, 21 ноября 2025 г.