Взгляд Anderson

Защищенные изображения легче, а не труднее, украсть с помощью ИИ

Новые исследования предполагают, что инструменты водяных знаков, предназначенные для блокировки редактирования изображений ИИ, могут иметь обратный эффект. Вместо того, чтобы останавливать модели, такие как Stable Diffusion, от внесения изменений, некоторые защиты на самом деле помогают ИИ следовать подсказкам редактирования более точно, что делает нежелательные манипуляции еще более легкими.

Существует заметная и прочная линия в литературе компьютерного зрения, посвященная защите авторских изображений от обучения в модели ИИ или использования в прямых процессах ИИ “изображение в изображение”. Системы этого типа в целом направлены на латентные модели диффузии (LDM), такие как Stable Diffusion и Flux, которые используют шумовые процедуры для кодирования и декодирования изображений.

Вставив враждебный шум в иначе нормальные изображения, можно заставить детекторы изображений неправильно угадать содержимое изображения, и помешать системам генерации изображений использовать защищенные данные:

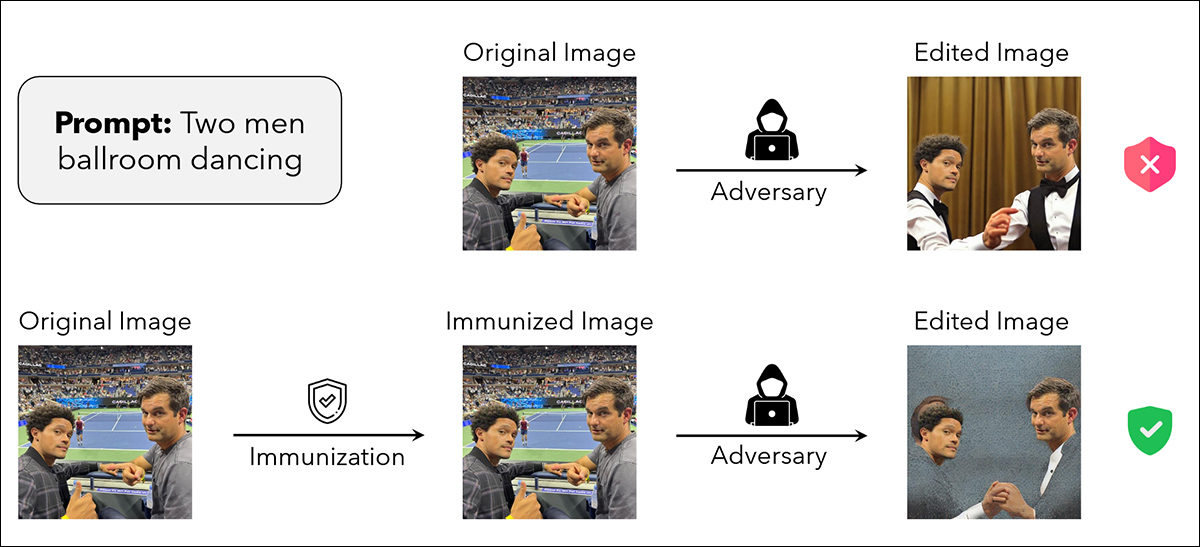

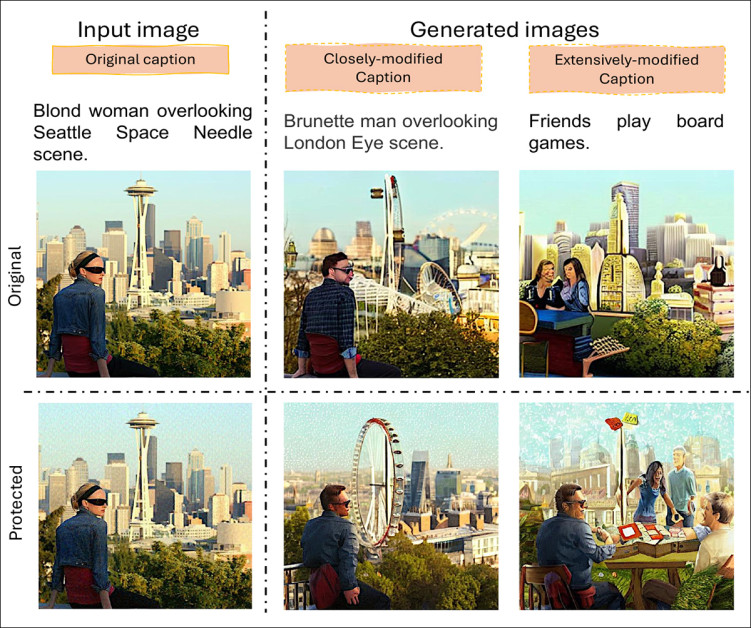

Из статьи MIT ‘Raising the Cost of Malicious AI-Powered Image Editing’, примеры исходного изображения, защищенного от манипуляций (нижний ряд). Источник: https://arxiv.org/pdf/2302.06588

Поскольку обратная связь художников против свободного использования Stable Diffusion веб-скрапированных изображений (включая защищенные авторским правом изображения) в 2023 году, сцена исследований произвела множество вариаций на одну и ту же тему – идею о том, что изображения можно невидимо “отравить” против обучения в системы ИИ или всасывания в генеративные конвейеры ИИ, не влияя на качество изображения для среднего зрителя.

Во всех случаях существует прямая корреляция между интенсивностью наложенной помехи, степенью, в которой изображение затем защищено, и степенью, в которой изображение не выглядит совсем так хорошо, как должно:

Хотя качество исследовательского PDF не полностью иллюстрирует проблему, большие количества враждебных помех жертвуют качеством ради безопасности. Здесь мы видим диапазон нарушений качества в проекте ‘Fawkes’ 2020 года под руководством Университета Чикаго. Источник: https://arxiv.org/pdf/2002.08327

Особенно интересно для художников, стремящихся защитить свой стиль от неавторизованного заимствования, является способность таких систем не только замаскировать идентификацию и другую информацию, но и “убедить” процесс обучения ИИ в том, что он видит что-то другое, чем он видит на самом деле, так что связи не образуются между семантическими и визуальными областями для “защищенных” данных обучения (т.е. подсказка, такая как ‘В стиле Поля Клея’).

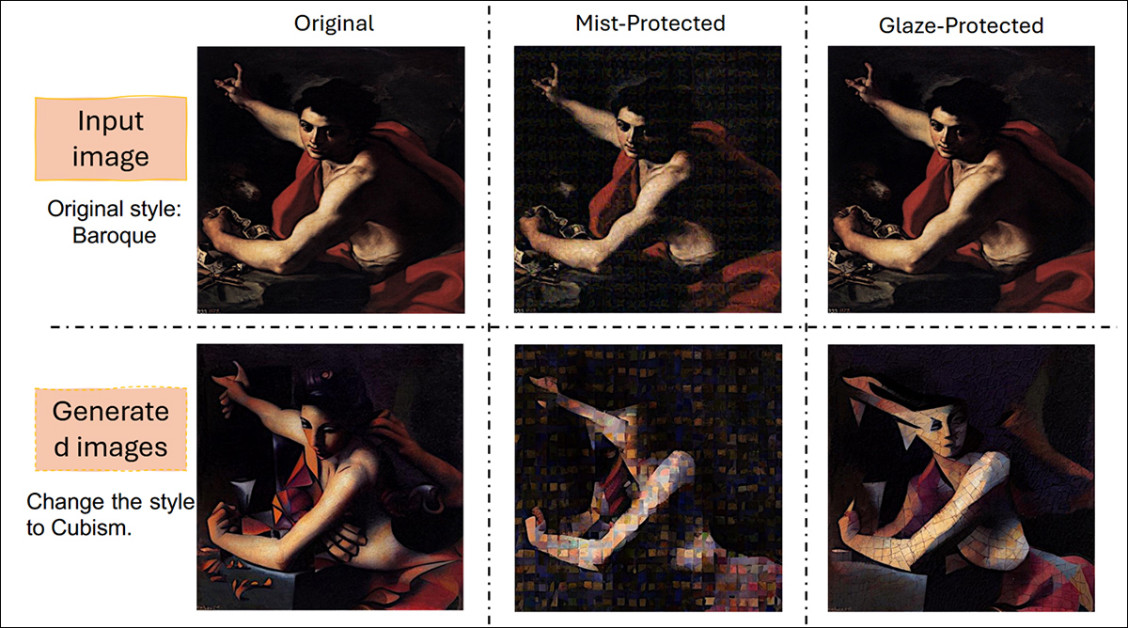

Mist и Glaze – два популярных метода инъекции, способных предотвратить, или хотя бы серьезно помешать попыткам использовать защищенные стили в рабочих процессах ИИ и тренировочных режимах. Источник: https://arxiv.org/pdf/2506.04394

Собственный гол

Теперь новые исследования из США обнаружили, что не только помехи могут не защитить изображение, но и что добавление помех может фактически улучшить эксплуатацию изображения во всех ИИ-процессах, против которых помехи должны были иммунизировать.

В статье говорится:

‘В наших экспериментах с различными методами защиты изображений на основе помех через несколько областей (естественные сцены и произведения искусства) и задач редактирования (генерация изображения в изображение и редактирование стиля), мы обнаружили, что такая защита не достигает этой цели полностью.

‘В большинстве сценариев диффузионное редактирование защищенных изображений генерирует желаемое выходное изображение, которое точно соответствует руководящей подсказке.

‘Наши результаты показывают, что добавление шума к изображениям может парадоксально увеличить их связь с заданными текстовыми подсказками во время процесса генерации, что приводит к непредвиденным последствиям, таким как лучшие результаты редактирования.

‘Следовательно, мы утверждаем, что методы, основанные на помехах, могут не обеспечить достаточного решения для надежной защиты изображений от диффузионного редактирования.’

В тестах защищенные изображения подвергались двум знакомым сценариям редактирования ИИ: прямой генерации изображения в изображение и переносу стиля. Эти процессы отражают обычные способы, которыми модели ИИ могут эксплуатировать защищенный контент, либо直接 изменяя изображение, либо заимствуя его стилистические черты для использования в другом месте.

Защищенные изображения, взятые из стандартных источников фотографий и произведений искусства, были запущены через эти конвейеры, чтобы увидеть, могут ли добавленные помехи блокировать или ухудшать редактирование.

Вместо этого присутствие защиты часто казалось, что оно заостряет выравнивание модели с подсказками, производя чистые, точные выходные данные, где ожидался некоторый сбой.

Авторы советуют, по сути, что этот очень популярный метод защиты может обеспечить ложное чувство безопасности, и что любой такой подход к иммунизации на основе помех должен быть тщательно протестирован против методов авторов.

Метод

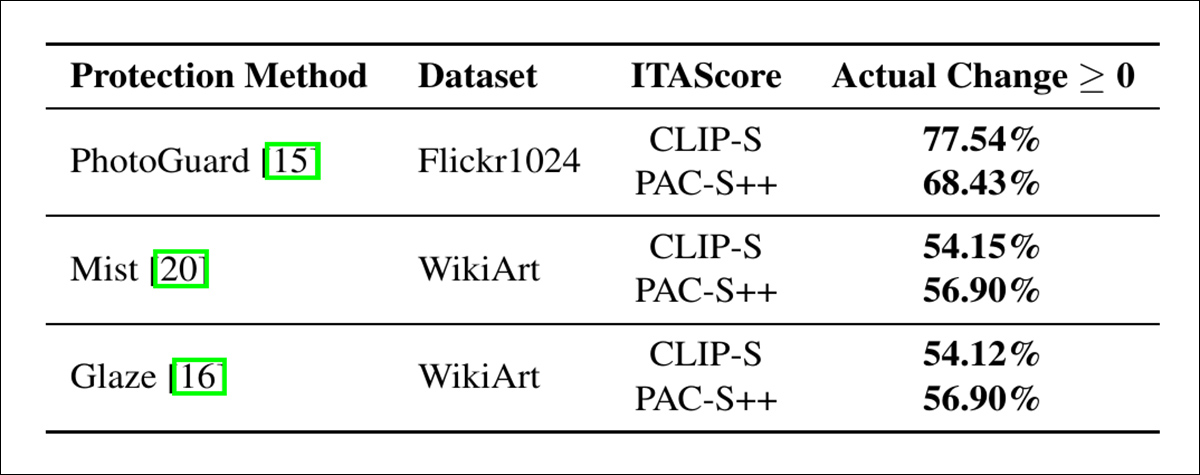

Авторы провели эксперименты, используя три метода защиты, которые применяют тщательно разработанные враждебные помехи: PhotoGuard; Mist; и Glaze.

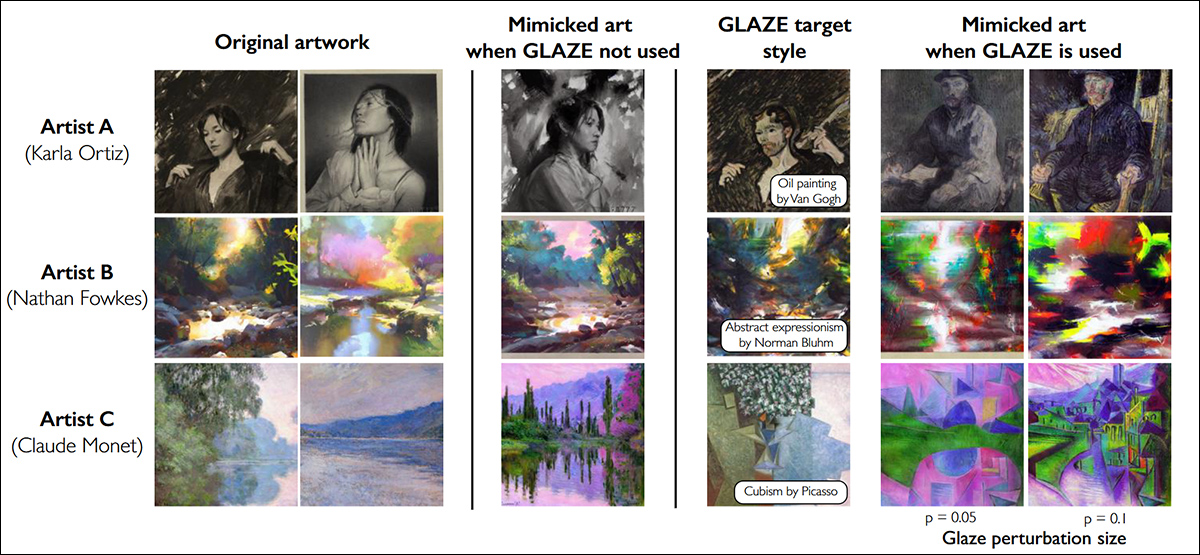

Glaze, одна из тестируемых авторами рамок, иллюстрирующая примеры защиты Glaze для трех художников. Первые два столбца показывают исходные произведения искусства; третий столбец показывает результаты имитации без защиты; четвертый столбец показывает стилизованные версии, использованные для оптимизации плаща, вместе с именем целевого стиля. Пятый и шестой столбцы показывают результаты имитации с применением защиты на уровнях p = 0,05 и p = 0,1. Все результаты используют модели Stable Diffusion. https://arxiv.org/pdf/2302.04222

PhotoGuard был применен к естественным сценам изображений, в то время как Mist и Glaze были использованы на произведениях искусства (т.е. “художественных” областях).

Тесты охватывали как естественные, так и художественные изображения, чтобы отразить возможное реальное использование. Эффективность каждого метода оценивалась путем проверки того, может ли модель ИИ все еще производить реалистичные и соответствующие подсказкам редактирования при работе с защищенными изображениями; если полученные изображения казались убедительными и соответствовали подсказкам, защита была признана неудачной.

Stable Diffusion v1.5 был использован в качестве предварительно обученного генератора изображений для задач редактирования исследователей. Пять семян были выбраны, чтобы обеспечить воспроизводимость: 9222, 999, 123, 66 и 42. Все остальные настройки генерации, такие как масштаб руководства, сила и общее количество шагов, следовали значениям по умолчанию, используемым в экспериментах PhotoGuard.

PhotoGuard был протестирован на естественных сценах изображений с использованием набора данных Flickr8k, который содержит более 8 000 изображений, сопоставленных с до пяти подписей каждое.

Противоречивые мысли

Две набора измененных подписей были созданы из первой подписи каждого изображения с помощью Claude Sonnet 3.5. Один набор содержал подсказки, которые были контекстно близки к исходным подписям; другой набор содержал подсказки, которые были контекстно далеки.

Например, из исходной подписи ‘Молодая девушка в розовом платье входит в деревянный сарай’, близкая подсказка будет ‘Молодой мальчик в синей рубашке входит в кирпичный дом’. Напротив, дальная подсказка будет ‘Два кота, лежащие на диване’.

Близкие подсказки были построены путем замены существительных и прилагательных на семантически подобные термины; дальние подсказки были сгенерированы путем инструктирования модели создавать подписи, которые были контекстно очень khácными.

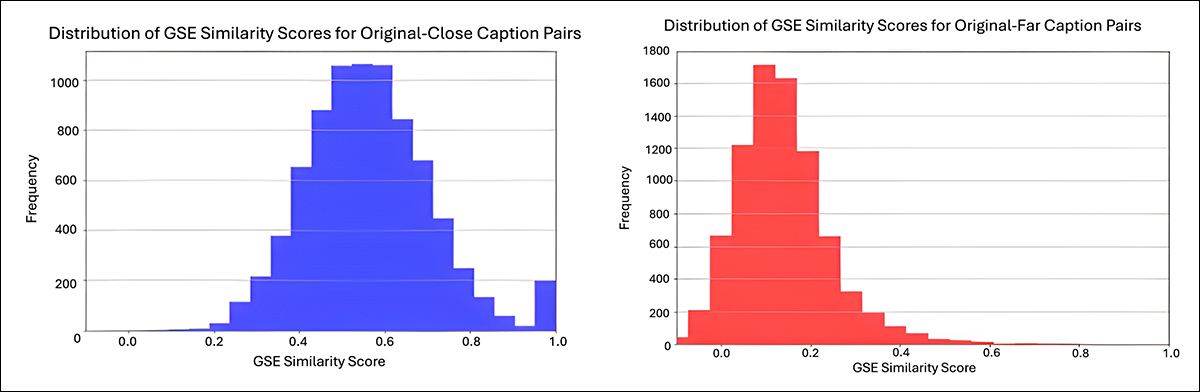

Все сгенерированные подписи были вручную проверены на качество и семантическую актуальность. Был использован Универсальный кодировщик предложений Google, чтобы рассчитать семантические коэффициенты подобия между исходными и измененными подписями:

Из дополнительного материала, распределения семантического подобия для измененных подписей, использованных в тестах Flickr8k. График слева показывает коэффициенты подобия для близко измененных подписей, в среднем около 0,6. График справа показывает обширно измененные подписи, в среднем около 0,1, отражая большее семантическое расстояние от исходных подписей. Значения были рассчитаны с помощью Универсального кодировщика предложений Google. Источник: https://sigport.org/sites/default/files/docs/IncompleteProtection_SM_0.pdf

Каждое изображение, вместе с его защищенной версией, было отредактировано с использованием как близких, так и дальних подсказок. Был использован Блинд/Референсный оценщик качества изображений (BRISQUE), чтобы оценить качество изображения:

Результаты генерации изображения в изображение на натуральных фотографиях, защищенных PhotoGuard. Несмотря на присутствие помех, Stable Diffusion v1.5 успешно следовала как небольшим, так и большим семантическим изменениям в подсказках редактирования, производя реалистичные выходные данные, соответствующие новым инструкциям.

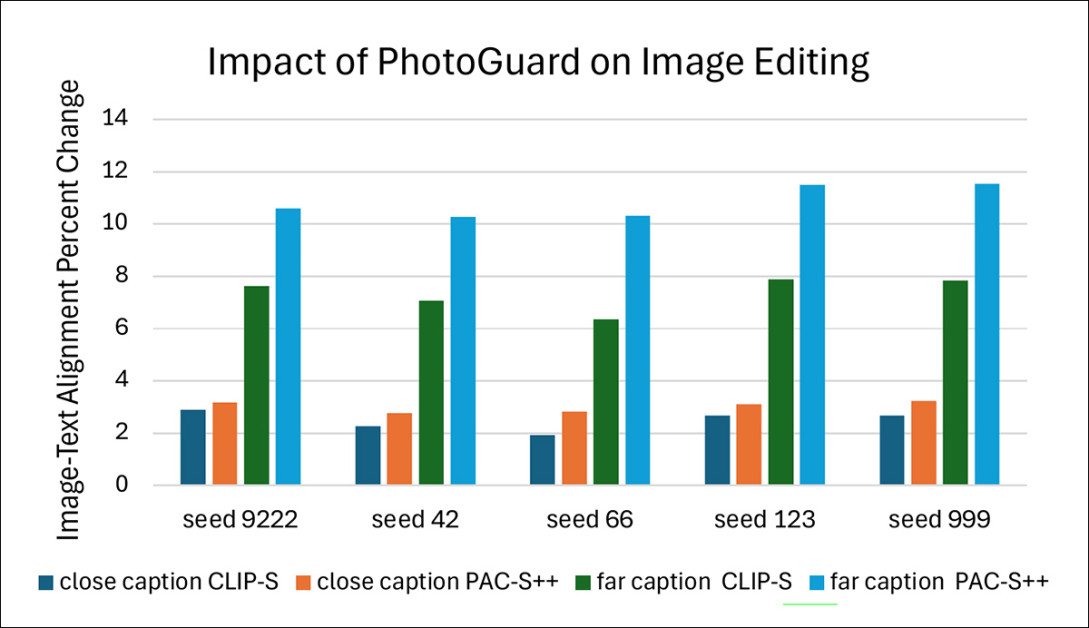

Метрики

Чтобы оценить, насколько хорошо защиты мешают ИИ-редактированию, исследователи измерили, насколько точно конечные изображения соответствовали инструкциям, которые им были даны, используя системы оценки, которые сравнивали содержимое изображения с текстовой подсказкой, чтобы увидеть, насколько хорошо они соответствуют.

Для этого CLIP-S использует модель, которая может понимать как изображения, так и текст, чтобы проверить, насколько они похожи, в то время как PAC-S++ добавляет дополнительные образцы, созданные ИИ, чтобы выровнять свое сравнение более близко к человеческой оценке.

Эти баллы выравнивания изображения и текста (ITA) обозначают, насколько точно ИИ следовал инструкциям при изменении защищенного изображения: если защищенное изображение все еще привело к высоко выровненной выходной картинке, это означает, что защита была признана неудачной в блокировании редактирования.

Влияние защиты на набор данных Flickr8k через пять семян, используя как близкие, так и дальние подсказки. Выравнивание изображения и текста измерялось с помощью баллов CLIP-S и PAC-S++.

Исследователи сравнили, насколько хорошо ИИ следовал подсказкам при редактировании защищенных изображений по сравнению с незащищенными. Они сначала посмотрели на разницу между ними, называемую Фактическим изменением. Затем разница была масштабирована, чтобы создать Процентное изменение, что делало его легче сравнивать результаты через множество тестов.

Этот процесс показал, делают ли защиты редактирование ИИ легче или труднее. Тесты были повторены пять раз, используя разные случайные семена, охватывая как небольшие, так и большие изменения исходных подписей.

Атака искусства

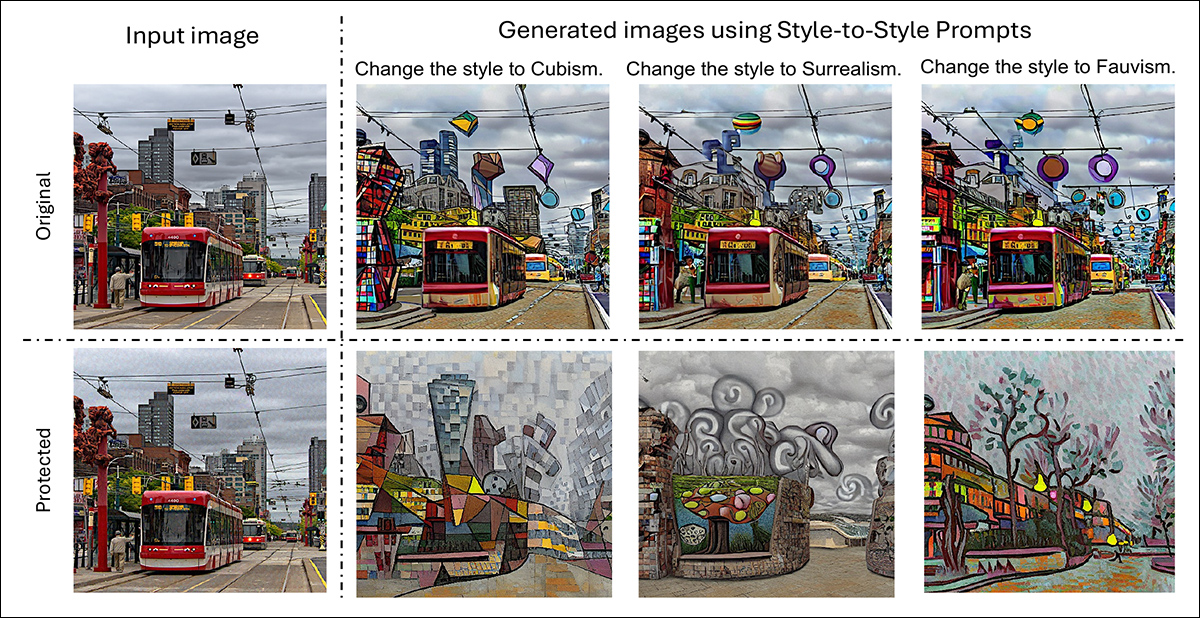

Для тестов на натуральных фотографиях был использован набор данных Flickr1024, содержащий более тысячи высококачественных изображений. Каждое изображение было отредактировано с подсказками, следующими шаблону: ‘Изменить стиль на [V]’, где [V] представлял один из семи знаменитых стилей искусства: Кубизм; Постимпрессионизм; Импрессионизм; Сюрреализм; Барокко; Фовизм; и Ренессанс.

Процесс включал применение PhotoGuard к исходным изображениям, генерирование защищенных версий и затем запуск как защищенных, так и незащищенных изображений через один и тот же набор задач переноса стиля:

Исходные и защищенные версии изображения натуральной сцены, каждое отредактированное для применения Кубизма, Сюрреализма и Фовизма.

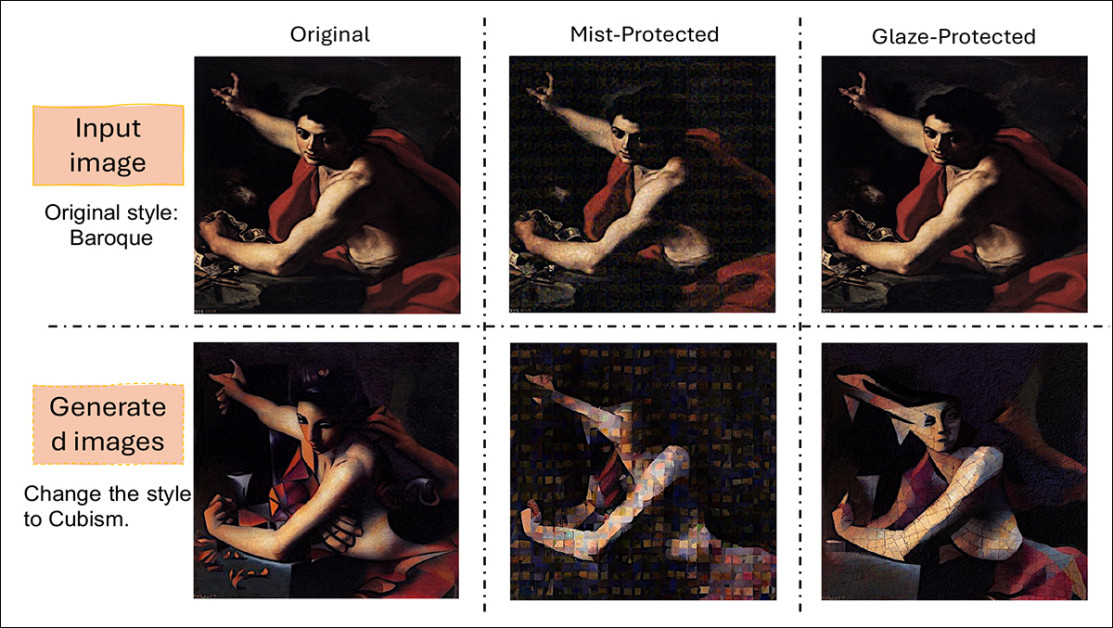

Чтобы протестировать методы защиты на произведениях искусства, был выполнен перенос стиля на изображениях из набора данных WikiArt, который курирует широкий спектр стилей искусства. Подсказки редактирования следовали тому же формату, что и раньше, инструктируя ИИ изменить стиль на случайно выбранный, не связанный стиль, взятый из меток WikiArt.

И Glaze, и Mist методы защиты были применены к изображениям перед редактированием, что позволило исследователям наблюдать, насколько хорошо каждая защита может блокировать или искажать результаты переноса стиля:

Примеры того, как методы защиты влияют на перенос стиля на произведениях искусства. Исходное изображение в стиле Барокко показано рядом с версиями, защищенными Mist и Glaze. После применения переноса стиля Кубизма можно увидеть различия в том, как каждая защита изменяет конечный результат.

Исследователи протестировали сравнения количественно:

Изменения в баллах выравнивания изображения и текста после редактирования переноса стиля.

Из этих результатов авторы комментируют:

‘Результаты подчеркивают значительное ограничение враждебных помех для защиты. Вместо того, чтобы препятствовать выравниванию, враждебные помехи часто усиливают реакцию генеративной модели на подсказки, непреднамеренно позволяя злоумышленникам производить выходные данные, которые более тесно соответствуют их целям. Такая защита не нарушает процесс редактирования изображения и может не быть в состоянии предотвратить злонамеренные действия по копированию неавторизованного материала.

‘Непредвиденные последствия использования враждебных помех выявляют уязвимости в существующих методах и подчеркивают срочную необходимость более эффективных методов защиты.’

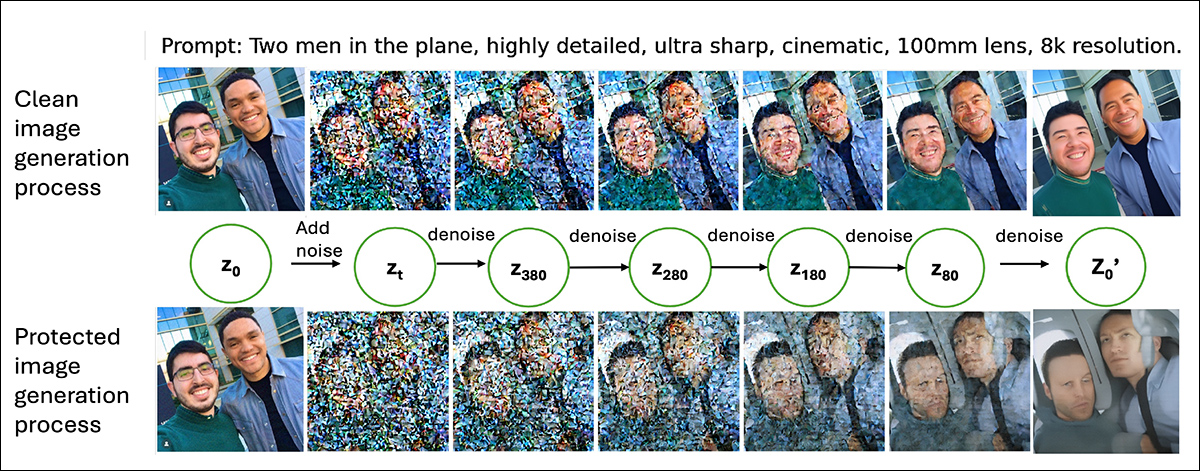

Авторы объясняют, что неожиданные результаты можно отнести к тому, как работают модели диффузии: LDM редактирует изображения, сначала преобразуя их в сжатую версию, называемую латентным; шум затем добавляется к этому латентному через много шагов, пока данные не станут почти случайными.

Модель обращает этот процесс во время генерации, удаляя шум шаг за шагом. На каждом этапе этого обращения текстовая подсказка помогает направлять, как шум должен быть очищен, постепенно формируя изображение, чтобы оно соответствовало подсказке:

Сравнение между генерациями из незащищенного изображения и защищенного изображения PhotoGuard, с промежуточными латентными состояниями, преобразованными обратно в изображения для визуализации.

Методы защиты добавляют небольшие количества дополнительного шума к исходному изображению перед тем, как оно входит в этот процесс. Хотя эти помехи незначительны в начале, они накапливаются, когда модель применяет свои собственные слои шума.

Этот накопление оставляет больше частей изображения ‘неопределенными’, когда модель начинает удалять шум. С большей неопределенностью модель опирается сильнее на текстовую подсказку, чтобы заполнить пропущенные детали, давая подсказке даже большее влияние, чем она обычно имела.

По сути, защиты делают его легче для ИИ изменить изображение, чтобы оно соответствовало подсказке, а не труднее.

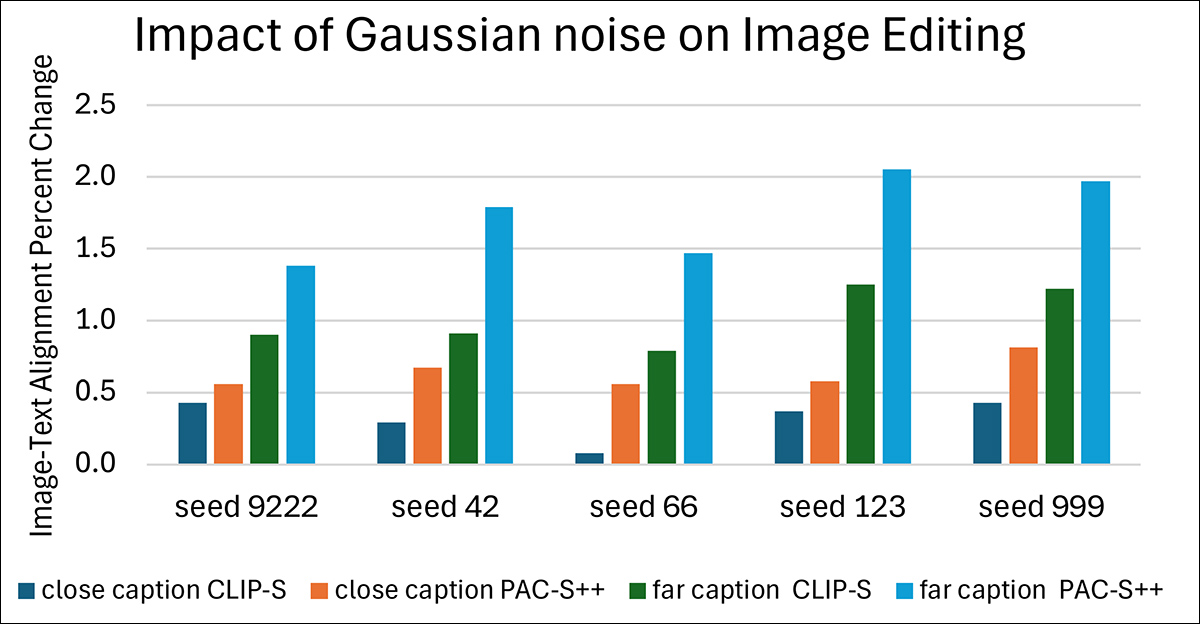

Наконец, авторы провели тест, в котором заменили сконструированные помехи из статьи ‘Raising the Cost of Malicious AI-Powered Image Editing’ на чистый гауссовский шум.

Результаты следовали тому же шаблону, что и раньше: во всех тестах значения Процентного изменения оставались положительными. Даже этот случайный, неструктурированный шум привел к более сильному выравниванию между сгенерированными изображениями и подсказками.

Влияние имитированной защиты с использованием гауссовского шума на набор данных Flickr8k.

Это подтвердило основное объяснение, что любой добавленный шум, независимо от его конструкции, создает большую неопределенность для модели во время генерации, позволяя текстовой подсказке оказывать еще большее влияние на конечное изображение.

Заключение

Сцена исследований толкала враждебные помехи на проблему авторских прав LDM почти столько же, сколько LDM существуют; но не появились устойчивые решения из необычного количества опубликованных статей на эту тему.

Или наложенные помехи чрезмерно снижают качество изображения, или закономерности не оказываются устойчивыми к манипуляциям и трансформационным процессам.

Однако это трудная мечта, которую трудно отказаться, поскольку альтернативой, кажется, являются сторонние системы мониторинга и рамки доказательства, такие как схема C2PA, возглавляемая Adobe, которая стремится поддерживать цепочку хранения для изображений от датчика камеры, но которая не имеет внутренней связи с изображаемым контентом.

В любом случае, если враждебные помехи на самом деле делают проблему хуже, как указывает новая статья, можно ли считать поиск защиты авторских прав с помощью таких средств “алхимией”.

Опубликовано в первый раз в понедельник, 9 июня 2025 года