Искусственный интеллект

Мультимодальная ИИ Эволюционирует, Когда ChatGPT Получает Зрение с GPT-4V(идение)

В рамках продолжающихся усилий по приближению ИИ к человеческим возможностям, модели GPT от OpenAI постоянно расширяют границы. GPT-4 теперь может принимать запросы как текста, так и изображений.

Мультимодальность в генеративном ИИ обозначает способность модели производить различные выходные данные, такие как текст, изображения или аудио, на основе входных данных. Эти модели, обученные на конкретных данных, учатся распознавать основные закономерности для генерации подобных новых данных, обогащая приложения ИИ.

Недавние Шаги в Мультимодальной ИИ

Одним из заметных шагов в этой области является интеграция DALL-E 3 в ChatGPT, значительное обновление технологии текст-изображение от OpenAI. Это сочетание позволяет для более плавного взаимодействия, где ChatGPT помогает в создании точных запросов для DALL-E 3, превращая идеи пользователей в яркое искусство, сгенерированное ИИ. Итак, хотя пользователи могут直接 взаимодействовать с DALL-E 3, наличие ChatGPT в этом процессе делает создание искусства ИИ намного более удобным для пользователей.

Подробнее о DALL-E 3 и его интеграции с ChatGPT можно узнать здесь. Это сотрудничество не только демонстрирует прогресс в мультимодальной ИИ, но и делает создание искусства ИИ легким для пользователей.

Google’s health с другой стороны представила Med-PaLM M в июне этого года. Это мультимодальная генеративная модель, способная кодировать и интерпретировать различные биомедицинские данные. Это было достигнуто путем дообучения PaLM-E, языковой модели, для адаптации к медицинским областям с использованием открытого бенчмарка, MultiMedBench. Этот бенчмарк состоит из более чем 1 миллиона образцов по 7 биомедицинским типам данных и 14 задачам, таким как медицинские вопросы-ответы и генерация отчетов радиологии.

Различные отрасли принимают инновационные мультимодальные инструменты ИИ, чтобы стимулировать бизнес-расширение, оптимизировать операции и повысить вовлеченность клиентов. Прогресс в возможностях ИИ голоса, видео и текста стимулирует рост мультимодальной ИИ.

Корпорации ищут мультимодальные приложения ИИ, способные изменить бизнес-модели и процессы, открывая пути роста по всей экосистеме генеративного ИИ, от инструментов данных до появляющихся приложений ИИ.

После запуска GPT-4 в марте некоторые пользователи заметили снижение качества ответов с течением времени, проблема, отраженная заметными разработчиками и на форумах OpenAI. Первоначально отклоненная OpenAI, позднее исследование подтвердило проблему. Оно показало снижение точности GPT-4 с 97,6% до 2,4% между мартом и июнем, указывая на снижение качества ответов с последующими обновлениями модели.

Шум вокруг Open AI’s ChatGPT вернулся. Теперь он поставляется с функцией зрения GPT-4V, позволяющей пользователям проанализировать изображения, предоставленные ими. Это последняя функция, открытая для пользователей.

Добавление анализа изображений к большим языковым моделям (LLM) как GPT-4 считается некоторыми как большой шаг вперед в исследованиях и разработке ИИ. Этот тип мультимодальной LLM открывает новые возможности, вынося языковые модели за пределы текста, чтобы предложить новые интерфейсы и решить новые типы задач, создавая свежие trải nghiệm для пользователей.

Механика Видения GPT-4

Замечательные возможности языка и зрения GPT-4, хотя и впечатляют, имеют лежащие в основе методы, которые остаются на поверхности.

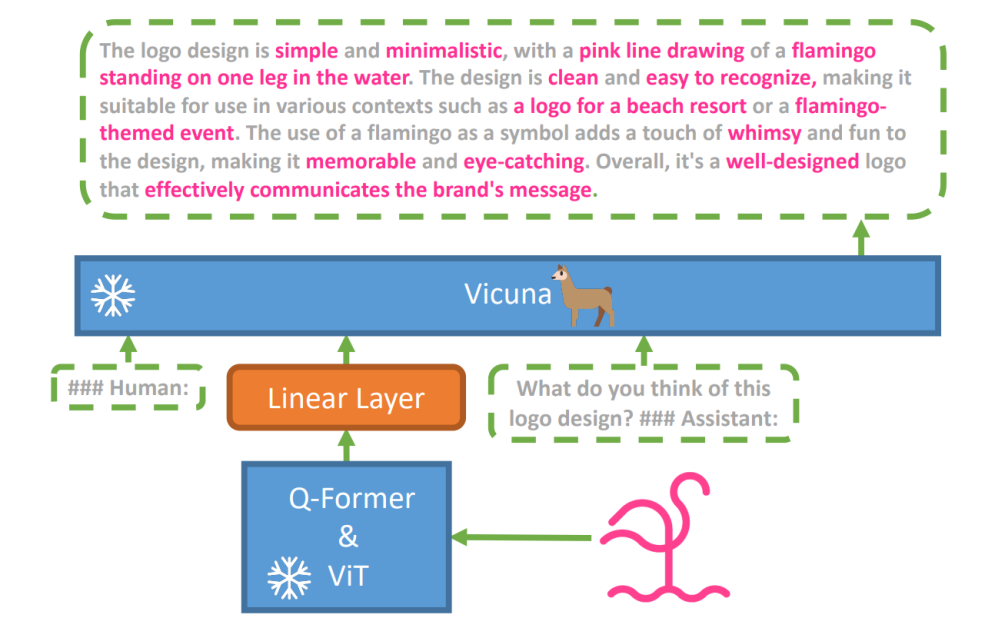

Чтобы изучить эту гипотезу, была представлена новая модель видения-языка, MiniGPT-4, использующая передовую LLM под названием Vicuna. Эта модель использует кодировщик видения с предварительно обученными компонентами для визуального восприятия, выравнивая закодированные визуальные особенности с языковой моделью Vicuna через один слой проекции. Архитектура MiniGPT-4 проста, но эффективна, с фокусом на выравнивании визуальных и языковых особенностей для улучшения возможностей визуального разговора.

Архитектура MiniGPT-4 включает кодировщик видения с предварительно обученными ViT и Q-Former, один линейный слой проекции и передовую языковую модель Vicuna.

Изучение Видения GPT-4

Определение Происхождения Изображений с ChatGPT

GPT-4 Видение улучшает способность ChatGPT анализировать изображения и определять их географическое происхождение. Эта функция переводит взаимодействие пользователей из простого текста в смесь текста и визуальных элементов, становясь полезным инструментом для тех, кто интересуется различными местами через данные изображений.

Сложные Математические Концепции

GPT-4 Видение отличается в изучении сложных математических идей, анализируя графические или рукописные выражения. Эта функция действует как полезный инструмент для людей, стремящихся решить сложные математические проблемы, отмечая GPT-4 Видение заметным помощником в образовательных и академических областях.

Преобразование Рукописного Ввода в LaTeX Код

Одна из замечательных способностей GPT-4V – это возможность перевести рукописный ввод в LaTeX код. Эта функция является благом для исследователей, академиков и студентов, которые часто нуждаются в переводе рукописных математических выражений или другой технической информации в цифровой формат. Преобразование из рукописного в LaTeX расширяет горизонт цифровизации документов и упрощает технический процесс написания.

Извлечение Деталей Таблицы

GPT-4V демонстрирует умение извлекать детали из таблиц и решать связанные запросы, что является важным активом в анализе данных. Пользователи могут использовать GPT-4V, чтобы просеять таблицы, собрать ключевые идеи и решить вопросы, делая его мощным инструментом для аналитиков данных и других специалистов.

Понимание Визуального Указания

Уникальная способность GPT-4V понимать визуальное указание добавляет новый измерение взаимодействия пользователя. Понимая визуальные подсказки, GPT-4V может отвечать на запросы с более высоким контекстным пониманием.

Создание Простых Макетов Сайтов, Используя Рисунок

Вдохновленный этим твитом, я попытался создать макет для сайта Unite.ai.

Хотя результат не совсем соответствовал моему первоначальному видению, вот результат, которого я достиг.

Ограничения и Недостатки GPT-4V(идение)

Чтобы проанализировать GPT-4V, команда Open AI провела качественные и количественные оценки. Качественные включали внутренние тесты и обзоры экспертов, а количественные измеряли отказы модели и точность в различных сценариях, таких как выявление вредоносного контента, распознавание демографических данных, проблемы конфиденциальности, геолокация, кибербезопасность и мультимодальные обходы.

Однако модель еще не идеальна.

Статья выделяет ограничения GPT-4V, такие как неправильные выводы и пропущенный текст или символы в изображениях. Она может выдумывать или изобретать факты. В частности, она не подходит для выявления опасных веществ на изображениях, часто неправильно определяя их.

В медицинской визуализации GPT-4V может давать несогласованные ответы и не осознает стандартных практик, что может привести к потенциальным неправильным диагнозам.

Ненадежная производительность для медицинских целей (Источник)

Она также не может понять нюансы определенных символов ненависти и может генерировать неуместный контент на основе визуальных входных данных. OpenAI советует не использовать GPT-4V для критических интерпретаций, особенно в медицинских или чувствительных контекстах.

Заключение

Прибытие GPT-4 Видения (GPT-4V) приносит множество интересных возможностей и новых препятствий. Перед его выпуском было приложено много усилий, чтобы минимизировать риски, особенно когда речь идет об изображениях людей.

Создано с помощью Fast Stable Diffusion XL https://huggingface.co/spaces/google/sdxl