Искусственный интеллект

Мультимодальный ИИ развивается по мере появления ChatGPT с GPT-4V(ision)

В стремлении сделать ИИ более похожим на человека, модели OpenAI GPT постоянно расширяют границы. Теперь GPT-4 может принимать как текстовые, так и графические запросы.

Мультимодальность в генеративном ИИ означает способность модели генерировать разнообразные выходные данные, такие как текст, изображения или аудио, на основе входных данных. Эти модели, обученные на определённых данных, изучают базовые закономерности для генерации аналогичных новых данных, расширяя возможности приложений ИИ.

Последние успехи в области мультимодального искусственного интеллекта

Недавний заметный прорыв в этой области связан с интеграцией DALL-E 3 в ChatGPT, что является существенным усовершенствованием технологии преобразования текста в изображения OpenAI. Это сочетание обеспечивает более плавное взаимодействие, поскольку ChatGPT помогает создавать точные подсказки для DALL-E 3, превращая идеи пользователей в яркие иллюстрации, созданные искусственным интеллектом. Таким образом, хотя пользователи могут напрямую взаимодействовать с DALL-E 3, наличие ChatGPT делает процесс создания изображений с помощью ИИ гораздо более удобным.

Узнайте больше о DALL-E 3 и его интеграции с ChatGPT. здесь. Это сотрудничество не только демонстрирует достижения в области мультимодального искусственного интеллекта, но и упрощает создание произведений искусства с использованием искусственного интеллекта для пользователей.

С другой стороны, Google Health представила Med-PaLM M в июне этого года. Это мультимодальная генеративная модель, предназначенная для кодирования и интерпретации разнообразных биомедицинских данных. Это было достигнуто путём тонкой настройки PaLM-E, языковой модели, для работы с медицинскими областями с использованием открытого бенчмарка MultiMedBench. Этот бенчмарк включает более 1 миллиона выборок из 7 типов биомедицинских данных и 14 задач, таких как ответы на медицинские вопросы и создание отчётов по рентгенологии.

Различные отрасли внедряют инновационные мультимодальные инструменты искусственного интеллекта для расширения бизнеса, оптимизации операций и повышения вовлеченности клиентов. Развитие возможностей искусственного интеллекта для голосовой, видео- и текстовой обработки стимулирует развитие мультимодального искусственного интеллекта.

Предприятия ищут мультимодальные приложения ИИ, способные перестроить бизнес-модели и процессы, открывая возможности для роста всей генеративной экосистемы ИИ, от инструментов обработки данных до новых приложений ИИ.

После запуска GPT-4 в марте некоторые пользователи заметили снижение качества отклика со временем, что вызвало обеспокоенность у известных разработчиков и на форумах OpenAI. Первоначально эта проблема была отвергнута OpenAI, а позднее исследовании подтвердил проблему. Было выявлено снижение точности GPT-4 с 97.6% до 2.4% в период с марта по июнь, что указывает на снижение качества ответов при последующих обновлениях модели.

Шумиха вокруг Открытые ИИ ChatGPT вернулся. Теперь он поставляется с функцией видения ГПТ-4В, позволяя пользователям анализировать предоставленные ими изображения с помощью GPT-4. Это новейшая функция, доступная пользователям.

Добавление анализа изображений в большие языковые модели (LLM), такие как GPT-4, рассматривается некоторыми как большой шаг вперед в исследованиях и разработках ИИ. Этот вид мультимодального LLM открывает новые возможности, выводя языковые модели за рамки текста, предлагая новые интерфейсы и решая новые виды задач, создавая новый опыт для пользователей.

Обучение GPT-4V было завершено в 2022 году, а ранний доступ был открыт в марте 2023 года. Визуальная функция GPT-4V основана на технологии GPT-4. Тренировочный процесс остался прежним. Первоначально модель была обучена предсказывать следующее слово в тексте, используя огромный набор данных, состоящий из текста и изображений из различных источников, включая Интернет.

Позже он был доработан с использованием большего количества данных, используя метод под названием «Обучение с подкреплением на основе обратной связи с человеком» (RLHF), чтобы генерировать результаты, которые предпочитают люди.

Механика обзора GPT-4

Удивительные возможности языка зрительного восприятия GPT-4, хотя и впечатляющие, имеют в своей основе методы, которые остаются на поверхности.

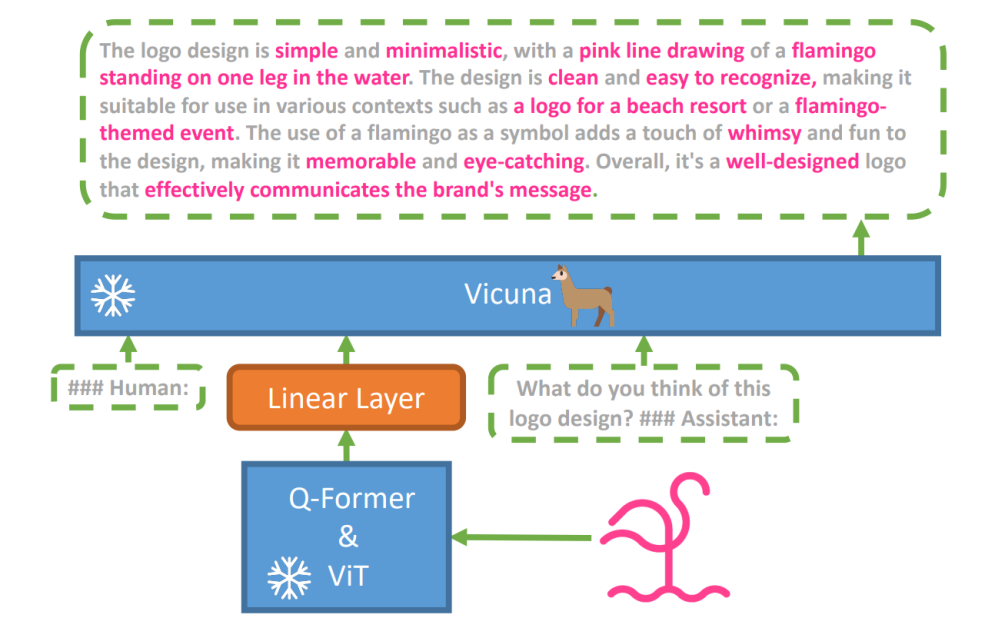

Чтобы исследовать эту гипотезу, была создана новая модель языка видения, МиниГПТ-4 был представлен с использованием передовой программы LLM под названием Викунья. В этой модели используется видеокодер с предварительно обученными компонентами для визуального восприятия, который выравнивает закодированные визуальные функции с моделью языка викуньи через один проекционный слой. Архитектура MiniGPT-4 проста, но эффективна, в ней основное внимание уделяется согласованию визуальных и языковых функций для улучшения возможностей визуального общения.

Архитектура MiniGPT-4 включает в себя видеокодер с предварительно обученными ViT и Q-Former, один линейный проекционный слой и усовершенствованную большую языковую модель Vicuna.

Тенденция использования авторегрессионных языковых моделей в задачах визуального языка также выросла, используя кросс-модальный перенос для обмена знаниями между языковыми и мультимодальными областями.

MiniGPT-4 объединяет визуальную и языковую области, сопоставляя визуальную информацию, полученную от предварительно обученного видеокодера с продвинутой моделью LLM. Модель использует Vicuna в качестве языкового декодера и использует двухэтапный подход к обучению. Сначала она обучается на большом наборе данных, состоящем из пар «изображение-текст», для понимания взаимосвязи между визуальным восприятием и языком, а затем дорабатывается на небольшом наборе данных высокого качества для повышения надежности и удобства генерации.

Чтобы повысить естественность и удобство использования сгенерированного языка в MiniGPT-4, исследователи разработали двухэтапный процесс выравнивания, устраняя недостаток адекватных наборов данных для выравнивания изображения и языка. Для этой цели они создали специализированный набор данных.

На первом этапе модель генерировала подробные описания входных изображений, повышая детализацию с помощью диалоговых подсказок, соответствующих формату модели языка викунья. Целью этого этапа было создание более полных описаний изображений.

Подсказка к описанию исходного изображения:

###Человек: Опишите этот образ подробно. Дайте как можно больше подробностей. Скажи все, что видишь. ###Ассистент:

При постобработке данных любые несоответствия или ошибки в сгенерированных описаниях исправлялись с помощью ChatGPT с последующей ручной проверкой для обеспечения высокого качества.

Подсказка для второго этапа точной настройки:

###Человек: ###Ассистент:

Это исследование открывает окно в понимание механики мультимодального генеративного ИИ, такого как GPT-4, и проливает свет на то, как можно эффективно интегрировать зрительные и языковые модальности для создания последовательных и контекстуально богатых результатов.

Изучение концепции GPT-4

Определение происхождения изображения с помощью ChatGPT

GPT-4 Vision расширяет возможности ChatGPT по анализу изображений и определению их географического происхождения. Эта функция позволяет пользователю не просто взаимодействовать с текстом, а комбинировать текст и визуальные элементы, становясь удобным инструментом для тех, кто интересуется различными местами с помощью изображений.

Сложные математические концепции

GPT-4 Vision отлично справляется с изучением сложных математических идей путем анализа графических или рукописных выражений. Эта функция служит полезным инструментом для людей, желающих решать сложные математические задачи, что делает GPT-4 Vision заметным помощником в образовательной и академической областях.

Преобразование рукописного ввода в коды LaTeX

Одной из замечательных возможностей GPT-4V является возможность перевода рукописных данных в коды LaTeX. Эта функция незаменима для исследователей, учёных и студентов, которым часто требуется преобразовывать рукописные математические выражения или другую техническую информацию в цифровой формат. Преобразование рукописных данных в формат LaTeX расширяет возможности оцифровки документов и упрощает процесс написания технических текстов.

Извлечение сведений о таблице

GPT-4V демонстрирует навыки извлечения подробностей из таблиц и ответа на соответствующие запросы, что является жизненно важным преимуществом в анализе данных. Пользователи могут использовать GPT-4V для анализа таблиц, сбора ключевой информации и решения вопросов, связанных с данными, что делает его надежным инструментом для аналитиков данных и других специалистов.

Понимание визуального указания

Уникальная способность GPT-4V воспринимать визуальные указания добавляет новое измерение взаимодействию с пользователем. Понимая визуальные сигналы, GPT-4V может отвечать на запросы с более глубоким пониманием контекста.

Создание простых макетов веб-сайтов с использованием чертежей

Мотивированный этим TweetЯ попытался создать макет сайта unite.ai.

Хоть результат и не совсем соответствовал моему первоначальному замыслу, вот чего мне удалось добиться.

Ограничения и недостатки GPT-4V(ision)

Для анализа GPT-4V команда Open AI провела качественные и количественные оценки. Качественные включали внутренние тесты и внешние экспертные оценки, а количественные измеряли отказы и точность модели в различных сценариях, таких как выявление вредоносного контента, демографическое распознавание, проблемы конфиденциальности, геолокация, кибербезопасность и мультимодальный взлом.

И все же модель не идеальна.

статье Подчеркиваются ограничения GPT-4V, такие как неверные выводы и отсутствие текста или символов на изображениях. GPT-XNUMXV может создавать галлюцинации или выдумывать факты. В частности, GPT-XNUMXV не подходит для определения опасных веществ на изображениях, часто определяя их неверно.

При медицинской визуализации GPT-4V может давать противоречивые ответы и не учитывает стандартные методы, что приводит к потенциальным ошибочным диагнозам.

Ненадежная работа для медицинских целей (Источник)

Он также не способен уловить нюансы некоторых символов ненависти и может генерировать неприемлемый контент на основе визуальных данных. OpenAI не рекомендует использовать GPT-4V для критической интерпретации, особенно в медицинских или деликатных контекстах.

Подводя итог

Создано с использованием Fast Stable Diffusion XL. https://huggingface.co/spaces/google/sdxl

Появление GPT-4 Vision (GPT-4V) открывает множество интересных возможностей и новых препятствий. Перед его внедрением были приложены значительные усилия для того, чтобы тщательно изучить и минимизировать риски, особенно связанные с фотографиями людей. Впечатляет, насколько продвинулась GPT-4V, показав многообещающие результаты в таких сложных областях, как медицина и наука.

Теперь на повестке дня несколько важных вопросов. Например, смогут ли эти модели узнавать известных людей по фотографиям? Должны ли они угадывать пол, расу или чувства человека по изображению? И нужны ли специальные настройки для людей с нарушениями зрения? Эти вопросы открывают целый ряд вопросов о конфиденциальности, справедливости и о том, как ИИ должен вписываться в нашу жизнь, — и каждый должен иметь возможность высказаться по этому вопросу.