Лидеры мнений

Расшифровка возможностей и проблем для агентов LLM в генеративном ИИ

Мы наблюдаем прогрессию приложений генеративного ИИ, работающих на основе больших языковых моделей (LLM), от подсказок к генерации с помощью поиска (RAG) и до агентов. Агенты активно обсуждаются в промышленности и научных кругах, главным образом благодаря мощности, которую эта технология предоставляет для трансформации корпоративных приложений и обеспечения лучшего опыта взаимодействия с клиентами. Существуют общие закономерности для создания агентов, которые позволяют сделать первые шаги к искусственному общему интеллекту (AGI).

В моей предыдущей статье мы рассмотрели лестницу интеллекта закономерностей для создания приложений, работающих на основе LLM. Начиная с подсказок, которые отражают проблемную область и используют внутреннюю память LLM для генерации вывода. С помощью RAG мы дополняем подсказку внешними знаниями, найденными в векторной базе данных, чтобы контролировать вывод. Далее, объединяя вызовы LLM, мы можем создать рабочие процессы для реализации сложных приложений. Агенты выводят это на новый уровень, автоматически определяя, как эти цепочки LLM должны быть сформированы. Давайте рассмотрим подробнее.

Агенты – под капотом

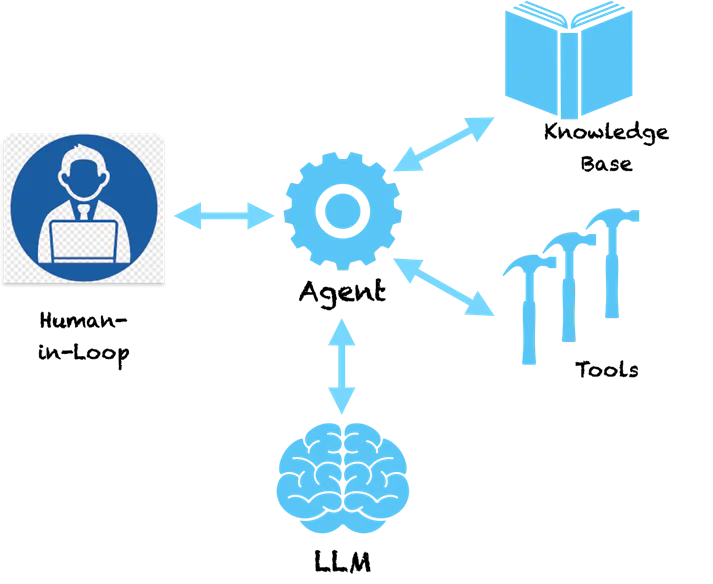

Ключевая закономерность с агентами заключается в том, что они используют силу понимания языка LLM, чтобы спланировать, как решить задачу. LLM понимает проблему и дает нам последовательность шагов для ее решения. Однако это не все. Агенты не являются чистой системой поддержки, которая будет предоставлять вам рекомендации по решению проблемы, а затем передает бразды правления вам, чтобы выполнить рекомендуемые шаги. Агенты оснащены инструментами, чтобы выполнить действия. Страшно, правда?!

Если мы задаем агенту простой вопрос, такой как:

Человек: Какая компания была основана изобретателем телефона?

Ниже приведен образец мыслительных шагов, которые агент может выполнить.

Агент (РАССУЖДЕНИЕ):

- Мысль: мне нужно найти изобретателя телефона.

- Действие: Поиск [изобретатель телефона]

- Наблюдение: Александр Грейам Белл

- Мысль: мне нужно найти компанию, основанную Александром Грейамом Беллом

- Действие: Поиск [компания, основанная Александром Грейамом Беллом]

- Наблюдение: Александр Грейам Белл стал сооснователем компании American Telephone and Telegraph Company (AT&T) в 1885 году

- Мысль: я нашел ответ. Я вернусь.

Агент (ОТВЕТ): Александр Грейам Белл стал сооснователем AT&T в 1885 году

Вы можете увидеть, что агент следует методичному способу разбиения проблемы на подзадачи, которые можно решить, выполнив конкретные действия. Действия здесь рекомендуются LLM, и мы можем сопоставить их с конкретными инструментами для реализации этих действий. Мы могли бы включить инструмент поиска для агента, чтобы, когда он осознает, что LLM предоставил поиск как действие, он вызвал этот инструмент с параметрами, предоставленными LLM. Поиск здесь выполняется в интернете, но также может быть перенаправлен на поиск во внутренней базе знаний, такой как векторная база данных. Система теперь становится самодостаточной и может выяснить, как решить сложные проблемы, следуя серии шагов. Фреймворки, такие как LangChain и LLaMAIndex, предоставляют вам легкий способ создания этих агентов и подключения к инструментам и API. Amazon недавно запустила свою платформу Bedrock Agents, которая предоставляет визуальный интерфейс для проектирования агентов.

Под капотом агенты следуют особому стилю отправки подсказок в LLM, что заставляет их генерировать план действий. Вышеуказанная закономерность Мысли-Действия-Наблюдения популярна в типе агента, называемом ReAct (Рассуждение и действие). Другие типы агентов включают MRKL и Plan & Execute, которые в основном различаются стилем подсказок.

Для более сложных агентов действия могут быть связаны с инструментами, которые вызывают изменения в исходных системах. Например, мы могли бы подключить агента к инструменту, который проверяет баланс отпуска и подает заявку на отпуск в системе ERP для сотрудника. Теперь мы могли бы создать приятного чат-бота, который взаимодействует с пользователями и через команду чата подает заявку на отпуск в системе. Никаких больше сложных экранов для подачи заявок на отпуск, простой унифицированный интерфейс чата. Звучит интересно!

Ограничения и необходимость Ответственного ИИ

Теперь что, если у нас есть инструмент, который вызывает транзакции на фондовом рынке с помощью предварительно авторизованного API? Вы создаете приложение, где агент изучает изменения на фондовом рынке (с помощью инструментов) и принимает решения о покупке и продаже акций. Что, если агент продает неправильные акции, потому что он галлюцинировал и принял неправильное решение? Поскольку LLM являются огромными моделями, трудно понять, почему они принимают некоторые решения, поэтому галлюцинации являются распространенными в отсутствие надлежащих ограничений.

Хотя агенты fasciniruyuschie, вы, вероятно, уже догадались, как они могут быть опасны. Если они галлюцинируют и выполняют неправильное действие, это может привести к巨альным финансовым потерям или серьезным проблемам в корпоративных системах. Поэтому Ответственный ИИ становится крайне важным в эпоху приложений, работающих на основе LLM. Принципы Ответственного ИИ вокруг воспроизводимости, прозрачности и подотчетности пытаются установить ограничения на решения, принимаемые агентами, и предлагают анализ рисков, чтобы решить, какие действия требуют участия человека в цикле. Поскольку проектируются более сложные агенты, они требуют более пристального внимания, прозрачности и подотчетности, чтобы мы были уверены в том, что они делают.

Заключительные мысли

Способность агентов генерировать путь логических шагов с действиями приближает их к человеческому рассуждению. Оснащение их более мощными инструментами может дать им сверхспособности. Закономерности, такие как ReAct, пытаются имитировать, как люди решают проблемы, и мы увидим лучшие закономерности агентов, которые будут актуальны для конкретных контекстов и областей (банковское дело, страхование, здравоохранение, промышленность и т. д.). Будущее уже здесь, и технология за агентами готова к использованию. В то же время нам нужно внимательно следить за ограничениями Ответственного ИИ, чтобы мы не создавали Skynet!