Взгляд Anderson

Борьба ИИ с чтением аналоговых часов может иметь более глубокое значение

Новая статья исследователей из Китая и Испании показывает, что даже такие передовые многомодальные модели ИИ, как GPT-4.1, испытывают трудности с определением времени по изображениям аналоговых часов. Небольшие визуальные изменения в часах могут вызвать значительные ошибки интерпретации, а тонкая настройка помогает только с знакомыми примерами. Результаты вызывают обеспокоенность по поводу надежности этих моделей при столкновении с незнакомыми изображениями в реальных задачах.

Когда люди развивают достаточно глубокое понимание области, такой как гравитация или другие основные физические принципы, мы выходим за рамки конкретных примеров и осваиваем лежащие в основе абстракции. Это позволяет нам применять эти знания творчески в различных контекстах и распознавать новые примеры, даже те, которые мы никогда не видели раньше, определяя принцип в действии.

Когда область имеет достаточное значение, мы можем даже начать воспринимать ее там, где она не существует, как в случае с pareidolia, обусловленной высокой стоимостью несвоевременного распознавания реального примера. Так сильна эта механизм распознавания образов, что она даже заставляет нас находить более широкий спектр образов там, где их нет.

Чем раньше и повторяющимся образом область воспитывается в нас, тем глубже ее основа и жизнестойкость; и одним из самых ранних визуальных наборов данных, с которыми мы сталкиваемся в детстве, является обучение часам, где используются печатные материалы или интерактивные аналоговые часы для обучения нас чтению времени:

Учебные пособия для обучения детей чтению времени. Source: https://www.youtube.com/watch?v=IBBQXBhSNUs

Хотя изменяющиеся моды в дизайне часов могут иногда вызывать у нас трудности, стойкость этого раннего освоения области довольно впечатляет, позволяя нам различать аналоговые часовые лица даже перед лицом сложных или “эксцентричных” дизайнерских решений:

Некоторые сложные лица в часовой моде. Source: https://www.ablogtowatch.com/wait-a-minute-legibility-is-the-most-important-part-of-watch-design/

Люди не нуждаются в тысячах примеров, чтобы научиться, как работают часы; как только базовая концепция освоена, мы можем распознавать ее почти в любой форме, даже когда она искажена или абстрагирована.

Трудность, с которой сталкиваются модели ИИ при выполнении этой задачи, по контрасту, подчеркивает более глубокую проблему: их кажущаяся сила может зависеть больше от высокообъемной экспозиции, чем от понимания.

За пределами имитационной игры?

Напряжение между поверхностным выполнением и настоящим “пониманием” возникло повторно в недавних исследованиях крупных моделей. В прошлом месяце Зхэцзянский университет и Университет Уэстлейка переформулировали вопрос в статье под названием Действительно ли модели PhD-уровня LLMs понимают элементарное сложение? (не является предметом этой статьи), заключив:

‘Несмотря на впечатляющие показатели, модели демонстрируют критическую зависимость от распознавания образов, а не от настоящего понимания, что подтверждается неудачами с символическими представлениями и нарушениями основных свойств.

‘Ясная постановка правил ухудшает производительность, что указывает на внутренние архитектурные ограничения. Эти идеи раскрывают пробелы в оценке и подчеркивают необходимость архитектур, способных к настоящей математической логике за пределами распознавания образов.’

На этой неделе вопрос возникает снова, теперь в сотрудничестве между Нанкинским университетом аэронавтики и астронавтики и Университетом Политехники Мадрида в Испании. Под названием Действительно ли многомодальные крупные языковые модели (MLLMs) научились читать время на аналоговых часах?, новая статья исследует, насколько хорошо многомодальные модели понимают чтение времени.

Хотя прогресс исследования описан только в общих деталях в статье, первоначальные тесты исследователей установили, что многомодальная языковая модель GPT-4.1 от OpenAI испытывала трудности с правильным чтением времени с разнообразного набора изображений часов, часто давая неправильные ответы даже в простых случаях.

Это указывает на возможный пробел в наборе данных модели, что поднимает необходимость более сбалансированного набора данных, чтобы проверить, может ли модель фактически выучить лежащую в основе концепцию. Следовательно, авторы создали синтетический набор данных аналоговых часов, равномерно покрывающий каждое возможное время и избегающий обычных предубеждений, найденных в изображениях в Интернете:

Пример из синтетического набора данных аналоговых часов исследователей, использованного для тонкой настройки модели GPT в новой работе. Source: https://huggingface.co/datasets/migonsa/analog_watches_finetune

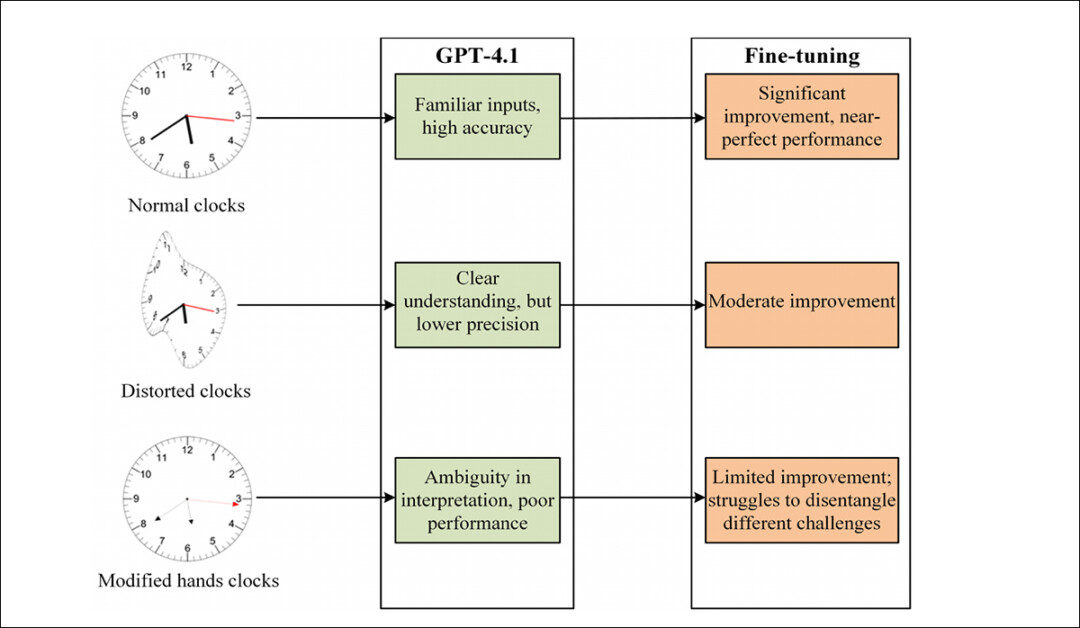

До тонкой настройки на новом наборе данных GPT-4.1 последовательно не смогла прочитать эти часы. После некоторого знакомства с новой коллекцией его производительность улучшилась – но только когда новые изображения выглядели как те, которые он уже видел.

Когда форма часов или стиль рук изменялись, точность резко падала; даже небольшие изменения, такие как более тонкие руки или стрелки (самое правое изображение ниже), были достаточны, чтобы сбить его с толку; и GPT-4.1 испытывал дополнительные трудности с интерпретацией “расплавляющихся часов” Дали:

Изображения часов со стандартным дизайном (слева), искаженной формой (в центре) и измененными руками (справа), вместе с временем, возвращенным GPT-4.1 до и после тонкой настройки. Source: https://arxiv.org/pdf/2505.10862

Авторы делают вывод, что текущие модели, такие как GPT-4.1, могут поэтому изучать чтение часов в основном через визуальное распознавание образов, а не через более глубокое понимание времени, утверждая:

‘[GPT 4.1] не справляется, когда часы деформированы или когда руки изменены, чтобы быть тоньше и иметь стрелку. Средняя абсолютная ошибка (MAE) в оценке времени за 150 случайных времен была 232,48 с для начальных часов, 1380,69 с, когда форма деформирована, и 3726,93 с, когда руки изменены.

‘Эти результаты предполагают, что MLLM не научилась читать время, а rather запомнила образы.’

Достаточно времени

Большинство наборов данных для обучения полагаются на изображения, полученные из Интернета, которые, как правило, повторяют определенные времена – особенно 10:10, популярную настройку в рекламе часов:

Из новой статьи, пример распространения времени ‘десять минут после десяти’ в аналоговых часовых изображениях.

В результате этого ограниченного диапазона времени, изображенного на часах, модель может видеть только узкий диапазон возможных конфигураций часов, что ограничивает ее способность обобщать за пределы этих повторяющихся образов.

Что касается того, почему модели не могут правильно интерпретировать искаженные часы, статья гласит:

‘Хотя GPT-4.1 работает исключительно хорошо со стандартными часами, удивительно, что изменение часов, сделав их тоньше и добавив стрелки, приводит к значительному падению точности.

‘Интуитивно можно было бы ожидать, что более визуально сложное изменение – искаженная циферблат – окажет более значительное влияние на производительность, но это изменение, кажется, имеет относительно меньший эффект.

‘Это вызывает вопрос: как MLLM интерпретируют часы, и почему они не справляются? Одна из возможностей заключается в том, что более тонкие руки нарушают способность модели воспринимать направление, ослабляя ее понимание пространственной ориентации.

‘Альтернативно, могут быть другие факторы, которые вызывают путаницу, когда модель пытается объединить часовые, минутные и секундные руки в точное время.’

Авторы утверждают, что определение коренной причины этих неудач является ключом к продвижению многомодальных моделей: если проблема заключается в том, как модель воспринимает пространственное направление, тонкая настройка может предложить простое решение; но если проблема возникает из более широкой трудности в интеграции нескольких визуальных сигналов, это указывает на более фундаментальную слабость в том, как эти системы обрабатывают информацию.

Тесты тонкой настройки

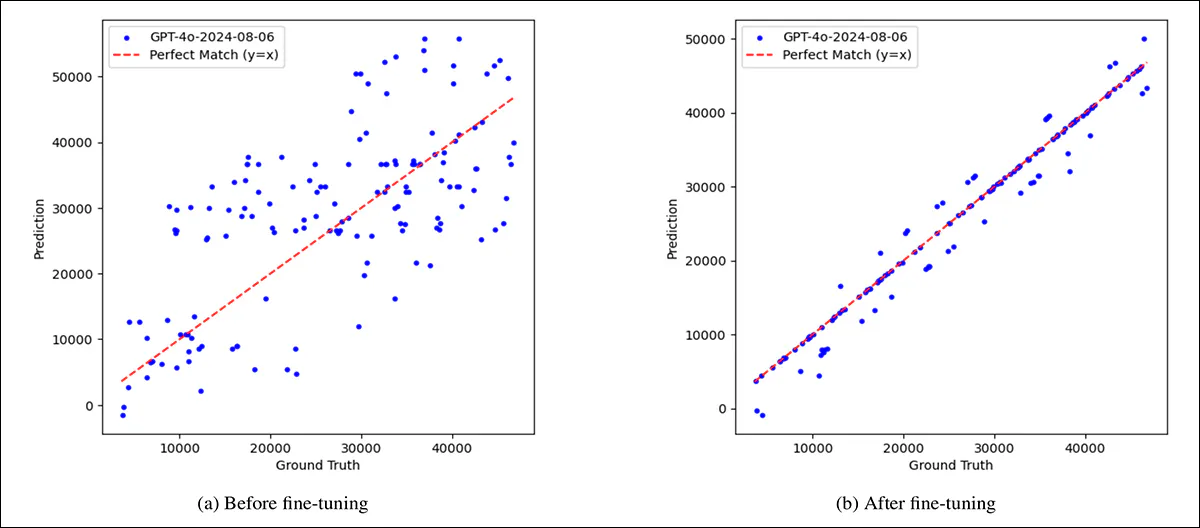

Чтобы проверить, могут ли неудачи модели быть преодолены с помощью экспозиции, GPT-4.1 была тонко настроена на вышеупомянутом и всестороннем синтетическом наборе данных. До тонкой настройки ее прогнозы были широко разбросаны, с значительными ошибками во всех типах часов. После тонкой настройки на коллекции точность резко улучшилась на стандартных часовых лицах и, в меньшей степени, на искаженных.

Однако часы с измененными руками, такими как более тонкие формы или стрелки, продолжали производить крупные ошибки.

Две различные модели неудач возникли: на обычных и искаженных часах модель обычно неправильно оценивала направление рук; но на часах с измененными стилями рук она часто путала функцию каждой руки, принимая часовую за минутную или минутную за секундную.

Сравнение, иллюстрирующее первоначальную слабость модели и частичные выгоды, достигнутые за счет тонкой настройки, показывающее предсказанное и фактическое время в секундах для 150 случайно выбранных часов. Слева, до тонкой настройки, прогнозы GPT-4.1 разбросаны и часто далеки от правильных значений, указанных красной диагональной линией. Справа, после тонкой настройки на сбалансированном синтетическом наборе данных, прогнозы гораздо ближе к фактическим значениям, хотя некоторые ошибки остаются.

Это предполагает, что модель научилась ассоциировать визуальные особенности, такие как толщина руки, с конкретными ролями, и боролась, когда эти сигналы менялись.

Ограниченное улучшение на незнакомых дизайнах вызывает дальнейшие сомнения в том, что модель такого типа учит абстрактную концепцию чтения времени или просто совершенствует свое распознавание образов.

Знаки рук

Итак, хотя тонкая настройка улучшила производительность GPT-4.1 на обычных аналоговых часах, она оказала гораздо меньшее влияние на часы с более тонкими руками или стрелками, что вызывает возможность того, что неудачи модели возникли не из-за абстрактного рассуждения, а из-за путаницы в отношении того, какая рука является какой.

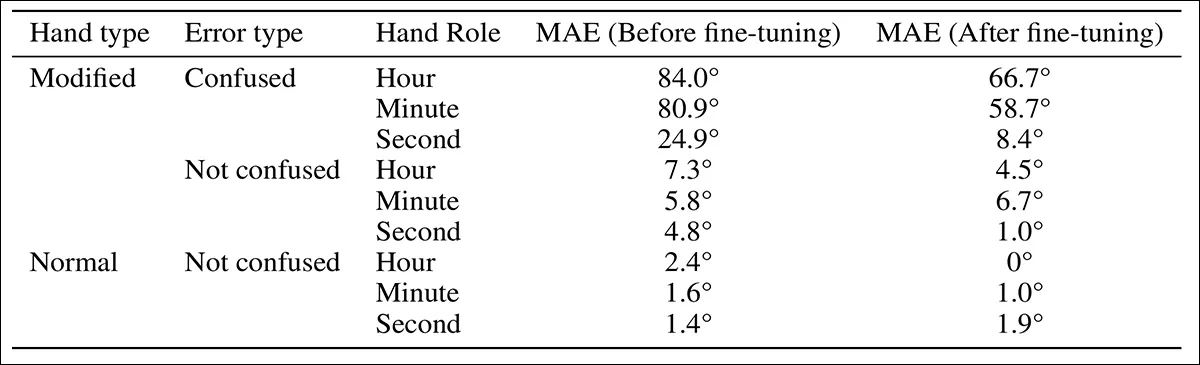

Чтобы проверить, может ли точность улучшиться, если эта путаница будет устранена, был проведен новый анализ прогнозов модели для набора данных “измененные руки”. Выходные данные были разделены на две группы: случаи, когда GPT-4.1 правильно распознала часовые, минутные и секундные руки; и случаи, когда она этого не сделала.

Прогнозы были оценены по средней абсолютной ошибке (MAE) до и после тонкой настройки, и результаты сравнены с результатами для стандартных часов; угловая ошибка также была измерена для каждой руки с использованием положения циферблата в качестве базовой линии:

Сравнение ошибок для часов с и без путаницы в ролях рук в наборе данных измененных рук до и после тонкой настройки.

Путаница в отношении ролей часов привела к самым большим ошибкам. Когда GPT-4.1 путала часовую руку с минутной или наоборот, полученные оценки времени часто были очень далеки от истинных.

Угловая ошибка по типу руки для прогнозов с и без путаницы в ролях рук до и после тонкой настройки в наборе данных измененных рук.

Чтобы сосредоточиться только на направленных ошибках, анализ был ограничен случаями, когда модель правильно определила функцию каждой руки. Если модель внутренне освоила общую концепцию чтения времени, ее производительность на этих примерах должна была соответствовать ее точности на стандартных часах. Это не произошло, и точность осталась заметно хуже.

Чтобы изучить, мешает ли форма руки чувству направления, был проведен второй эксперимент: два новых набора данных были созданы, каждый содержащий шестьдесят синтетических часов с только часовой рукой, указывающей на разную минутную метку. Один набор использовал оригинальный дизайн руки, а другой – измененный. Модель была попросена назвать метку, на которую указывала рука.

Результаты показали небольшое снижение точности с измененными руками, но не достаточно, чтобы объяснить более широкие неудачи модели. Один незнакомый визуальный признак казался способным нарушить общую интерпретацию модели, даже в задачах, которые она ранее выполняла хорошо.

Обзор производительности GPT-4.1 до и после тонкой настройки на стандартных, искаженных и измененных часах, подчеркивающий неравномерные выгоды и постоянные слабости.

Заключение

Хотя фокус статьи может показаться тривиальным на первый взгляд, он не особенно важен, если модели зрения-языка когда-либо научатся читать аналоговые часы с 100% точностью. Что придает работе вес – это ее фокус на более глубоком повторяющемся вопросе: может ли насыщение моделей большим (и более разнообразным) данными привести к тому же виду понимания области, которое люди приобретают через абстракцию и обобщение; или же единственно жизнеспособный путь – это наводнение области достаточно примеров, чтобы предвидеть каждую вероятную вариацию на вывод.

Любой из этих путей вызывает сомнения в том, что текущие архитектуры действительно способны выучить.

Опубликовано впервые в понедельник, 19 мая 2025