Взгляд Anderson

ИИ предпочитает читать книгу, чем смотреть фильм

Это удивительно трудно заставить модели ИИ смотреть и комментировать фактическое видеоконтент, даже если они предназначены для этой задачи. Они больше интересуются письменным словом.

Если вы когда-либо пытались загрузить небольшой видеоклип в ChatGPT или в подобную популярную модель зрения/языка, вы могли быть удивлены, осознав, что они не могут фактически проанализировать видео. Хотя модели, такие как ChatGPT-4o+, способны анализировать отдельные кадры – в виде изображений, таких как JPEG и PNG – они предпочитают, чтобы пользователь извлекал свои собственные кадры и загружал их в виде изображений (которые они готовы прокомментировать).

В случае серии OpenAI GPT один может, довольно утомительно, извлечь полный набор кадров из видеоклипа и подать их в ChatGPT, для целей, например, генерации нарративной дорожки, созданной ИИ, для видео:

![Изображения и код из учебника OpenAI по парсингу нескольких извлеченных кадров для разработки комментариев ИИ для видеоклипа. [ Источник ] https://cookbook.openai.com/examples/gpt_with_vision_for_video_understanding](https://www.unite.ai/wp-content/uploads/2025/10/openai-gpt-frame-parsing.jpg)

Изображения и код из учебника OpenAI по парсингу нескольких извлеченных кадров для разработки комментариев ИИ для видеоклипа. Источник

Но пользователям приходится делать конвертацию из видео в кадры, либо путем вызова функций в более крупной программе, как в примере выше, либо извлекая кадры с помощью FFMPEG или различных бесплатных и платных решений для редактирования видео.

В определенной степени, возможно, даже в большой степени, ограничения на анализ видео в крупномасштабных продуктах, таких как ChatGPT, зависят от использования ресурсов: просто оснащение одного экземпляра ИИ выбором наиболее популярных видеокодеков и выделение вычислительных ресурсов для диско-интенсивного и CPU-затратного процесса извлечения – это не незначительное соображение, если сотни миллионов пользователей решат начать использовать эти возможности каждый день.

Кроме того, временный анализ может нарисовать совершенно другую картину, чем один кадр (представьте, что кто-то входит в дом в хорошем настроении и затем обнаруживает тело); поэтому рассмотрение всей временной «контрольной суммы» даже короткого видеоклипа – это требовательная и ресурсоемкая задача – а также специализированная область исследовательской литературы, например, с продолжающимся развитием таких рамок, как Оптический поток – который по сути «разворачивает» длину видео, чтобы оно могло быть рассмотрено и обработано как статический документ:

![Диаграммы оптического потока подчеркивают, как движение отслеживается через кадры в видеопоследовательности, с зелеными векторами, показывающими направление и интенсивность движения. Эти сопоставления обеспечивают временную непрерывность, необходимую для VLM, и также могут служить структурными руководствами в рабочих процессах VFX. [ Источник ] https://www.researchgate.net/figure/Optical-flow-field-vectors-shown-as-green-vectors-with-red-end-points-before-and-after_fig6_290181771](https://www.unite.ai/wp-content/uploads/2025/10/optical-flow.jpg)

Диаграммы оптического потока подчеркивают, как движение отслеживается через кадры в видеопоследовательности, с зелеными векторами, показывающими направление и интенсивность движения. Эти сопоставления обеспечивают временную непрерывность, необходимую для VLM, и также могут служить структурными руководствами в рабочих процессах VFX. Источник

Удовлетворение кратким изложением

Тем не менее, поскольку модели, такие как Notebook LM от Google и более недавние записи ChatGPT, способны читать связанные метаданные (т.е. встроенный текстовый контент, который контекстуализирует видео каким-либо образом), они не запрещают загрузку видеофайлов; и иногда они даже будут пытаться интерпретировать видео, которое не имеет таких данных.

В следующем случае я загрузил 6-секундный случайный клип из итальянского фильма Рука Бога (2021) в NotebookLM, обеспечив, чтобы клип содержал нулевую полезную текстовую информацию, либо в метаданных, либо в имени файла.

NotebookLM затем продолжил сложно фантазировать материал, совершенно не связанный с видео*, вместе с бессмысленным и несвязанным 5-минутным подкастом:

Обычный момент в 6-секундном клипе из итальянского фильма совершенно неправильно интерпретируется NotebookLM. Источник: Google NotebookLM

Хотя Notebook, как и ChatGPT, может принять видео с YouTube в качестве входных данных, он будет делать это только в том случае, если видео имеет интерпретируемый текстовый слой аннотаций и/или субтитров (не растр-субтитров, которые встроены в видео).

В этом смысле тяжелая работа фактического просмотра содержимого видео и выполнения семантической интерпретации (юридическая необходимость для YouTube, из-за его защитных мер авторских прав, и его будущей системы защиты личности), была выполнена после загрузки пользователя, когда и когда клип мог быть выделен необходимым ресурсам.

Фактическая интерпретация видео дорога и изнурительна, и, как оказалось, даже модели, которые были обучены специально для выполнения этой задачи, предпочитают читать текст, чем фактически смотреть видео.

TL;DW

Это, согласно новой статье из Университета Бристоля в Великобритании, озаглавленной Видео не стоит тысячи слов, где два автора приходят к выводу, что текущие модели зрения и языка (VLM) – модели, предназначенные для анализа видео более усердным образом, и для участия в вопросах и ответах на видео (VQA) – также отдают предпочтение текстовой информации, когда только могут.

Когда им предоставлялись движущиеся изображения и письменные вопросы и варианты ответов, авторы статьи обнаружили, что модели обычно основывали свои выборы на закономерностях в тексте, а не на чем-либо, происходящем на экране – во многих случаях выполняя столь же хорошо, даже когда вопрос был полностью удален.

В том, что кажется привычной формой обхода или жульничества, то, что имело значение для большинства моделей, было возможность обнаружить закономерности в возможных ответах; только когда задача была сделана более сложной, путем добавления большего количества вариантов ответов, ИИ начали обращать больше внимания на видео.

Авторы провели тесты VQA в различных условиях для шести моделей VLM разнообразных длин контекста, на четырех подходящих наборах данных; и обнаружили, что результаты указывают на зависимость моделей от текста над видеоконтентом.

![Пример из исследования, показывающий, как модель анализа видео взвешивает то, что она видит, по сравнению с тем, что она читает. Клип показывает человека, плетущего бамбук, но модель присваивает гораздо больше важности письменному вопросу и тексту ответа, чем самим кадрам видео. Синие выделения отмечают элементы, поддерживающие выбранный ответ, в то время как красные выделения отмечают те, которые тянут его в противоположную сторону, иллюстрируя, как рассуждение модели центрируется на словах, а не на движущихся изображениях. [ Источник ] https://arxiv.org/pdf/2510.23253](https://www.unite.ai/wp-content/uploads/2025/10/evaluation.jpg)

Пример из исследования, показывающий, как модель анализа видео взвешивает то, что она видит, по сравнению с тем, что она читает. Клип показывает человека, плетущего бамбук, но модель присваивает гораздо больше важности письменному вопросу и тексту ответа, чем самим кадрам видео. Синие выделения отмечают элементы, поддерживающие выбранный ответ, в то время как красные выделения отмечают те, которые тянут его в противоположную сторону, иллюстрируя, как рассуждение модели центрируется на словах, а не на движущихся изображениях. Источник

Метод

Чтобы понять, как каждая часть входных данных способствует решению модели, новая работа использует метод из теории игр, называемый Шапли-значениями. Первоначально разработанный для справедливого раздела выплаты между игроками в коалиции, Шапли-значения присваивают кредит каждому «игроку» на основе его индивидуального влияния.

По сути, игроки в этом сценарии являются либо кадрами видео, либо текстовыми компонентами (аннотациями, субтитрами, подписями и т. д.) задачи VQA; и «выплата» – это окончательный ответ модели. Систематически тестируя, что происходит, когда каждая часть добавляется или удаляется, метод раскрывает, насколько важен этот элемент для получения выбранного ответа.

В случае новой работы Шапли-значения были адаптированы для обработки смешанных модальностей, с видео- и текстовыми компонентами, рассматриваемыми отдельно, и их различным влиянием на выходные данные моделей измерены, раскрывая, интерпретируется ли видеоконтент действительно или используются письменные подсказки в качестве обхода.

Метрики

Две простые метрики были определены для сравнения того, как каждая модальность (т.е. видео, вопрос или ответ) способствует решению модели: Вклад модальности измеряет, какая часть общего объяснения поступает от каждого типа входных данных; здесь все доступные Шапли-значения суммируются, и доля, принадлежащая каждой модальности, рассчитывается как процент от общего.

Во-вторых, Вклад на особенность исправляет тот факт, что некоторые модальности, такие как видео, содержат гораздо больше особенностей, чем другие. Вместо этого рассчитывается среднее Шапли-значение для каждой особенности, и эти средние значения сравниваются, чтобы определить, какая модальность имеет доминирующее влияние.

Данные и тесты

Авторы протестировали подход на шести моделях VLM с различными характеристиками, предназначенными для обеспечения того, чтобы принципы тестов были широко применимы и обобщаемы. Следовательно, модели были выбраны для разных длин контекста, разных возрастов (т.е. как долго с момента выпуска фреймворка) и разных конфигураций архитектуры.

Участниками стали FrozenBiLM; InternVideo; VideoLLaMA2; VideoLLaMA3; LLaVa-Video (который использует Qwen2); и LongVA (также использующий Qwen2).

С той же целью разнообразия четыре целевых набора данных были выбраны EgoSchema, набор данных VQA, предназначенный для того, чтобы быть невозможным для завершения без полного просмотра связанных видео; HD-EPIC, набор данных, ориентированный на кухню, в котором есть некоторые необычно длинные видео; MVBench, отобранный набор вкладов из других наборов данных; и LVBench, который задает вопросы VQA для очень длинных видео.

Из них авторы разработали 60 вопросов – по 10 из каждого типа вопросов.

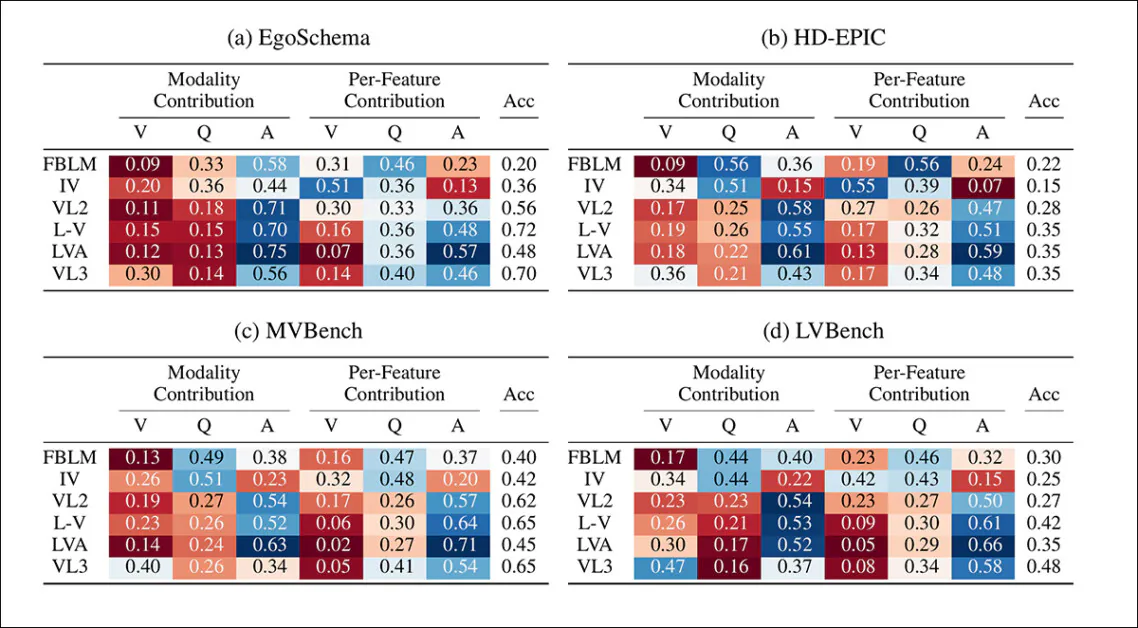

Метрики вклада показали, что большинство моделей полагались меньше на видео, чем на текст, особенно когда судили кадр за кадром. Даже когда видео показывало разумное выступление в общем вкладе, его вклад на особенность часто был минимальным, что предполагает, что хотя модель могла использовать видео в совокупности, она обращала мало внимания на отдельные кадры. VideoLLaMA3 был основным исключением здесь, с более сильной визуальной зависимостью, особенно на более длинных последовательностях в LVBench:

Оценки вклада модальности (MC) и вклада на особенность (PFC) по моделям и наборам данных, показывающие относительный вес видео (V), вопроса (Q) и ответа (A) входных данных. Более холодные цвета указывают на более сильные вклады; более теплые цвета указывают на более слабые или незначительные влияния. Во всех настройках язык явно доминирует, а видео часто отодвигается на второй план – особенно в влиянии на кадр.

Что касается текста, вопрос, как правило, имел больше значения, чем ответ, особенно в более сильных моделях. Это было наиболее очевидно в наборах данных, таких как EgoSchema, где вопросы были длиннее и более естественными, а ответы были короткими и иногда схематичными. MVBench несколько изменил это, поскольку его бинарная структура ответа увеличила кажущееся значение токенов ответа.

Во всех моделях и наборах данных, однако, зрение постоянно отодвигалось на второй план, а язык выполнял большую часть тяжелой работы.

В статье говорится:

‘[Для] моделей с длинным контекстом видео показывает значительно уменьшенные вклады, что означает, что на кадр Шапли-значения гораздо меньше, чем их текстовые аналоги.

‘Видео как целая модальность все еще явно очень актуальна, но это доказывает, что Шапли-значения его отдельных кадров более сосредоточены вокруг нуля, и что внимание модели к ним гораздо менее направлено, чем к тексту.’

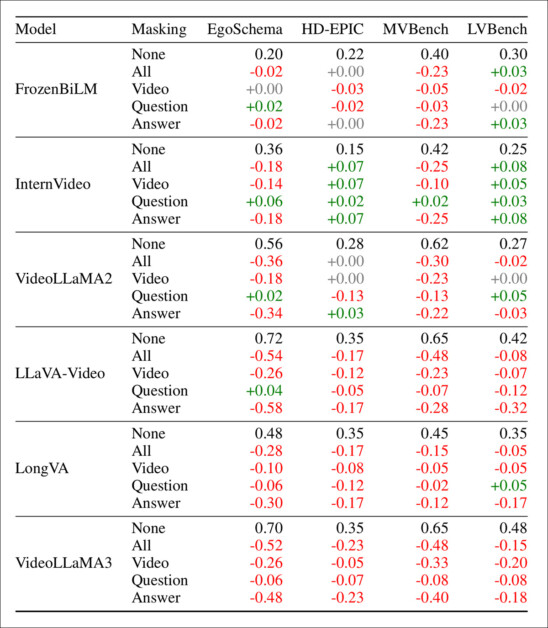

Чтобы протестировать, как каждая часть входных данных способствует точности модели, исследователи провели дополнительные тесты с использованием маскирования – намеренного сокрытия одной или нескольких частей входных данных и наблюдения за тем, насколько меняется точность модели в результате.

Если производительность резко падает при удалении определенного входного данных, этот входной данных, вероятно, важен; если модель работает примерно одинаково, это предполагает, что отсутствующая часть не была сильно использована. В этом смысле тесты маскирования являются своего рода итеративным исследованием абляции.

Влияние маскирования видео, вопроса или ответа входных данных на четыре эталонные задачи VQA. Оценки показывают изменение от базовой модели. Красный цвет означает более низкую точность, зеленый – более высокую. Модели часто сохраняли высокие оценки без видео, но теряли больше, когда ответ (текст) был удален. Вопрос обычно мог быть маскирован с минимальным эффектом.

Результаты (показанные выше) указывают на то, что ответы (текстовые ответы в данных с несколькими вариантами) имеют наибольший вес во всех отношениях. Маскирование ответа обычно вызывало самое большое падение точности, часто снижая модели до почти случайной производительности.

Однако маскирование вопроса обычно имело гораздо меньший эффект, что подтверждает предыдущий вывод о том, что модели недооценивают вопрос.

В некоторых случаях точность даже улучшалась когда вопрос был удален, что предполагает, что модели иногда просто сопоставляли ответы с текстовыми или визуальными подсказками, а не правильно оценивали вопрос.

Модели также различались в своей зависимости от видео: некоторые сохраняли разумную точность без него, что еще больше подтверждает ограниченный вклад видео-особенностей во многих текущих настройках.

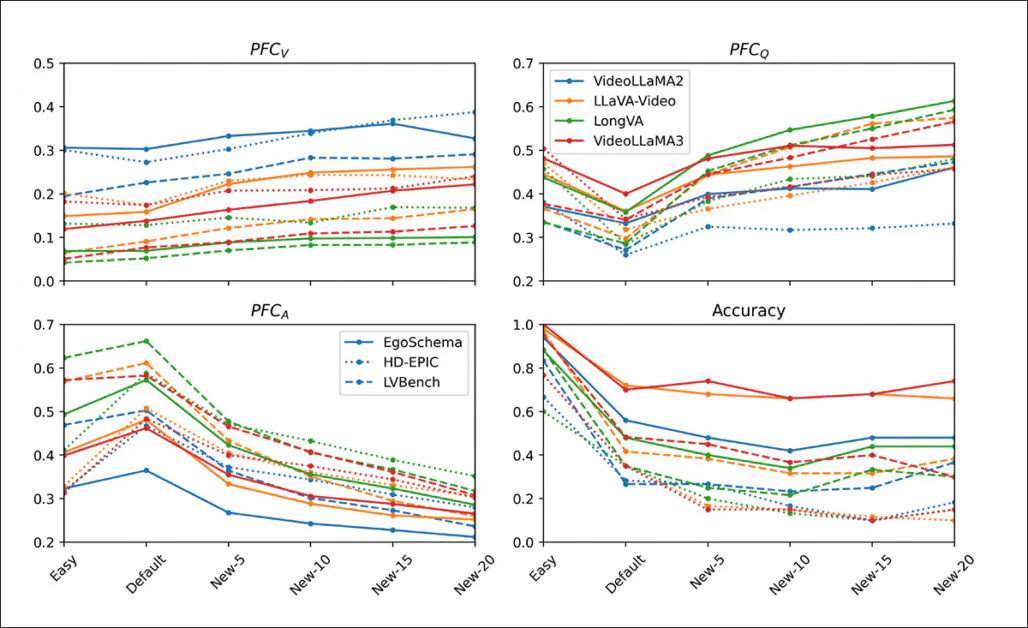

Авторы затем протестировали, могут ли модели быть вынуждены полагаться на видео, добавив дополнительные неправильные ответы к вариантам ответов.

Когда отвлекающие факторы были легкими и переработаны из других вопросов, производительность улучшилась, поскольку модели сопоставляли текстовые закономерности без большого рассуждения. Но с десятью или более несвязанными ответами они начали больше полагаться на видео и вопрос:

Вклад на особенность и точность для видео, вопроса и ответа входных данных, когда добавляются дополнительные неправильные ответы к каждой задаче VQA, показывая, что увеличение количества отвлекающих факторов снижает доминирование текста и повышает относительное влияние визуальных и вопросных особенностей.

Для VideoLLaMA3 маскирование видео снизило точность на 40% на EgoSchema и на 15% на LVBench, что указывает на то, что простое увеличение количества ответов может сдвинуть модели от текстовых обходов к настоящему многомодальному рассуждению.

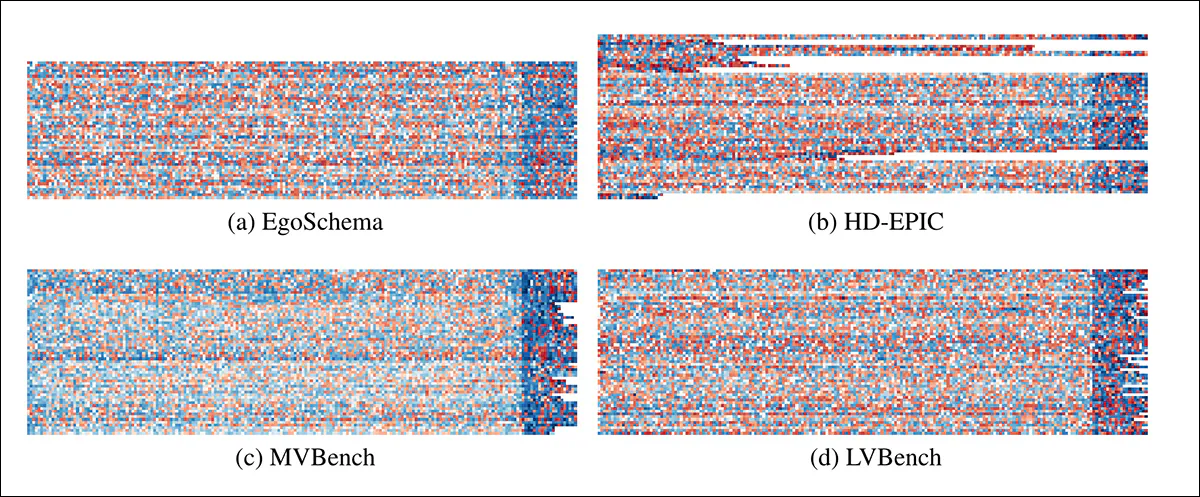

Исследователи также изучили, как атрибуция распределяется по входным данным, и ниже мы видим тепловые карты Шапли-значений для каждого входного данных модели:

Тепловые карты Шапли-значений для четырех наборов данных, где каждая строка показывает одну задачу VQA, а каждый столбец – одну особенность. Видео-особенности появляются слева, за которыми следует текст. Гораздо более сильные значения в текстовых регионах (красный цвет) подтверждают, что модели полагаются гораздо больше на язык, чем на видео.

Комментируя результаты выше, авторы заявляют:

‘Величина Шапли-значений гораздо больше в правой части каждой тепловой карты, представляющей вопросные и ответные атрибуции. Эта резкая граница – это место, где видеокадры заканчиваются, а текстовые особенности начинаются, демонстрируя, что вклад видеомодальности гораздо меньше, чем вопрос/ответ. ‘

В итоге, во всех наборах данных значения гораздо сильнее в текстовой части спектра, что явно указывает на то, что модели полагаются гораздо больше на язык, чем на визуальные подсказки. Даже когда видео используется, вклад распределен тонко по многим кадрам, часто без какой-либо последовательной закономерности.

Ниже мы видим аннотированный пример из EgoSchema. 16 наиболее «важных» кадров были выбраны с помощью Шапли-значений и окрашены в соответствии с их влиянием, с синим цветом, указывающим на положительный вклад, и красным – на отрицательный:

Атрибуции Шапли для одного примера EgoSchema, показывающие 16 наиболее влиятельных кадров и все текстовые входные данные. Видеовклады минимальны по сравнению с текстом, который доминирует в рассуждениях модели. Синий и красный цвета указывают на положительное и отрицательное влияние на выбранный ответ.

Заключение

Кто угодно, кто когда-либо занимался редактированием видео или анализом видео, уже знает, насколько эти процессы требовательны к ресурсам, и понимает, почему компании, обрабатывающие миллионы запросов ИИ в день, не могут позволить себе беззаботно разрешать пользователям выполнять ад хок редактирование и интерпретацию видео.

Одна вещь, которую следует помнить в этом отношении, заключается в том, что почти каждый API-интерфейс ИИ, который вы когда-либо попробуете (за исключением, возможно, совершенно нового и недолговечного демо в поддержку новой научной работы), стремится выполнить желания пользователей на минимальном возможном уровне расхода ресурсов.

Это означает полагаться на существующие метаданные из пользовательских данных или RAG-запросы, если это возможно; и извлекать (если абсолютно необходимо) метаданные для более парсируемых форматов, таких как PDF, документы и отдельные изображения.

То, что не находится на столе, – это запуск вашего загруженного видео через CLIP или последний YOLO-релиз, или через любую энергоемкую и трудоемкую VLM, которая может фактически определить, что находится в кадрах, и понять, что происходит в предоставленном видео, учитывая временность.

Однако это не означает, что явления, которые документируются в текущей статье, обязательно следуют из скупых архитектурных подходов. Авторы отмечают, что текст доминирует в современных многомодальных парадигмах обучения в любом случае, что указывает на то, что «визуальный язык» либо менее развит, либо менее важен или информативен в многомодальном контексте, либо (по крайней мере, на данный момент) менее хорошо понят.

* Интересно, что материал, который NotebookLM придумал, кажется либо полностью оригинальным, либо совершенно неиндексированным Google, поскольку я не смог найти никаких веб-результатов, которые могли бы проникнуть в обучающие данные и спровоцировать этот вывод.

Опубликовано впервые в пятницу, 31 октября 2025 года; отредактировано 14:20 для форматирования