Искусственный интеллект

Матирование изображений AI, которое понимает сцены

В дополнительном документальном фильме, сопровождающем выпуск DVD 2003 г. Alien3 (1992), легенда визуальных эффектов Ричард Эдлунд с ужасом вспоминал «борьбу сумо» фотохимического извлечения масок, которая доминировала в работе над визуальными эффектами между поздние 1930s и в конце 1980-х годов. Эдлунд описал этот процесс, основанный на пробах и промахах, как «борьбу сумо», в сравнении с цифровыми технологиями синего и зеленого экранов, которые стали популярными в начале 1990-х годов (и он возвращенный к метафоре так).

Извлечение элемента переднего плана (например, человека или модели космического корабля) из фона, чтобы вырезанное изображение можно было скомпоновать в фоновую пластину, первоначально было достигнуто путем съемки объекта переднего плана на однородном синем или зеленом фоне.

Трудоемкие процессы фотохимической экстракции для визуальных эффектов, снятых ILM для фильма «Возвращение джедая» (1983). Источник: https://www.youtube.com/watch?v=qwMLOjqPmbQ

В полученном кадре цвет фона впоследствии будет химически выделен и использован в качестве шаблона для повторной печати объекта переднего плана (или человека) в кадре. оптический принтер как «плавающий» объект в прозрачной пленочной ячейке.

Этот процесс был известен как наложение цветоделения (CSO), хотя этот термин в конечном итоге стал больше ассоциироваться с грубым «Хромакей» видеоэффекты в малобюджетных телевизионных продуктах 1970-х и 1980-х годов, которые были достигнуты с помощью аналоговых, а не химических или цифровых средств.

Демонстрация наложения цветоделения в 1970 году для британского детского шоу «Голубой Питер». Источник: https://www.bbc.co.uk/archive/blue_peter_noakes_CSO/zwb9vwx

В любом случае, будь то элементы фильма или видео, после этого извлеченные кадры могут быть вставлены в любые другие кадры.

Хотя Disney заметно более дорогой и запатентованный процесс с парами натрия (который, в частности, нажимал на желтый, а также был использовал для фильма ужасов Альфреда Хичкока 1963 года Птицы) давали лучшее разрешение и более четкие матовые изображения, фотохимическая экстракция оставалась кропотливой и ненадежной.

Запатентованный процесс экстракции паров натрия компанией Disney требовал фонов, близких к жёлтому концу спектра. Здесь Анджела Лэнсбери висит на тросах во время съёмок сцены с визуальными эффектами для фильма «Набалдашники и метлы» (1971). Источник

Помимо цифрового матирования

В 1990-х цифровая революция избавила от химикатов, но не от зеленых экранов. Теперь можно было удалить зеленый (или любой другой цвет) фон, просто выполнив поиск пикселей в пределах допустимого диапазона этого цвета, в программном обеспечении для редактирования пикселей, таком как Photoshop, и в новом поколении наборов видеокомпозитинга, которые могли автоматически отключать цветные фоны. Почти ночь, шестьдесят лет отрасли оптической печати ушли в историю.

Последние десять лет исследований в области компьютерного зрения с ускорением на графическом процессоре открывают третью эпоху извлечения матовых изображений, ставя перед исследователями задачу разработки систем, которые могут извлекать высококачественные матовые изображения без необходимости использования зеленых экранов. Только в Arxiv еженедельно публикуются статьи, посвященные инновациям в области извлечения переднего плана на основе машинного обучения.

Поместите нас в картину

Этот очаг академического и отраслевого интереса к извлечению ИИ уже повлиял на потребительское пространство: грубые, но работоспособные реализации знакомы всем нам в виде Zoom и Skype фильтры, которые могут заменить фон нашей гостиной тропическими островами и т. д. во время видеоконференций.

Тем не менее, лучшие матовые по-прежнему требуют зеленого экрана, так как Зум отметил в прошлую среду.

Слева: мужчина на фоне зелёного экрана, волосы которого были качественно извлечены с помощью функции виртуального фона Zoom. Справа: женщина на фоне обычной домашней сцены, волосы которой были извлечены алгоритмически, менее точно и с более высокими вычислительными требованиями. Источник: https://support.zoom.us/hc/en-us/articles/210707503-Changing-your-Virtual-Background-image.

A дальнейший пост с платформы поддержки Zoom предупреждает, что извлечение изображений, отличных от зеленого экрана, также требует большей вычислительной мощности устройства захвата.

Необходимость вырезать это

Улучшения в качестве, портативности и экономии ресурсов для систем извлечения мате «в дикой природе» (т. е. изоляция людей без необходимости использования зеленых экранов) актуальны для многих других секторов и сфер деятельности, а не только для фильтров видеоконференций.

При разработке наборов данных улучшенное распознавание лиц, головы и всего тела позволяет гарантировать, что посторонние фоновые элементы не будут обучаться в моделях компьютерного зрения людей; более точная изоляция значительно улучшит семантическая сегментация методы, предназначенные для различения и ассимиляции доменов (т.е. 'кошка', 'человек', 'лодка'), и улучшить VAE и трансформатороснованные на системах синтеза изображений, такие как новая система OpenAI ДАЛЛ-Э 2; а лучшие алгоритмы извлечения сократят потребность в дорогостоящем ручном ротоскопирования в дорогостоящих конвейерах VFX.

Фактически господство мультимодальные Методологии (обычно текст/изображение), в которых домен, например, «кошка», кодируется как изображение, так и связанные с ним текстовые ссылки, уже проникают в обработку изображений. Один из недавних примеров — Text2Live архитектура, которая использует мультимодальное (текст/изображение) обучение для создания видеороликов, среди множества других возможностей, хрустальные лебеди и стеклянные жирафы.

AI-матирование с учетом сцены

Большое количество исследований автоматического матирования на основе ИИ было сосредоточено на распознавании границ и оценке группировок на основе пикселей внутри изображения или видеокадра. Тем не менее, новое исследование из Китая предлагает конвейер экстракции, который улучшает оконтуривание и качество мата за счет использования текстовые описания сцены (мультимодальный подход, который набрал обороты в секторе исследований компьютерного зрения за последние 3-4 года), утверждая, что он улучшил предыдущие методы во многих отношениях.

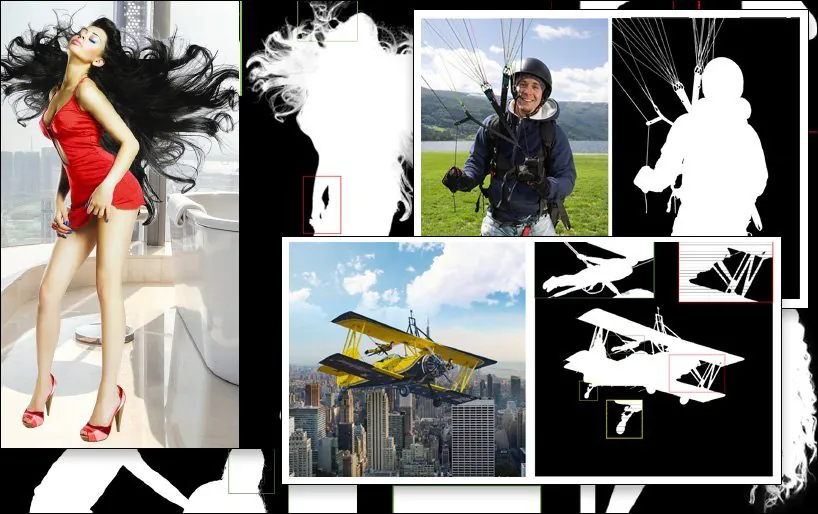

Пример извлечения SPG-IM (последнее изображение внизу справа) по сравнению с конкурирующими предыдущими методами. Источник: https://arxiv.org/pdf/2204.09276.pdf

Задача, стоящая перед подсектором исследований извлечения, состоит в том, чтобы создать рабочие процессы, требующие минимального количества ручных аннотаций и вмешательства человека, а в идеале — никакого. Помимо финансовых последствий, исследователи новой статьи отмечают, что аннотации и ручная сегментация, выполняемая аутсорсинговыми краудворкерами в разных культурах, могут привести к тому, что изображения будут помечены или даже сегментированы по-разному, что приведет к непоследовательным и неудовлетворительным алгоритмам.

Одним из примеров этого является субъективная интерпретация того, что определяет «объект переднего плана»:

Из новой статьи: предыдущие методы ЛЧМ и МОДнет («GT» означает Ground Truth, «идеальный» результат, часто достигаемый вручную или неалгоритмическими методами), имеют разные и в разной степени эффективные подходы к определению содержимого переднего плана, тогда как новый метод SPG-IM более эффективно определяет «ближнее содержимое» через контекст сцены.

Чтобы решить эту проблему, исследователи разработали двухэтапный конвейер под названием Матирование изображений, управляемое ситуационным восприятием (СПГ-ИМ). Двухступенчатая архитектура кодера/декодера включает в себя ситуационную дистилляцию восприятия (SPD) и ситуационное восприятие, управляемое матированием (SPGM).

Во-первых, SPD предварительно обучает преобразование визуальных функций в текстовые, создавая подписи, соответствующие связанным с ними изображениям. После этого прогнозирование маски переднего плана включается путем подключения конвейера к новому предсказание значимости техника.

Затем SPGM выводит оценочную альфа-маску на основе входного необработанного изображения RGB и сгенерированной маски, полученной в первом модуле.

Целью является руководство по ситуационному восприятию, при котором система имеет контекстуальное понимание того, из чего состоит изображение, что позволяет ей ставить, например, задачу извлечения сложных волос из фона на фоне известных характеристик такой конкретной задачи.

В примере ниже SPG-IM распознаёт, что шнуры являются неотъемлемой частью «парашюта», тогда как MODNet не может сохранить и определить эти детали. Аналогично, полная структура игровой площадки произвольно теряется в MODNet.

Новый статье называется Матирование изображений, управляемое ситуационным восприятием, и исходит от исследователей из Исследовательского института OPPO, PicUp.ai и Xmotors.

Интеллектуальные автоматические маты

SPG-IM также предлагает сеть уточнения адаптивного фокального преобразования (AFT), которая может обрабатывать локальные детали и глобальный контекст по отдельности, способствуя созданию «интеллектуальных масок».

Понимание контекста сцены (в данном случае «девушка с лошадью») может потенциально облегчить извлечение переднего плана по сравнению с предыдущими методами.

В документе говорится:

«Мы считаем, что визуальные репрезентации задачи преобразования визуального в текст, например, «При создании подписей к изображениям необходимо сосредоточиться на более семантически содержательных сигналах между а) объектом и б) объектом и окружающей средой для создания описаний, охватывающих как глобальную информацию, так и локальные детали. Кроме того, по сравнению с дорогостоящим пиксельным аннотированием при матировании изображений, текстовые метки можно собирать в больших объемах при очень низких затратах».

Архитектурное отделение SPD проходит предварительную подготовку совместно с Мичиганским университетом ВирТекс текстовый декодер на основе преобразователя, который изучает визуальные представления из семантически плотных заголовков.

VirTex совместно обучает ConvNet и Transformers с помощью куплетов с подписями к изображениям и передает полученную информацию последующим задачам технического зрения, таким как обнаружение объектов. Источник: https://arxiv.org/pdf/2006.06666.pdf

Среди других тестов и исследований абляции исследователи протестировали SPG-IM в сравнении с современными тримапна основе методов Deep Image Matting (ОТСУТСТВУЕТ), Индекснет, Контекстно-зависимое матирование изображения (CAM), Управляемое контекстное внимание (GCA) FBAи семантическое отображение изображений (SIM).

Другие проверенные ранее фреймворки включали подходы без использования тримапов. ЛЧМ, HAttматирование и МОДнетДля объективного сравнения методы тестирования были адаптированы на основе различных методологий; в случаях, когда код был недоступен, методы, описанные в статье, были воспроизведены на основе описанной архитектуры.

В новом документе говорится:

«Наша модель SPG-IM значительно превосходит все конкурирующие методы без использования тримапа ([LFM], [HAttMatting] и [MODNet]). Кроме того, наша модель также демонстрирует значительное превосходство над современными методами на основе тримапа и масок (SOTA) по всем четырём показателям в общедоступных наборах данных (Composition-1K, Distinction-646 и Human-2K), а также в нашем бенчмарке Multi-Object-1K».

И продолжает:

«Очевидно, что наш метод сохраняет мелкие детали (например, кончики волос, прозрачные текстуры и границы) без использования тримапа. Более того, по сравнению с другими конкурирующими моделями без тримапа, наш SPG-IM может лучше сохранять глобальную семантическую полноту».

Впервые опубликовано 24 апреля 2022 г.