Взгляд Anderson

AI Может Угадать Год Фотографии По Возрасту Людей

Новое исследование показывает, что ИИ может использовать лица людей, чтобы оценить год, когда была сделана фотография, сочетая предположения о возрасте с известными годами рождения, чтобы превзойти текущие методы, основанные на сцене.

Угадывание даты фотографии раньше было намного проще, чем сейчас, потому что мода на волосы и одежду раньше развивалась с бешеной скоростью. По много обсуждаемым причинам, этот вихрь визуального стиля закончился около тридцати лет назад, что означает, что теперь уже не так легко посмотреть на прическу или предметы одежды и угадать год по этому типу визуальной подсказки.

В течение некоторого времени было возможно также датировать изображения и фильмы на основе цвета и характеристик зерна пленки. Не нужно было быть судебным экспертом; если вы смотрели достаточно старых фильмов, культурные подсказки (такие как музыка, машины, мода, темы и т. д.) в конечном итоге стали бы ассоциироваться у зрителя с стилями пленки:

![Иллюстрация того, как улучшения в пленке постепенно расширили диапазон тонов кожи и стилей освещения с течением времени, переходя от плоских, фронтальных установок к более натуральным и разнообразным видам. [ Источник ] https://archive.is/3ZSjN (моя собственная статья)](https://www.unite.ai/wp-content/uploads/2025/11/grain-styles.jpg)

Иллюстрация того, как улучшения в пленке постепенно расширили диапазон тонов кожи и стилей освещения с течением времени, переходя от плоских, фронтальных установок к более натуральным и разнообразным видам. Источник (моя собственная статья)

Дополнительная “якорь” для датирования фотографии была то, что она была в черно-белом – экономия, которая стала излишней после популяризации цифровой фотографии в начале этого века

Несколько коммерческих и экспериментальных систем, таких как MyHeritage, поставляемый с PhotoDater, пытаются датировать фотографии, используя эти и различные другие критерии.

![Пример оценки возраста фотографии из сервиса MyHeritage PhotoDater. Источник [ https://www.youtube.com/watch?v=2oVyLI6tBcY ]](https://www.unite.ai/wp-content/uploads/2025/11/photodater.jpg)

Пример оценки возраста фотографии из сервиса MyHeritage PhotoDater. Источник

Отсутствие других подсказок, таких как смартфоны или другая технология, специфичная для эпохи, лучший способ определить возраст фотографии, сделанной за последние 15-25 лет, заключается в том, что вы знакомы с человеком (т. е. знаменитостью или, возможно, знакомым), и можете оценить его возраст, что дает приблизительный эквивалент года.

Лицо как ссылка

В области компьютерного зрения и в различных других областях (т. е. судебной экспертизы, архивной обработки, журналистики, архитектуры набора данных и т. д.) возможность определения возраста фотографии является ценной целью, поскольку многие из наиболее интересных цифровых и аналоговых коллекций не имеют надлежащей аннотации и метаданных или даже имеют неправильные метаданные из предыдущих (неправильных) предположений.

Следовательно, было бы полезно, если бы система ИИ могла просмотреть фотографии так же, как мы делаем, когда оглядываемся назад на наши исторические коллекции, и комментируем ‘О, да, это было, когда…’. Вопрос в том, что могло бы быть крючком, отсутствием обычных необходимых подсказок?

Новая исследовательская работа из Чехии предлагает первоначальную опору в этом подходе, используя системы ИИ, основанные на распознавании возраста, в сочетании с лицевым распознаванием, связанным с общей базой данных идентификаторов (в данном случае, коллекцией, подобной IMDB, с чешскими исполнителями и кинематографистами):

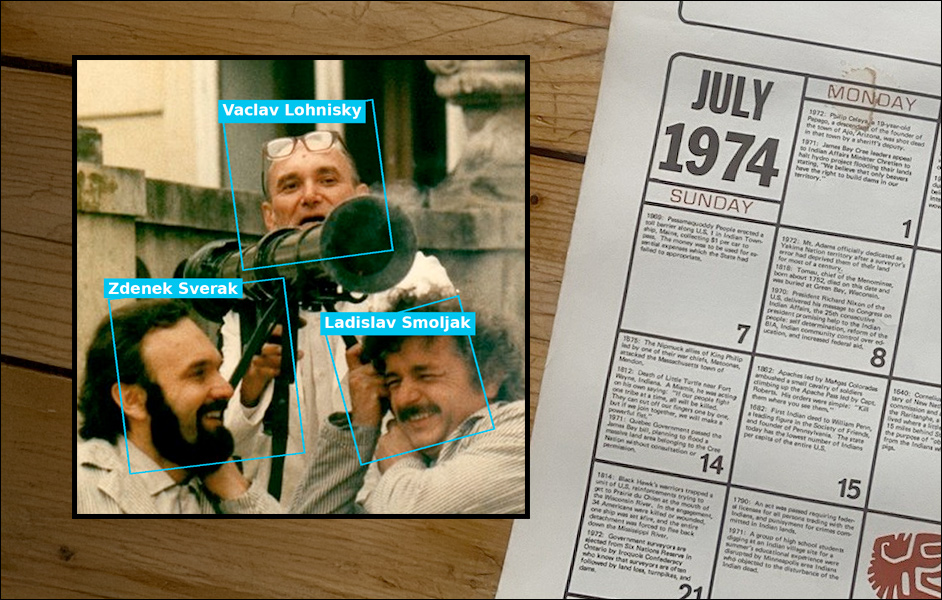

![Кадр из фильма 'Joachim, Put It in the Machine' (1974), использованный для иллюстрации процесса датирования. Модель обнаруживает известных людей в фотографии, оценивает их возраст, используя оценщик возраста лица (правый столбец), и вычитает это значение из года рождения каждого человека, чтобы сгенерировать вероятностное распределение возможных дат фотографии. Графики показывают вероятность каждой оценки возраста, с пунктирными линиями, отмечающими истинный возраст человека на момент фотографии. [ Источник ] https://arxiv.org/pdf/2511.05464](https://www.unite.ai/wp-content/uploads/2025/11/fig-1a-and-1b.jpg)

Кадр из фильма ‘Joachim, Put It in the Machine’ (1974), использованный для иллюстрации процесса датирования. Модель обнаруживает известных людей в фотографии, оценивает их возраст, используя оценщик возраста лица (правый столбец), и вычитает это значение из года рождения каждого человека, чтобы сгенерировать вероятностное распределение возможных дат фотографии. Графики показывают вероятность каждой оценки возраста, с пунктирными линиями, отмечающими истинный возраст человека на момент фотографии. Источник

Система работает, обнаруживая известных людей в фотографии, оценивая их возраст лица, используя предварительно обученную модель, и вычитая эту оценку из их задокументированного года рождения, чтобы сгенерировать вероятные даты для фотографии. Когда на фотографии присутствуют несколько лиц, оценки дат объединяются, чтобы произвести окончательный прогноз.

Метод был протестирован на изображениях, отобранных из Чехословацкой кинобазы данных (CSFD), и в результате полученный подход, по утверждению авторов, предлагает последовательно лучшую точность, чем модели, основанные на сцене (статические модели, которые полагаются на фоновые элементы или визуальный контекст, а не на лица), обученные на тех же данных.

Схема этого метода требует центральной базы данных, содержащей знания о широкой группе людей, в данном случае IMDB-стиль чешской кинобазы данных; но любая подобная коллекция, в которой есть подтвержденные даты рождения и центральные даты-подтвержденные события, могла бы дать подобный результат.

В статье говорится:

‘Уникально, наша база данных предоставляет аннотации для нескольких людей в одном изображении, что позволяет изучать агрегацию информации из нескольких лиц. Мы предлагаем вероятностную структуру, которая формально объединяет визуальные доказательства из современных моделей распознавания лиц и оценки возраста, и временные приоры, основанные на карьере, чтобы сделать вывод о годе захвата фотографии.

‘Наши эксперименты демонстрируют, что агрегация доказательств из нескольких лиц последовательно улучшает производительность, и подход значительно превосходит сильные, основанные на сцене, базовые модели, особенно для изображений, содержащих несколько идентифицируемых людей.’

Новая статья озаглавлена Датирование фотографий по агрегации возраста лица и исходит от двух исследователей из Чехословацкого технического университета в Праге, с обещанием более позднего выпуска кода/данных.

Метод

Чтобы оценить, когда была сделана фотография, новая система автора смотрит на каждое обнаруженное лицо и пытается угадать, кто это может быть, используя упомянутую базу данных известных людей. Поскольку человек может появиться только один раз в фотографии, система проверяет все возможные комбинации возможных идентификаторов и использует их известные годы рождения, чтобы угадать, сколько лет каждому человеку.

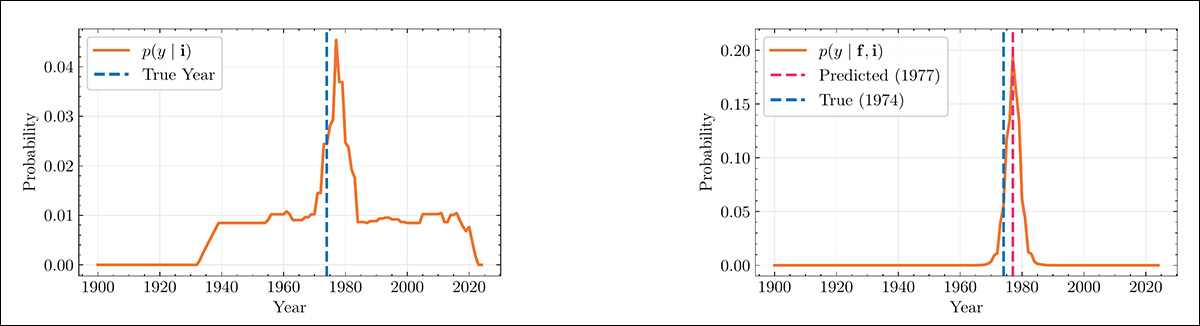

После этого она работает в обратном направлении, чтобы оценить наиболее вероятный год, который сделал бы эти возрасты совпадающими:

Слева: система строит временную шкалу, показывающую, когда признанные люди были наиболее активны, на основе их известных карьер. Справа: это объединяется с оценками возраста лица, чтобы произвести окончательную оценку даты, когда было сделано изображение.

Чтобы управлять большим количеством возможных комбинаций идентификаторов, система предполагает, что лица являются независимыми, и что каждое из них зависит только от его идентификатора и даты фотографии.

Чтобы оценить, когда была сделана фотография, система сначала угадывает возраст каждого обнаруженного лица, используя модель cvut-002, которая основана на архитектуре ViT-B/16 и обучена на частной базе данных (которая, по утверждению авторов, занимает высокое место в базе данных NIST’s Face Analysis Technology Evaluation (FATE) базе данных).

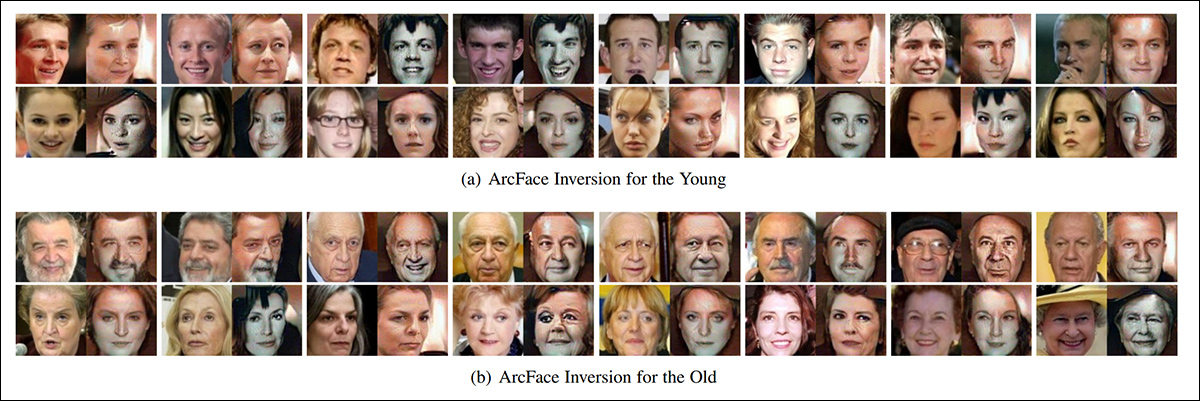

Как только год рождения человека становится известен, модель преобразует оценку возраста в вероятную год фотографии, просто добавляя возраст к году рождения, что дает вероятностное распределение возможных лет захвата. Чтобы оценить, насколько обнаруженное лицо соответствует известной идентификации, система сравнивает их вложения в пространстве ArcFace:

ArcFace, центральная архитектура для популярной модели InsightFace, была запущена в 2015 году, предназначенная стать влиятельным проектом в оценке и оценке лица. Источник

Каждая идентификация представлена средним вложением, построенным из ее эталонных портретов. Затем сходство между тестовым лицом и идентификацией измеряется, используя распределение Вон Мизеса Фишера, которое моделирует, насколько плотно вложения идентификации聚ируются вокруг этого среднего. Общий параметр остроты контролирует, насколько уверена система в этих кластерах, и оценивается, используя стратегию оставления одного на портретах идентификации.

Модель определяет пять типов приоров, чтобы оценить, когда признанный человек может появиться в фотографии: униформ; десятилетие; фильм; изображение; и комбинированный приор, который объединяет сильнейшие и слабейшие варианты, чтобы проверить чувствительность к силе приора (т. е. устойчивость приоров к напряжению).

Чтобы справиться с лицами, которые не могут быть уверенно идентифицированы, модель включает в себя резервную ‘неизвестную’ идентификацию с неинформативными распределениями, в которых вероятность лица плоская в пространстве вложения, и временной приор плоский во всех годах. Это позволяет неопределенным лицам быть проигнорированными без предвзятости окончательной оценки даты:

Как производительность влияет, когда некоторые лица в изображении не могут быть идентифицированы. Каждый квадрат показывает среднюю ошибку датирования для разных количеств известных и неизвестных идентификаторов, с размером квадрата, отражающим, насколько часто эта комбинация встречается в наборе данных. Ошибка увеличивается с большим количеством неизвестных, но снижается последовательно, когда добавляется больше известных идентификаторов.

Данные и тесты

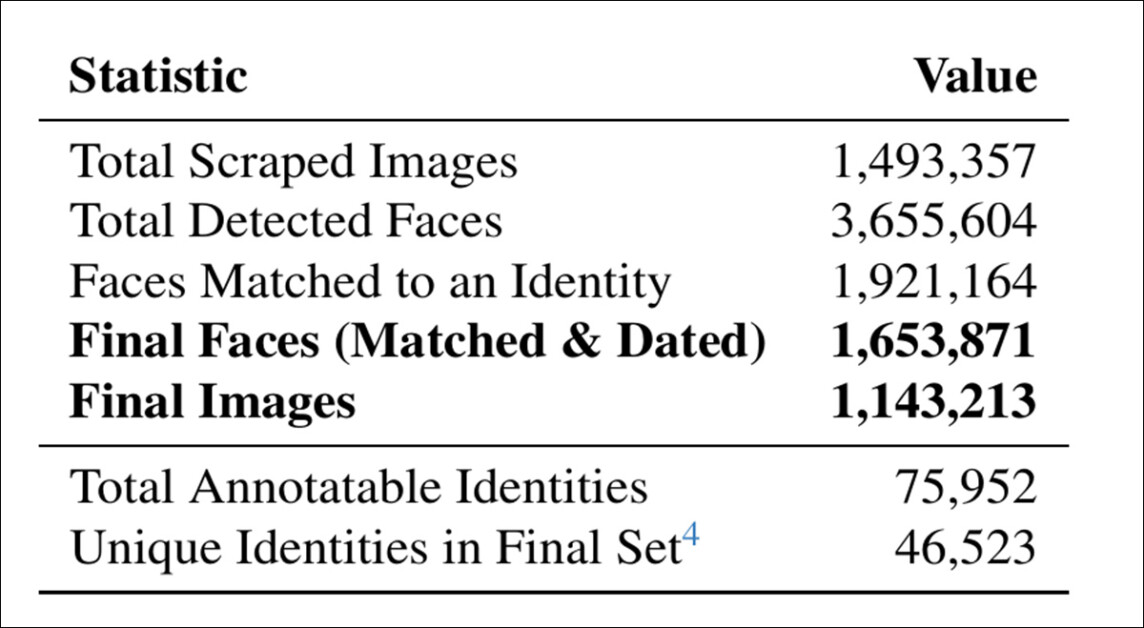

Авторы использовали упомянутую базу данных CSFD, чтобы сформировать новый набор данных, который они назвали CSFD-1.6M. Набор данных был построен из сцен, в которых участвовали несколько людей, и каждый человек в изображении был сопоставлен с публичным профилем, в котором указан год рождения, и портрет.

Затем каждое лицо в изображении было сопоставлено с одним из известных идентификаторов, изначально используя ArcFace для создания вложений лица, и вычисляя среднее вложение для каждой идентификации.

После этого алгоритм Хунгариан был использован для присвоения лиц идентификаторам путем сравнения сходства вложений, с корректировками, сделанными, когда количество обнаруженных лиц через SCRFD-10GE не совпадало с количеством известных людей.

Статистика из набора данных CSFD-1.6M, в которой подробно описаны извлеченные изображения, обнаруженные лица, совпадения идентификаторов, окончательные аннотированные образцы и доступный пул идентификаторов.

Совпадения были отклонены, если сходство было слишком низким или если оценка возраста сильно отличалась от известного возраста, и лица не фильтровались по качеству или размеру.

Авторы отмечают превосходство своего отобранного набора над ближайшим сравнимым набором данных, IMDB-WIKI:

‘Наша база данных не только существенно больше, но, критически, состоит из многопersonажных сцен, необходимых нашей модели. Хотя ни один веб-скрейпинговый набор данных не свободен от шума меток, наша пайплайн аннотации использует явные ссылки между изображениями и профилями идентификаторов, предоставленные базой данных, направленные на более высококачественные назначения идентификаторов.’

Их оценка сравнивает несколько версий системы датирования, чтобы понять, откуда происходят ее выгоды. Одна модель предполагала идеальное знание того, кто находится в изображении, предоставляя верхнюю границу производительности, удаляя любую неопределенность в распознавании идентификатора, и полная версия модели затем оценивала идентификаторы и даты совместно, взвешивая различные возможные конфигурации идентификаторов, прежде чем прийти к окончательной оценке года.

Более простой вариант выбирал единую наиболее вероятную конфигурацию идентификатора без маргинализации альтернатив, что оказалось почти таким же эффективным на практике.

Напротив, наиболее базовая базовая модель присваивала каждому лицу независимо и объединяла полученные оценки возраста, не учитывая, делают ли идентификаторы коллективно смысл.

Чтобы протестировать, насколько метод выигрывает от использования лиц вообще, отдельная модель была обучена для оценки даты напрямую из всей сцены. Эта модель, основанная на сцене, представляет собой наиболее сильный альтернативный подход, используемый в настоящее время в оценке даты изображения, поскольку она может учиться эра-специфичным визуальным закономерностям на всем изображении, а не полагаться на идентификатор или возраст.

Метрики и данные

Средняя абсолютная ошибка (MAE) между прогнозируемым годом и известной фактической датой была центральной метрикой для экспериментов.

Данные были разделены на пять частей, с учетом того, чтобы все изображения из одного фильма были сохранены в одной части. Три из этих частей были использованы для обучения, одна для проверки, и одна для тестирования. Этот пятикратный поворот был применен, чтобы предотвратить переобучение.

Поскольку модели, основанные на лицах, не были обучены на этом наборе данных, никакого разделения не потребовалось, и вместо этого они были оценены напрямую на полном наборе данных CSFD-1.6M.

Модель Сцена была обучена в течение 200 эпох под оптимизатором Adam, с изображениями, измененными до 384×384 кадра.

Результаты

Раздел результатов статьи необычно разделен на несколько показателей производительности, без единого выдающегося или центрального теста. Однако мы представим выбор наиболее важных результатов здесь.

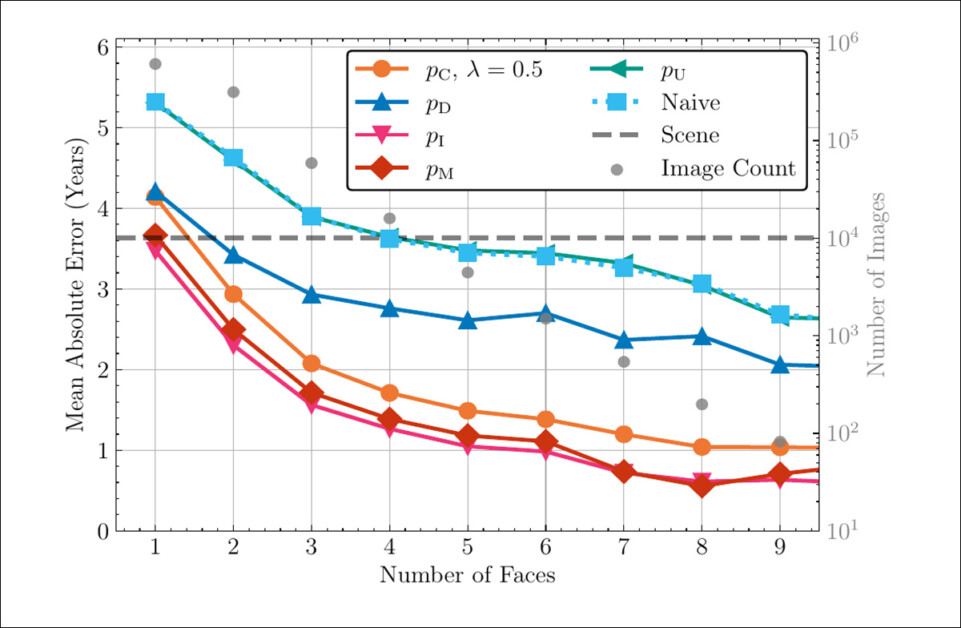

Наиболее важный результат не является единственным числом, а закономерностью: модели агрегации лица (особенно Полная и Top-1 варианты) последовательно превосходят сильную Сцену базовую линию, когда два или более известных идентификатора присутствуют – даже хотя Сцена модель обучена напрямую на наборе данных, поддерживая центральное утверждение, что идентификатор-связанное лицевое датирование обеспечивает более прочный сигнал, чем целостная интерпретация сцены.

Чтобы оценить эффект временных приоров, авторы сравнили несколько конфигураций своей Полной модели. Наиболее сильная производительность была получена, используя Десятилетие Приор, который значительно превосходит как Наивную модель (которая не использует временной приор) и Униформный Приор (который предполагает, что нет предпочтения над годами):

Производительность падает резко для всех методов, когда увеличивается количество лиц, но модели, использующие реалистичные временные приоры, такие как Десятилетие Приор, затронуты гораздо меньше. Базовые модели Naive и Scene остаются плоскими или ухудшаются с более крупными группами, в то время как Полная модель, руководствующаяся информативными приорами, поддерживает низкую ошибку. Оракул-основанные приоры, которые полагаются на статистику тестового набора, определяют нижнюю границу достижимой производительности.

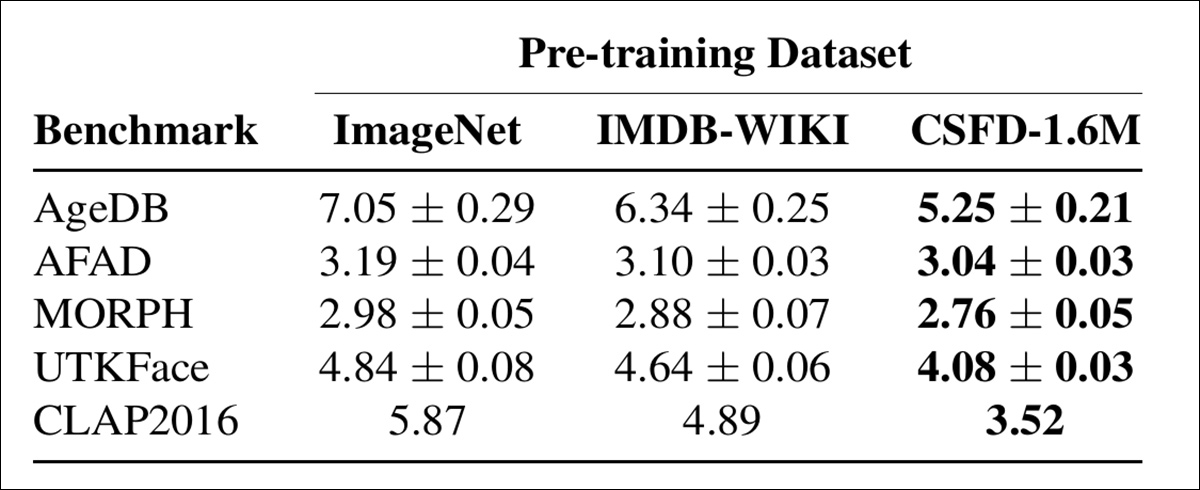

Чтобы продемонстрировать ценность CSFD-1.6M за пределами датирования фотографий, набор данных также был протестирован в качестве ресурса для предварительного обучения для более широкой задачи оценки возраста лица. Следуя стандартному протоколу оценки, ResNet101 модели были предварительно обучены на CSFD-1.6M и сравнены с аналогами, предварительно обученными на IMDB-WIKI и ImageNet. Эти модели затем были дообучены и оценены на пяти популярных базах данных: AgeDB; AFAD, MORPH; UTKFace; и CLAP2016:

Средняя абсолютная ошибка (плюс-минус стандартное отклонение) на пяти базах данных оценки возраста, сравнивающих модели, предварительно обученные на ImageNet, IMDB-WIKI и CSFD-1.6M. Более низкие значения указывают на лучшую производительность. CSFD-1.6M дает наиболее сильные результаты на всех базах данных.

На всех пяти базах данных предварительное обучение на CSFD-1.6M привело к наименьшим показателям ошибок, превосходя другие два источника предварительного обучения с явным отрывом – разрыв в производительности, который оказался наиболее сильным на AFAD и CLAP2016, но оставался последовательным на всех базах данных.

Мы направляем читателя к остальной части раздела результатов в исходной статье, который также обширно занимается исследованиями удаления.

Вывод

Хотя новая статья быстро становится плотной и недоступной для случайного читателя, тема, рассматриваемая в ней, является одной из наиболее интересных и актуальных в литературе компьютерного зрения – не в последнюю очередь потому, что она пересекается с антропологией и культурными исследованиями, где константы трудно определить.

* Как и эволюция музыки замедлила свою скорость изменения.

Опубликовано в понедельник, 10 ноября 2025