Unghiul lui Anderson

Chiar și inteligența artificială de bază poate scrie știri care pot fi confundate cu cele scrise de oameni

Noi cercetări arată că chiar și modelele locale de inteligență artificială mici pot scrie știri pe care oamenii nu le pot deosebi de jurnalismul real, egalând sistemele de top și lăsând cititorii incapabili să spună cine a scris ce.

Conform unei noi colaborări de cercetare între Germania și Franța, oamenii nu pot spune dacă un articol de știri este scris de inteligență artificială sau de un om – chiar și atunci când este scris de modele deschise care pot fi descărcate și rulate pe calculatoare desktop de consum relativ medii.

Într-o altă indicație că inteligența artificială mică este în ascensiune, un sondaj de 2.318 judecăți colectate de la 1.054 de participanți într-un portal academic dedicat a constatat că cititorii umani nu pot identifica proveniența unui articol la un nivel mai mare decât cel întâmplător, chiar și atunci când a fost generat de modele relativ modeste cu cât mai puțini parametri, printre care Mistral și Llama variante:

Medii și scoruri de autenticitate pentru LLM-uri testate. GPT-4o cu 200 de miliarde de parametri nu depășește semnificativ modelele mai mici. Cele testate pentru studiu au fost Gemma 7B, Phi-3 Mini, LLaMA-2 13B, Mistral 7B, GPT-4o și GPT-3.5. Sursă

Autorii revin la un subiect pe care l-au examinat pentru prima dată în lansarea din 2024 Binecuvântare sau blestem? Un sondaj despre impactul inteligenței artificiale generative asupra știrilor false. Rezultatele însele sunt rezultate recent lansate dintr-un proiect mai mare inițial anunțat în ianuarie și fac uz de cadrul online participativ JudgeGPT al autorilor.

Puterea ușoară

Intitulat Își pot da seama oamenii? Un studiu dual-axă al percepției umane a știrilor generate de LLM, și provenind de la trei cercetători de la Universitatea de Științe Aplicate din Frankfurt și unitatea de cercetare IRISA din Nantes, noul studiu face o distincție importantă între ‘știri false’ și ‘știri scrise de inteligență artificială’ (deoarece știrile false pot fi scrise de oameni sau de inteligență artificială, și cele două aspecte nu sunt necesar sinonime).

Cu toate acestea, poate cel mai interesant aspect este concluzia că modelele mici, incluzând Mistral 7B și Gemma 7B pot, cu doar șapte miliarde de parametri, să se confrunte cu aplomb cu modele precum ChatGPT (4o) cu 200 de miliarde de parametri:

‘Modelele deschise cu cât mai puțini parametri de 7 miliarde produc text evaluate la fel ca și ieșirile GPT-4o, indicând faptul că capacitatea de a genera text care nu poate fi deosebit de cel uman nu mai este limitată la modelele de frontieră.’

Cu toate acestea, ‘știrile generate de inteligență artificială’ pot reprezenta multe tipuri diferite de colaborare om-inteligență artificială, de la corectură ortografică până la delegarea completă a efortului, și studiul nu clarifică exact ce tip de conținut a fost produs pentru testele menționate (deși descrie metodologia pentru producerea acestuia – a se vedea mai jos).

Metodă

Pentru participanții implicați în platforma JudgeGPT, fiecare fragment de știri a fost evaluat folosind un cadru dual-axă în care au furnizat trei evaluări independente pe slider-uri continue de la 0 la 100:

Interfața portalului JudgeGPT, unde evaluatorii evaluează materialul pe atribuirea sursei; autenticitate; și familiaritatea cu subiectul. Vă rugăm să consultați sursa pentru o rezoluție mai bună.

Judecata sursei a capturat dacă un pasaj părea scris de mașină sau de om; judecata autenticității, dacă a fost perceput ca fals sau legitim; și familiaritatea cu subiectul, cât de bine cunoștea cititorul subiectul.

S-au folosit scale continue în loc de o scală Likert, pentru a capta grade de certitudine mai precis și pentru a sprijini analiza statistică, incluzând corelația Pearson și clustering.

Fragmentele de text generate de mașină au fost produse de cadrul RogueGPT al autorilor, arhitectura de alimentare pentru JudgeGPT. RogueGPT orchestrează contribuții de la șase Modele de Limbaj Mare (LLM): ChatGPT-4; ChatGPT-3.5; ChatGPT-4o; LLaMA-2 13B; Gemma 7B; și Mistral 7B.

S-a folosit promptarea bazată pe personaj pentru a genera textele, și generările de inteligență artificială au fost ancorate în subiecte de știri reale și au fost verificate de oameni.

În schimb, fragmentele de text scrise de oameni au fost extrase din ‘surse de știri stabilite’ și ‘baze de date de informații’ nespecificate.

Autorii observă:

‘Setul de stimulare este intenționat să fie îndreptat spre fragmente de origine mașină (∼98%), cu articole de origine umană care servesc ca repere de calibrare.

‘Acestă alegere de proiectare reflectă focalizarea studiului asupra variației din cadrul inteligenței artificiale (între modele) și nu asupra comparației om-inteligență artificială; participanții nu sunt informați despre rata de bază, și detectarea aproape de întâmplător [rezultate] se mențin atunci când sunt analizate pe subsetul de origine umană în sine.’

Participanții au dat mai întâi consimțământ informat și au completat un chestionar demografic care acoperă vârsta, educația, orientarea politică și familiaritatea cu inteligența artificială, după care au evaluat secvența de fragmente de știri.

Fiecare persoană a revizuit între 5-87 de articole, cu o medie de 12, în timp ce ordinea de prezentare a fost randomizată, și asignarea modelului a fost echilibrată pe participanți, pentru a reduce bias-ul. Platforma a înregistrat cele trei evaluări pe slider-uri, alături de timpul de răspuns și un identificator anonim, permițând evaluărilor individuale să fie legate de factori de fond.

Autorii subliniază că eșantionul s-a îndreptat spre participanți educați din Europa, cu 68% cu educație universitară, și 74% cu sediul în Europa – o bias care este notată ca o limitare pentru generalizarea mai largă.

Teste

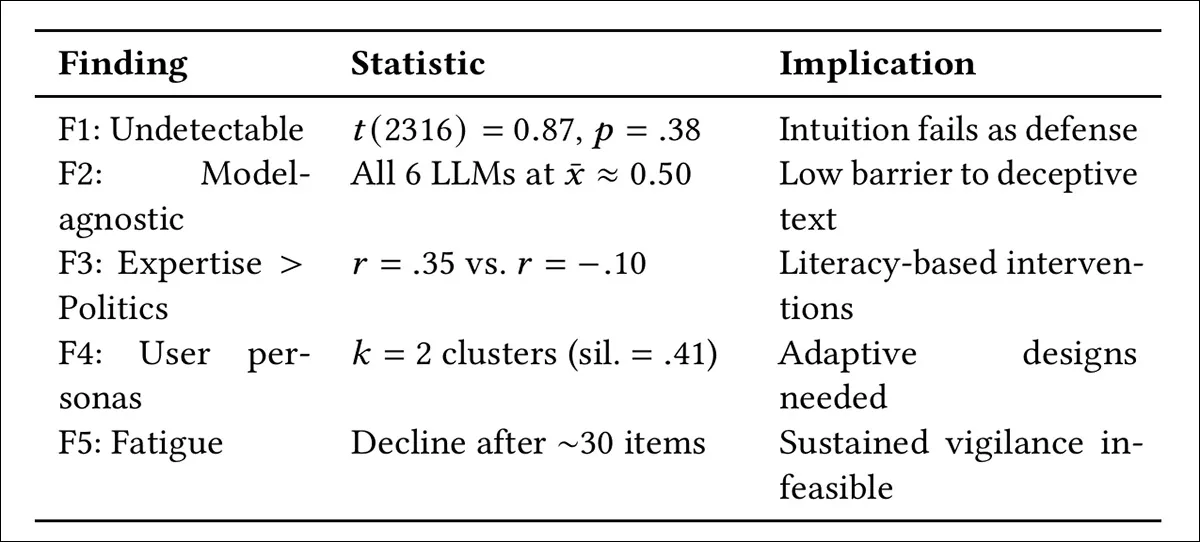

Testele sunt împărțite în cinci tipuri de rezultate: deosebirea textului generat de mașină de cel scris de om; compararea detectării între diferitele LLM; examinarea efectului expertizei de domeniu versus orientării politice asupra acurateței; identificarea strategiilor de răspuns distincte printre participanți; și urmărirea modului în care acuratețea se schimbă pe parcursul evaluărilor repetate, din cauza oboselii:

Rezumatul celor cinci rezultate principale din 2.318 judecăți pe 1.054 de participanți, arătând că detectarea umană a textului scris de inteligență artificială a rămas la niveluri de întâmplător pe toate modelele, că acuratețea a fost legată de expertiza de domeniu mai mult decât de orientarea politică, că participanții s-au grupat în profiluri de încredere distincte, și că performanța a scăzut după aproximativ 30 de evaluări, din cauza oboselii cognitive.

Testul a arătat că nu există o diferență semnificativă mai mare decât întâmplător în scorurile sursei între condiții, aparent indicând faptul că participanții nu pot deosebi textul generat de inteligență artificială de cel scris de om:

Distribuțiile scorurilor sursei și autenticității pentru fragmentele de origine mașină și umană arată o suprapunere substanțială, fără o separare semnificativă între cele două condiții, și testarea statistică – indicând faptul că participanții nu au putut deosebi în mod fiabil textul generat de inteligență artificială de conținutul scris de om.

Pentru al doilea aspect, așa cum se arată în graficul de la începutul articolului, eșecul detectării nu a variat în funcție de model, deoarece ieșirile tuturor LLM au fost grupate în jurul judecăților de nivel de întâmplător, fără diferențe semnificative între ele. Chiar și sistemele deschise mai mici, cum ar fi Mistral 7B și Gemma 7B, au fost evaluate la fel ca și GPT-4o, indicând faptul că textul care nu poate fi deosebit de cel uman nu mai este limitat la cele mai mari modele.

Pentru al treilea aspect, acuratețea a fost legată mai puternic de expertiza de domeniu decât de orientarea politică, deoarece familiaritatea cu știrile false a corelat cu judecăți mai bune, în timp ce opiniile politice nu au avut niciun efect semnificativ, sugerând că abilitățile analitice învățate pot conta mai mult decât ideologia:

Rezultatele pentru a treia linie de investigație au arătat că orientarea politică nu a avut niciun efect semnificativ asupra atribuirii sursei sau a scorului de autenticitate, cu doar tendințe slabe, nesemnificative, pe ambele măsuri, în timp ce familiaritatea auto-raportată cu știrile false a fost asociată cu o acuratețe mai mare pe ambele axe. Acest lucru sugerează că abilitatea analitică bazată pe experiență a fost un predictor mai puternic al performanței decât poziția ideologică. Vă rugăm să consultați sursa pentru o rezoluție mai bună.

A patra constatare a arătat că participanții s-au grupat în două stiluri de răspuns distincte, identificate ca ‘Sceptici’ – care au atribuit o încredere scăzută pe conținut, indiferent de origine – și ‘Credincioși’ – care au menținut un nivel mai ridicat de încredere.

În cele din urmă, în ceea ce privește al cincilea obiectiv, o analiză în curs de desfășurare a judecăților secvențiale a arătat că participanții au devenit inițial mai buni la sarcină, cu acuratețea care s-a îmbunătățit pe parcursul aproximativ primelor 15-20 de evaluări, pe măsură ce s-au adaptat la format:

Mediile mobile ale scorurilor de atribuire a sursei și autenticității pe parcursul secvenței de evaluări ale participanților arată o fază inițială de îmbunătățire, pe măsură ce utilizatorii par să se adapteze la sarcină în primele 15–20 de articole, urmată de o scădere constantă a ambelor măsuri după aproximativ 30 de evaluări. Vă rugăm să consultați sursa pentru o rezoluție mai bună.

Cu toate acestea, acest efect a fost de scurtă durată, deoarece performanța a început să scadă după aproximativ 30 de articole, participanții etichetând din ce în ce mai mult conținutul ca fals – o schimbare interpretată ca oboseală cognitivă, și sugerând limite clare asupra cât de mult timp abordările bazate pe detectare pot rămâne eficiente, în practică.

Acest lucru poate reprezenta o dovadă empirică că, obosiți de perspectiva de a deosebi știrile false de cele reale, știrile generate de inteligență artificială de la cele scrise de oameni, putem tenda să ne bazăm pe presupunerea că știrile sunt generate de inteligență artificială și/sau false (nu neapărat același lucru), pentru a fi ‘în siguranță’. Cei care consideră acest lucru ‘leneș’ și cred că oamenii ar trebui să-și facă propriile cercetări pentru a verifica o posibilă știre falsă, ar putea fi interesați să afle că un studiu din 2024 a indicat că acest lucru face ca problemele să fie și mai grave.

Autorii sugerează că eșecul judecății umane din rezultate indică faptul că putem avea nevoie să delegăm astfel de chestiuni tehnologiilor de proveniență criptografică, cum ar fi inițiativa C2PA condusă de Adobe. Alte soluții posibile menționate sunt cadrul OriginLens al autorilor și un alt proiect implicat de autor, numit CRED-1.

Autorii concluzionează:

‘Oamenii pot spune? Studiul nostru dual-axă cu 2.318 judecăți pe șase familii de LLM oferă un răspuns empiric clar: nu pot.

‘Textul generat de mașină este indistinguibil de cel scris de om, indiferent de mărimea modelului sau de familie, expertiza de domeniu prezice acuratețea detectării mai puternic decât orientarea politică, participanții adoptă strategii de încredere distincte, și oboseala cognitivă limitează detectarea susținută.

‘Aceste rezultate susțin o schimbare de la detectarea la nivel de utilizator către măsuri de contracarare la nivel de sistem, incluzând proveniența conținutului, indicatori de încredere adaptivi și intervenții de imunizare limitate.’

Concluzie

Aspectul îngrijorător al acestui articol este rețeaua de proiecte și lucrări care autorii – sau unii dintre autori, în funcție de lucrare – au inițiat sau au o mână în; și cu siguranță ar fi fost interesant de a studiat mostre de text generate de inteligență artificială și de om care au produs aceste rezultate, pentru a înțelege mai bine tipul de ieșire pe care metodologia de generare descrisă o produce.

Cu toate acestea, este interesant de auzi că modelele deschise, cu sursă deschisă, pot fi comparate cu giganții API, cum ar fi seria ChatGPT – poate fi că sarcina de față nu este de fapt atât de dificilă, și că un model cu 200 de miliarde de parametri este o supraîncărcare pentru astfel de sarcini? Ar trebui să știm puțin mai mult despre mostrele de text generate de inteligență artificială și de om care au produs aceste rezultate, pentru a răspunde la această întrebare.

Între timp, conform site-ului canirun.ai, Mistral 7B (care a fost aproximativ la fel ca ChatGPT-4o în testele menționate) ‘rulează bine’ pe un NVIDIA RTX 3080 cu 16 GB de VRAM, și ‘rulează decent’ pe un 3060 cu 6 GB de VRAM – nu sunt deloc plăcile grafice cele mai noi sau mai bune în funcțiune*. Așadar, oricine dorește să-și dezvolte propria metodologie pentru trimiterea de mostre poate participa, de asemenea, la aceste experimente.

* Gemma 7B nu este listată pe site.

Publicat pentru prima dată joi, 9 aprilie 2026