Unghiul lui Anderson

Scrierea generată de IA nu se “obosește” niciodată și, prin urmare, se dezvăluie

Scrierea de tip ChatGPT se dezvăluie prin creșterea în consistență, în timp ce scrierea umană rămâne eratică pe tot parcursul.

Fereastra de context limitată a majorității modelelor de limbaj mari cu care se confruntă consumatorii (LLM) este unul dintre factorii care le pot face să uite sau să reamintească în mod greșit părți anterioare ale conversațiilor utilizatorilor – erori de reamintire care pot transforma treptat ieșirea în nonsens total – sau, și mai rău, text coerent care conține erori subtile.

Deoarece aceste împrejurări duc la halucinații, și deoarece halucinațiile sunt încă cea mai mare piedică în calea avansului total al IA pe piață, s-a depus mult efort de cercetare pentru a crea sisteme de inteligență generativă care pot crea porțiuni mai lungi, dar mult mai consistente de text.

Într-adevăr, se fac atât de multe progrese încât recunoașterea conținutului generat de IA pe termen lung (adică conținut generat în totalitate de IA, cu – presupunând – îngrijire umană minimă sau zero) este considerată o problemă în creștere.

Dezvoltarea unui discurs generat de IA

Cu toate acestea, studii empirice recente susțin că, cu cât produc mai mult text generatorul de text IA într-o singură explozie, cu atât este mai ușor să se determine dacă acel text a fost scris de un om; dar înțelepciunea acceptată în legătură cu acest “ancoră” de detectare a presupus că IA poate fi descoperită pentru că oricare ar fi ceea ce face diferit de oameni, are șansa de a face mai des în trasee mai lungi.

Nu se fac presupuneri despre distribuția acestor “povestiri” în textul însuși.

Pentru a contesta acest lucru și pentru a extinde problema, o lucrare de cercetare recentă și interesantă din China oferă o metodă nouă de a distinge noile generații de conținut generat de IA pe termen lung de la autori umani reali. Cercetătorii din spatele lucrării susțin că natura token-pe-token prin care se generează textul IA devine mai consistent cu o lungime mai mare, în timp ce excentricitățile oamenilor nu scad odată cu lungimea.

În acest fel, autorii sugerează că perspicacitatea lor oferă o posibilă nouă metrică pentru sistemele de detectare a textului IA*:

‘Tokenurile generate de IA din partea a doua a textului prezintă fluctuații de probabilitate mai mici și mai stabile pe măsură ce predicțiile modelului devin din ce în ce mai consistente pe măsură ce contextul se acumulează.

‘Denominăm acest model Decăderea volatilității din etapa târzie. Acest fenomen reflectă comportamentul inerent al generării autoregresive: pe măsură ce devine disponibil mai mult context, distribuția de predicție a modelului se ascute, conducând la o variabilitate redusă în statistici la nivel de token.

‘Scrierea umană, pe de altă parte, continuă să introducă alegeri lexicale neașteptate și menține o volatilitate mai ridicată pe tot parcursul.’

Pentru a captura această “netezime” ciudată care se acumulează în textul IA spre sfârșit, cercetătorii definesc două caracteristici simple: prima măsoară cât de mult “săripe” comportamentul statistic al scrierii “între” tokeni; a doua verifică cât de stabil rămân pe porțiuni scurte de text.

Ambele sunt calculate doar din a doua jumătate a ieșirii, unde IA devine vizibil mai regulată și scrierea umană nu.

Autorii notează că, deși aceste semnale funcționează bine singure, sunt și mai eficiente atunci când sunt combinate cu metode de detectare mai vechi care scanează modele mai ample. Ei notează, de asemenea, că această abordare funcționează cel mai bine pe texte mai lungi, unde contrastul poate deveni mai evident.

Lucrarea nouă oferă o metodologie pentru testarea “calității IA” prin analiza caracteristicilor temporale din a doua jumătate, fără a necesita antrenament suplimentar sau reglare fină, sau acces privilegiat la model.

Noua lucrare se intitulează Când IA se stabilește: Stabilitatea din etapa târzie ca semnătură a detectării textului generat de IA și provine de la patru autori de la Universitatea Westlake din Hangzhou.

Metodă

Pentru a captura netezimea în creștere a textului generat de IA, cercetătorii au proiectat două măsurători care se concentrează doar pe a doua jumătate a unui pasaj. Acestea se bazează pe scoruri de log-probabilitate de la un model de limbaj standard și nu necesită reglare fină, reantrenare sau mostre suplimentare:

<img class=" wp-image-249428" src="https://www.unite.ai/wp-content/uploads/2026/01/figure-2-7.jpg" alt="Din noua lucrare – fiecare rând arată comportamentul unei metrici de bază din EvoBench de-a lungul secvenței de token: valoare brută (stânga), derivată absolută (centru) și deviație standard locală (dreapta). Liniile umane și IA sunt afișate în albastru și roșu. Cea mai mare divergență apare în a doua jumătate a textului, în special pentru Log Probabilitate și Discrepanță de eșantionare, care arată o separare în creștere și o ieșire mai netedă a IA. Entropia și Concentrarea Top-K arată o schimbare mică în timp. Sursă – https://arxiv.org/pdf/2601.04833” width=”893″ height=”379″ /> Din noua lucrare – fiecare rând arată comportamentul unei metrici de bază din EvoBench de-a lungul secvenței de token: valoare brută (stânga), derivată absolută (centru) și deviație standard locală (dreapta). Liniile umane și IA sunt afișate în albastru și roșu. Cea mai mare divergență apare în a doua jumătate a textului, în special pentru Log Probabilitate și Discrepanță de eșantionare, care arată o separare în creștere și o ieșire mai netedă a IA. Entropia și Concentrarea Top-K arată o schimbare mică în timp. Sursă – https://arxiv.org/pdf/2601.04833

Prima măsură, numită Dispensarea derivativă (DD), urmărește cât de ascuțit se schimbă încrederea modelului de la un cuvânt la altul. Textul IA tinde să se stabilizeze într-un ritm, astfel încât aceste schimbări devin mai mici și mai previzibile în a doua jumătate. În schimb, scrierea umană rămâne “neregulată”.

A doua măsură, Volatilitatea locală (LV), examinează cât de mult “săripe” încrederea modelului “în interiorul” unei ferestre mici de text. Din nou, IA tinde să devină mai stabilă în timp, în timp ce alegerile umane rămân mai surprinzătoare și mai puțin consistente:

Textul IA devine mai neted pe măsură ce avansează, în timp ce scrierea umană rămâne neregulată. Aceste grafice urmăresc modul în care încrederea modelului se schimbă de-a lungul unui pasaj, reflectând atât ascuțimea schimbării între cuvinte consecutive, cât și cantitatea de variație în interiorul porțiunilor locale de text. În ambele privințe, scăderea este mult mai abruptă în ieșirea generată de mașină, cu contrastul devenind mai evident după punctul de mijloc. Cutiile galbene evidențiază această lacună în creștere din a doua jumătate, unde scrierea IA atinge până la 32% mai multă stabilitate decât scrierea umană.

O dată again, ambele metrici sunt calculate doar din partea a doua a textului, unde diferența dintre scrierea umană și cea a mașinii este cea mai evidentă. Acestea sunt apoi incorporate într-o singură valoare numită Scor de detectare a stabilității temporale (TSD) – care este predispus să crească pe măsură ce scrierea devine “mai netedă” (și, prin urmare, mai probabil să fie generată de IA). Un prag simplu este apoi utilizat pentru a decide dacă un anumit pasaj este probabil scris de o mașină.

Deoarece aceste caracteristici se concentrează asupra când apare un model, mai degrabă decât doar ce arată acel model, ele sunt completate de metodele mai vechi care caută anomalii statistice în întregul pasaj. Adăugarea scorului TSD la ieșirea oferirii din sfârșitul anului 2024 Fast‑DetectGPT (de asemenea, în colaborare cu Westlake) oferă o îmbunătățire suplimentară a rezultatelor (în special pentru conținutul pe termen lung, unde efectul de netezire din etapa târzie este cel mai puternic).

Date și teste

Autorii au efectuat teste pe două seturi de date de referință legate: EvoBench conține 32.000 de perechi de text uman/IA generate în întreaga lume în șapte familii de modele, incluzând GPT-4; GPT-4o; Claude; Google Gemini; LLaMA-3; și Qwen, cu un total de 29 de versiuni de modele.

Celălalt cadru a fost MAGE, care oferă 30.000 de perechi de test în opt familii de modele, incluzând (dar nu limitat la) seria GPT de la OpenAI și familiile LLaMA, OPT și FLAN-T5.

Concurenți

Metoda nouă a fost testată împotriva unei game de detectoare zero-shot care utilizează același model surogat. Probabilitatea, Entropia, Rangul și Log-Rang (DetectGPT) au măsurat statistici la nivel de token pe întregul pasaj; LLR (DetectLLM) a aplicat normalizarea pentru a permite comparația directă între modele; și Fast-Detect a estimat curbură locală prin perturbații bazate pe eșantionare.

Lastde a analizat subsecvențe discriminative în semnalul de probabilitate, în timp ce FourierGPT a operat în domeniul frecvenței. Diveye a capturat schimbări în “surpriză” diversitatea de-a lungul secvenței.

În final, UCE a evaluat profilul de incertitudine al predicțiilor de token, pentru a identifica modele de încredere nefirești.

Implementare și rezultate

Toate metodele de detectare au fost rulate utilizând Llama-3-8B-Instruct ca model surogat împărtășit, cu secvențe de intrare limitate la 512 de tokeni. Caracteristicile temporale au fost extrase doar din a doua jumătate a fiecărui pasaj, utilizând o fereastră glisantă de 20 de tokeni pentru a măsura volatilitatea. O versiune fuzionată a metodei, numită TSD+, a combinat semnalul propus cu Fast-DetectGPT.

Aria de sub curba caracteristică a receptorului și a operatorului (AUROC) a fost metrica de evaluare principală†:

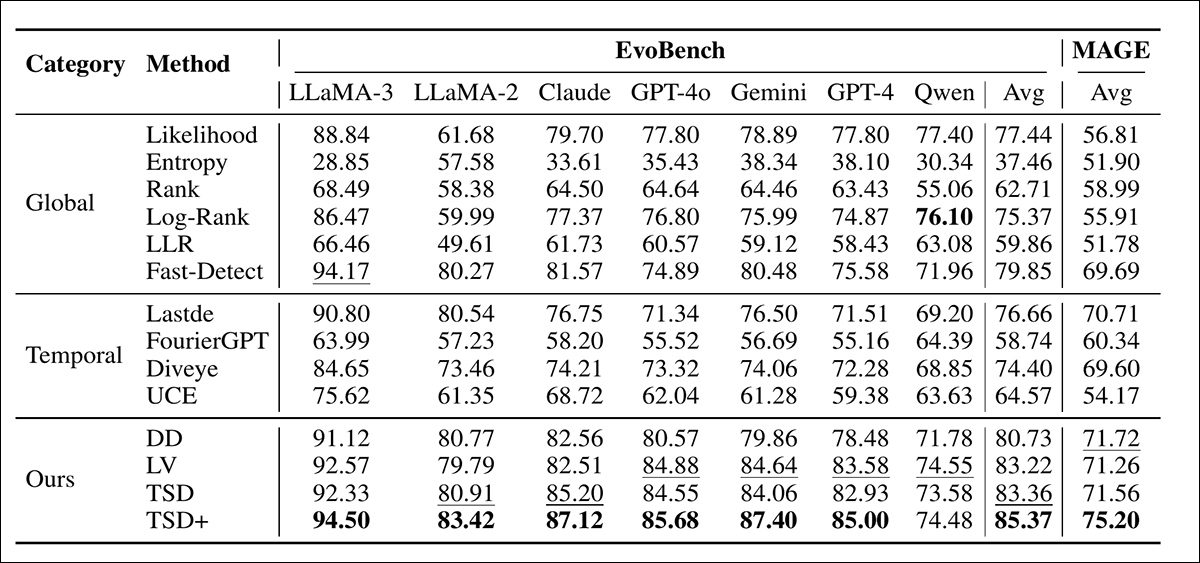

Performanță diversă între metodele testate împotriva textului generat de IA. Precizia de detectare este afișată pe două seturi de referință: EvoBench, care acoperă multiple LLM-uri de înaltă profil, și MAGE, un set de date complementar. Metricile sunt grupate după tipul de metodă: statistici globale, caracteristici temporale și variante propuse. Scorurile medii AUROC sunt prezentate în coloanele finale. Rezultatele variantei metodei autorilor depășesc în mod constant rezultatele metodelor anterioare, cu TSD+ care oferă scorurile cele mai ridicate în aproape toate setările modelului.

Dintre aceste rezultate inițiale, autorii declară:

‘Caracteristicile noastre temporale simple realizează o performanță de top între metodele autonome, cu TSD care atinge 83,36% pe EvoBench și 71,56% pe MAGE, depășind toate metodele anterioare, inclusiv Fast-DetectGPT.

‘Acest lucru este remarcabil, având în vedere simplitatea metodei noastre: calculăm doar statistici de ordinul doi din a doua jumătate a secvențelor, fără eșantionare perturbată sau transformări în domeniul frecvenței.’

Noua metodă a funcționat în special bine pe modelele IA mai noi, cum ar fi GPT-4 și GPT-4o, identificând textul scris de IA cu o acuratețe mai mare decât detectorul lider, cu o diferență de până la 9,66%. Deși modelele avansate mai noi produc un text mai puțin evident “consistent”, care ascunde unele semne de automatizare, anumite modele de cronometraj subtile sunt încă evidente aproape de sfârșit.

Abordările concurente care se concentrează asupra caracteristicilor structurale ample nu au reușit să capteze aceste modele din etapa târzie. Prin integrarea unui detector global, sistemul hibrid pare să recupereze aceste semnale pierdute și îmbunătățește performanța, în special pe seturile de referință în care ieșirile scurte ale IA pot slăbi semnalele temporale.

Concluzie

Un aspect care nu a fost abordat direct în noua lucrare este tendința scriitorilor umani de a-și itera lucrarea prin redactare și diverse straturi de supraveghere – uneori incluzând supraveghere externă, cum ar fi inputul editorilor și corectorilor, precum și posibile modificări sugerate de departamentele juridice, în funcție de context.

Multiplele părți implicate în documente atât de simple, cum ar fi un articol de ziar bine îngropat, pot chiar să șteargă excentricitățile pe care sistemul propus le urmărește și, în esență, echivalează cu o “versiune analogică” a unui proces de redactare asistat de IA.

O considerare suplimentară și contrastantă este că conținutul textului la care au contribuit mai multe persoane poate fi, de asemenea, printre cele mai fragmentate, defecte și repetitive piese de proză care intră într-un set de date, deoarece acestea adesea nu au beneficiat de o voce finală unificatoare, lăsând natura lor fragmentată a dezvoltării evidențiată în proză.

* Textul original al autorilor, reprodus din lucrare; nu sunt accentuările mele.

† Autorii declară ‘primar’, în timp ce listează nicio altă metrică de evaluare.

Publicat pentru prima dată luni, 26 ianuarie 2026