Líderes de pensamento

O que todo Cientista de Dados Deve Saber sobre Transformadores de Grafos e seu Impacto nos Dados Estruturados

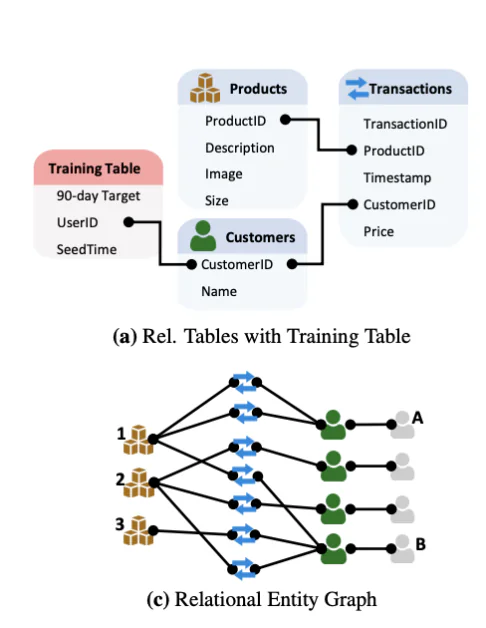

Eu co-criei Redes Neurais de Grafos enquanto estava em Stanford. Eu reconheci cedo que essa tecnologia era incrivelmente poderosa. Cada ponto de dados, cada observação, cada pedaço de conhecimento não existe em isolamento; ele faz parte de um grafo conectado a outros pedaços de conhecimento. Importante, a maioria dos dados de negócios valiosos, frequentemente armazenados como tabelas em bancos de dados e armazéns de dados, pode ser naturalmente representada como um grafo. Aproveitar essa estrutura relacional é fundamental para construir modelos de IA precisos e não alucinatórios.

Redes neurais de grafos (GNNs) introduziram arquiteturas de passagem de mensagens que podiam raciocinar sobre grafos capturando conexões entre pedaços de conhecimento. Mas assim como os Transformadores transformaram a compreensão da linguagem, uma nova classe de modelos, Transformadores de Grafos, está trazendo ganhos semelhantes para dados baseados em grafos. Esses modelos combinam a flexibilidade de mecanismos de atenção com priores estruturais de grafos para modelar relacionamentos complexos de forma mais eficaz do que seus antecessores GNNs.

Por que os grafos precisam de mais do que passagem de mensagens

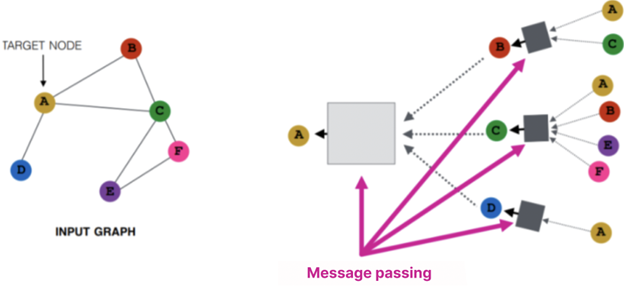

Redes neurais de grafos tradicionais (GNNs) dependem de passagem de mensagens, um processo onde cada nó atualiza seu estado interno agregando informações de seus vizinhos. Pense nisso como cada nó trocando resumos com nós próximos, então usando esses resumos para refinar sua própria compreensão. Ao longo de múltiplas camadas, isso permite que as informações se propaguem pelo grafo.

Embora poderosas para aprender padrões locais, a passagem de mensagens tem limitações importantes:

- Sobrecarga: À medida que as informações são agregadas ao longo de muitos saltos, elas podem se tornar comprimidas, perdendo detalhes significativos. Isso é especialmente problemático em GNNs profundas.

- Contexto limitado: A passagem de mensagens padrão não pode facilmente capturar dependências de longo alcance sem muitas camadas, o que aumenta a complexidade e o ruído.

- Expressividade: Muitas estruturas de grafos não podem ser diferenciadas usando apenas informações de vizinhança local, limitando o desempenho do modelo em tarefas que exigem distinções estruturais finas.

É aqui que os Transformadores de Grafos entram em cena. Ao substituir ou complementar a passagem de mensagens com mecanismos de atenção, eles permitem que cada nó atenda diretamente a outros (mesmo distantes) com base em importância aprendida. O resultado são representações mais ricas, melhor escalabilidade e a capacidade de raciocinar sobre estruturas complexas de forma mais flexível.

De GNNs para Transformadores de Grafos

O modelo Transformer original, introduzido no icônico artigo, Atenção é Tudo o que Você Precisa, foi projetado para modelar relacionamentos entre tokens em uma sequência. Seu sucesso reside na auto-atenção, um mecanismo que permite que cada entrada considere todas as outras entradas, ponderadas por relevância aprendida.

Transformadores de Grafos adaptam esse paradigma permitindo que os nós atendam não apenas aos seus vizinhos, mas a qualquer nó no grafo, seja por meio de atenção totalmente conectada ou de uma abordagem híbrida que equilibre sinais globais e locais. O desafio é introduzir uma noção de estrutura em um modelo projetado para sequências não estruturadas.

Codificações Posicionais Específicas de Grafos

Ao contrário do texto, os grafos não têm uma ordem inerente, tornando codificação posicional, que se refere a técnicas para injetar informações estruturais ou de localização em um modelo, não triviais. Transformadores de Grafos abordam isso com vários métodos:

- Vetores Próprios de Laplace: Derivados da matriz laplaciana do grafo, eles fornecem uma embedding espectral que captura a estrutura global.

- Caminhadas Aleatórias: Capturam a probabilidade de percorrer de um nó para outro ao longo de múltiplos saltos.

- Codificações Estruturais: Incluem métricas de distância, graus de nó ou tipos de aresta.

Essas codificações posicionais, seja espectrais, probabilísticas ou estruturais, dão aos Transformadores de Grafos uma maneira de entender onde cada nó se situa dentro do grafo mais amplo. Essa consciência estrutural é essencial para permitir que os mecanismos de atenção operem de forma significativa em dados irregulares e não ordenados, permitindo que o modelo capture relacionamentos que seriam invisíveis para métodos mais simples e puramente locais.

Implementações e Casos de Uso no Mundo Real

Levar Transformadores de Grafos para a produção requer infraestrutura que possa escalar para tamanhos de dados do mundo real. Bibliotecas como PyTorch Geometric (PyG) estão tornando isso possível. Construído sobre PyTorch, PyG fornece um framework modular para implementar GNNs e Transformadores de Grafos em uma variedade de aplicações, desde modelagem de moléculas até sistemas de recomendação. Ele suporta treinamento em mini-lotes em muitos grafos pequenos e em um único grafo grande, com suporte a multi-GPU e torch.compile, tornando-o adequado para fluxos de trabalho de pesquisa e empresa.

Essas ferramentas já estão alimentando uma ampla gama de aplicações do mundo real. Na descoberta de drogas, Transformadores de Grafos ajudam a prever propriedades moleculares modelando interações atômicas como grafos. Na otimização de logística e cadeia de suprimentos, eles podem representar e raciocinar sobre redes dinâmicas de remessas, armazéns e rotas. Empresas de comércio eletrônico usam-nos para melhorar as recomendações, entendendo o comportamento de compra e navegação de produtos como grafos relacionais. E na cibersegurança, modelos baseados em grafos são usados para detectar anomalias analisando padrões de acesso, topologia de rede e sequências de eventos.

Em cada um desses contextos, a capacidade de aprender a partir de estruturas complexas e interconectadas, sem depender apenas de recursos criados manualmente, está se provando uma grande vantagem.

Considerações Técnicas

Apesar de seu potencial, os Transformadores de Grafos vêm com trade-offs de engenharia reais. A atenção completa escala quadraticamente com o número de nós, tornando a eficiência de memória e computação uma preocupação principal, especialmente para grafos grandes ou densos. Muitos grafos do mundo real também têm arestas direcionais, introduzindo assimetrias que complicam como as informações estruturais são codificadas. E em implantações práticas, as entradas raramente são uniformes: combinar dados estruturados de grafos com texto, séries temporais ou imagens exige escolhas arquiteturais cuidadosas e pré-processamento de dados robusto.

Esses desafios não são intransponíveis, mas eles exigem um design de sistema pensado, especialmente quando se transita de protótipos de pesquisa para modelos prontos para produção.

O Que Vem a Seguir: LLMs Encontram Grafos

Uma direção importante de pesquisa é a integração de grandes modelos de linguagem (LLMs) com estruturas de grafos. Esses sistemas híbridos usam LLMs para codificar contexto textual ou extrair entidades, então fundamentam essa informação em um grafo para raciocínio e tomada de decisões.

Na biologia, isso impulsionou ferramentas como AlphaFold. No AI empresarial, isso habilita sistemas de suporte ao cliente que combinam documentação e grafos comportamentais. Transformadores de Grafos também estão desempenhando um papel crescente na capacitação de agentes de IA para tomar decisões mais inteligentes e ações mais apropriadas, permitindo que eles raciocinem sobre representações de estado estruturadas e priorizem interações dinamicamente. Essa fusão ajuda os agentes a entender melhor as relações hierárquicas, a acompanhar dependências ao longo do tempo e a adaptar seu comportamento em ambientes complexos.

O campo ainda está emergindo, mas o potencial é significativo.

Conclusão

Transformadores de Grafos não são apenas a próxima iteração de GNNs; eles representam uma convergência de atenção, estrutura e escalabilidade. Seja você trabalhe em finanças, ciências da vida ou sistemas de recomendação, a mensagem é clara: seus dados formam um grafo, então seus modelos também devem.