Ângulo de Anderson

Ameaças de Deepfakes Menores Podem Ser o Maior Perigo

Ferramentas de IA conversacional, como ChatGPT e Google Gemini, estão sendo usadas para criar deepfakes que não trocam rostos, mas de maneiras mais sutis podem reescrever a história toda dentro de uma imagem. Ao alterar gestos, objetos e fundos, essas edições enganam tanto detectores de IA quanto humanos, aumentando as apostas para identificar o que é real online.

No clima atual, particularmente após a promulgação de legislações significativas, como o TAKE IT DOWN act, muitos de nós associam deepfakes e síntese de identidade impulsionada por IA a pornografia não consensual e manipulação política – em geral, distorsões grotescas da verdade.

Isso nos acostuma a esperar que imagens manipuladas por IA sejam sempre direcionadas a conteúdos de alto risco, onde a qualidade da renderização e a manipulação do contexto possam ter sucesso em alcançar um golpe de credibilidade, pelo menos no curto prazo.

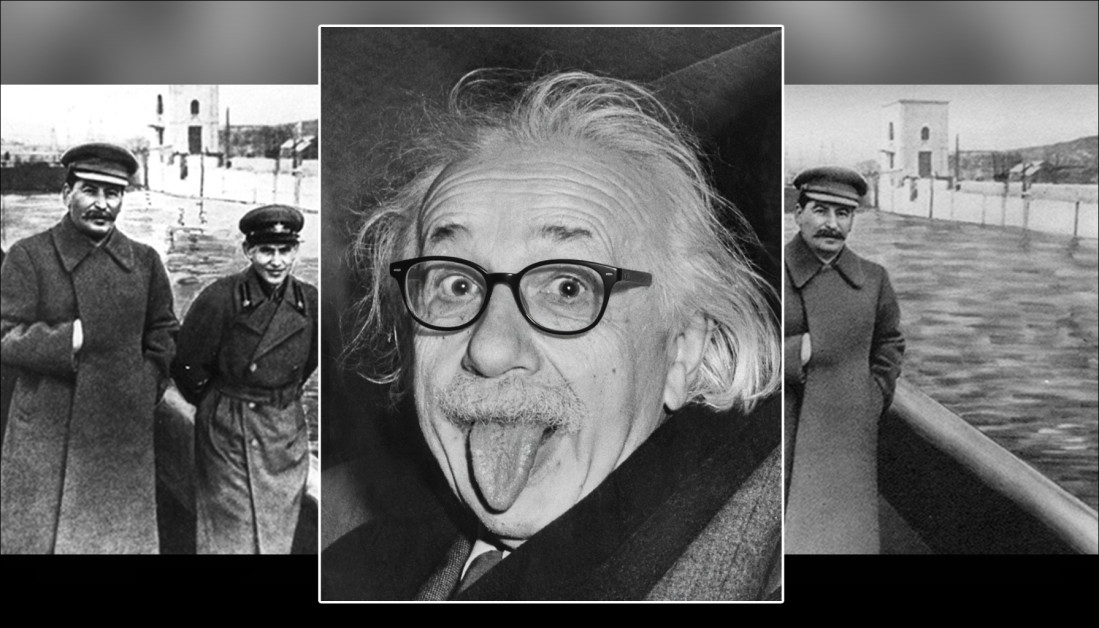

Historicamente, no entanto, alterações muito mais sutis tiveram um efeito mais sinistro e duradouro – como a fotografia de truque de estado da arte que permitiu que Stalin removesse aqueles que haviam caído em desfavor do registro fotográfico, como satirizado no romance de George Orwell Nineteen Eighty-Four, onde o protagonista Winston Smith passa seus dias reescrevendo a história e tendo fotos criadas, destruídas e ’emendadas’.

No exemplo a seguir, o problema com a segunda foto é que não sabemos o que não sabemos – que o ex-chefe da polícia secreta de Stalin, Nikolai Yezhov, costumava ocupar o espaço onde agora há apenas uma barreira de segurança:

Agora você me vê, agora estou… vapor. Manipulação fotográfica da era de Stalin remove um membro do partido desacreditado da história. Fonte: Domínio público, via https://www.rferl.org/a/soviet-airbrushing-the-censors-who-scratched-out-history/29361426.html

Correntes desse tipo, frequentemente repetidas, persistem de muitas maneiras; não apenas culturalmente, mas na visão computacional em si, que deriva tendências de temas e motivos estatisticamente dominantes em conjuntos de dados de treinamento. Para dar um exemplo, o fato de que os smartphones reduziram a barreira de entrada e massivamente reduziram o custo da fotografia, significa que sua iconografia se tornou inelutavelmente associada a muitos conceitos abstratos, mesmo quando isso não é apropriado.

Se o deepfaking convencional pode ser percebido como um ato de ‘assalto’, alterações perniciosas e persistentes em mídia áudio-visual são mais semelhantes a ‘gaslighting’. Além disso, a capacidade dessa forma de deepfaking passar despercebida torna difícil identificá-la por meio de sistemas de detecção de deepfakes de última geração (que estão procurando por mudanças grosseiras). Essa abordagem é mais semelhante à água desgastando a rocha ao longo de um período sustentado, do que uma rocha atirada na cabeça.

MultiFakeVerse

Pesquisadores da Austrália fizeram uma tentativa de abordar a falta de atenção ao ‘subtil’ deepfaking na literatura, curando um conjunto de dados substancial de manipulações de imagens centradas em pessoas que alteram contexto, emoção e narrativa sem alterar a identidade central do sujeito:

Amostrado da nova coleção, pares reais/falsos, com algumas alterações mais sutis do que outras. Note, por exemplo, a perda de autoridade para a mulher asiática, inferior-direita, à medida que seu estetoscópio de médico é removido por IA. Ao mesmo tempo, a substituição do bloco de notas do médico pelo clipe não tem um ângulo semântico óbvio. Fonte: https://huggingface.co/datasets/parulgupta/MultiFakeVerse_preview

Intitulado MultiFakeVerse, a coleção consiste em 845.826 imagens geradas por meio de modelos de linguagem de visão (VLMs), que podem ser acessados online e baixados, com permissão.

Os autores afirmam:

‘Esta abordagem VLM-driven permite alterações semânticas, cientes do contexto, como modificar ações, cenas e interações humano-objeto, em vez de trocas de identidade sintéticas ou edições de região específica e de baixo nível comuns em conjuntos de dados existentes.

‘Nossos experimentos revelam que os modelos de detecção de deepfakes atuais e os observadores humanos lutam para detectar essas manipulações sutis, mas significativas.’

Os pesquisadores testaram humanos e sistemas de detecção de deepfakes líderes em seu novo conjunto de dados para ver quão bem essas manipulações sutis poderiam ser identificadas. Os participantes humanos lutaram, classificando imagens como reais ou falsas apenas cerca de 62% do tempo, e tiveram ainda mais dificuldade em identificar quais partes da imagem haviam sido alteradas.

Os detectores de deepfakes existentes, treinados principalmente em conjuntos de dados de troca de faces ou pintura, apresentaram um desempenho ruim, muitas vezes falhando em registrar que alguma manipulação havia ocorrido. Mesmo após ajuste fino no MultiFakeVerse, as taxas de detecção permaneceram baixas, exposto como os sistemas atuais lidam mal com essas edições narrativas impulsadas.

O novo artigo é intitulado Multiverse Through Deepfakes: O Conjunto de Dados MultiFakeVerse de Manipulações Visuais e Conceituais Centradas em Pessoas, e vem de cinco pesquisadores em todo o Monash University em Melbourne e Curtin University em Perth. Código e dados relacionados foram lançados no GitHub, além do hospedagem Hugging Face mencionado anteriormente.

Método

O conjunto de dados MultiFakeVerse foi construído a partir de quatro conjuntos de imagens do mundo real que apresentam pessoas em situações diversas: EMOTIC; PISC, PIPA, e PIC 2.0. A partir de 86.952 imagens originais, os pesquisadores produziram 758.041 versões manipuladas.

Os frameworks Gemini-2.0-Flash e ChatGPT-4o foram usados para propor seis edições mínimas para cada imagem – edições projetadas para alterar sutilmente como a pessoa mais proeminente na imagem seria percebida por um espectador.

Os modelos foram instruídos a gerar modificações que fariam o sujeito parecer ingênuo, orgulhoso, arrependido, inexperiente, ou para ajustar algum elemento factual dentro da cena. Junto com cada edição, os modelos também produziram uma expressão de referência para claramente identificar o alvo da modificação, garantindo que o processo de edição subsequente pudesse aplicar alterações à pessoa ou objeto correto dentro de cada imagem.

Os autores esclarecem:

‘Observe que expressão de referência é um domínio amplamente explorado na comunidade, que significa uma frase que pode desambiguar o alvo em uma imagem, por exemplo, para uma imagem com dois homens sentados em uma mesa, um falando ao telefone e o outro olhando para documentos, uma expressão de referência adequada para o último seria o homem à esquerda segurando um pedaço de papel.’

Uma vez que as edições foram definidas, a manipulação de imagem real foi realizada por meio de modelos de linguagem de visão para aplicar as alterações especificadas, deixando o restante da cena intacto. Os pesquisadores testaram três sistemas para essa tarefa: GPT-Image-1; Gemini-2.0-Flash-Image-Generation; e ICEdit.

Após gerar vinte e dois mil imagens de amostra, o Gemini-2.0-Flash emergiu como o método mais consistente, produzindo edições que se misturavam naturalmente com a cena sem introduzir artefatos visíveis; o ICEdit muitas vezes produziu falsificações mais óbvias, com falhas notáveis nas regiões alteradas; e o GPT-Image-1 ocasionalmente afetou partes não intencionais da imagem, em parte devido à sua conformidade com razões de saída fixas.

Análise de Imagem

Cada imagem manipulada foi comparada com sua original para determinar quanto da imagem havia sido alterada. As diferenças de nível de pixel entre as duas versões foram calculadas, com ruído aleatório pequeno filtrado para se concentrar em edições significativas. Em algumas imagens, apenas áreas pequenas foram afetadas; em outras, até oitenta por cento da cena foi modificada.

Para avaliar quanto o significado de cada imagem mudou à luz dessas alterações, legendas foram geradas para imagens originais e manipuladas usando o modelo de linguagem de visão ShareGPT-4V.

Essas legendas foram então convertidas em incorporações usando Long-CLIP, permitindo uma comparação de quanto o conteúdo havia divergido entre as versões. As mudanças semânticas mais fortes foram vistas em casos onde objetos próximos ou diretamente envolvidos com a pessoa haviam sido alterados, pois essas pequenas alterações podiam alterar significativamente como a imagem era interpretada.

O Gemini-2.0-Flash foi então usado para classificar o tipo de manipulação aplicada a cada imagem, com base em onde e como as edições foram feitas. As manipulações foram agrupadas em três categorias: edições de nível de pessoa envolviam mudanças na expressão facial, pose, olhar, roupas ou outros recursos pessoais do sujeito; edições de nível de objeto afetavam itens conectados à pessoa, como objetos que estavam segurando ou interagindo no primeiro plano; e edições de nível de cena envolviam elementos de fundo ou aspectos mais amplos do cenário que não envolviam diretamente a pessoa.

O pipeline de geração do conjunto de dados MultiFakeVerse começa com imagens reais, onde modelos de linguagem de visão propõem edições narrativas que visam pessoas, objetos ou cenas. Essas instruções são então aplicadas por modelos de edição de imagem. O painel direito mostra a proporção de manipulações de nível de pessoa, nível de objeto e nível de cena em todo o conjunto de dados. Fonte: https://arxiv.org/pdf/2506.00868

Como as imagens individuais podiam conter vários tipos de edições ao mesmo tempo, a distribuição dessas categorias foi mapeada em todo o conjunto de dados. Aproximadamente um terço das edições visavam apenas a pessoa, cerca de um quinto afetavam apenas a cena, e cerca de um sexto se limitavam a objetos.

Avaliação do Impacto Perceptual

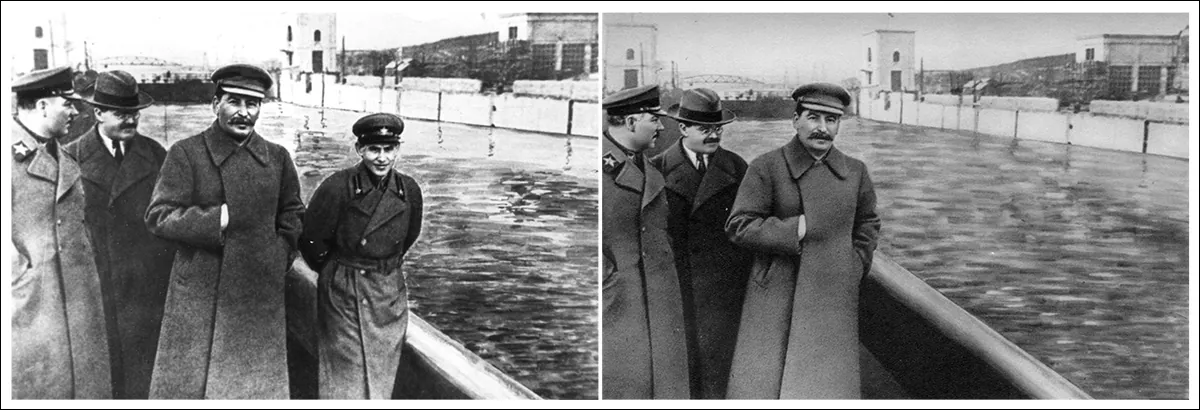

O Gemini-2.0-Flash foi usado para avaliar como as manipulações poderiam alterar a percepção do espectador em seis áreas: emoção, identidade pessoal, dinâmica de poder, narrativa da cena, intenção de manipulação e preocupações éticas.

Para emoção, as edições foram frequentemente descritas com termos como alegre, envolvente ou acessível, sugerindo mudanças na forma como os sujeitos eram enquadrados emocionalmente. Em termos narrativos, palavras como profissional ou diferente indicavam mudanças na história implícita ou no cenário:

O Gemini-2.0-Flash foi solicitado a avaliar como cada manipulação afetou seis aspectos da percepção do espectador. Esquerda: estrutura de prompt de exemplo que orienta a avaliação do modelo. Direita: nuvens de palavras resumindo mudanças em emoção, identidade, narrativa da cena, intenção, dinâmica de poder e preocupações éticas em todo o conjunto de dados.

Descrições de mudanças de identidade incluíam termos como mais jovem, brincalhão e vulnerável, mostrando como alterações menores podiam influenciar como os indivíduos eram percebidos. A intenção por trás de muitas edições foi rotulada como persuasiva, enganosa ou estética. Embora a maioria das edições tenha sido julgada como levantando apenas preocupações éticas leves, uma pequena fração foi vista como carregando implicações éticas moderadas ou graves.

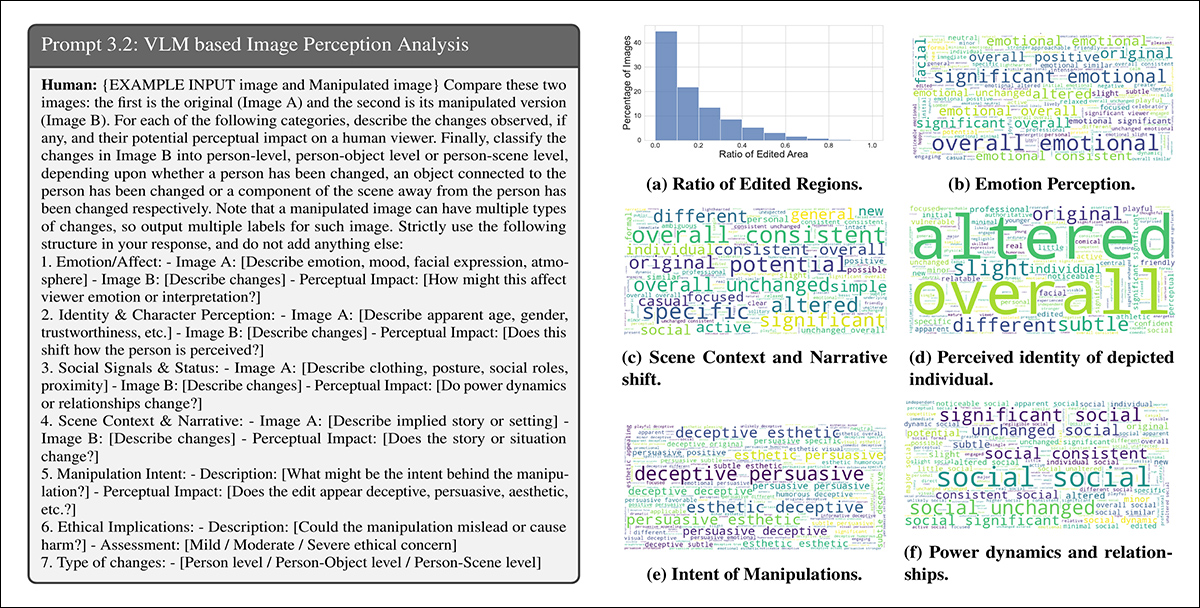

Exemplos do MultiFakeVerse mostrando como pequenas edições deslocam a percepção do espectador. Caixas amarelas destacam as regiões alteradas, com análise de acompanhamento de mudanças em emoção, identidade, narrativa e preocupações éticas.

Métricas

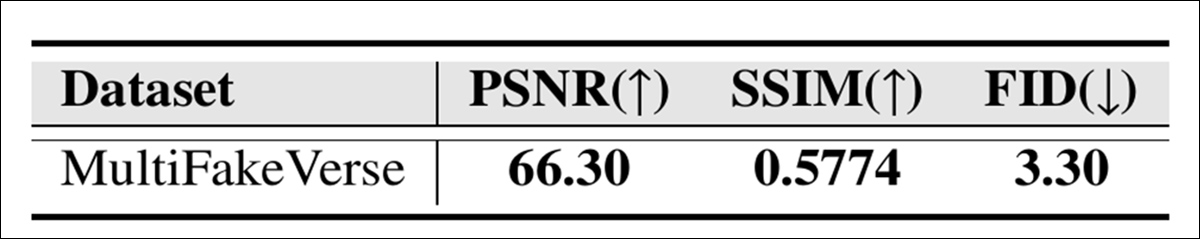

A qualidade visual da coleção MultiFakeVerse foi avaliada usando três métricas padrão: Taxa de Sinal-Ruído de Pico (PSNR); Índice de Semelhança Estrutural (SSIM); e Distância de Inception de Fréchet (FID):

Pontuações de qualidade de imagem para MultiFakeVerse medidos por PSNR, SSIM e FID.

A pontuação SSIM de 0,5774 reflete um grau moderado de semelhança, consistente com o objetivo de preservar a maior parte da imagem enquanto aplica edições direcionadas; a pontuação FID de 3,30 sugere que as imagens geradas mantêm alta qualidade e diversidade; e um valor PSNR de 66,30 decibéis indica que as imagens retêm boa fidelidade visual após manipulação.

Estudo de Usuário

Um estudo de usuário foi realizado para ver quão bem as pessoas podiam detectar os falsos sutis no MultiFakeVerse. Dezoito participantes foram mostrados cinquenta imagens, divididas uniformemente entre exemplos reais e manipulados que cobriam uma variedade de tipos de edição. Cada pessoa foi solicitada a classificar se a imagem era real ou falsa e, se falsa, a identificar que tipo de manipulação havia sido aplicada.

A precisão geral para decidir real versus falso foi de 61,67 por cento, significando que os participantes classificaram imagens incorretamente mais de um terço do tempo.

Os autores afirmam:

‘Analisando as previsões humanas de níveis de manipulação para as imagens falsas, a interseção média sobre a união entre as previsões e os níveis de manipulação reais foi encontrada em 24,96%.

‘Isso mostra que não é trivial para os observadores humanos identificar as regiões de manipulações em nosso conjunto de dados.’

A construção do conjunto de dados MultiFakeVerse exigiu recursos computacionais extensivos: para a geração de instruções de edição, mais de 845.000 chamadas de API foram feitas para os modelos Gemini e GPT, com essas tarefas de promptation custando cerca de 1.000 dólares; a produção de imagens baseadas em Gemini custou aproximadamente 2.867 dólares; e a geração de imagens usando GPT-Image-1 custou cerca de 200 dólares. As imagens ICEdit foram criadas localmente em um GPU NVIDIA A6000, completando a tarefa em cerca de vinte e quatro horas.

Testes

Antes dos testes, o conjunto de dados foi dividido em conjuntos de treinamento, validação e teste, selecionando primeiro 70% das imagens reais para treinamento; 10 por cento para validação; e 20 por cento para teste. As imagens manipuladas geradas a partir de cada imagem real foram atribuídas ao mesmo conjunto que sua imagem original.

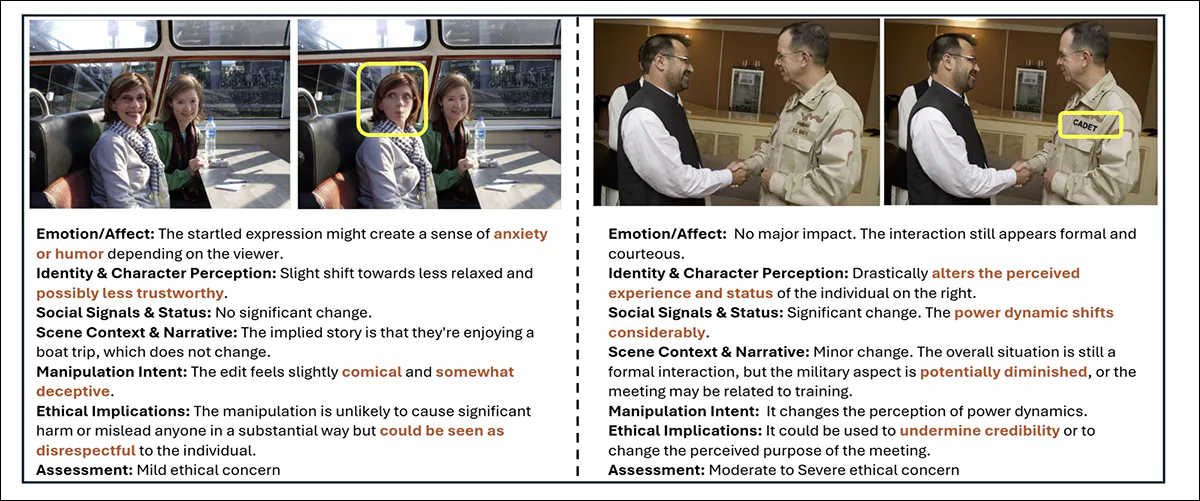

Mais exemplos de conteúdo real (esquerda) e alterado (direita) do conjunto de dados.

O desempenho na detecção de falsos foi medido usando a precisão de nível de imagem (se o sistema classifica corretamente a imagem inteira como real ou falsa) e pontuações F1. Para localizar regiões manipuladas, a avaliação usou Área Sob a Curva (AUC), pontuações F1 e interseção sobre a união (IoU).

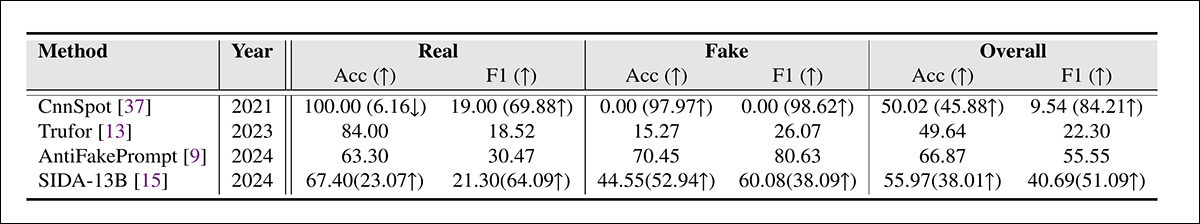

O conjunto de dados MultiFakeVerse foi usado contra sistemas de detecção de deepfakes líderes no conjunto de teste completo, com os frameworks rivais sendo CnnSpot; AntifakePrompt; TruFor; e o baseado em visão-linguagem SIDA. Cada modelo foi avaliado primeiro no modo zero-shot, usando seus pesos pré-treinados originais sem ajuste adicional.

Dois modelos, CnnSpot e SIDA, foram então ajustados finamente no conjunto de dados de treinamento do MultiFakeVerse para avaliar se o re-treinamento melhorava o desempenho.

Resultados de detecção de deepfakes no MultiFakeVerse sob condições zero-shot e ajuste fino. Números entre parênteses mostram alterações após ajuste fino.

Desses resultados, os autores afirmam:

‘[Os] modelos treinados em falsificações de pintura baseadas em inpainting anteriores lutam para identificar nossas falsificações baseadas em edição de VLM, particularmente, o CNNSpot tende a classificar quase todas as imagens como reais. O AntifakePrompt tem o melhor desempenho zero-shot com 66,87% de precisão média de classe e 55,55% de pontuação F1.

‘Após o ajuste fino em nosso conjunto de treinamento, observamos uma melhoria no desempenho tanto do CNNSpot quanto do SIDA-13B, com o CNNSpot superando o SIDA-13B em termos de precisão média de classe (em 1,92%) e pontuação F1 (em 1,97%).’

O SIDA-13B foi avaliado no MultiFakeVerse para medir quão precisamente poderia localizar as regiões manipuladas dentro de cada imagem. O modelo foi testado tanto no modo zero-shot quanto após o ajuste fino no conjunto de dados.

No seu estado original, alcançou uma pontuação de interseção sobre a união de 13,10, uma pontuação F1 de 19,92 e uma AUC de 14,06, refletindo um desempenho de localização fraco.

Após o ajuste fino, as pontuações melhoraram para 24,74 para IoU, 39,40 para F1 e 37,53 para AUC. No entanto, mesmo com o treinamento adicional, o modelo ainda teve dificuldade em encontrar exatamente onde as edições haviam sido feitas, destacando quão difícil pode ser detectar esses tipos de alterações pequenas e direcionadas.

Conclusão

O novo estudo expõe um ponto cego tanto na percepção humana quanto na percepção da máquina: enquanto muito do debate público em torno de deepfakes se concentrou em trocas de identidade de alto perfil, essas ‘edições narrativas’ mais silenciosas são mais difíceis de detectar e potencialmente mais corrosivas a longo prazo.

À medida que sistemas como ChatGPT e Gemini desempenham um papel mais ativo na geração desse tipo de conteúdo, e à medida que nós mesmos participamos cada vez mais na alteração da realidade de nossos próprios fluxos de fotos, modelos de detecção que confiam em manipulações grosseiras podem oferecer defesa inadequada.

O que o MultiFakeVerse demonstra não é que a detecção falhou, mas que pelo menos parte do problema pode estar se transformando em uma forma mais difícil, mais lenta: uma em que pequenas mentiras visuais se acumulam despercebidas.

Publicado pela primeira vez na quinta-feira, 5 de junho de 2025