Inteligência artificial

NeRF: Treinamento de Drones em Ambientes de Radiância Neural

Pesquisadores da Universidade de Stanford desenvolveram uma nova forma de treinar drones para navegar em ambientes fotorealistas e altamente precisos, aproveitando a recente avalanche de interesse em Campos de Radiância Neural (NeRF).

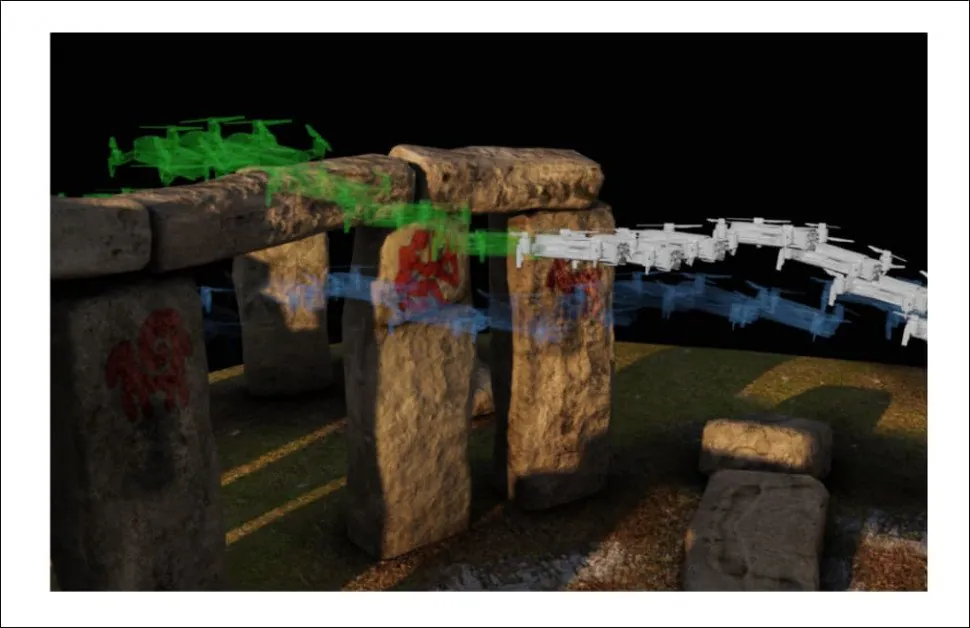

Drones podem ser treinados em ambientes virtuais mapeados diretamente de locais da vida real, sem a necessidade de reconstrução de cena 3D especializada. Nesta imagem do projeto, uma perturbação do vento foi adicionada como um obstáculo potencial para o drone, e podemos ver o drone sendo momentaneamente desviado de sua trajetória e compensando no último momento para evitar um obstáculo potencial. Fonte: https://mikh3x4.github.io/nerf-navigation/

O método oferece a possibilidade de treinamento interativo de drones (ou outros tipos de objetos) em cenários virtuais que incluem automaticamente informações de volume (para calcular a evasão de colisões), texturização extraída diretamente de fotos da vida real (para ajudar a treinar as redes de reconhecimento de imagens dos drones de forma mais realista) e iluminação do mundo real (para garantir que uma variedade de cenários de iluminação sejam treinados na rede, evitando a sobreajuste ou superotimização para a foto original da cena).

Um objeto-couch navega um ambiente virtual complexo que seria muito difícil de mapear usando captura de geometria e retexturização em fluxos de trabalho tradicionais de AR/VR, mas que foi recriado automaticamente em NeRF a partir de um número limitado de fotos. Fonte: https://www.youtube.com/watch?v=5JjWpv9BaaE

As implementações típicas de NeRF não apresentam mecanismos de trajetória, pois a maioria dos projetos NeRF nos últimos 18 meses se concentrou em outros desafios, como reiluminação de cena, renderização de reflexos, composição e desentanglement de elementos capturados.

NeRF como VR/AR

O novo artigo é intitulado Navegação de Robô por Visão em um Mundo de Radiância Neural e é uma colaboração entre três departamentos da Universidade de Stanford: Aeronáutica e Astronáutica, Engenharia Mecânica e Ciência da Computação.

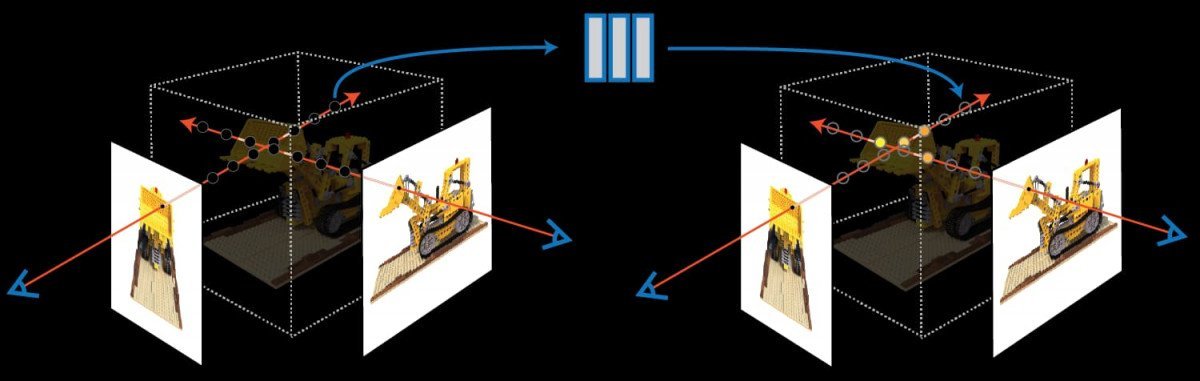

O trabalho propõe um quadro de navegação que fornece a um robô um ambiente NeRF pré-treinado, cuja densidade de volume delimita caminhos possíveis para o dispositivo. Ele também inclui um filtro para estimar onde o robô está dentro do ambiente virtual, com base no reconhecimento de imagens da câmera RGB a bordo do robô. Dessa forma, um drone ou robô é capaz de ‘visualizar’ mais precisamente o que pode esperar ver em um determinado ambiente.

O otimizador de trajetória do projeto navega por um modelo NeRF de Stonehenge que foi gerado por meio de fotogrametria e interpretação de imagens (neste caso, de modelos de malha) em um ambiente de Radiância Neural. O planejador de trajetória calcula vários caminhos possíveis antes de estabelecer uma trajetória ótima sobre o arco.

Porque um ambiente NeRF apresenta oclusões totalmente modeladas, o drone pode aprender a calcular obstruções mais facilmente, desde que a rede neural por trás do NeRF possa mapear a relação entre oclusões e a forma como os sistemas de navegação baseados em visão a bordo do drone percebem o ambiente. O pipeline de geração automática de NeRF oferece um método relativamente trivial para criar espaços de treinamento hiper-realistas com apenas algumas fotos.

A estrutura de replanejamento online desenvolvida para o projeto da Universidade de Stanford facilita um pipeline de navegação baseado em visão totalmente resiliente.

A iniciativa da Universidade de Stanford é uma das primeiras a considerar as possibilidades de explorar um espaço NeRF no contexto de um ambiente imersivo e navegável do tipo VR. Os campos de radiância neural são uma tecnologia emergente e atualmente sujeita a esforços acadêmicos múltiplos para otimizar seus requisitos de recursos de computação altos, bem como para desentrelaçar os elementos capturados.

NeRF não é (Realmente) CGI

Porque um ambiente NeRF é uma cena 3D navegável, tornou-se uma tecnologia mal compreendida desde sua emergência em 2020, frequentemente amplamente percebida como um método para automatizar a criação de malhas e texturas, em vez de substituir ambientes 3D familiares aos espectadores dos departamentos de efeitos visuais de Hollywood e das cenas fantásticas de ambientes de realidade aumentada e virtual.

NeRF extrai informações de geometria e textura de um número limitado de pontos de vista de imagem, calculando a diferença entre imagens como informações volumétricas. Fonte: https://www.matthewtancik.com/nerf

Na verdade, o ambiente NeRF é mais como um espaço de renderização ‘ao vivo’, onde uma combinação de informações de pixel e iluminação é retida e navegada em uma rede neural ativa e em execução.

A chave para o potencial do NeRF é que ele só requer um número limitado de imagens para recriar ambientes, e que os ambientes gerados contêm todas as informações necessárias para uma reconstrução de alta fidelidade, sem a necessidade dos serviços de modeladores, artistas de textura, especialistas em iluminação e das hordas de outros contribuintes para a ‘CGI tradicional’.

Segmentação Semântica

Mesmo que o NeRF constitua efetivamente ‘Imagem Gerada por Computador’ (CGI), ele oferece uma metodologia completamente diferente e um pipeline altamente automatizado. Além disso, o NeRF pode isolar e ‘encapsular’ partes móveis de uma cena, para que elas possam ser adicionadas, removidas, aceleradas e geralmente operar como facetas discretas em um ambiente virtual – uma capacidade que está muito além do estado da arte atual em uma interpretação ‘de Hollywood’ do que é a CGI.

Uma colaboração da Universidade de Tecnologia de Xangai, lançada no verão de 2021, oferece um método para individuar elementos móveis NeRF em facetas ‘coláveis’ para uma cena. Fonte: https://www.youtube.com/watch?v=Wp4HfOwFGP4

Negativamente, a arquitetura do NeRF é um pouco de uma ‘caixa preta’; não é possível atualmente extrair um objeto de um ambiente NeRF e manipulá-lo diretamente com ferramentas tradicionais baseadas em malha e imagem, embora vários esforços de pesquisa estejam começando a fazer avanços na desconstrução da matriz por trás dos ambientes de renderização ao vivo da rede neural do NeRF.

https://www.youtube.com/watch?v=5JjWpv9BaaE