Inteligência artificial

Mistral AI: Estabelecendo Novos Padrões Além do Llama2 no Espaço Open-Source

Os Grandes Modelos de Linguagem (LLMs) recentemente ocuparam o centro das atenções, graças a performers de destaque como o ChatGPT. Quando a Meta introduziu seus modelos Llama, isso despertou um interesse renovado nos LLMs open-source. O objetivo? Criar LLMs open-source acessíveis e eficientes que sejam tão bons quanto os modelos de ponta, como o GPT-4, mas sem a alta taxa ou complexidade.

Essa combinação de acessibilidade e eficiência não apenas abriu novas oportunidades para pesquisadores e desenvolvedores, mas também estabeleceu o palco para uma nova era de avanços tecnológicos no processamento de linguagem natural.

Recentemente, startups de IA gerativa têm sido bem-sucedidas em termos de financiamento. Juntas, arrecadaram $20 milhões, visando moldar a IA open-source. A Anthropic também arrecadou uma impressionante $450 milhões, e a Cohere, em parceria com a Google Cloud, garantiu $270 milhões em junho deste ano.

Introdução ao Mistral 7B: Tamanho e Disponibilidade

A Mistral AI, com sede em Paris e co-fundada por ex-alunos do Google’s DeepMind e Meta, anunciou seu primeiro grande modelo de linguagem: Mistral 7B. Esse modelo pode ser facilmente baixado por qualquer pessoa no GitHub e até mesmo por meio de um torrent de 13,4 gigabytes.

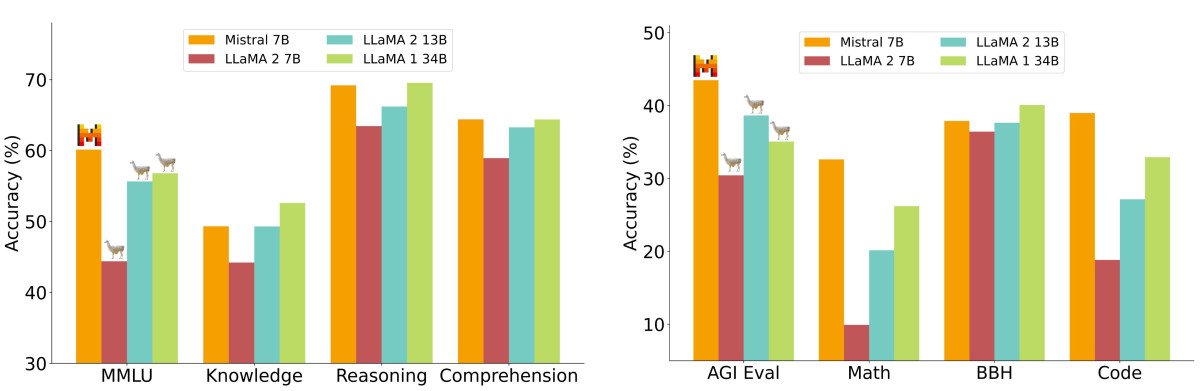

Essa startup conseguiu garantir financiamento de semente recorde mesmo antes de ter um produto lançado. O primeiro modelo da Mistral, com 7 bilhões de parâmetros, supera o desempenho do Llama 2 13B em todos os testes e supera o Llama 1 34B em muitas métricas.

Em comparação com outros modelos, como o Llama 2, o Mistral 7B fornece capacidades semelhantes ou melhores, mas com menos sobrecarga computacional. Enquanto os modelos fundamentais, como o GPT-4, podem alcançar mais, eles vêm com um custo mais alto e não são tão amigáveis ao usuário, pois são principalmente acessíveis por meio de APIs.

Quando se trata de tarefas de codificação, o Mistral 7B dá CodeLlama 7B uma corrida por seu dinheiro. Além disso, é compacto o suficiente, com 13,4 GB, para executar em máquinas padrão.

Além disso, o Mistral 7B Instruct, ajustado especificamente para conjuntos de dados instrutivos no Hugging Face, mostrou um grande desempenho. Ele supera outros modelos de 7B no MT-Bench e fica lado a lado com modelos de chat de 13B.

Hugging Face Mistral 7B Exemplo

Benchmark de Desempenho

Em uma análise detalhada de desempenho, o Mistral 7B foi medido contra os modelos da família Llama 2. Os resultados foram claros: o Mistral 7B superou substancialmente o Llama 2 13B em todos os benchmarks. Na verdade, ele igualou o desempenho do Llama 34B, especialmente se destacando em benchmarks de codificação e raciocínio.

Os benchmarks foram organizados em várias categorias, como Raciocínio Comum, Conhecimento Mundial, Compreensão de Leitura, Matemática e Codificação, entre outras. Uma observação particularmente notável foi a métrica de custo-desempenho do Mistral 7B, denominada “tamanho de modelo equivalente”. Em áreas como raciocínio e compreensão, o Mistral 7B demonstrou um desempenho semelhante a um modelo Llama 2 três vezes maior, indicando possíveis economias de memória e um aumento na taxa de transferência. No entanto, em benchmarks de conhecimento, o Mistral 7B se alinhou estreitamente com o Llama 2 13B, o que provavelmente é atribuído às limitações de parâmetros que afetam a compressão de conhecimento.

O que realmente torna o modelo Mistral 7B melhor do que a maioria dos outros Modelos de Linguagem?

Simplificando os Mecanismos de Atenção

Embora as sutilezas dos mecanismos de atenção sejam técnicas, sua ideia fundamental é relativamente simples. Imagine ler um livro e destacar frases importantes; isso é análogo a como os mecanismos de atenção “destacam” ou dão importância a pontos de dados específicos em uma sequência.

No contexto dos modelos de linguagem, esses mecanismos permitem que o modelo se concentre nas partes mais relevantes dos dados de entrada, garantindo que a saída seja coerente e contextualmente precisa.

Nos transformadores padrão, as pontuações de atenção são calculadas com a fórmula:

A fórmula para essas pontuações envolve uma etapa crucial – a multiplicação matricial de Q e K. O desafio aqui é que, à medida que o comprimento da sequência cresce, ambas as matrizes se expandem de acordo, levando a um processo computacionalmente intensivo. Essa preocupação de escalabilidade é uma das principais razões pelas quais os transformadores padrão podem ser lentos, especialmente ao lidar com sequências longas.

A atenção multi-consulta (MQA) acelera as coisas usando um conjunto de ‘cabeças de chave-valor’, mas às vezes sacrifica a qualidade. Agora, você pode se perguntar, por que não combinar a velocidade da MQA com a qualidade da atenção multi-cabeça? É aí que entra a atenção de consulta agrupada (GQA).

Atenção de Consulta Agrupada (GQA)

A GQA é uma solução intermediária. Em vez de usar apenas uma ou várias ‘cabeças de chave-valor’, ela as agrupa. Dessa forma, a GQA alcança um desempenho próximo à atenção multi-cabeça detalhada, mas com a velocidade da MQA. Para modelos como o Mistral, isso significa desempenho eficiente sem comprometer muito a qualidade.

Atenção de Janela Deslizante (SWA)

A janela deslizante é outro método usado no processamento de sequências de atenção. Esse método usa uma janela de atenção de tamanho fixo em torno de cada token na sequência. Com várias camadas empilhando essa atenção com janela, as camadas superiores eventualmente ganham uma perspectiva mais ampla, abrangendo informações de toda a entrada. Esse mecanismo é análogo aos campos receptivos vistos nas Redes Neurais Convolucionais (CNNs).

Por outro lado, a “atenção de janela deslizante dilatada” do modelo Longformer, que é conceitualmente semelhante ao método de janela deslizante, calcula apenas algumas diagonais da matriz. Essa alteração resulta em uso de memória aumentando linearmente, em vez de quadrática, tornando-a um método mais eficiente para sequências mais longas.

Transparência da Mistral AI versus Preocupações de Segurança na Descentralização

Em seu anúncio, a Mistral AI também enfatizou a transparência com a declaração: “Sem truques, sem dados proprietários.” Mas, ao mesmo tempo, seu único modelo disponível no momento, ‘Mistral-7B-v0.1’, é um modelo base pré-treinado; portanto, ele pode gerar uma resposta a qualquer consulta sem moderação, o que levanta preocupações potenciais de segurança. Enquanto modelos como GPT e Llama têm mecanismos para discernir quando responder, a natureza totalmente descentralizada da Mistral pode ser explorada por atores mal-intencionados.

No entanto, a descentralização dos Grandes Modelos de Linguagem tem seus méritos. Embora algumas pessoas possam mal utilizá-la, as pessoas podem aproveitar seu poder para o bem social e tornar a inteligência acessível a todos.

Flexibilidade de Implantação

Um dos destaques é que o Mistral 7B está disponível sob a licença Apache 2.0. Isso significa que não há barreiras reais para usá-lo – seja para fins pessoais, uma grande corporação ou até mesmo uma entidade governamental. Você só precisa do sistema certo para executá-lo, ou talvez precise investir em recursos de nuvem.

Embora existam outras licenças, como a licença MIT mais simples e a licença CC BY-SA-4.0 cooperativa, que exige crédito e licenciamento semelhante para derivados, a licença Apache 2.0 fornece uma base sólida para empreendimentos em grande escala.

Pensamentos Finais

O surgimento de Grandes Modelos de Linguagem open-source, como o Mistral 7B, sinaliza uma mudança pivotal na indústria de IA, tornando modelos de linguagem de alta qualidade acessíveis a uma audiência mais ampla. As abordagens inovadoras da Mistral AI, como a atenção de consulta agrupada e a atenção de janela deslizante, prometem desempenho eficiente sem comprometer a qualidade.

Embora a natureza descentralizada da Mistral apresente certos desafios, sua flexibilidade e licenciamento open-source enfatizam o potencial para democratizar a IA. À medida que o cenário evolui, o foco inevitavelmente estará em equilibrar o poder desses modelos com considerações éticas e mecanismos de segurança.

O que vem a seguir para a Mistral? O modelo 7B foi apenas o começo. A equipe pretende lançar modelos ainda maiores em breve. Se esses novos modelos corresponderem ao desempenho do 7B, a Mistral pode rapidamente se tornar um dos principais jogadores da indústria, tudo dentro de seu primeiro ano.