Líderes de pensamento

Agentes Autônomos Precisam de Mais do que Observabilidade de IA

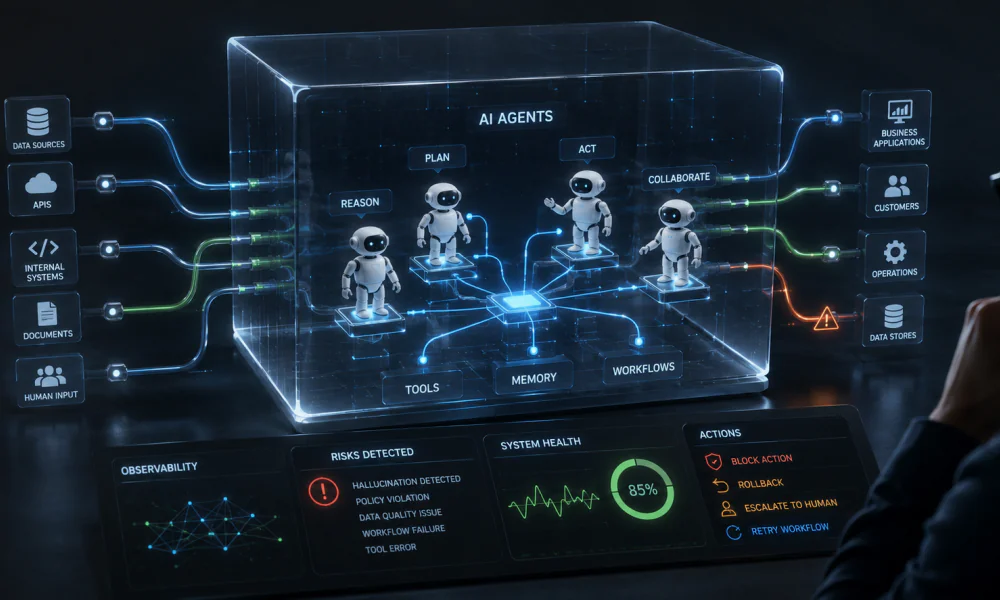

À medida que as empresas usam agentes de IA para pensar, agir e iniciar fluxos de trabalho, é imperativo desenvolver um plano para monitorar e gerenciar esses agentes.

Quando vários componentes de um sistema de IA começam a tomar suas próprias decisões, a observabilidade sozinha não é suficiente para garantir que as operações permaneçam estáveis, seguras ou confiáveis.

Para gerenciar eficazmente os agentes de IA em toda a empresa, as empresas devem superar a lacuna entre a identificação de problemas e a ação. Isso vai além de simplesmente observar problemas; as empresas devem ativamente prevenir esses problemas.

A emergência de agentes autônomos

A primeira onda de IA empresarial foi baseada em sistemas de prompt; um usuário fazia uma pergunta, o modelo respondia e a troca terminava ali. Embora essas tecnologias iniciais fossem essencialmente reativas, elas foram úteis para busca, copilotos, criação de conteúdo e resumo.

A onda subsequente é diferente. Não apenas os agentes de IA autônomos reagem, mas também raciocinam sobre objetivos, selecionam ferramentas, extraem informações, tomam ações e iniciam fluxos de trabalho. Eles às vezes trabalham em conjunto com outros agentes ou sistemas e cada vez mais servem como jogadores operacionais dentro da empresa, em vez de uma camada de interface para instruções humanas.

Essa mudança é significativa porque afeta as características operacionais da IA. As equipes não estão mais apenas observando as saídas dos modelos. Em vez disso, elas estão gerenciando sistemas dinâmicos que podem afetar instantaneamente clientes, funcionários, infraestrutura, processos de negócios e outros aplicativos.

As capacidades dos agentes hoje

As habilidades dos agentes evoluem junto com eles. Os agentes podem selecionar o que fazer em seguida, dividir um objetivo em etapas e completar atividades em vários níveis. Ao contatar APIs, consultar bancos de dados, pesquisar sistemas internos, atualizar registros e iniciar ações downstream, eles coordenam fluxos de trabalho. Ao integrar prompts, memória, regras de negócios, informações recuperadas e sinais operacionais em tempo real, os agentes também podem fazer julgamentos baseados no contexto.

Agentes mais sofisticados podem identificar quando um fluxo de trabalho está falhando, tentar novamente, escalar problemas ou encaminhar trabalhos para um revisor humano. Dentro de CRM, ticketing, infraestrutura de nuvem, bases de conhecimento internas, plataformas de observabilidade e aplicativos de negócios, os agentes podem funcionar de forma independente. Antecipamos que essas habilidades continuarão a expandir-se rapidamente.

Como as empresas estão integrando agentes de IA autônomos

Os agentes estão sendo incorporados a uma gama crescente de operações organizacionais e estão se aproximando de processos operacionais onde velocidade, precisão, segurança e governança são importantes. Algumas dessas operações incluem: atendimento ao cliente e manipulação de casos, resposta a incidentes e operações de TI, fluxos de trabalho para DevOps e dependência de sites, correção de código e desenvolvimento de software, planejamento operacional e de cadeia de suprimentos, e muito mais.

Ameaças operacionais emergentes

No entanto, à medida que os agentes se tornam cada vez mais independentes, as empresas devem lidar com um novo tipo de risco operacional.

- Escolhas ruins não são apenas aconselhadas; elas são frequentemente executadas

- Erros menores podem se espalhar rapidamente para outros sistemas conectados

- Ações no mundo real podem ser desencadeadas por alucinações

- Os agentes podem se desviar da intenção, política ou conformidade da empresa

- Interações entre vários componentes podem resultar em falhas

- Tomada de decisão automatizada pode tomar decisões mais rápido do que a avaliação humana

Embora as equipes possam observar sintomas, elas também devem ser capazes de entender as razões por trás do comportamento do sistema. A IA empresarial precisa de controles de confiabilidade além da visibilidade.

Complexidades dos sistemas de IA

Os sistemas de IA impulsionados de hoje raramente são um único modelo. Eles são sistemas distribuídos e em camadas, compostos por muitos componentes interativos que incluem:

- Modelos fundamentais (LLMs)

- Modelos de linguagem pequenos ajustados ou específicos de tarefa (SLMs)

- Modelos de incorporação

- Bancos de dados de vetores

- Pipelines de recuperação e componentes RAG

- Modelos de template de prompt e camadas de orquestração de prompt

- Conjuntos de dados de treinamento e avaliação

- Camadas de guardrails e política

- Agentes e fluxos de trabalho

- Sistemas de chamada de ferramentas

- Telemetria (também conhecida como logs, métricas e traços)

- Pontos de verificação de aprovação humanos no loop

Seus riscos

Cada componente adiciona um modo de falha diferente, e a forma como eles interagem adiciona mais complexidade. Mesmo que um sistema pareça forte na camada de infraestrutura, ele ainda pode tomar más decisões e gerar resultados satisfatórios; tudo enquanto constrói risco operacional abaixo da superfície.

Alguns dos riscos associados incluem: a introdução de entradas ruins ou corrompidas por pipelines de dados, gargalos de infraestrutura que reduzem a confiabilidade, resultados prejudiciais ou errôneos e gargalos operacionais em resposta à revisão humana. Além disso, sistemas com vários agentes ou etapas podem falhar de maneiras que não são imediatamente aparentes.

Observabilidade de IA

A monitoração tradicional é insuficiente para entender o comportamento de prompt, a qualidade de recuperação, a deriva do modelo, os canais de execução do agente ou a conexão entre o comportamento da IA e o impacto operacional ou de negócios downstream.

É aí que entra a observabilidade de IA. A observabilidade de IA permite que as equipes entendam como os sistemas de IA funcionam em produção, coletando, correlacionando e avaliando entradas e saídas, comportamentos desejados e sinais de decisão gerados por esses sistemas. Isso é essencial, porque os sistemas de IA são dispersos, não determinísticos e extremamente sensíveis ao contexto.

A observabilidade de IA oferece visão geral dos fluxos de trabalho de IA, para que as equipes que a utilizam possam entender como prompts, modelos, camadas de recuperação, ferramentas e sistemas downstream interagem durante a execução.

A observabilidade de IA permite monitorar o desempenho e o comportamento, incluindo latência, custo, uso de tokens, taxa de transferência, taxas de erro, indicadores de qualidade de saída do modelo e comportamento. Ela rastreia e analisa os caminhos de execução em fluxos de trabalho de agente complexos e demonstra como os resultados são alcançados em várias etapas e dependências.

A observabilidade de IA também encontra anomalias em sinais operacionais e de IA, expondo comportamento anormal em modelos, pipelines, infraestrutura ou resultados de usuário antes que as equipes os descubram manualmente. Ela acelera a diagnóstico quando algo dá errado e facilita as investigações de causa raiz, incluindo operações específicas de IA na telemetria do sistema (logs, métricas, traços e eventos).

A observabilidade sozinha não é suficiente

Apesar de ser uma prática de negócios essencial, a observabilidade de IA tem limitações inerentes.

A observabilidade é diagnóstica, e não preventiva; as equipes podem aprender o que deu errado, mas não necessariamente como impedi-lo de acontecer novamente. É importante entender que o conhecimento das ações passadas de um agente não se traduz automaticamente em controle sobre as ações futuras do agente.

Quando se trata de sistemas complexos e não determinísticos, a observabilidade pode frequentemente sobrecarregar as equipes com dados que levam à incerteza. Em vez de oferecer uma resposta operacional, a observabilidade frequentemente termina em uma explicação. Mesmo quando as equipes estão cientes de um problema, elas podem não ter a automação, as salvaguardas e os loops de controle necessários para tomar medidas corretivas.

Isso cria uma lacuna operacional. As empresas podem ser capazes de detectar deriva, resultados ruins, comportamento perigoso ou produtividade degradada, mas elas ainda podem não ser capazes de impedi-los de acontecer novamente, mitigar seus efeitos ou manter sistemas autônomos dentro de parâmetros de operação seguros.

Isso significa que as equipes continuam a operar de forma reativa. Elas usam intervenção manual quando algo quebra, investigam incidentes após o fato e dependem do trabalho humano para compensar sistemas que estão se tornando mais rápidos e autônomos.

Visão geral da confiabilidade de IA

A confiabilidade de IA vai além de apenas observar problemas. É a disciplina de garantir que os sistemas de IA funcionem de forma segura, consistente, previsível e bem-sucedida em contextos de produção do mundo real. A confiabilidade de IA compreende e gerencia o sistema completo de sistemas em torno da IA. Ela fecha o loop entre detecção e ação.

A confiabilidade de IA se concentra em se o sistema de IA como um todo pode funcionar dentro de limites operacionais razoáveis ao longo do tempo, em vez de apenas se um modelo forneceu uma resposta precisa. Qualidade, segurança, resiliência, explicabilidade, conformidade com políticas, eficiência de custo e estabilidade operacional fazem parte da equação.

A transição da detecção para a prevenção

A confiabilidade de IA reduz o tempo entre o reconhecimento de um problema e a solução. Ela muda a conversa de “o que deu errado?” para “quão rápido nossa IA melhorará?” Empregar as seguintes técnicas move a observabilidade de observação passiva para prevenção proativa:

- Correlacionar sinais em modelos, dados e infraestrutura para identificar problemas

- Detecção proativa de problemas antes do impacto

- Verificar todas as entradas e saídas em sistemas de IA probabilísticos para detectar mudanças comportamentais sutis

- Criar um loop de feedback entre a detecção de saída indesejada em produção e o uso dessa saída para gerar dados de ajuste fino que melhoram a precisão dos modelos subjacentes

- Rastreamento de fluxo de trabalho de agente múltiplo para garantir que você possa conectar os pontos sobre por que e como os dados evoluíram para informar ações complexas

- Fluxos de trabalho de agente humanos no loop definidos para resposta segura e remediação automatizada

Fechar a lacuna entre controle e observação

As empresas se beneficiam de estruturas que integram visibilidade e controle e exigem mais do que apenas uma camada de observabilidade em cima da IA gerativa. Em sistemas determinísticos e não determinísticos, uma plataforma de confiabilidade pode identificar, antecipar, explicar e ajudar a controlar problemas.

O seguinte deve ser incluído em uma estrutura viável para operações de IA confiáveis:

- Telemetria integrada para sistemas de TI e de IA

- Rastreamento de fluxo de trabalho de agente e dependência de sistema de ponta a ponta

- Rastreamento de comportamento e qualidade de IA específico (prompts e avaliações)

- Detecção de anomalias avançada, independentemente da fonte

- Raciocínio causal e análise de causa raiz

- Alertas que se adaptam automaticamente ao seu ambiente e não exigem limiares manuais

- Enforcement de política e guardrails

- Avaliação humana de ações delicadas ou significativas no loop

- Automação de fluxos de trabalho e coordenação de remediação

- Uso de análise preditiva para prevenir problemas

- Loops de feedback que conectam detecção de anomalias com melhoria da qualidade do modelo de IA

Facilitando funções de IA

Os sistemas de IA dependem de infraestrutura, serviços, pipelines de dados e rotinas operacionais; eles não falham sozinhos. As equipes obtêm a visão geral quando a confiabilidade de IA e de TI são combinadas.

Um invólucro LLM fino não deve ser a base de uma plataforma confiável. Para identificar e corrigir problemas que outras ferramentas de IA gerativa apenas ignoram, uma variedade de técnicas de IA deve ser considerada, incluindo IA não supervisionada, IA preditiva, IA causal e IA gerativa. Essa combinação de técnicas é comumente conhecida como “IA composta”.

A IA gerativa é boa em resumir linguagem natural. Ela é mais adequada para situações que exigem raciocínio sobre dados não estruturados ou quando interagindo com humanos. Mas isso não se encaixa na forma da maioria dos problemas de confiabilidade em produção.

A IA preditiva se concentra em identificar sinais precoces antes que eles se tornem falhas, más experiências do cliente ou falhas caras, usando algoritmos de detecção de anomalias.

A IA causal ajuda a determinar as verdadeiras causas raiz para revelar se a qualidade de recuperação, o comportamento do modelo, a lentidão da infraestrutura, a deriva de dados upstream ou a falha do sistema downstream foi a causa de uma queda de desempenho.

A IA não supervisionada descobre padrões, estruturas ou anomalias ocultas em dados sem orientação humana. Ela supera a IA gerativa para confiabilidade porque se concentra em encontrar estruturas ocultas dentro de dados complexos e não classificados para agrupar itens semelhantes ou encontrar relacionamentos.

Quando o risco, a ambiguidade ou os efeitos comerciais são significativos, os agentes de IA operacionais devem ser capazes de automatizar a reação enquanto mantêm a participação humana para operações confiáveis.

A compreensão do modelo de IA sobre o contexto comercial específico pode ser aprimorada em cada encontro, usando aprendizado por reforço a partir de dados de usuário reais em produção.

Mesmo os sistemas mais avançados vão além dos alertas; a remediação de loop fechado aprende com cada incidente ao longo do tempo, automatiza reações reconhecidas e inicia medidas seguras.

Preparando-se para sistemas de IA autônomos

As empresas podem se preparar para sistemas de IA autônomos de várias maneiras. Em primeiro lugar, os agentes devem ser vistos como sistemas operacionais, e não como instrumentos de produtividade. Uma vez que um agente tenha a capacidade de agir, ele se torna uma parte integral das operações da empresa e deve ser regulamentado adequadamente.

As equipes podem registrar sinais de modelos, prompts, ferramentas, fluxos de trabalho, infraestrutura e resultados de usuário imediatamente, instrumentando os agentes. Essa vigilância básica não deve e não deve ser adiada até que os agentes se tornem essenciais para a empresa.

Estabelecer padrões de confiabilidade antes do amplo deploy de agentes também é crucial. Em vez de ser introduzido após o fato, limiares aceitáveis para segurança, latência, taxas de erro, risco de alucinação, conformidade com políticas e impacto comercial devem ser incorporados em seu design.

Vincular o comportamento da IA aos sistemas e procedimentos subjacentes que o suportam permite que as empresas integrem operações de IA e de TI. Usar ferramentas diferentes para monitorar infraestrutura e modelos cria pontos cegos.

Engenharia de plataforma, SRE, segurança, equipes de dados, equipes de IA e proprietários de negócios devem trabalhar juntos para fornecer operações de IA confiáveis, e sistemas autônomos transcendem silos convencionais.

Cada incidente, anomalia e quase-acidente melhorará o sistema, incorporando loops de feedback nas operações, permitindo que as empresas aprendam continuamente com o comportamento de produção.

Por fim, é crucial selecionar plataformas projetadas para controle, e não apenas para observação. As empresas se beneficiarão de sistemas que integram observabilidade, previsão, explicação e ação à medida que os agentes de IA se tornam mais autônomos. As organizações que fazem a transição com sucesso de identificar problemas para controlar resultados de forma segura serão as vencedoras.

O resumo

A IA nas empresas agora é um sistema operacional em ambientes empresariais, em vez de uma ferramenta. Em contextos de produção do mundo real, adicionar confiabilidade aos sistemas de IA garante operações seguras, consistentes, previsíveis e eficientes.