Inteligência artificial

Menos é Mais: Por Que Recuperar Menos Documentos Pode Melhorar as Respostas da IA

Retrieval-Augmented Generation (RAG) é uma abordagem para construir sistemas de IA que combina um modelo de linguagem com uma fonte de conhecimento externa. Em termos simples, a IA primeiro procura por documentos relevantes (como artigos ou páginas da web) relacionados a uma consulta do usuário e, em seguida, usa esses documentos para gerar uma resposta mais precisa. Esse método tem sido celebrado por ajudar grandes modelos de linguagem (LLMs) a permanecerem factuais e reduzir alucinações, fundamentando suas respostas em dados reais.

Intuitivamente, pode-se pensar que, quanto mais documentos a IA recuperar, melhor informada será sua resposta. No entanto, pesquisas recentes sugerem uma reviravolta surpreendente: quando se trata de fornecer informações a uma IA, às vezes menos é mais.

Menos Documentos, Melhores Respostas

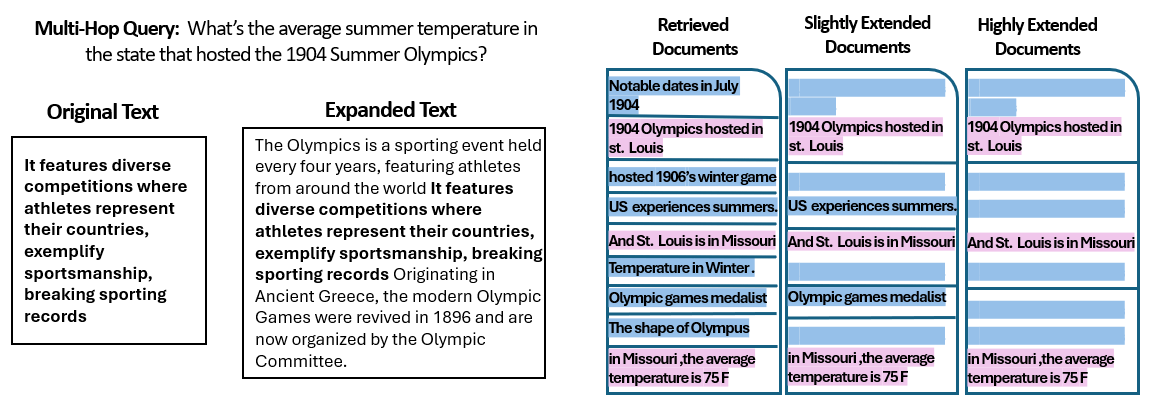

Um novo estudo realizado por pesquisadores da Universidade Hebraica de Jerusalém explorou como o número de documentos fornecidos a um sistema RAG afeta seu desempenho. Crucialmente, eles mantiveram a quantidade total de texto constante – significando que, se menos documentos fossem fornecidos, esses documentos eram ligeiramente expandidos para preencher o mesmo comprimento que muitos documentos teriam. Dessa forma, qualquer diferença de desempenho poderia ser atribuída à quantidade de documentos, e não simplesmente por ter uma entrada mais curta.

Os pesquisadores usaram um conjunto de dados de resposta a perguntas (MuSiQue) com perguntas de trivia, cada uma originalmente emparelhada com 20 parágrafos do Wikipedia (apenas alguns dos quais realmente contêm a resposta, com o restante sendo distratores). Ao reduzir o número de documentos de 20 para apenas 2-4 verdadeiramente relevantes – e preenchendo esses com um pouco de contexto extra para manter um comprimento consistente –, eles criaram cenários nos quais a IA tinha menos peças de material para considerar, mas ainda assim aproximadamente a mesma quantidade total de palavras para ler.

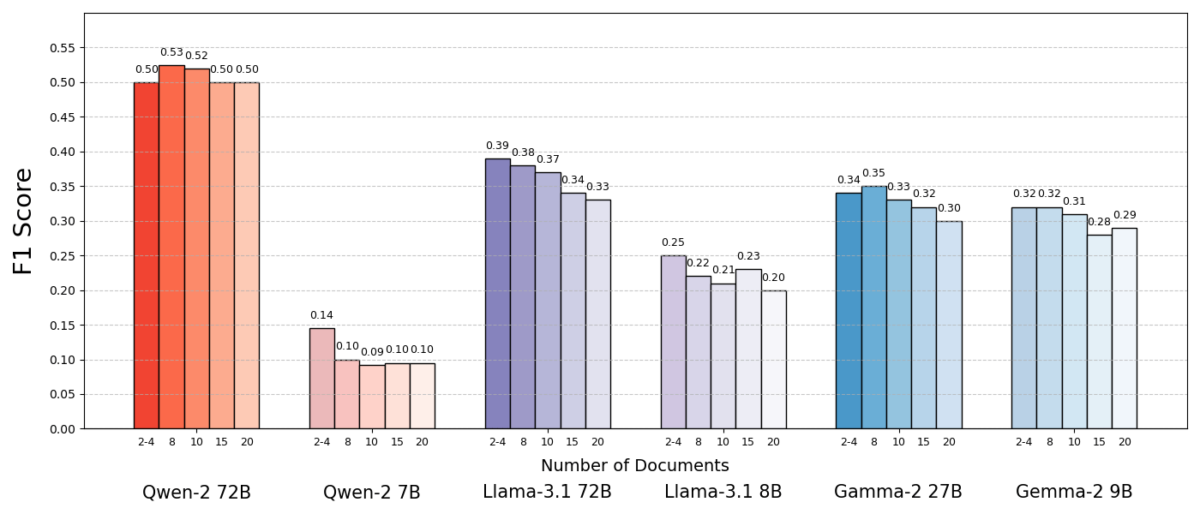

Os resultados foram surpreendentes. Na maioria dos casos, os modelos de IA responderam com mais precisão quando lhes foram fornecidos menos documentos em vez do conjunto completo. O desempenho melhorou significativamente – em alguns casos, até 10% na precisão (pontuação F1) quando o sistema usou apenas os poucos documentos de suporte em vez de uma grande coleção. Esse aumento contraintuitivo foi observado em vários modelos de linguagem de código aberto diferentes, incluindo variantes do Llama da Meta e outros, indicando que o fenômeno não está ligado a um modelo de IA específico.

Um modelo (Qwen-2) foi uma exceção notável que lidou com vários documentos sem perda de pontuação, mas quase todos os modelos testados se saíram melhor com menos documentos no geral. Em outras palavras, adicionar mais material de referência além das peças relevantes realmente prejudicou seu desempenho mais frequentemente do que o ajudou.

Fonte: Levy et al.

Por que isso é tão surpreendente? Tipicamente, os sistemas RAG são projetados sob a suposição de que recuperar uma faixa mais ampla de informações só pode ajudar a IA – afinal, se a resposta não estiver nos primeiros documentos, pode estar no décimo ou vigésimo.

Este estudo inverte esse roteiro, demonstrando que empilhar indiscriminadamente documentos extras pode ter efeitos colaterais. Mesmo quando o comprimento total do texto foi mantido constante, a mera presença de muitos documentos diferentes (cada um com seu próprio contexto e peculiaridades) tornou a tarefa de resposta a perguntas mais desafiadora para a IA. Parece que, além de um certo ponto, cada documento adicional introduziu mais ruído do que sinal, confundindo o modelo e prejudicando sua capacidade de extrair a resposta correta.

Por Que Menos Pode Ser Mais em RAG

Esse resultado de “menos é mais” faz sentido quando consideramos como os modelos de linguagem de IA processam informações. Quando uma IA é fornecida apenas com os documentos mais relevantes, o contexto que ela vê é focado e livre de distrações, muito como um estudante que foi entregue apenas as páginas certas para estudar.

No estudo, os modelos se saíram significativamente melhor quando lhes foram fornecidos apenas os documentos de suporte, com material irrelevante removido. O contexto restante não era apenas mais curto, mas também mais limpo – continha fatos que apontavam diretamente para a resposta e nada mais. Com menos documentos para manipular, o modelo podia dedicar sua atenção total às informações pertinentes, tornando-o menos provável que se desviasse ou se confundisse.

Por outro lado, quando muitos documentos foram recuperados, a IA teve que vasculhar uma mistura de conteúdo relevante e irrelevante. Muitas vezes, esses documentos extras eram “semelhantes, mas não relacionados” – poderiam compartilhar um tópico ou palavras-chave com a consulta, mas não conter a resposta. Tal conteúdo pode enganar o modelo. A IA pode gastar esforço tentando conectar pontos entre documentos que não levam a uma resposta correta ou, pior, pode mesclar informações de múltiplas fontes de forma incorreta. Isso aumenta o risco de alucinações – instâncias em que a IA gera uma resposta que soa plausível, mas não está fundamentada em nenhuma fonte única.

Em essência, fornecer muitos documentos ao modelo pode diluir as informações úteis e introduzir detalhes conflitantes, tornando mais difícil para a IA decidir o que é verdade.

Interessantemente, os pesquisadores descobriram que, se os documentos extras fossem obviamente irrelevantes (por exemplo, texto aleatório e não relacionado), os modelos eram melhores em ignorá-los. O verdadeiro problema vem de dados distrativos que parecem relevantes: quando todos os textos recuperados estão sobre tópicos semelhantes, a IA assume que deve usá-los todos, e pode ter dificuldade em dizer quais detalhes são realmente importantes. Isso está alinhado com a observação do estudo de que distratores aleatórios causaram menos confusão do que distratores realistas na entrada. A IA pode filtrar fora o disparate óbvio, mas informações ligeiramente fora do tópico são uma armadilha sutil – elas se infiltram sob a aparência de relevância e descarrilham a resposta. Ao reduzir o número de documentos para apenas os verdadeiramente necessários, evitamos armadilhas dessas de antemão.

Há também um benefício prático: recuperar e processar menos documentos reduz a sobrecarga computacional para um sistema RAG. Cada documento que é puxado tem que ser analisado (incorporado, lido e atendido pelo modelo), o que usa tempo e recursos computacionais. Eliminar documentos supérfluos torna o sistema mais eficiente – ele pode encontrar respostas mais rapidamente e a um custo mais baixo. Em cenários onde a precisão melhorou ao se concentrar em menos fontes, temos uma vitória dupla: respostas melhores e um processo mais enxuto e eficiente.

Fonte: Levy et al.

Reavaliando RAG: Direções Futuras

Essa nova evidência de que a qualidade frequentemente supera a quantidade na recuperação tem implicações importantes para o futuro dos sistemas de IA que dependem de conhecimento externo. Isso sugere que os designers de sistemas RAG devem priorizar a filtragem inteligente e o ranqueamento de documentos sobre a mera quantidade. Em vez de buscar 100 passagens possíveis e esperar que a resposta esteja enterrada em algum lugar, pode ser mais sábio buscar apenas as poucas passagens mais relevantes.

Os autores do estudo enfatizam a necessidade de métodos de recuperação “equilibrarem relevância e diversidade” nas informações que fornecem ao modelo. Em outras palavras, queremos fornecer cobertura suficiente do tópico para responder à pergunta, mas não tanto que os fatos centrais sejam afogados em um mar de texto extraneous.

À medida que avançamos, os pesquisadores provavelmente explorarão técnicas que ajudem os modelos de IA a lidar com múltiplos documentos de forma mais elegante. Uma abordagem é desenvolver sistemas de recuperação ou reclassificadores melhores que possam identificar quais documentos realmente adicionam valor e quais apenas introduzem conflito. Outro ângulo é melhorar os próprios modelos de linguagem: se um modelo (como o Qwen-2) conseguiu lidar com muitos documentos sem perder precisão, examinar como ele foi treinado ou estruturado poderia oferecer pistas para tornar outros modelos mais robustos. Talvez os futuros grandes modelos de linguagem incorporem mecanismos para reconhecer quando duas fontes estão dizendo a mesma coisa (ou se contradizendo) e se concentrar adequadamente. O objetivo seria permitir que os modelos utilizem uma rica variedade de fontes sem cair na confusão – efetivamente obtendo o melhor de ambos os mundos (amplitude de informações e clareza de foco).

Também é digno de nota que, à medida que os sistemas de IA ganham janelas de contexto maiores (a capacidade de ler mais texto de uma vez), simplesmente despejar mais dados no prompt não é uma bala de prata. Um contexto maior não significa automaticamente melhor compreensão. Este estudo mostra que, mesmo que uma IA possa tecnicamente ler 50 páginas de uma vez, fornecer 50 páginas de informações de qualidade mista pode não produzir um bom resultado. O modelo ainda se beneficia de ter conteúdo curado e relevante para trabalhar, em vez de um despejo indiscriminado. De fato, a recuperação inteligente pode se tornar ainda mais crucial na era de janelas de contexto gigantes – para garantir que a capacidade extra seja usada para conhecimento valioso, e não para ruído.

As descobertas do “Mais Documentos, Mesmo Comprimento” (o paper apropriadamente intitulado) incentivam uma reavaliação de nossas suposições na pesquisa de IA. Às vezes, alimentar uma IA com todos os dados que temos não é tão eficaz quanto pensamos. Ao nos concentrarmos nas peças de informação mais relevantes, não apenas melhoramos a precisão das respostas geradas pela IA, mas também tornamos os sistemas mais eficientes e fáceis de confiar. É uma lição contraintuitiva, mas com ramificações emocionais: os futuros sistemas RAG podem ser tanto mais inteligentes quanto mais enxutos, escolhendo cuidadosamente menos documentos, mas melhores, para recuperar.