Inteligência artificial

GOTCHA– Um Sistema CAPTCHA para Deepfakes ao Vivo

Nova pesquisa da Universidade de Nova York acrescenta às crescentes indicações de que podemos ter que fazer o equivalente a um “teste de embriaguez” para nos autenticar, antes de iniciar uma chamada de vídeo sensível – como uma videoconferência relacionada ao trabalho, ou qualquer outro cenário sensível que possa atrair fraudadores que usem software de transmissão de deepfakes em tempo real.

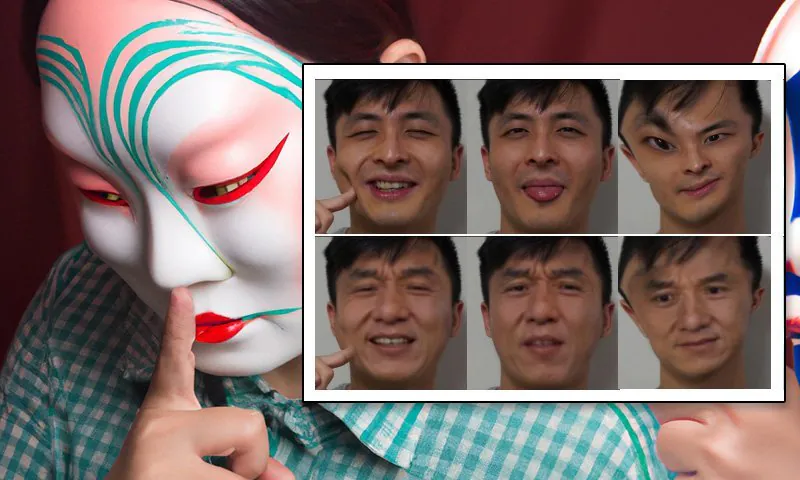

Alguns dos desafios ativos e passivos aplicados a cenários de chamadas de vídeo no GOTCHA. O usuário deve cumprir e passar nos desafios, enquanto métodos ‘passivos’ adicionais (como tentar sobrecarregar um possível sistema de deepfake) são usados sobre os quais o participante não tem influência. Fonte: http://export.arxiv.org/pdf/2210.06186

O sistema proposto é intitulado GOTCHA – uma homenagem aos sistemas CAPTCHA que se tornaram um obstáculo crescente para a navegação na web nos últimos 10-15 anos, nos quais sistemas automatizados exigem que o usuário realize tarefas que as máquinas são ruins em realizar, como identificar animais ou decifrar texto distorcido (e, ironicamente, esses desafios requentemente transformam o usuário em um annotador de estilo AMT gratuito).

Em essência, o GOTCHA estende o papel de agosto de 2022 DF-Captcha da Universidade Ben-Gurion, que foi o primeiro a propor que a pessoa no outro lado da chamada pulasse por alguns arcos visuais semânticos para provar sua autenticidade.

O papel de agosto de 2022 da Universidade Ben Gurion propôs primeiro uma série de testes interativos para o usuário, incluindo ocultar o rosto ou até mesmo deprimir a pele – tarefas que mesmo sistemas de deepfake ao vivo bem treinados podem não ter antecipado ou ser capazes de lidar com fotorealismo. Fonte: https://arxiv.org/pdf/2208.08524.pdf

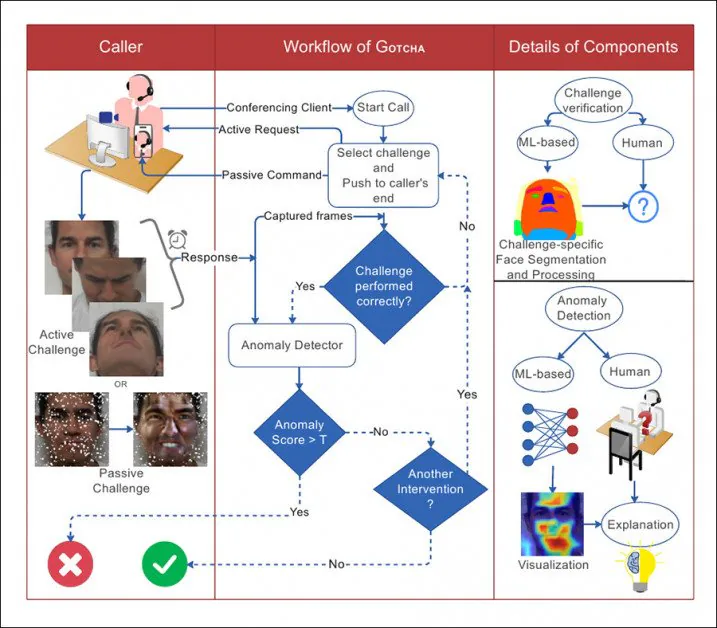

Notavelmente, o GOTCHA adiciona metodologias ‘passivas’ a uma ‘cascata’ de testes propostos, incluindo a superposição automática de elementos irreais sobre o rosto do usuário e a ‘sobrecarga’ de quadros que passam pelo sistema de origem. No entanto, apenas as tarefas responsivas do usuário podem ser avaliadas sem permissões especiais para acessar o sistema local do usuário – o que, presumivelmente, viria na forma de módulos ou complementos locais para sistemas populares como Skype e Zoom, ou até mesmo na forma de software proprietário dedicado especificamente para eliminar os falsificadores.

Do papel, uma ilustração da interação entre o chamador e o sistema no GOTCHA, com linhas tracejadas como fluxos de decisão.

Os pesquisadores validaram o sistema em um novo conjunto de dados contendo mais de 2,5 milhões de quadros de vídeo de 47 participantes, cada um realizando 13 desafios do GOTCHA. Eles afirmam que a estrutura induz uma ‘redução consistente e mensurável’ na qualidade do conteúdo de deepfake para usuários fraudulentos, sobrecarregando o sistema local até que artefatos evidentes se tornem claros para o olho humano nu (embora o GOTCHA também contenha alguns métodos de análise algorítmica mais sutis).

O novo papel é intitulado Gotcha: Um Sistema de Resposta a Desafios para Detecção de Deepfakes em Tempo Real (o nome do sistema é capitalizado no corpo, mas não no título da publicação, embora não seja um acrônimo).

Uma Variedade de Desafios

Em grande parte de acordo com o papel da Universidade Ben Gurion, os desafios reais enfrentados pelo usuário são divididos em vários tipos de tarefas.

Para ocultação, o usuário é obrigado a ocultar o rosto com a mão ou com outros objetos, ou a apresentar o rosto em um ângulo que não seja provável que tenha sido treinado em um modelo de deepfake (geralmente devido à falta de dados de treinamento para ‘posições estranhas’ – veja a variedade de imagens na primeira ilustração acima).

Além das ações que o usuário pode realizar por conta própria de acordo com as instruções, o GOTCHA pode superpor cortes aleatórios de rosto, adesivos e filtros de realidade aumentada, para ‘corromper’ o fluxo de rosto que um modelo de deepfake local pode estar esperando, causando falha. Como indicado anteriormente, embora isso seja um processo ‘passivo’ para o usuário, é um processo intrusivo para o software, que precisa ser capaz de intervir diretamente no fluxo do correspondente.

Em seguida, o usuário pode ser solicitado a fazer expressões faciais incomuns que sejam prováveis de estar ausentes ou sub-representadas em qualquer conjunto de dados de treinamento, causando uma diminuição na qualidade da saída de deepfake (imagem ‘b’, segunda coluna da esquerda, na primeira ilustração acima).

Como parte desses testes, o usuário pode ser solicitado a ler texto ou fazer conversa que seja projetada para desafiar um sistema de deepfake ao vivo local, que pode não ter treinado uma gama adequada de fonemas ou outros tipos de dados de boca para um nível em que possa reconstruir movimentos labiais precisos sob tal escrutínio.

Finalmente (e isso pareceria desafiar os talentos de atuação do correspondente), nessa categoria, o usuário pode ser solicitado a realizar uma ‘micro-expressão’ – uma expressão facial curta e involuntária que trai uma emoção. Diz o papel: ‘[isso] geralmente dura 0,5-4,0 segundos e é difícil de falsificar’.

Embora o papel não descreva como extrair uma micro-expressão, a lógica sugere que a única maneira de fazer isso é criar uma emoção apropriada no usuário final, talvez com algum tipo de conteúdo surpreendente apresentado a ele como parte da rotina do teste.

Distorção Facial, Iluminação e Convidados Inesperados

Adicionalmente, em linha com as sugestões do papel de agosto, o novo trabalho propõe solicitar ao usuário final que realize distorções faciais incomuns e manipulações, como pressionar o dedo na bochecha, interagir com o rosto e/ou cabelo e realizar outros movimentos que nenhum sistema de deepfake ao vivo atual é provável de ser capaz de lidar bem, desde que essas são ações marginais – mesmo que estivessem presentes no conjunto de dados de treinamento, sua reprodução provavelmente seria de baixa qualidade, em linha com outros dados ‘outlier’.

Um sorriso, mas esse ‘rosto deprimido’ não é traduzido bem por um sistema de deepfake ao vivo local.

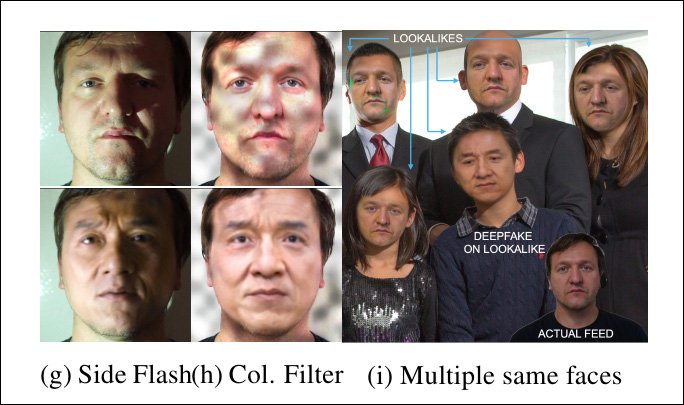

Um desafio adicional reside em alterar as condições de iluminação em que o usuário final está situado, desde que é possível que o treinamento de um modelo de deepfake tenha sido otimizado para situações de iluminação padrão de videoconferência, ou até mesmo as condições de iluminação exatas em que a chamada está ocorrendo.

Assim, o usuário pode ser solicitado a brilhar a lanterna do telefone celular no rosto ou de alguma outra forma alterar a iluminação (e vale notar que essa abordagem é a proposição central de outro papel de detecção de deepfake ao vivo que saiu este verão).

Sistemas de deepfake ao vivo são desafiados por iluminação inesperada – e até mesmo por várias pessoas no fluxo, onde estavam esperando apenas um indivíduo.

No caso do sistema proposto ter a capacidade de interpor no fluxo de usuário local (que é suspeito de abrigar um intermediário de deepfake), adicionar padrões inesperados (veja a coluna do meio na imagem acima) pode comprometer a capacidade do algoritmo de deepfake de manter uma simulação.

Além disso, embora seja irrazoável esperar que um correspondente tenha pessoas adicionais à mão para ajudar a autenticá-lo, o sistema pode interpor faces adicionais (imagem mais à direita acima) e ver se algum sistema de deepfake local comete o erro de mudar a atenção – ou até mesmo tentar deepfake todos eles (sistemas de deepfake autoencoder não têm capacidades de ‘reconhecimento de identidade’ que possam manter a atenção focada em um indivíduo neste cenário).

Esteganografia e Sobrecarga

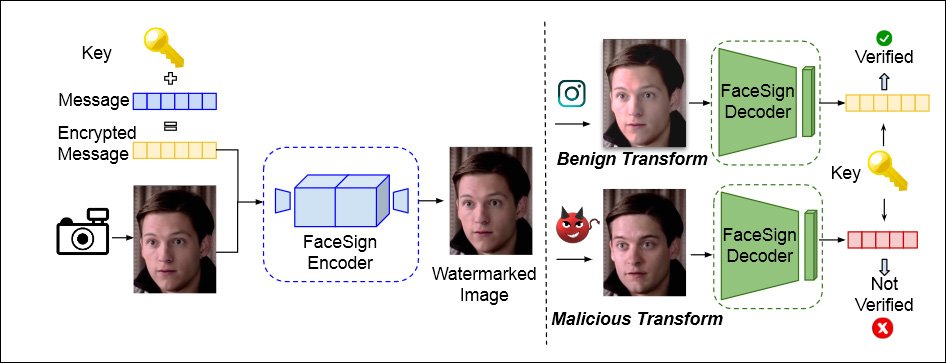

O GOTCHA também incorpora uma abordagem primeiramente proposta pela UC San Diego em abril deste ano, e que usa esteganografia para criptografar uma mensagem no fluxo de vídeo local do usuário. Rotinas de deepfake destruiriam completamente essa mensagem, levando a uma falha de autenticação.

Do papel de abril de 2022 da Universidade da Califórnia, San Diego, e da Universidade Estadual de San Diego, um método de determinar identidade autêntica vendo se um sinal esteganográfico enviado ao fluxo de vídeo do usuário sobrevive ao loop local intacto – se não o fizer, pode haver alguma trapaça de deepfake. Fonte: https://arxiv.org/pdf/2204.01960.pdf

Além disso, o GOTCHA é capaz de sobrecarregar o sistema local (dado acesso e permissão), duplicando um fluxo e apresentando ‘dados excessivos’ a qualquer sistema local, projetado para causar falha de replicação em um sistema de deepfake local.

O sistema contém testes adicionais (veja o papel para detalhes), incluindo um desafio, no caso de um correspondente baseado em smartphone, de virar o telefone de cabeça para baixo, o que distorceria um sistema de deepfake local:

Novamente, esse tipo de coisa só funcionaria com um caso de uso convincente, onde o usuário é forçado a conceder acesso local ao fluxo, e não pode ser implementado por avaliação passiva simples do vídeo do usuário, ao contrário dos testes interativos (como pressionar um dedo no rosto).

Praticidade

O papel toca brevemente na extensão em que testes dessa natureza podem irritar o usuário final, ou de alguma forma incomodá-lo – por exemplo, obrigando o usuário a ter à mão vários objetos que possam ser necessários para os testes, como óculos de sol.

Ele também reconhece que pode ser difícil fazer com que correspondentes poderosos sejam cumpridos com as rotinas de teste. No que diz respeito ao caso de uma chamada de vídeo com um CEO, os autores afirmam:

‘A usabilidade pode ser a chave aqui, então desafios informais ou frívolos (como distorções faciais ou expressões) podem não ser apropriados. Desafios que usem artigos físicos externos podem não ser desejáveis. O contexto aqui é apropriadamente modificado e o GOTCHA adapta sua suíte de desafios de acordo.’

Dados e Testes

O GOTCHA foi testado contra quatro cepas de sistema de deepfake ao vivo local, incluindo duas variações do criador de deepfakes autoencoder muito popular DeepFaceLab (‘DFL’, embora, surpreendentemente, o papel não mencione DeepFaceLive, que, desde agosto de 2021, é a implementação ‘ao vivo’ do DeepFaceLab, e parece o recurso mais provável para um possível falsificador).

Os quatro sistemas foram DFL treinado ‘levemente’ em uma pessoa não famosa que participou dos testes, e um celebridade emparelhada; DFL treinado mais completamente, para 2m+ iterações ou etapas, onde se esperaria um modelo muito mais performático; Latent Image Animator (LIA); e Face Swapping Generative Adversarial Network (FSGAN).

Para os dados, os pesquisadores capturaram e curaram os clipes de vídeo mencionados, apresentando 47 usuários realizando 13 desafios ativos, com cada usuário produzindo cerca de 5-6 minutos de vídeo em 1080p a 60fps. Os autores afirmam também que esses dados serão eventualmente liberados publicamente.

A detecção de anomalias pode ser realizada por um observador humano ou algoritmicamente. Para a segunda opção, o sistema foi treinado em 600 faces do conjunto de dados FaceForensics. A função de perda de regressão foi a poderosa Learned Perceptual Image Patch Similarity (LPIPS), enquanto a entropia cruzada binária foi usada para treinar o classificador. EigenCam foi usado para visualizar os pesos do detector.

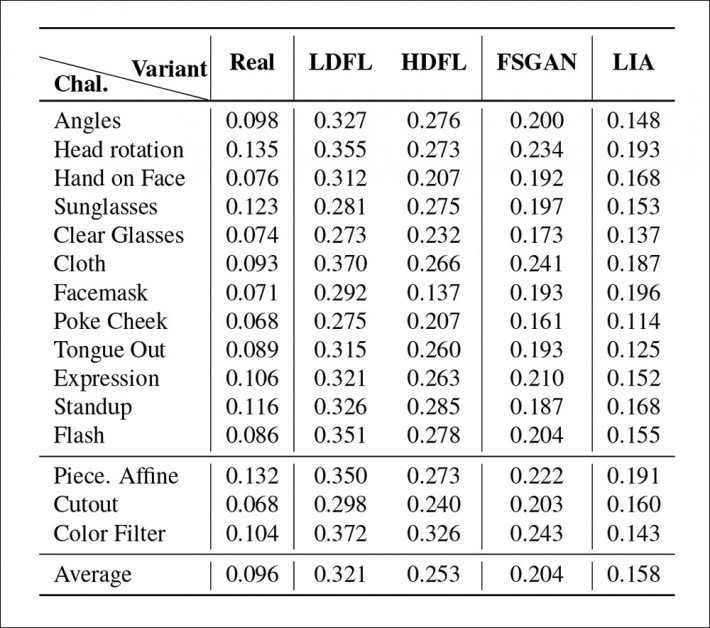

Resultados principais dos testes para o GOTCHA.

Os pesquisadores encontraram que, para a cascata completa de testes nos quatro sistemas, o menor número e gravidade de anomalias (ou seja, artefatos que revelariam a presença de um sistema de deepfake) foram obtidos pela distribuição DFL treinada com mais alta frequência. A versão menos treinada lutou particularmente para recriar movimentos labiais complexos (que ocupam muito pouco do quadro, mas que recebem alta atenção humana), enquanto o FSGAN ocupou o meio do caminho entre as duas versões do DFL, e o LIA provou ser completamente inadequado para a tarefa, com os pesquisadores opinando que o LIA falharia em um deploy real.

Publicado pela primeira vez em 17 de outubro de 2022.