Inteligência artificial

Geração de Vídeo de IA Melhor a Partir de Apenas Duas Imagens

A interpolação de quadros de vídeo (VFI) é um problema aberto na pesquisa de vídeo gerativo. O desafio é gerar quadros intermediários entre dois quadros existentes em uma sequência de vídeo.

Clique para reproduzir. O framework FILM, uma colaboração entre o Google e a Universidade de Washington, propôs um método eficaz de interpolação de quadros que permanece popular nos círculos de hobby e profissionais. À esquerda, podemos ver os dois quadros separados e distintos superpostos; no meio, o ‘quadro final’; e à direita, a síntese final entre os quadros. Fontes: https://film-net.github.io/ e https://arxiv.org/pdf/2202.04901

Em termos gerais, essa técnica remonta a mais de um século e tem sido usada na animação tradicional desde então. Nesse contexto, os principais ‘quadros-chave’ seriam gerados por um artista de animação principal, enquanto o trabalho de ‘tweening’ de quadros intermediários seria realizado por outros funcionários, como uma tarefa mais rotineira.

Antes do surgimento da IA gerativa, a interpolação de quadros foi usada em projetos como Estimativa de Fluxo Intermediário em Tempo Real (RIFE), Interpolação de Quadros de Vídeo Consciente de Profundidade (DAIN) e o Frame Interpolation for Large Motion (FILM – veja acima) para fins de aumento da taxa de quadros de um vídeo existente ou habilitar efeitos de câmera lenta artificialmente gerados. Isso é realizado dividindo os quadros existentes de um clipe e gerando quadros intermediários estimados.

A VFI também é usada no desenvolvimento de melhores codecs de vídeo e, de forma mais geral, em sistemas baseados em fluxo óptico (incluindo sistemas gerativos), que utilizam conhecimento avançado de quadros-chave para otimizar e dar forma ao conteúdo intersticial que os precede.

Quadros Finais em Sistemas de Vídeo Gerativos

Sistemas gerativos modernos, como Luma e Kling, permitem que os usuários especifiquem um quadro de início e um quadro de fim, e podem realizar essa tarefa analisando pontos-chave nas duas imagens e estimando uma trajetória entre as duas imagens.

Como podemos ver nos exemplos abaixo, fornecer um ‘quadro de fechamento’ permite que o sistema de vídeo gerativo (neste caso, Kling) mantenha aspectos como identidade, mesmo que os resultados não sejam perfeitos (particularmente com movimentos grandes).

Clique para reproduzir. Kling é um dos muitos geradores de vídeo, incluindo Runway e Luma, que permitem que o usuário especifique um quadro de fim. Na maioria dos casos, um movimento mínimo levará aos resultados mais realistas e menos defeituosos. Fonte: https://www.youtube.com/watch?v=8oylqODAaH8

Nesse exemplo, a identidade da pessoa é consistente entre os dois quadros-chave fornecidos pelo usuário, levando a uma geração de vídeo relativamente consistente.

Quando apenas o quadro de início é fornecido, a janela de atenção do sistema gerativo não é usualmente grande o suficiente para ‘lembrar’ como a pessoa parecia no início do vídeo. Em vez disso, a identidade provavelmente mudará um pouco com cada quadro, até que toda a semelhança seja perdida. No exemplo abaixo, uma imagem de início foi carregada e o movimento da pessoa foi guiado por um prompt de texto:

Clique para reproduzir. Com nenhum quadro de fim, Kling só tem um pequeno grupo de quadros imediatamente anteriores para guiar a geração dos próximos quadros. Em casos onde qualquer movimento significativo é necessário, essa atrofia de identidade se torna severa.

Podemos ver que a semelhança do ator não é resiliente às instruções, pois o sistema gerativo não sabe como ele pareceria se estivesse sorrindo, e ele não está sorrindo na imagem de semente (a única referência disponível).

A maioria dos clipes gerativos virais é cuidadosamente curada para desemfatizar essas limitações. No entanto, o progresso de sistemas de vídeo gerativos temporalmente consistentes pode depender de novos desenvolvimentos do setor de pesquisa em relação à interpolação de quadros, pois a única alternativa possível é a dependência de CGI tradicional como um vídeo ‘guia’ (e mesmo nesse caso, a consistência de textura e iluminação são atualmente difíceis de alcançar).

Além disso, a natureza lentamente iterativa de derivar um novo quadro de um pequeno grupo de quadros recentes torna muito difícil alcançar movimentos grandes e ousados. Isso ocorre porque um objeto que se move rapidamente através de um quadro pode transitar de um lado para o outro no espaço de um único quadro, contrariamente aos movimentos mais graduais nos quais o sistema provavelmente foi treinado.

Da mesma forma, uma mudança significativa e ousada de pose pode levar não apenas a uma mudança de identidade, mas a incongruências vívidas:

Clique para reproduzir. Nesse exemplo do Luma, o movimento solicitado não parece ser bem representado nos dados de treinamento.

Framer

Isso nos leva a um artigo recente e interessante da China, que afirma ter alcançado um novo estado da arte em interpolação de quadros autêntica – e que é o primeiro do seu tipo a oferecer interação de usuário baseada em arrasto.

Framer permite que o usuário direcione o movimento usando uma interface intuitiva baseada em arrasto, embora também tenha um modo ‘automático’. Fonte: https://www.youtube.com/watch?v=4MPGKgn7jRc

Aplicativos centrados em arrasto se tornaram frequentes na literatura recentemente, à medida que o setor de pesquisa luta para fornecer instrumentalidades para sistemas gerativos que não se baseiam nos resultados fairly cruais obtidos por prompts de texto.

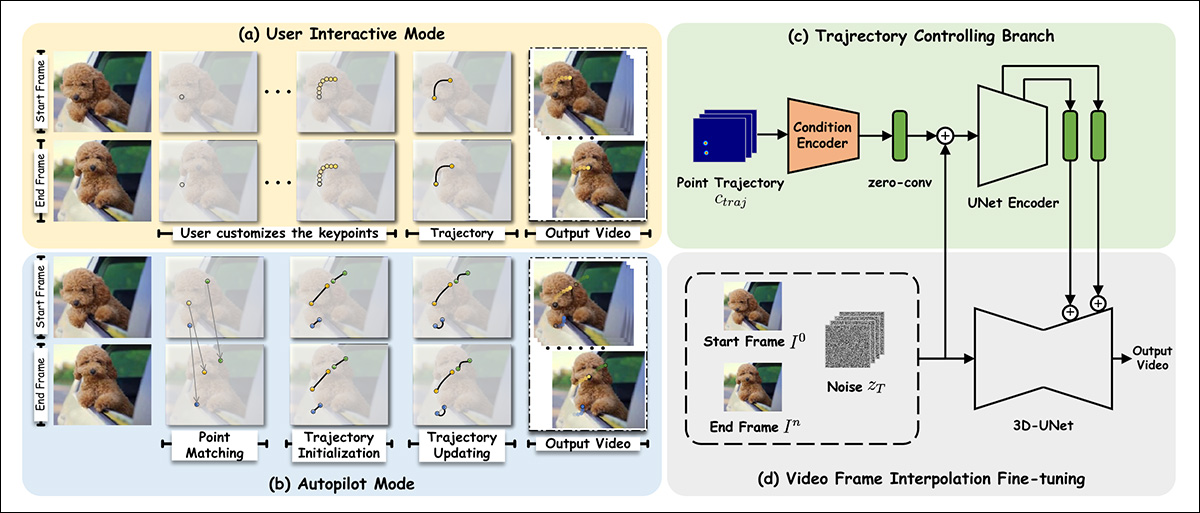

O novo sistema, intitulado Framer, pode não apenas seguir o arrasto orientado pelo usuário, mas também tem um modo ‘piloto automático’ mais convencional. Além da interpolação convencional, o sistema é capaz de produzir simulações de time-lapse, bem como morfismo e vistas novas da imagem de entrada.

Quadros intersticiais gerados para uma simulação de time-lapse no Framer. Fonte: https://arxiv.org/pdf/2410.18978

Em relação à produção de vistas novas, Framer cruza um pouco o território de Campos de Radiância Neural (NeRF) – embora exija apenas duas imagens, enquanto NeRF geralmente requer seis ou mais vistas de imagem de entrada.

Nos testes, Framer, que é baseado no modelo de vídeo gerativo de difusão latente estável da Stability.ai Stable Video Diffusion, foi capaz de superar as abordagens rivais aproximadas, em um estudo de usuário.

No momento da escrita, o código está programado para ser lançado no GitHub. Amostras de vídeo (das quais as imagens acima são derivadas) estão disponíveis no site do projeto, e os pesquisadores também lançaram um vídeo no YouTube.

O novo artigo é intitulado Framer: Interpolação de Quadros Interativa, e vem de nove pesquisadores da Universidade de Zhejiang e do Grupo Alibaba.

Método

Framer usa interpolação baseada em pontos-chave em qualquer uma de suas duas modalidades, onde a imagem de entrada é avaliada para topologia básica, e ‘pontos móveis’ são atribuídos onde necessário. Em essência, esses pontos são equivalentes a marcos faciais em sistemas baseados em ID, mas se generalizam para qualquer superfície.

Os pesquisadores ajustaram a Stable Video Diffusion (SVD) no conjunto de dados OpenVid-1M, adicionando uma capacidade adicional de síntese de último quadro. Isso facilita um mecanismo de controle de trajetória (topo direito na imagem de esquema abaixo) que pode avaliar um caminho em direção ao quadro de fim (ou de volta para ele).

Esquema para Framer.

Com relação à adição de condicionamento de último quadro, os autores afirmam:

‘Para preservar o conhecimento visual do SVD pré-treinado o máximo possível, seguimos o paradigma de condicionamento do SVD e injetamos condições de quadro de fim no espaço latente e no espaço semântico, respectivamente.

‘Especificamente, concatenamos a característica latente codificada pelo VAE do primeiro [quadro] com o ruído latente do primeiro quadro, como feito no SVD. Além disso, concatenamos a característica latente do último quadro, zn, com o ruído latente do quadro de fim, considerando que as condições e os ruídos latentes correspondentes estão alinhados espacialmente.

‘Além disso, extraímos a incorporação de imagem CLIP do primeiro e do último quadros separadamente e as concatenamos para injeção de recurso de atenção cruzada.’

Para a funcionalidade baseada em arrasto, o módulo de trajetória aproveita o framework CoTracker liderado pela Meta Ai, que avalia profusos caminhos possíveis à frente. Esses são reduzidos a entre 1-10 trajetórias possíveis.

As coordenadas de pontos obtidas são então transformadas por meio de uma metodologia inspirada nas arquiteturas DragNUWA e DragAnything. Isso obtém um mapa de calor gaussiano, que individua as áreas-alvo para movimento.

Posteriormente, os dados são alimentados nos mecanismos de condicionamento do ControlNet, um sistema de conformidade auxiliar originalmente projetado para a Stable Diffusion, e desde então adaptado para outras arquiteturas.

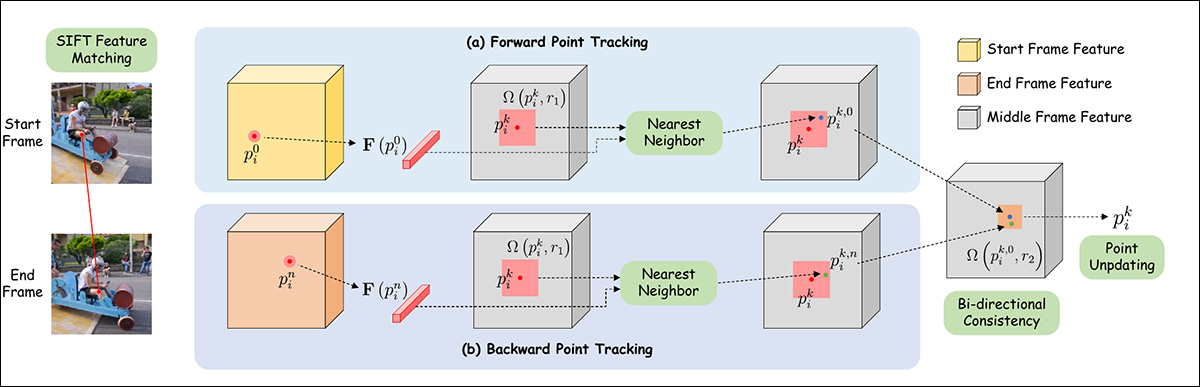

Para o modo autopilot, a correspondência de recursos é inicialmente realizada por meio do SIFT, que interpreta uma trajetória que pode ser passada para um mecanismo de atualização automática inspirado no DragGAN e no DragDiffusion.

Esquema para estimação de trajetória de pontos em Framer.

Dados e Testes

Para o ajuste fino do Framer, a atenção espacial e os blocos residuais foram congelados, e apenas as camadas de atenção temporal e os blocos residuais foram afetados.

O modelo foi treinado por 10.000 iterações sob AdamW, com uma taxa de aprendizado de 1e-4 e um tamanho de lote de 16. O treinamento ocorreu em 16 GPUs NVIDIA A100.

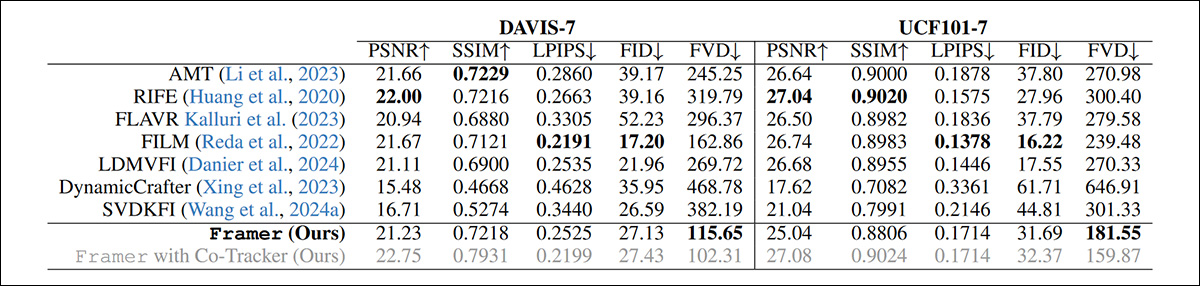

Como as abordagens anteriores para o problema não oferecem edição baseada em arrasto, os pesquisadores optaram por comparar o modo autopilot do Framer com a funcionalidade padrão de ofertas mais antigas.

As estruturas testadas para a categoria de sistemas de geração de vídeo baseados em difusão atuais foram LDMVFI; Dynamic Crafter; e SVDKFI. Para ‘sistemas de vídeo tradicionais’, as estruturas rivais foram AMT; RIFE; FLAVR; e o mencionado FILM.

Além do estudo de usuário, testes foram realizados sobre os conjuntos de dados DAVIS e UCF101.

Testes qualitativos só podem ser avaliados pelas faculdades objetivas da equipe de pesquisa e por estudos de usuário. No entanto, o artigo observa que as métricas quantitativas tradicionais são em grande parte inadequadas para a proposição em questão:

‘As métricas de reconstrução, como PSNR, SSIM e LPIPS, falham em capturar a qualidade dos quadros interpolados com precisão, pois penalizam outros resultados de interpolação plausíveis que não estão alinhados com o pixel do vídeo original.

‘Embora as métricas de geração, como FID, ofereçam alguma melhoria, elas ainda são insuficientes, pois não levam em conta a consistência temporal e avaliam os quadros em isolamento.’

Apesar disso, os pesquisadores realizaram testes qualitativos com várias métricas populares:

Resultados quantitativos para Framer vs. sistemas rivais.

Os autores observam que, apesar de terem as probabilidades contra eles, Framer ainda alcança a melhor pontuação FVD entre os métodos testados.

Abaixo estão os resultados de amostra do artigo para uma comparação qualitativa:

Comparações qualitativas contra abordagens anteriores. Por favor, consulte o artigo para uma melhor resolução, bem como resultados de vídeo em https://www.youtube.com/watch?v=4MPGKgn7jRc.