Inteligência artificial

A Disney Combina CGI Com Renderização Neural para Tacklar o ‘Vale Uncanny’

A divisão de pesquisa de IA da Disney desenvolveu um método híbrido para simulação facial de qualidade de filme, combinando as forças da renderização neural facial com a consistência de uma abordagem baseada em CGI.

O artigo pendente é intitulado Rendering com Estilo: Combinando Abordagens Tradicionais e Neurais para Renderização de Rosto de Alta Qualidade, e é pré-visualizado em um novo vídeo de 10 minutos no canal do YouTube da Disney Research (inserido no final deste artigo*).

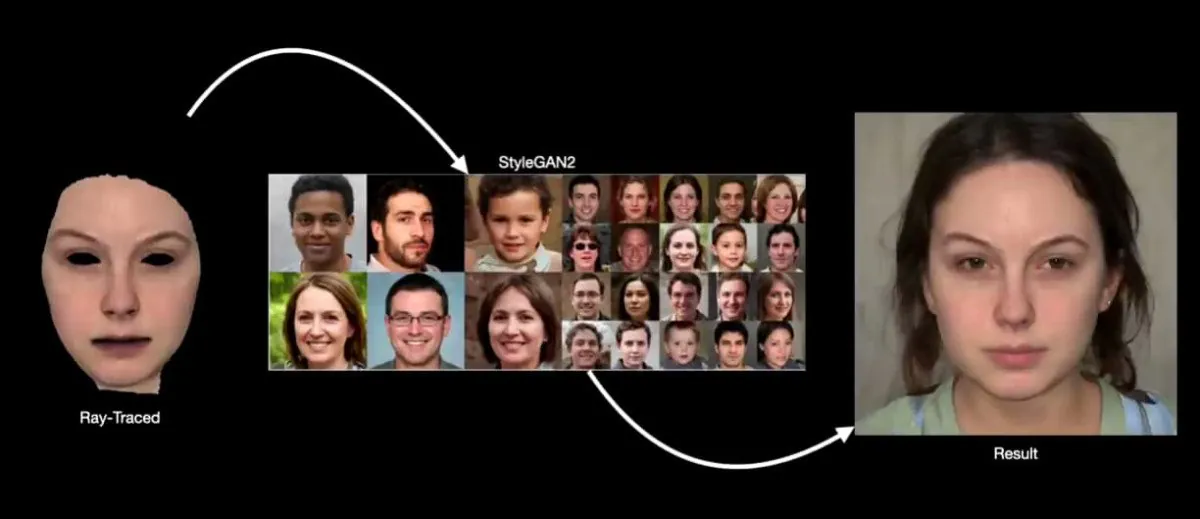

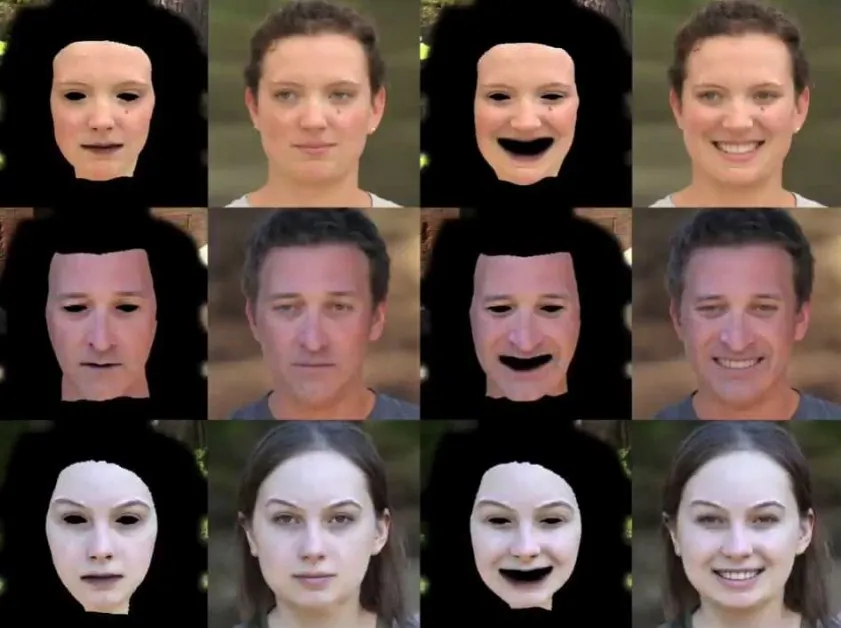

Malhas combinadas com renderizações faciais neurais. Veja o vídeo incorporado no final do artigo para melhor detalhe e qualidade. Source: https://www.youtube.com/watch?v=k-RKSGbWLng (desde substituído por https://www.youtube.com/watch?v=TwpLqTmvqVk)

Como o vídeo nota, a renderização neural de rostos (incluindo deepfakes) pode produzir olhos e interiores de boca muito mais realistas do que o CGI é capaz, enquanto as texturas faciais impulsionadas por CGI são mais consistentes e adequadas para saída de efeitos visuais de nível de cinema.

Portanto, a Disney está experimentando deixar o gerador neural NVIDIA’s StyleGan2 lidar com os recursos circundantes de um rosto e os elementos “críticos para a vida” como olhos, enquanto superpõe consistentes texturas faciais CGI e elementos relacionados na saída.

Do vídeo (veja o final do artigo), o conceito arquitetônico por trás da abordagem híbrida da Disney, onde uma malha CGI de estilo antigo, do tipo usado para recriar ‘jovem’ Carrie Fisher e o falecido Peter Cushing para Rogue One (2016), é integrada em ambientes faciais renderizados neuralmente.

O vídeo faz uma referência tácita à crítica frequente da inautenticidade e do efeito “vale uncanny” da recriação CGI do falecido ator britânico Star Wars Peter Cushing em Rogue One (2016), concedendo:

‘[Há] ainda uma grande lacuna entre o que as pessoas podem capturar e renderizar facilmente versus duplos digitais fotorealistas finais, completos com cabelo, olhos e boca interna. Para fechar essa lacuna, geralmente é necessário muito trabalho manual de artistas habilidosos.’

Na verdade, mesmo os sistemas de captura facial mais modernos não tentam recriar olhos, interiores de boca ou cabelo, que têm problemas de autenticidade em tais técnicas (olhos) ou de consistência temporal (cabelo).

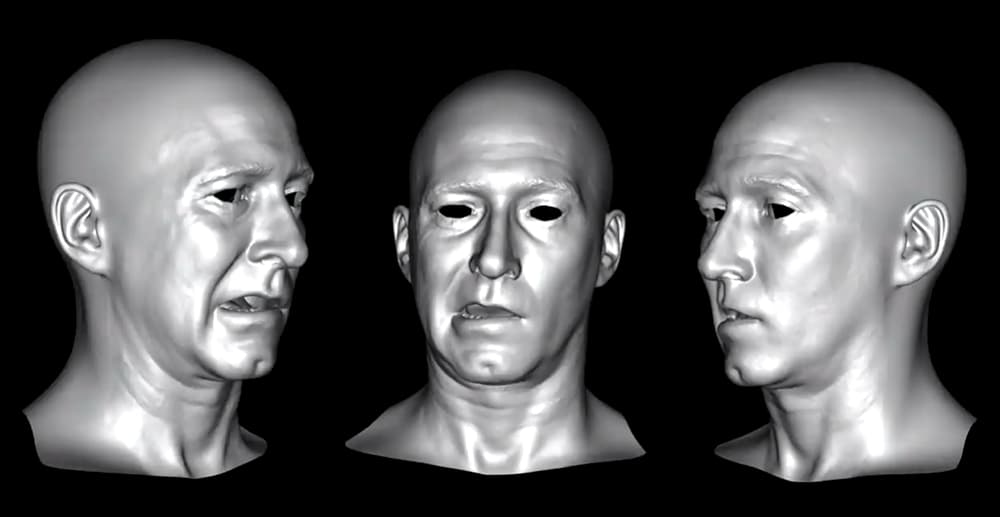

O vídeo ilustra o que os artistas de efeitos visuais obterão após uma sessão típica de captura facial moderna. Olhos, cabelo, barba e interiores de boca terão que ser tratados por equipes separadas na linha de produção, além de texturização e iluminação.

Controle de Iluminação

A abordagem híbrida também é um benefício com a reluzimento – um desafio notável para a renderização neural de rostos, desde que as superposições de pele CGI possam ser mais facilmente reluzidas.

Uma versão animada da abordagem CGI/Neural.

Em ambientes mais desafiadores, como externas, os pesquisadores desenvolveram um método de inpainting em torno de uma espécie de zona desmilitarizada ao redor da pessoa sendo “criada”.

Uma margem preta é gerada para permitir uma ‘tela’ para inpainting as partes externas da identidade e integrar a pele CGI na saída combinada CGI/neural.

O vídeo nota:

‘[A] renderização neural não corresponde perfeitamente à restrição de fundo. – é apenas destinada a ser um guia, desde que otimizar componentes realistas humanos, como cabelo, olhos e dentes, é o objetivo principal. Mais desafiador é tentar manter uma identidade consistente, enquanto muda a iluminação do ambiente.’

Criando Malhas CGI a Partir de Renderizações Neurais

A equipe de pesquisa também desenvolveu um autoencoder variacional treinado em um (não especificado) grande banco de dados de imagens faciais 3D, e afirma que pode produzir ‘aleatórias, mas plausíveis’ malhas faciais 3D a partir de dados de verdade.

Há limitações para que essa pesquisa supere, incluindo a dificuldade em manter o cabelo temporalmente consistente nas renderizações neurais, e o vídeo (veja abaixo) mostra vários exemplos de cabelo mutando rapidamente em uma volta consistente em torno de um rosto CGI/neural.

A consistência temporal na renderização de vídeo neural é um problema muito mais amplo do que apenas da Disney, e parece provável que iterações posteriores desse sistema possam recorrer a adicionar cabelo ’em pós-produção’, ou várias outras abordagens possíveis para geração de cabelo, em vez de esperar que uma abordagem neural nova eventualmente resolva isso.

Usos para Geração de Conjunto de Dados

O método é proposto também como um método potencial de geração de dados sintéticos, e enriquecimento do paisagem de imagens faciais, que nos últimos anos se tornou perigosamente monótono.

A Disney prevê a nova técnica populando conjuntos de dados de imagens faciais.

‘[Cada] resultado fotorealista que geramos tem uma geometria subjacente correspondente, e mapas de aparência, renderizados a partir de pontos de vista de câmera desconhecidos com iluminação conhecida. Essa informação de ‘verdade’ pode ser vital para treinar aplicações downstream, como reconstrução facial 3D monocular, reconhecimento facial ou compreensão de cena. E assim, cada renderização de resultado pode ser considerada uma amostra de dados, e podemos gerar muitas variações de muitos indivíduos diferentes.

‘Além disso, mesmo para uma pessoa renderizada em uma expressão única com um ponto de vista único e iluminação, podemos gerar variações aleatórias do render fotorealista variando a semente de randomização durante a otimização.’

Os pesquisadores observam que essa diversidade de saída configurável pode ser útil no treinamento de aplicações de reconhecimento facial, concluindo:

‘[Nosso] método é capaz de aproveitar a tecnologia atual para captura, modelagem e renderização de pele facial, e criar automaticamente renders faciais fotorealistas que correspondam à identidade, expressão e configuração de cena desejadas. Essa abordagem tem aplicações e renderização facial para filmes e entretenimento, economizando trabalho manual de artistas e também para geração de dados em diferentes campos de aprendizado profundo.’

Para uma olhada mais profunda na nova abordagem, confira o vídeo de 10 minutos lançado hoje:

* O link de vídeo original foi substituído por outro aparentemente idêntico 8 horas após a publicação deste artigo. Eu mudei todos os links relevantes, pois não há traço do vídeo original.

8:24 GMT+2 – Substituído vídeo, pois foi trocado pelo canal do YouTube da Disney Research por algum motivo.