Ângulo de Anderson

IAs de codificação tendem a sofrer com o efeito Dunning-Kruger

Uma nova pesquisa mostra que IAs de codificação como o ChatGPT sofrem do Efeito Dunning-Kruger, frequentemente agindo com mais confiança quando são menos competentes. Ao lidar com linguagens de programação desconhecidas ou obscuras, elas afirmam ter alta certeza, mesmo quando suas respostas falham. O estudo associa o excesso de confiança do modelo ao baixo desempenho e à falta de dados de treinamento, levantando novas preocupações sobre o quanto esses sistemas realmente sabem sobre o que estão executando. não Sei.

Qualquer pessoa que tenha passado um tempo moderado interagindo com Grandes Modelos de Linguagem sobre questões factuais já saberá que os LLMs estão frequentemente dispostos a dar uma confiantemente errado resposta a uma consulta do usuário.

Juntamente com formas mais evidentes de alucinação, a razão para essa ostentação vazia não é 100% clara. Pesquisas publicadas no verão sugerem que os modelos dão respostas confiantes mesmo quando sabem que estão errados, por exemplo; embora outras teorias atribuam excesso de confiança a escolhas arquitetônicas, entre outras possibilidades.

O que o usuário final pode ter certeza é que a experiência é incrivelmente frustrante, já que somos codificados para confiar em pessoas estimativas de suas próprias habilidades (até porque nesses casos há consequências, legais e de outra natureza, para uma pessoa que promete demais e entrega de menos); e um tipo de transferência antropomórfica significa que tendemos a replicar esse comportamento com sistemas de IA conversacionais.

Mas um LLM é uma entidade irresponsável que pode e irá efetivamente retornar um 'Ops! Dedos de manteiga…' depois de ter ajudado o usuário a destruir inadvertidamente algo importante, ou pelo menos desperdiçar uma tarde do seu tempo; assumindo que isso vai admitir qualquer responsabilidade.

Pior ainda, essa falta de prudência e circunspecção parece impossível de ser eliminada, pelo menos no ChatGPT, que tranquilizará abundantemente o usuário quanto à validade de seus conselhos e explicará as falhas em seu raciocínio somente depois que o dano estiver feito. Nem a atualização do sistema memória persistente, nem o uso de prompts repetitivos parecem ter muito impacto sobre o problema.

As pessoas também podem ser teimosas e autoiludidas – embora qualquer um que errasse tão profundamente e com tanta frequência provavelmente seria demitido precocemente. Essas pessoas sofrem do oposto da "síndrome do impostor" (onde um funcionário teme ter sido promovido acima de suas capacidades) – a Efeito Dunning Kruger, onde uma pessoa significativamente superestima sua capacidade de executar uma tarefa.

O custo da inflação

Um novo estudo da Microsoft examina o valor do efeito Dunning-Kruger em relação ao desempenho efetivo de arquiteturas de codificação auxiliadas por IA (como a própria Redmond Copilot), em um esforço de pesquisa que é o primeiro a abordar especificamente esse subsetor de LLMs.

O trabalho analisa a confiança com que essas IAs programadoras avaliam suas próprias respostas em comparação com seu desempenho real, em dezenas de linguagens de programação. Os resultados mostram um padrão claramente semelhante ao humano: quando os modelos eram menos capazes, eles se mostravam mais seguros de si.

O efeito foi mais forte em línguas obscuras ou de poucos recursos, onde os dados de treinamento eram escassos – quanto mais fraco o modelo ou mais rara a língua, maior a probabilidade de ocorrência de erros. ilusão de habilidade:

Desempenho real e percebido do GPT-4o em todas as linguagens de programação, classificado pelo desempenho real. Fonte: https://arxiv.org/pdf/2510.05457

Os quatro autores, todos colaboradores que trabalham para a Microsoft, afirmam que o trabalho levanta novas questões sobre até que ponto essas ferramentas são confiáveis para julgar seus próprios resultados, e eles afirmam:

'Ao analisar a confiança e o desempenho do modelo em um conjunto diversificado de linguagens de programação, revelamos que os modelos de IA refletem padrões humanos de excesso de confiança, especialmente em domínios desconhecidos ou de poucos recursos.

Nossos experimentos demonstram que modelos menos competentes e aqueles que operam em linguagens de programação raras apresentam um viés mais forte, semelhante ao DKE, sugerindo que a intensidade do viés é proporcional à competência dos modelos. Isso está alinhado com experimentos humanos para o viés.

Os pesquisadores contextualizam essa linha de estudo como uma forma de entender como a confiança do modelo se torna pouco confiável quando o desempenho é fraco e para testar se os sistemas de IA exibem o mesmo tipo de excesso de confiança visto em humanos, com implicações posteriores para a confiança e a implantação prática.

Embora o novo papel desafia Lei das manchetes de Betteridge, ainda assim é intitulado Os modelos de código sofrem com o efeito Dunning-Kruger?. Embora os autores afirmem que o código foi lançado para o trabalho, a pré-impressão atual não traz detalhes sobre isso.

Forma

O estudo testou a precisão com que as IAs de codificação poderiam julgar suas próprias respostas, dando a elas milhares de questões de programação de múltipla escolha, com cada questão pertencendo a um domínio de linguagem específico, de Python e Java a Perl e COBOL:

Domínios de linguagem de programação usados no estudo, juntamente com o número de questões de codificação de múltipla escolha amostradas para cada domínio.

Os modelos foram encarregados de escolher a opção correta e, em seguida, estimar o quão confiantes estavam em sua escolha, com seu desempenho real medido pela frequência com que acertaram a resposta - e sua autoavaliação de confiança indicando o quão bons eles eram Acredita Eram elas. A comparação dessas duas métricas permitiu aos pesquisadores ver onde a confiança e a competência divergiam.

Para medir o quão confiantes os modelos pareciam estar, o estudo usou dois métodos: confiança absoluta e ferrolhos de sobrepor podem ser usados para proteger uma porta de embutir pelo lado de fora. Alguns kits de corrente de segurança também permitem travamento externo com chave ou botão giratório. confiança relativa. No primeiro, o modelo foi solicitado a dar uma pontuação de zero a um ao lado de cada resposta, com sua confiança para um determinado idioma definida pela média dessas pontuações em perguntas naquele idioma.

O segundo método analisou o quão confiante o modelo estava quando escolhendo entre duas perguntas; para cada par, o modelo tinha que dizer qual deles tinha mais certeza. Essas escolhas eram então pontuadas usando sistemas de classificação originalmente projetados para jogos competitivos, tratando cada questão como se fosse um jogador em uma partida. As pontuações finais foram normalizadas e calculadas para cada idioma, resultando em uma pontuação de confiança relativa.

Duas formas estabelecidas do Efeito Dunning-Kruger são examinadas no artigo: uma que rastreia como um único modelo avalia mal seu desempenho em diferentes domínios; e outra que compara os níveis de confiança entre modelos mais fracos e mais fortes.

A primeira forma, chamada DKE intraparticipante, analisa se um único modelo se torna mais confiante em linguagens nas quais apresenta baixo desempenho. O segundo, DKE interparticipante, pergunta se os modelos que têm um desempenho geral pior também tendem a se autoavaliar melhor.

Em ambos os casos, a lacuna entre a confiança e o desempenho real é usada para medir o excesso de confiança, com lacunas maiores em configurações de baixo desempenho apontando para um comportamento semelhante ao DKE.

Consistentes

O estudo testa o Efeito Dunning-Kruger em seis grandes modelos de linguagem: Mistral; Phi-3; DeepSeek‑Destilar; Phi-4; GPT‑0.1 e GPT-4o.

Cada modelo foi testado em questões de programação de múltipla escolha do questionário disponível ao público. Conjunto de dados CodeNet, com 37 idiomas* representados para revelar como a confiança e a precisão variam entre domínios de codificação familiares e obscuros.

A análise intermodelo mostra um padrão claro de Dunning-Kruger:

Desempenho real versus percebido em seis modelos de código, mostrando como modelos de baixo desempenho, como Mistral e Phi‑3, apresentam alta confiança, apesar da baixa precisão, enquanto modelos mais fortes, como GPT‑4o, mostram comportamento mais calibrado ou até mesmo pouco confiante.

Modelos com menor precisão, incluindo Mistral e Phi‑3, tenderam a superestimar suas próprias habilidades, enquanto sistemas de melhor desempenho, como GPT‑4o, mostraram níveis de confiança que correspondiam mais de perto ao seu desempenho real, principalmente quando julgados pela confiança relativa.

Os resultados também indicam que os modelos mais capazes podem, às vezes, subestimar a si mesmos (um padrão que as pontuações de confiança absoluta não conseguem capturar).

Os resultados também indicam que a análise intramodelo corrobora a presença do Efeito Dunning-Kruger. No gráfico de resultados apresentado no início do artigo, vemos o desempenho de cada modelo em diferentes linguagens de programação, organizado por desempenho real.

Em linguagens em que os modelos obtiveram resultados ruins, especialmente em linguagens raras ou com poucos recursos, como COBOL, Prolog e Ceylon, a confiança foi visivelmente maior do que os resultados justificavam. Em linguagens conhecidas, como Python e JavaScript, a confiança se alinhou mais com a precisão real, chegando até mesmo a ficar abaixo dela.

Este padrão apareceu tanto nas medidas de confiança absoluta como relativa, sugerindo que os modelos estão menos conscientes de seus próprios limites quando operam em domínios de codificação desconhecidos.

Tratar modelos como participantes introduziu algumas limitações, já que o pequeno número de modelos em jogo afeta a diversidade; as diferenças dentro dos resultados de um único modelo são ignoradas; e a distribuição de dados pode não refletir a de participantes humanos reais.

Para dar conta disto, o estudo testou três configurações alternativas: em primeiro lugar, cada modelo recebeu uma persona distinta; em segundo lugar, as respostas foram amostradas em um nível mais alto temperatura para criar mais variação; em terceiro lugar, os prompts foram parafraseados várias vezes, com cada versão tratada como um participante separado:

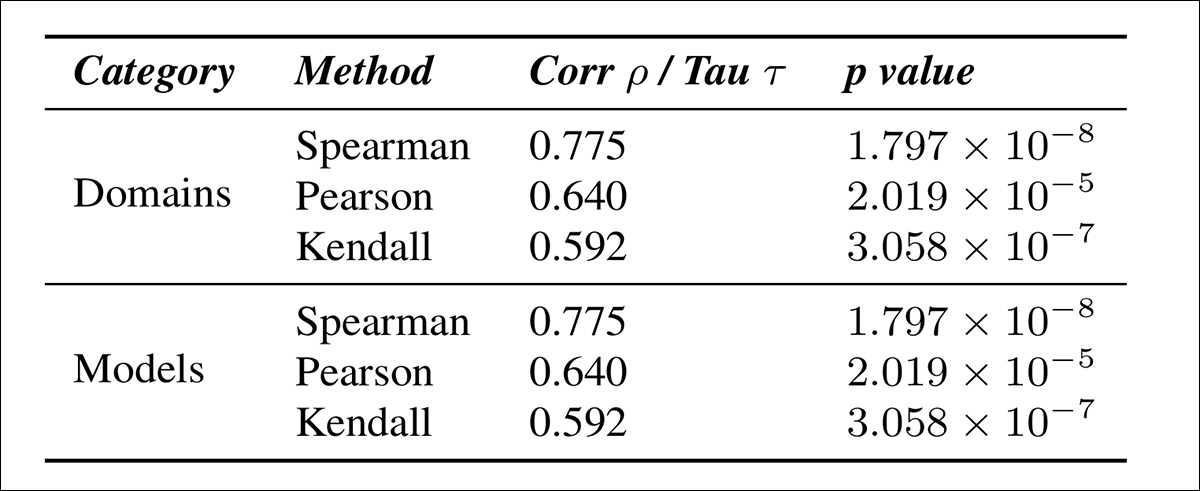

Correlação entre excesso de confiança e desempenho real em diferentes configurações experimentais, mostrando que o padrão Dunning-Kruger permanece consistente em todas as condições e é mais forte quando múltiplas respostas diversas são amostradas do mesmo modelo.

A tabela de resultados mostrada acima indica o quão fortemente o Efeito Dunning-Kruger se manifesta sob essas condições, permanecendo presente em todos os casos; e que o DKE foi mais pronunciado quando múltiplas respostas foram amostradas do mesmo modelo em alta temperatura.

Para entender melhor como o desempenho percebido diverge do desempenho real, o estudo comparou estimativas de confiança absoluta e relativa, calculando o quanto cada modelo superestimou sua própria capacidade (especificamente, a diferença entre sua pontuação de confiança e sua precisão real) e, então, medindo como essa superestimação se relacionava com o desempenho real do modelo:

Correlação entre excesso de confiança (medido como confiança absoluta menos relativa) e precisão real em domínios de programação e tipos de modelo, mostrando que maior superestimação está consistentemente associada a menor desempenho.

A tabela de resultados acima ilustra como a superestimação se relaciona com o desempenho real, tanto entre domínios de programação quanto entre modelos. Em ambos os casos, podemos observar que modelos com menor precisão tendem a apresentar maior excesso de confiança.

Além disso, modelos especializados treinados em domínios mais estreitos mostraram efeitos DKE mais fortes do que os generalistas:

Correlação entre superestimação e desempenho real para modelos especializados de base, de domínio único e de múltiplos domínios, mostrando efeitos DKE mais fortes à medida que a especialização aumenta.

Com o Conjunto de dados MultiPL-E em oito linguagens de programação, os autores descobriram que o treinamento de domínio único levou a um maior excesso de confiança do que as configurações de vários domínios ou de base, sugerindo que DKE piora com aumento da especialização.

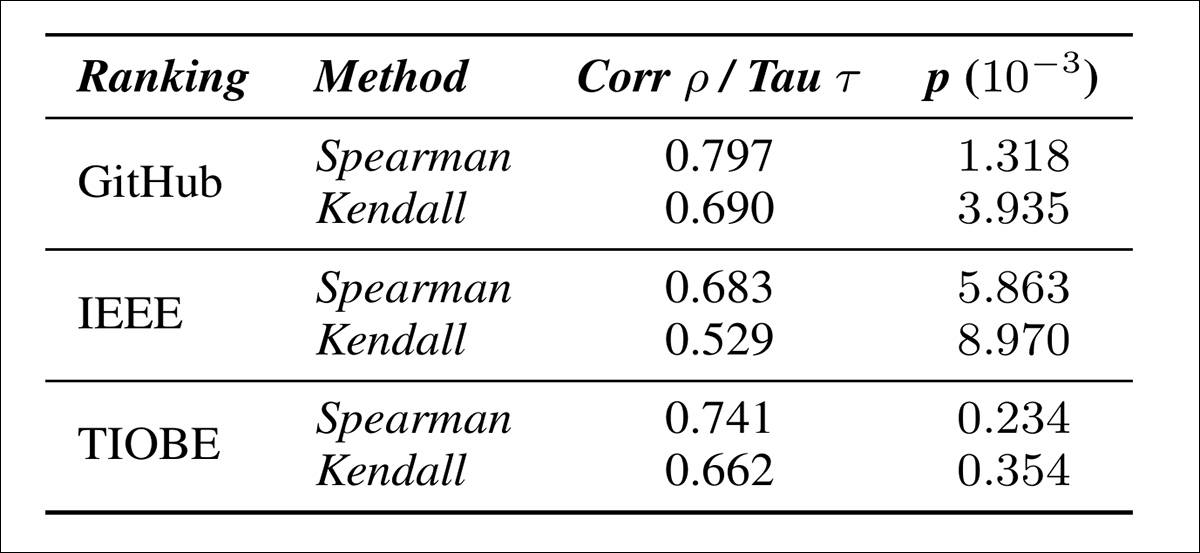

Os testes também revelaram que os modelos tendem a ser mais confiantes em linguagens de programação raras. GitHub, IEEE e TIOBE classificações, a raridade está fortemente correlacionada com maior confiança percebida, atingindo um pico de 0.797:

Correlação entre excesso de confiança no modelo e raridade linguística, utilizando três classificações de popularidade. Línguas menos comuns estão associadas a um desempenho percebido mais alto.

Por fim, os autores testaram se o efeito Dunning-Kruger aparece na geração de código, avaliando modelos no conjunto de dados MultiPL-E nas linguagens Ada, Dart, Prolog, Swift, C++, Python, C# e Elixir.

Embora o efeito ainda estivesse presente, ele foi notavelmente mais fraco do que no cenário de questões de múltipla escolha, provavelmente refletindo a maior dificuldade em avaliar a confiança e a correção em tarefas abertas:

Correlação entre superestimação e desempenho real na geração de código aberto, com base nos resultados do MultiPL‑E em oito linguagens de programação.

Ao considerar a explicação ainda contestada para o efeito Dunning-Kruger, os autores concluem:

'Uma possível explicação que pode ser comum tanto aos humanos quanto aos modelos de IA é a explicação metacognitiva, que afirma que avaliar a qualidade do desempenho de uma habilidade é uma parte crucial da aquisição de uma habilidade.

"Essa explicação pode ser potencialmente testada experimentalmente em modelos de IA com um estudo controlado de diferentes estratégias de treinamento e para verificar se todas elas levam a melhorias simultâneas no desempenho e na capacidade de avaliar a qualidade do desempenho. No entanto, este estudo está significativamente além do escopo deste artigo, e o deixamos para trabalhos futuros."

Conclusão

Mesmo em seu domínio nativo, o efeito Dunning-Kruger (como observa o artigo) pode ser atribuído a uma causa estatística ou cognitiva. Se for uma causa estatística, a aplicação de uma síndrome até então exclusivamente humana a um contexto de aprendizado de máquina é, na verdade, bastante válida.

Embora os autores especulem que a causa poderia ser considerada "cognitiva" em ambos os casos, isso exigiria um ponto de vista um pouco mais metafísico.

Talvez a descoberta mais interessante no artigo seja até que ponto vários LLMs em codificação tendem a redobrar seus esforços em circunstâncias menos favoráveis, ou seja, exibindo máxima confiança ao lidar com as linguagens mais esparsas ou menos conhecidas — o que seria uma estratégia quase imediatamente autodestrutiva em um ambiente de trabalho do mundo real.

* As linguagens de programação usadas foram Ada, Bash, C, C#, C++, COBOL, Ceylon, Clojure, D, Dart, Dash, Elixir, Erland, F#, Fortran, Go, Haskell, Java, JavaScript, Julia, Lisp, Kotlin, Lua, OCaml, Objective-C, PHP, Pascal, Perl, Prolog, Python, Racket, Ruby, Rust, Scala, Swift, TypeScript e Visual Basic.

Primeira publicação quarta-feira, 8 de outubro de 2025