Inteligência artificial

Uma Introdução ao Vertex AI

Dada a paisagem em rápida evolução da Inteligência Artificial, um dos principais obstáculos que os líderes de tecnologia frequentemente enfrentam é a transição de ser “experimental” para ser “pronto para a empresa”. Enquanto os chatbots de consumidor e uma plataforma interativa ajudam com a imaginação pública, as empresas não podem ter sucesso com apenas uma interface de chat. Em uma era em que a concorrência é mais agressiva do que nunca, as empresas precisam de um ecossistema robusto, escalável e seguro, e é isso que o Google tenta oferecer com o Vertex AI, a plataforma unificada de Inteligência Artificial e Aprendizado de Máquina do Google Cloud.

O Vertex AI tenta solidificar-se como a espinha dorsal para a integração de IA Geradora com a infraestrutura de nuvem moderna, oferecendo uma suite abrangente de recursos que fecha a lacuna entre os modelos de fundação brutos e as aplicações de nível de produção. O Vertex AI não é apenas um invólucro para grandes modelos de linguagem (LLMs), mas sim um ecossistema unificado de Aprendizado de Máquina e Inteligência Artificial (ML/AI) que trata a IA Geradora como um cidadão de primeira classe da infraestrutura de nuvem moderna.

No coração do Vertex AI está o Jardim de Modelos, um mercado central que fornece acesso a mais de 200 modelos de fundação curados, incluindo o poderoso multimodal Gemini 2.5 Pro, que apresenta uma janela de contexto de 2 milhões de tokens. Neste artigo, vamos dissecar a arquitetura do Vertex AI, explorar como o Jardim de Modelos serve como a “Loja de Aplicativos” da indústria para a inteligência, e olhar para os pilares técnicos que tornam essa plataforma a espinha dorsal do próximo nível de software empresarial.

A Arquitetura Central: Uma Plataforma Unificada

O Vertex AI não é uma coleção frouxamente acoplada de ferramentas, mas sim um ecossistema unificado de dados e IA projetado para fechar a fragmentação de dados, ferramentas e equipes que atormenta o aprendizado de máquina até hoje. Tradicionalmente, o desenvolvimento de IA ocorre em ambientes isolados, e às vezes, os dados são espalhados e presos em vários repositórios. Por exemplo, as organizações podem armazenar dados de cliente em armazéns SQL, enquanto os documentos não estruturados são descartados em um Lago de Dados. Quando os dados são isolados, a IA vê apenas uma “verdade parcial”, levando a resultados tendenciosos ou altas taxas de alucinação, pois falta o contexto completo da empresa.

O Vertex AI tenta integrar todo o ciclo de vida, desde a ingestão de dados brutos no BigQuery e Cloud Storage até o monitoramento de produção, servindo essencialmente como um “tecido conjuntivo” entre esses silos. O Vertex AI se integra nativamente com o Cloud Storage e BigQuery, permitindo que os modelos de IA recuperem os dados sem pipelines complexos de Extração, Transformação e Carga.

A Fundação: O Hipercômputador de IA do Google

A camada GenAI do Vertex AI está sobre a arquitetura do hipercômputador de IA do Google, um sistema de supercomputação integrado, que consiste em:

TPU v5p e v5e (Unidades de Processamento de Tensor)

As Unidades de Processamento de Tensor do Google são ASICs (Circuits Integrados Específicos de Aplicação) personalizados projetados especificamente para a multiplicação de matrizes que define o aprendizado profundo.

- TPU v5p (Desempenho): Este é o acelerador de bandeira para treinamento em grande escala. Cada pod TPU v5p pode escalar para 8.960 chips interconectados pelo Inter-Chip Interconnect (ICI) de maior banda do Google, a 4.800 Gbps. Para um líder de tecnologia, isso significa 2,8 vezes mais rápido o treinamento para um modelo do tamanho do GPT-3 (175B parâmetros) em comparação com a geração anterior, reduzindo drasticamente o tempo de comercialização.

- TPU v5e (Eficiência): Projetado para desempenho “otimizado por custo”, o v5e é o cavalo de batalha para treinamento de escala média e inferência de alta taxa. Ele oferece até 2,5 vezes melhor desempenho por preço, tornando-o a escolha ideal para empresas que precisam executar inferência 24/7 sem um orçamento massive.

NVIDIA H100/A100 GPUs para Flexibilidade

Enquanto os TPUs são especializados, muitas equipes de desenvolvimento confiam no ecossistema NVIDIA CUDA. O Vertex AI fornece suporte de primeira classe para o hardware mais recente da NVIDIA:

- NVIDIA H100 (Hopper): Ideal para ajustar finamente os maiores modelos de código aberto (como Llama 3.1 405B) que exigem largura de banda de memória maciça.

- Rede de Conectividade Jupiter: Para evitar o “Gargalo de Rede”, o Google usa sua rede de tecido de centro de dados Jupiter. Isso garante que os dados se movam entre os GPUs a uma velocidade relâmpago, suportando RDMA (Acesso Direto à Memória Remota) para contornar a sobrecarga do CPU e fornecer desempenho quase local em nós distribuídos.

Orquestração Dinâmica

A mudança técnica mais crítica no Vertex AI é a Orquestração Dinâmica. Em um ambiente legado, se um nó GPU falhar durante uma execução de treinamento de 3 semanas, o trabalho inteiro pode falhar.

- Resiliência Automatizada: O Vertex AI, frequentemente alimentado pelo Google Kubernetes Engine (GKE) sob a capa, apresenta “Nós auto-curativos”. Se uma falha de hardware for detectada, a plataforma migra automaticamente a carga de trabalho para um nó saudável.

- Agendador de Carga de Trabalho Dinâmico: Essa ferramenta permite que as equipes solicitem capacidade com base na urgência. Você pode optar por Início Flexível (mais barato, começa quando a capacidade estiver disponível) ou Capacidade Garantida para lançamentos de missão crítica.

- Treinamento sem Servidor: Para equipes que desejam zero gerenciamento de infraestrutura, o Treinamento sem Servidor do Vertex AI permite que você envie seu código e dados; a plataforma fornece o cluster, executa o trabalho e o desmonta – cobrando apenas os segundos de computação usados.

Os Três Pontos de Entrada: Descoberta, Experimentação e Automação

Para acomodar diferentes personalidades técnicas – desde cientistas de dados até desenvolvedores de aplicativos – o Vertex AI fornece três pontos de entrada principais:

- Jardim de Modelos: O Mercado para Descoberta.

- Vertex AI Studio: O Playground para Experimentação.

- Vertex AI Agent Builder: A Fábrica para Automação.

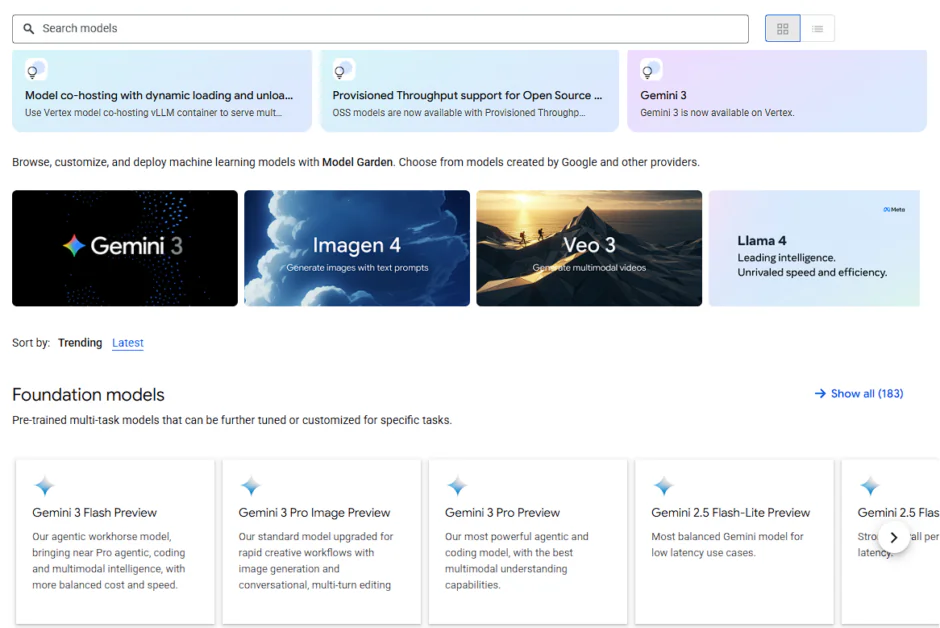

Jardim de Modelos: O Mercado para Descoberta

O Jardim de Modelos do Google Cloud é uma plataforma centralizada dentro do Google Cloud para descobrir, testar, personalizar e implantar uma ampla gama de modelos de IA de primeira parte, de código aberto e de terceiros, incluindo multimodais (visão, texto, código) para várias necessidades de negócios, oferecendo integração perfeita com as ferramentas do Vertex AI para MLOps em fluxo. Ele atua como uma biblioteca abrangente, ajudando desenvolvedores e empresas a selecionar o modelo certo (desde grandes modelos de fundação até especializados) para suas tarefas, seja para geração de texto, análise de imagem ou conclusão de código, e implantá-los eficientemente dentro de seu ambiente do Google Cloud.

O Jardim de Modelos categoriza seus 200+ modelos em três níveis distintos, permitindo que os arquitetos equilibrem desempenho, custo e controle:

- Modelos de Primeira Parte (Google): São os modelos multimodais de bandeira disponíveis dentro do Vertex AI, e o Google os oferece em vários tamanhos, variando do Pro com raciocínio complexo até o Flash com baixa latência e alto volume, permitindo que os desenvolvedores otimizem seus modelos de acordo com seus casos de uso.

- Modelos de Terceira Parte (Proprietários): Por meio de parcerias estratégicas, o Vertex AI oferece acesso “Modelo como um Serviço” (MaaS) a gigantes como Anthropic (Claude 3.5) e Mistral AI. Em vez de gerenciar credenciais de faturamento e segurança separadas para cinco diferentes provedores de IA, uma equipe de tecnologia pode acessar todos eles por meio de seu projeto existente do Google Cloud, usando um formato de API unificado.

- Modelos de Código Aberto e Peso Aberto: Este nível inclui Meta’s Llama 3.2, Mistral, e o próprio Gemma do Google. Eles são ideais para organizações que desejam implantar modelos dentro de sua própria VPC (Rede Privada Virtual) para garantir o máximo de isolamento de dados.

Em um ambiente não unificado, implantar um modelo de código aberto como Llama exige configurar um ambiente PyTorch, configurar drivers CUDA e gerenciar um invólucro Flask ou FastAPI.

O Jardim de Modelos elimina essa fase de “Munging” por meio de Pontos de Extremidade Gerenciados Unificados:

- Implantação com um Clique: Para muitos modelos, clicar em “Implantar” provisiona automaticamente os recursos TPU/GPU necessários, envolve o modelo em um contêiner pronto para produção e fornece um ponto de extremidade de API REST.

- Integração com Hugging Face: O Vertex AI agora permite que os desenvolvedores implantem modelos diretamente do Hugging Face Hub em um ponto de extremidade do Vertex, fornecendo uma expansão quase infinita de inteligência disponível.

- Conexão de Serviço Privada (PSC): Para setores altamente regulamentados, os modelos podem ser implantados usando Conexão de Serviço Privada, garantindo que o ponto de extremidade do modelo nunca seja exposto à internet pública – mantendo o tráfego de dados estritamente dentro da rede corporativa.

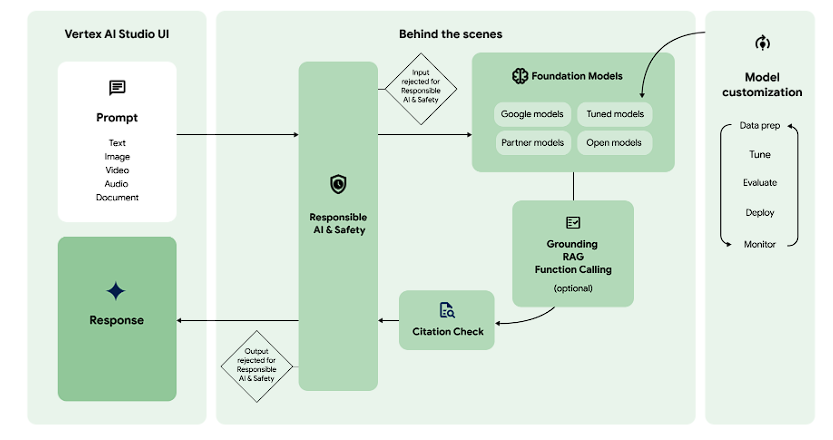

Vertex AI Studio: O Playground para Experimentação

Enquanto o Jardim de Modelos é sobre seleção, o Vertex AI Studio é sobre precisão. O Vertex AI Studio pode ser comparado aos compiladores e depuradores que você encontra no mundo de software tradicional. O Vertex AI Studio é o espaço de trabalho onde os modelos brutos são esculpidos em ferramentas de negócios específicas por meio de uma combinação de engenharia de prompt, teste multimodal e ajuste de hiperparâmetro avançado.

Prototipagem Multimodal: Além do Texto

Uma das características de destaque do Studio é seu suporte nativo a multimodalidade. Enquanto outras plataformas exigem codificação complexa para lidar com dados não textuais, o Vertex AI Studio permite que você insira arquivos diretamente na interface para testar as capacidades de raciocínio do Gemini 2.5.

- Inteligência de Vídeo: Você pode fazer upload de uma palestra técnica de 45 minutos e pedir ao modelo que “identifique cada vez que uma API específica é mencionada e forneça um resumo com marcação de tempo.”

- Análise de Documentos: Em vez de apenas ler texto, o modelo pode analisar o layout visual de um PDF de 1.000 páginas, entendendo a relação entre gráficos, tabelas e a prosa circundante.

- Execução de Código: O Studio agora suporta execução de código no playground. Se você pedir a um modelo que resolva um problema matemático complexo ou analise um CSV, o modelo pode escrever e executar código Python em um ambiente seguro e isolado para fornecer uma resposta verificada.

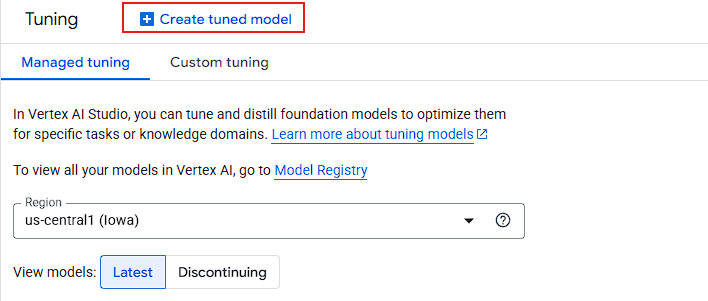

Personalização Avançada: O Caminho de Ajuste

Quando a engenharia de prompt (Zero-shot ou Few-shot) atinge o teto, o Vertex AI Studio fornece a maquinaria pesada: Ajuste de Modelo.

- Ajuste de Fine-Tuning Supervisionado (SFT): Os desenvolvedores fornecem um conjunto de dados de “Prompt/Resposta” pares (idealmente 100+ exemplos). Isso ensina o modelo a adotar uma voz de marca específica, formato de saída (como JSON especializado) ou jargão de domínio específico.

- Cache de Contexto: Para empresas que lidam com conjuntos de dados estáticos maciços (como uma biblioteca jurídica ou uma base de código), o Studio permite Cache de Contexto. Isso permite “pré-carregar” 1 milhão de tokens de dados na memória do modelo, reduzindo drasticamente a latência e os custos para consultas subsequentes.

- Destilação (Professor-Aluno): Esta é uma mudança arquitetônica de alto nível. Você pode usar um modelo maciço (Gemini 2.5 Pro) para “ensinar” um modelo menor e mais rápido (Gemini 2.0 Flash). O resultado é um modelo leve que executa em um nível “Pro” mas roda com a velocidade e o custo do “Flash”.

Vertex AI Agent Builder: A Fábrica para Automação

Vertex AI Agent Builder é um framework de orquestração de alto nível que permite que os desenvolvedores criem esses agentes combinando modelos de fundação com dados de empresa e APIs externas.

A Arquitetura da “Verdade”: Ancoragem e RAG

A barreira técnica principal para a IA empresarial é a alucinação. O Agent Builder resolve isso por meio de um sofisticado motor de Ancoragem.

- Ancoragem com Pesquisa do Google: Para consultas que exigem conhecimento do mundo em tempo real (por exemplo, “Quais são as taxas de hipoteca atuais em Nova York?”), o agente pode realizar uma pesquisa do Google, extrair os fatos e citar suas fontes.

- Pesquisa do Vertex AI (RAG como um Serviço): Em vez de construir manualmente um banco de dados de vetores (Pinecone, Weaviate), os desenvolvedores podem usar Pesquisa do Vertex AI para indexar seus próprios documentos (PDFs, HTML, BigQuery). Ele lida com as etapas de “quebrar”, “incorporar” e “recuperar” automaticamente, garantindo que o agente responda apenas com base em sua “Fonte de Verdade” interna.

- Motor RAG do Vertex AI: Para implementações personalizadas de grande escala, este serviço gerenciado permite uma busca híbrida (combinando resultados baseados em vetores e palavras-chave) para melhorar a precisão em até 30% sobre as saídas LLM padrão.

Orquestração de Múltiplos Agentes (Protocolo A2A)

Os fluxos de trabalho empresariais avançados frequentemente exigem vários agentes especializados trabalhando juntos. O Vertex AI introduz o Protocolo de Agente para Agente (A2A), um padrão aberto que permite:

- O “Agente de Viagens” falar com o “Agente de Finanças” para garantir que uma reserva de voo esteja dentro do orçamento corporativo.

- Interoperabilidade: Como ele usa um protocolo aberto, os agentes construídos no Vertex podem se comunicar com aqueles construídos em outros frameworks, como LangChain ou CrewAI.

A Pilha do Desenvolvedor: ADK e Motor de Agente

Para o público da “plataforma de tecnologia”, o Agent Builder oferece dois caminhos distintos:

- Console sem Código: Uma interface de arrastar e soltar visual para prototipagem rápida e configuração de usuário de negócios.

- Kits de Desenvolvimento de Agente (ADK): Um kit de ferramentas de código Python para engenheiros. Ele permite “Prompt como Código”, integração de controle de versão e a capacidade de implantar no Motor de Agente do Vertex AI—um tempo de execução gerenciado que lida com persistência de sessão, escalabilidade e gerenciamento de estado automaticamente.

Conclusão: De “E se” para “O que vem a seguir”

A transição de um demo de IA impressionante para um aplicativo empresarial de nível de produção tem sido o “vale da morte” para projetos de transformação digital. Como exploramos, o Vertex AI é projetado especificamente para fechar essa lacuna. Ao unificar os silos fragmentados de dados, infraestrutura e orquestração de modelos, o Google Cloud mudou a conversa para longe do poder bruto dos Grandes Modelos de Linguagem e em direção à maturidade operacional do ciclo de vida da IA.