Inteligência artificial

AI Image Matting que compreende as cenas

No documentário extra que acompanha o lançamento do DVD de 2003 Alien3 (1992), a lenda dos efeitos visuais Richard Edlund relembrou com horror a 'luta de sumô' de extração fotoquímica de matte que dominou o trabalho de efeitos visuais entre 1930s final e no final da década de 1980. Edlund descreveu a natureza imprevisível do processo como "luta de sumô", em comparação com as técnicas digitais de tela azul/verde que dominaram no início da década de 1990 (e ele tem devolvida à metáfora desde então).

A extração de um elemento de primeiro plano (como uma pessoa ou um modelo de nave espacial) de um plano de fundo, para que a imagem recortada possa ser composta em uma placa de fundo, foi originalmente obtida filmando-se o objeto de primeiro plano contra um fundo azul ou verde uniforme.

Processos laboriosos de extração fotoquímica para uma filmagem de efeitos visuais feita pela ILM para 'O Retorno de Jedi' (1983). Fonte: https://www.youtube.com/watch?v=qwMLOjqPmbQ

Na filmagem resultante, a cor de fundo seria subsequentemente isolada quimicamente e usada como modelo para reimprimir o objeto (ou pessoa) em primeiro plano em um impressora óptica como um objeto 'flutuante' em uma célula de filme transparente.

O processo era conhecido como sobreposição de separação de cores (CSO) - embora esse termo acabasse se tornando mais associado ao petróleo bruto 'Chromakey' efeitos de vídeo na produção de televisão de baixo orçamento das décadas de 1970 e 1980, que foram alcançados com meios analógicos em vez de químicos ou digitais.

Uma demonstração de sobreposição de separação de cores em 1970 para o programa infantil britânico 'Blue Peter'. Fonte: https://www.bbc.co.uk/archive/blue_peter_noakes_CSO/zwb9vwx

Em qualquer caso, seja para filmes ou elementos de vídeo, a partir daí a filmagem extraída pode ser inserida em qualquer outra filmagem.

Embora a Disney seja notavelmente mais cara e proprietária processo de vapor de sódio (que digitou em amarelo, especificamente, e também foi usava para o terror de Alfred Hitchcock de 1963 Os pássaros) deu melhor definição e foscos mais nítidos, a extração fotoquímica permaneceu meticulosa e não confiável.

O processo patenteado de extração de vapor de sódio da Disney exigia fundos próximos à extremidade amarela do espectro. Aqui, Angela Lansbury está suspensa em fios durante a produção de uma sequência repleta de efeitos visuais para "Bedknobs and Broomsticks" (1971). fonte

Além da cobertura digital

Na década de 1990, a revolução digital dispensou os produtos químicos, mas não a necessidade de telas verdes. Agora era possível remover o fundo verde (ou qualquer cor) apenas procurando por pixels dentro de uma faixa de tolerância daquela cor, em software de edição de pixels como o Photoshop, e uma nova geração de suítes de composição de vídeo que podiam codificar automaticamente os fundos coloridos. Quase da noite para o dia, sessenta anos da indústria de impressão óptica ficaram para a história.

Os últimos dez anos de pesquisa de visão computacional acelerada por GPU estão conduzindo a extração de foscos para uma terceira era, incumbindo os pesquisadores do desenvolvimento de sistemas que possam extrair foscos de alta qualidade sem a necessidade de telas verdes. Somente no Arxiv, artigos relacionados a inovações na extração de primeiro plano baseada em aprendizado de máquina são publicados semanalmente.

Colocando-nos na foto

Esse locus de interesse acadêmico e da indústria na extração de IA já afetou o espaço do consumidor: implementações rudimentares, mas viáveis, são familiares para todos nós na forma de Zoom e Skype filtros que podem substituir nossos fundos de sala de estar por ilhas tropicais, e outros, em chamadas de videoconferência.

No entanto, os melhores mattes ainda requerem uma tela verde, como Zoom anotado última quarta-feira.

À esquerda, um homem em frente a uma tela verde, com cabelos bem extraídos pelo recurso Fundo Virtual do Zoom. À direita, uma mulher em frente a uma cena doméstica normal, com cabelos extraídos algoritmicamente, com menos precisão e com requisitos de computação mais elevados. Fonte: https://support.zoom.us/hc/en-us/articles/210707503-Changing-your-Virtual-Background-image

A postar mais da plataforma Zoom Support adverte que a extração de tela não verde também requer maior poder de computação no dispositivo de captura.

A necessidade de cortá-lo

Melhorias na qualidade, portabilidade e economia de recursos para sistemas de extração de matte "na natureza" (ou seja, isolar pessoas sem a necessidade de telas verdes) são relevantes para muitos outros setores e atividades do que apenas filtros de videoconferência.

Para o desenvolvimento de conjuntos de dados, o reconhecimento facial, de cabeça e corpo inteiro aprimorados oferece a possibilidade de garantir que elementos de fundo estranhos não sejam treinados em modelos de visão computacional de sujeitos humanos; um isolamento mais preciso melhoraria muito segmentação semântica técnicas projetadas para distinguir e assimilar domínios (ou seja, 'gato', 'pessoa', 'barco'), e melhorar VAE e transformadorsistemas de síntese de imagens baseados em algoritmos, como o novo OpenAI DALL-E2; e melhores algoritmos de extração reduziriam a necessidade de manuais caros rotoscopia em dispendiosos pipelines VFX.

Na verdade, a ascendência multimodal Metodologias (geralmente texto/imagem), nas quais um domínio como "gato" é codificado como uma imagem e com referências textuais associadas, já estão se expandindo no processamento de imagens. Um exemplo recente é o Text2Live arquitetura, que usa treinamento multimodal (texto/imagem) para criar vídeos de, entre inúmeras outras possibilidades, cisnes de cristal e girafas de vidro.

IA sensível à cena Matting

Muitas pesquisas sobre matting automático baseado em IA se concentraram no reconhecimento de limites e na avaliação de agrupamentos baseados em pixels dentro de uma imagem ou quadro de vídeo. No entanto, uma nova pesquisa da China oferece um canal de extração que melhora o delineamento e a qualidade fosca, aproveitando descrições baseadas em texto de uma cena (uma abordagem multimodal que ganhou força no setor de pesquisa de visão computacional nos últimos 3-4 anos), alegando ter melhorado os métodos anteriores de várias maneiras.

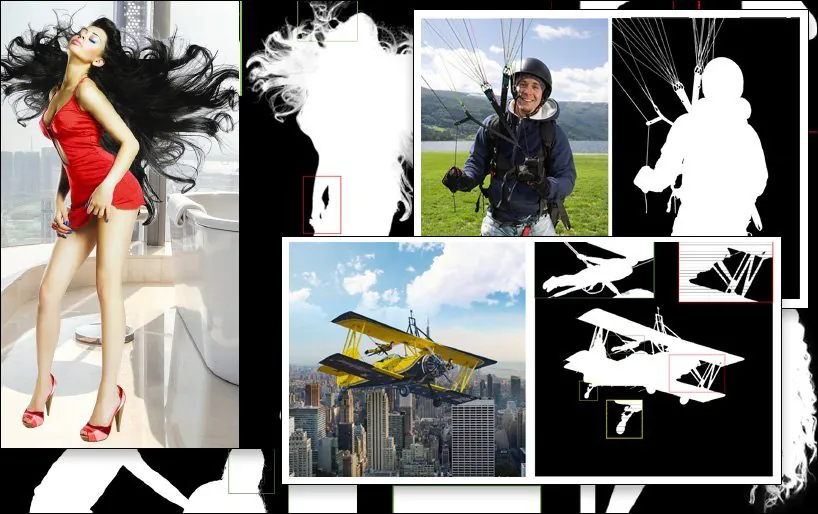

Um exemplo de extração SPG-IM (última imagem, canto inferior direito), comparada com métodos concorrentes anteriores. Fonte: https://arxiv.org/pdf/2204.09276.pdf

O desafio colocado para o subsetor de pesquisa de extração é produzir fluxos de trabalho que exijam um mínimo de anotação manual e intervenção humana – idealmente, nenhuma. Além das implicações de custo, os pesquisadores do novo artigo observam que anotações e segmentações manuais realizadas por crowdworkers terceirizados em várias culturas podem fazer com que as imagens sejam rotuladas ou mesmo segmentadas de maneiras diferentes, levando a algoritmos inconsistentes e insatisfatórios.

Um exemplo disso é a interpretação subjetiva do que define um "objeto de primeiro plano":

Do novo artigo: métodos anteriores LFM e MODNet ('GT' significa Ground Truth, um resultado 'ideal' geralmente obtido manualmente ou por métodos não algorítmicos), têm abordagens diferentes e variadamente eficazes na definição do conteúdo de primeiro plano, enquanto o novo método SPG-IM delineia de forma mais eficaz o 'conteúdo próximo' por meio do contexto da cena.

Para resolver isso, os pesquisadores desenvolveram um pipeline de dois estágios intitulado Imagem Guiada por Percepção Situacional Matting (SPG-IM). A arquitetura do codificador/decodificador de dois estágios compreende a Destilação de Percepção Situacional (SPD) e o Fosco Guiado por Percepção Situacional (SPGM).

Primeiro, o SPD pré-treina transformações de recursos visuais para textuais, gerando legendas apropriadas para suas imagens associadas. Depois disso, a previsão da máscara de primeiro plano é habilitada conectando o pipeline a um novo previsão de saliência técnica.

Em seguida, o SPGM gera um alpha matte estimado com base na entrada da imagem RGB bruta e na máscara gerada obtida no primeiro módulo.

O objetivo é a orientação da percepção situacional, em que o sistema tem uma compreensão contextual do que é a imagem, permitindo enquadrar – por exemplo – o desafio de extrair cabelos complexos de um fundo contra características conhecidas de uma tarefa tão específica.

No exemplo abaixo, o SPG-IM entende que os cabos são intrínsecos a um "paraquedas", enquanto o MODNet não consegue reter e definir esses detalhes. Da mesma forma acima, a estrutura completa do aparato do playground é arbitrariamente perdida no MODNet.

O novo papel é intitulado Imagem Guiada por Percepção Situacional Matting, e vem de pesquisadores do OPPO Research Institute, PicUp.ai e Xmotors.

Mates Automatizados Inteligentes

O SPG-IM também oferece uma Rede de Refinamento de Transformação Focal Adaptativa (AFT) que pode processar detalhes locais e contexto global separadamente, facilitando 'materiais inteligentes'.

Entender o contexto da cena, neste caso 'garota com cavalo', pode tornar a extração do primeiro plano mais fácil do que os métodos anteriores.

O artigo afirma:

'Acreditamos que as representações visuais da tarefa visual para textual, por exemplo A legendagem de imagens, por sua vez, concentra-se em sinais semanticamente mais abrangentes entre a) objeto e b) objeto e o ambiente, gerando descrições que possam abranger tanto informações globais quanto detalhes locais. Além disso, em comparação com a dispendiosa anotação de pixels da matização de imagens, rótulos textuais podem ser coletados em larga escala a um custo muito baixo.

O ramo SPD da arquitetura é pré-treinado em conjunto com a Universidade de Michigan Virtex decodificador textual baseado em transformador, que aprende representações visuais de legendas semanticamente densas.

O VirTex treina conjuntamente um ConvNet e Transformers por meio de dísticos de legenda de imagem e transfere os insights obtidos para tarefas de visão downstream, como detecção de objetos. Fonte: https://arxiv.org/pdf/2006.06666.pdf

Entre outros testes e estudos de ablação, os pesquisadores testaram o SPG-IM contra o estado da arte mapa trimestralmétodos baseados em Deep Image Matting (DIM), IndexNet, Matting de imagem sensível ao contexto (CAM), Atenção Contextual Orientada (GCA) FBA, e Mapeamento Semântico de Imagens (SIM).

Outras estruturas anteriores testadas incluíram abordagens sem trimap LFM, HAttMatting e MODNet. Para uma comparação justa, os métodos de teste foram adaptados com base nas diferentes metodologias; onde o código não estava disponível, as técnicas do artigo foram reproduzidas a partir da arquitetura descrita.

O novo papel afirma:

Nosso SPG-IM supera todos os métodos concorrentes sem trimapa ([LFM], [HAttMatting] e [MODNet]) por uma ampla margem. Ao mesmo tempo, nosso modelo também demonstra notável superioridade sobre os métodos de última geração (SOTA) baseados em trimapa e guiados por máscara em termos de todas as quatro métricas nos conjuntos de dados públicos (ou seja, Composição-1K, Distinção-646 e Humano-2K) e nosso benchmark Multi-Objeto-1K.

E continua:

"Pode-se observar claramente que nosso método preserva detalhes finos (por exemplo, pontas de cabelo, texturas transparentes e limites) sem a orientação do trimap. Além disso, em comparação com outros modelos concorrentes sem trimap, nosso SPG-IM consegue reter melhor completude semântica global."

Publicado pela primeira vez em 24 de abril de 2022.