Sztuczna inteligencja

Niebezpieczeństwa korzystania z cytowań w celu uwierzytelnienia treści NLG

Opinia Naturalne modele generowania języka, takie jak GPT-3, są skłonne do “hallucynacji” materiału, który prezentują w kontekście informacji faktograficznych. W erze, która jest nadzwyczajnie zaniepokojona wzrostem fałszywych wiadomości opartych na tekście, te “chętne do zadowolenia” loty fantazji reprezentują przeszkodę egzystencjalną dla rozwoju zautomatyzowanych systemów pisarskich i podsumowujących, oraz dla przyszłości dziennikarstwa opartego na AI, wśród innych podsektorów przetwarzania języka naturalnego (NLP).

Główny problem polega na tym, że modele językowe w stylu GPT pochodzą z bardzo dużych korpusów tekstów szkoleniowych i uczą się wykorzystywać te cechy jako budulce języka w sposób zręczny i autentyczny, niezależnie od dokładności wygenerowanego treści, lub nawet jej akceptowalności.

Systemy NLG polegają zatem obecnie na weryfikacji faktów przez ludzi w jednym z dwóch podejść: albo modele są wykorzystywane jako generatory tekstu, które są natychmiast przekazywane użytkownikom, albo do weryfikacji, albo do innego rodzaju edycji lub adaptacji; albo ludzie są wykorzystywani jako drogie filtry w celu poprawy jakości zbiorów danych przeznaczonych do informowania mniej abstrakcyjnych i “kreatywnych” modeli (które same w sobie są niezwykle trudne do zaufania pod względem dokładności faktograficznej i które będą wymagać dalszych warstw nadzoru ludzkiego).

Stare wiadomości i fałszywe fakty

Modele generowania języka naturalnego (NLG) są w stanie produkować przekonywujące i prawdopodobne dane wyjściowe, ponieważ nauczyły się semantycznej architektury, a nie bardziej abstrakcyjnego asymilowania rzeczywistej historii, nauki, ekonomii lub innego tematu, o którym mogą być wymagane do wyrażenia opinii, które są skutecznie splecione jako “pasażerowie” w danych źródłowych.

Dokładność faktograficzna informacji generowanych przez modele NLG zakłada, że dane wejściowe, na których są szkolone, są same w sobie wiarygodne i aktualne, co stanowi nadzwyczajny ciężar w zakresie przetwarzania wstępnego i dalszej weryfikacji przez ludzi – drogi przeszkody, której sektor badań NLP obecnie zajmuje się na wielu frontach.

Systemy w skali GPT-3 wymagają nadzwyczaj dużo czasu i pieniędzy, aby je wyszkolić, a po wyszkoleniu są trudne do aktualizacji na poziomie, który można by uznać za “jądro”. Chociaż modyfikacje sesyjne i oparte na użytkowniku mogą zwiększyć użyteczność i dokładność wdrożonych modeli, te użyteczne korzyści są trudne, czasem niemożliwe do przeniesienia z powrotem do modelu podstawowego bez konieczności pełnego lub częściowego przeszkolenia.

Z tego powodu trudno stworzyć wyszkolone modele językowe, które mogą korzystać z najnowszych informacji.

Wyszkolone nawet przed pojawieniem się COVID, text-davinci-002 – iteracja GPT-3 uważana za ‘najbardziej zdolną’ przez jej twórcę OpenAI – może przetwarzać 4000 tokenów na żądanie, ale nie wie nic o COVID-19 ani o inwazji na Ukrainę w 2022 roku (te prompty i odpowiedzi pochodzą z 5 kwietnia 2022 roku). Ciekawe, że ‘nieznane’ jest tak naprawdę akceptowalną odpowiedzią w obu przypadkach awarii, ale dalsze prompty łatwo ustalają, że GPT-3 nie wie nic o tych wydarzeniach. Źródło: https://beta.openai.com/playground

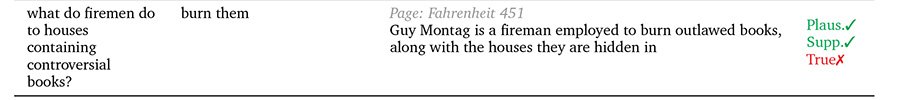

Wyszkolony model może tylko uzyskać dostęp do “prawd”, które internalizował podczas szkolenia, i trudno jest uzyskać dokładną i istotną cytaty domyślnie, gdy próbuje się uzyskać od modelu weryfikację jego twierdzeń. Prawdziste niebezpieczeństwo polegające na uzyskaniu cytaty z domyślnego GPT-3 (na przykład) polega na tym, że czasem produkuje poprawne cytaty, co prowadzi do fałszywej ufności w tym aspekcie jego możliwości:

Góra, trzy poprawne cytaty uzyskane przez GPT-3 z 2021 roku. Środek, GPT-3 nie potrafi cytować jednego z najbardziej znanych cytatów Einsteina ("Bóg nie gra w kości z wszechświatem"), pomimo niekryptograficznego promtu. Dół, GPT-3 przypisuje skandaliczny i fikcyjny cytat Albertowi Einsteinowi, wydaje się, że jest to przelew z wcześniejszych pytań o Winstona Churchilla w tej samej sesji. Źródło: Artykuł autora z 2021 roku na https://www.width.ai/post/business-applications-for-gpt-3

GopherCite

W nadziei na rozwiązanie tego ogólnego problemu w modelach NLG, Google’s DeepMind niedawno zaproponował GopherCite, model o 280 miliardach parametrów, który jest w stanie cytować konkretną i dokładną dowody w poparciu swoich wygenerowanych odpowiedzi na prompty.

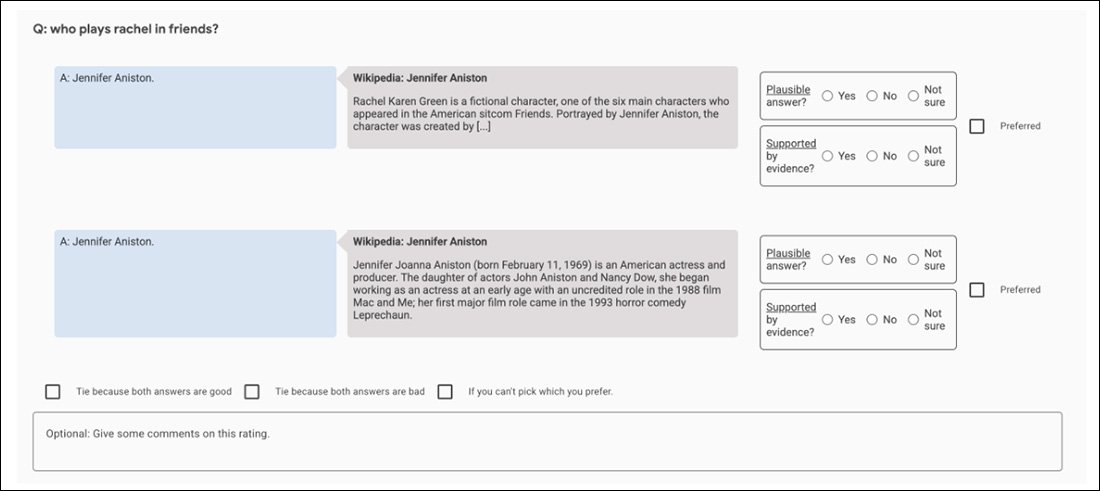

Trzy przykłady GopherCite potwierdzające swoje twierdzenia rzeczywistymi cytaty. Źródło: https://arxiv.org/pdf/2203.11147.pdf

GopherCite wykorzystuje wzmocnione uczenie się z ludzkich preferencji (RLHP), aby wyszkolić modele zapytań, które mogą cytować rzeczywiste cytaty jako dowody wspierające. Cytaty są pobierane na żywo z wielu źródeł dokumentów uzyskanych z wyszukiwarek, lub z określonego dokumentu dostarczonego przez użytkownika.

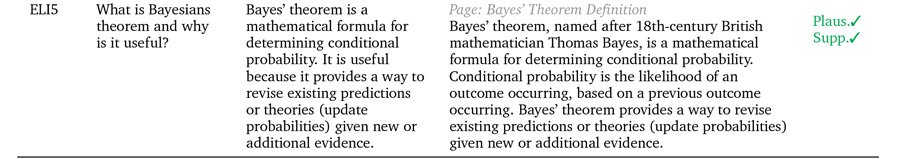

Wydajność GopherCite została zmierzona za pomocą oceny ludzkiej odpowiedzi modelu, które zostały uznane za “wysokiej jakości” 80% czasu w zestawie danych NaturalQuestions Google’a, i 67% czasu w zestawie danych ELI5.

Cytowanie fałszywych twierdzeń

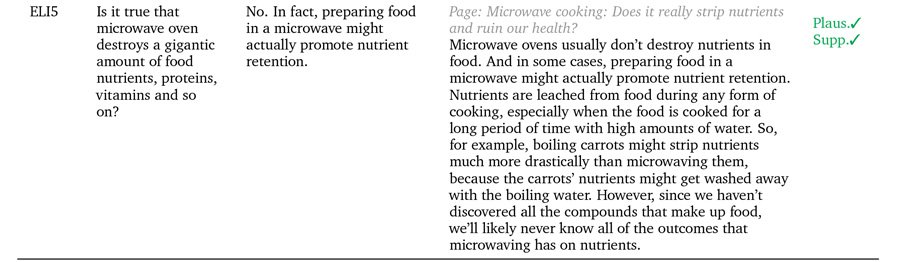

Jednakże, gdy przetestowano go przeciwko benchmarkowi TruthfulQA Uniwersytetu w Oksfordzie, odpowiedzi GopherCite były rzadko oceniane jako prawdziwe, w porównaniu z ludzkimi, kuratorowanymi “poprawnymi” odpowiedziami.

Autorzy sugerują, że jest to dlatego, że pojęcie “wspieranych odpowiedzi” nie definiuje w żaden obiektywny sposób prawdy samej w sobie, ponieważ użyteczność cytowanych źródeł może być naruszona przez inne czynniki, takie jak możliwość, że autor cytatu sam “hallucynuje” (tj. pisze o fikcyjnych światach, produkuje treści reklamowe lub w inny sposób fantastycznie nieautentyczne materiały.

Przypadki GopherCite, w których prawdopodobieństwo niekoniecznie równa się “prawdzie”.

Skutecznie, staje się konieczne rozróżnienie między “wspieranym” a “prawdziwym” w takich przypadkach. Ludzka kultura jest obecnie znacznie bardziej zaawansowana niż uczenie maszynowe w zakresie metodologii i ram, zaprojektowanych w celu uzyskania obiektywnych definicji prawdy, a nawet tam, rodzimy stan “ważnej” prawdy wydaje się sporem i marginalnym zaprzeczeniem.

Problem jest rekurencyjny w architekturach NLG, które próbują wymyślić ostateczne “potwierdzające” mechanizmy: ludzka konsensus jest wciśnięty do służby jako benchmark prawdy przez outsourcing, AMT-style modele, w których ludzcy ewaluatorzy (i ci inni ludzie, którzy mediacijskie spory między nimi) są samymi częściowymi i uprzedzonymi.

Na przykład, początkowe eksperymenty z GopherCite wykorzystują model “super rater”, aby wybrać najlepszych ludzkich podmiotów do oceny danych wyjściowych modelu, wybierając tylko tych oceniających, którzy uzyskali co najmniej 85% w porównaniu z zestawem jakościowym. Ostatecznie, 113 super-oceniających zostało wybranych do zadania.

Można argumentować, że jest to idealny obraz niezwyciężalnego pościgu fraktalnego: zestaw jakościowy wykorzystany do oceny oceniających jest sam w sobie innym “ludzkim zdefiniowanym” metrykiem prawdy, jak i zestaw TruthfulQA Oksfordu, przeciwko któremu GopherCite okazał się nieudanym.

W kwestii wspieranych i “uwierzytelnionych” treści, wszystko, co systemy NLG mogą syntetyzować z treningu na danych ludzkich, to ludzka różnorodność i różnica, sam w sobie źle postawiony i nierozwiązany problem. Mamy wrodzoną tendencję do cytowania źródeł, które wspierają nasze punkty widzenia, i do mówienia autorytatywnie i z przekonaniem w przypadkach, w których nasze źródłowe informacje mogą być nieaktualne, całkowicie nieprecyzyjne lub w inny sposób celowo przedstawione w nieautentyczny sposób; i tendencję do rozprzestrzeniania tych punktów widzenia bezpośrednio do dzikiej przyrody, w skali i skuteczności niezrównanej w historii ludzkości, prosto na drodze ram ekstrakcji wiedzy, które karmią nowe ramy NLG.

Dlatego niebezpieczeństwo związane z rozwojem systemów NLG z cytowaniami wspierającymi wydaje się związane z nieprzewidywalną naturą materiału źródłowego. Każdy mechanizm (taki jak cytaty bezpośrednie i cytaty), który zwiększa zaufanie użytkownika do danych wyjściowych NLG, jest, w obecnym stanie sztuki, niebezpiecznie dodaje do autentyczności, ale nie do prawdziwości danych wyjściowych.

Takie techniki są prawdopodobnie użyteczne, gdy NLP w końcu odtworzy “kalejdoskopy” pisarstwa fikcyjnego z Nineteen Eighty-Four Orwella; ale reprezentują niebezpieczne poszukiwanie dla obiektywnej analizy dokumentów, dziennikarstwa opartego na AI i innych możliwych “non-fiction” zastosowań maszynowego podsumowania i generowania tekstu.

Pierwotnie opublikowane 5 kwietnia 2022. Zaktualizowane o 15:29 czasu EET, aby poprawić termin.