Sztuczna inteligencja

Problem Czarnego Pudełka w LLM: Wyzwania i Pojawiające się Rozwiązania

Uczenie maszynowe, podzbiór sztucznej inteligencji, składa się z trzech składników: algorytmów, danych szkoleniowych i wynikowego modelu. Algorytm, który jest podstawowym zestawem procedur, uczy się identyfikować wzorce z dużego zbioru przykładów (danych szkoleniowych). Kulminacją tego szkolenia jest model uczenia maszynowego. Na przykład, algorytm wyszkolony z obrazami psów spowodowałby powstanie modelu zdolnego do identyfikacji psów na obrazach.

Czarna Skrzynka w Uczeniu Maszynowym

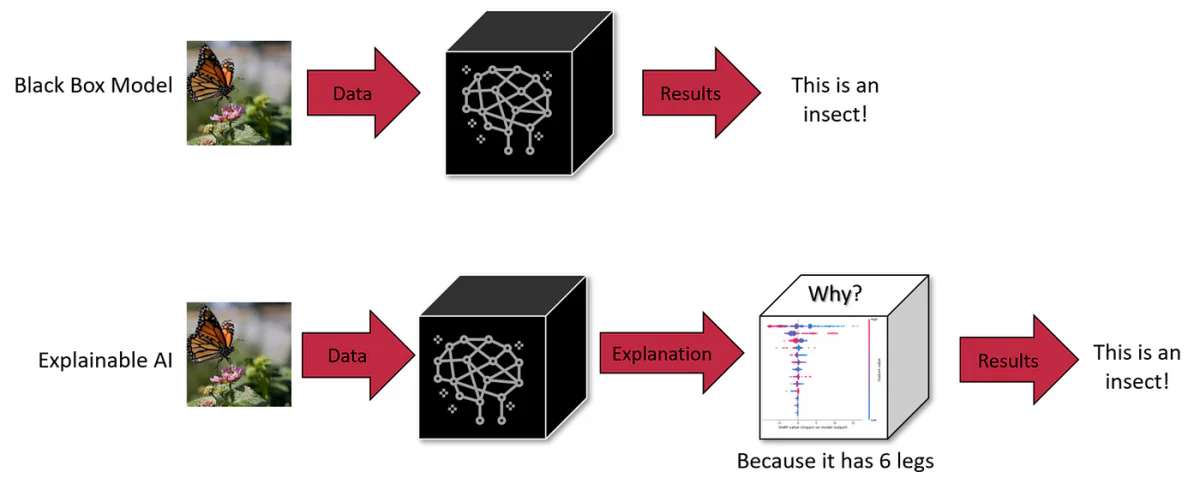

W uczeniu maszynowym, którykolwiek z trzech składników — algorytm, dane szkoleniowe lub model — może być czarną skrzynką. Chociaż algorytmy są często publicznie znane, deweloperzy mogą zdecydować się na utrzymanie modelu lub danych szkoleniowych w tajemnicy w celu ochrony własności intelektualnej. Ta nieprzezroczystość sprawia, że trudno zrozumieć proces podejmowania decyzji przez sztuczną inteligencję.

Czarna skrzynka w sztucznej inteligencji to systemy, których wewnętrzne mechanizmy pozostają nieprzezroczyste lub niewidoczne dla użytkowników. Użytkownicy mogą wprowadzać dane i otrzymywać dane wyjściowe, ale logika lub kod, który produkuje dane wyjściowe, pozostaje ukryty. Jest to powszechna cecha wielu systemów sztucznej inteligencji, w tym zaawansowanych modeli generatywnych, takich jak ChatGPT i DALL-E 3.

LLM, takie jak GPT-4, stanowią znaczące wyzwanie: ich wewnętrzne mechanizmy są w dużej mierze nieprzezroczyste, czyniąc je “czarnymi skrzynkami”. Taka nieprzezroczystość nie jest tylko zagadnieniem technicznym; stanowi realne zagrożenie dla bezpieczeństwa i etyki. Na przykład, jeśli nie możemy zrozumieć, w jaki sposób te systemy dochodzą do wniosków, czy możemy im ufać w krytycznych obszarach, takich jak diagnozy medyczne lub oceny finansowe?

Badanie Technik LIME i SHAP

Interpretowalność w modelach uczenia maszynowego (ML) i głębokiego uczenia (DL) pomaga nam zrozumieć nieprzezroczyste wewnętrzne mechanizmy tych zaawansowanych modeli. Local Interpretable Model-agnostic Explanations (LIME) i SHapley Additive exPlanations (SHAP) to dwie takie popularne techniki interpretowalności.

LIME, na przykład, rozwiązuje problem złożoności, tworząc prostsze, lokalne modele zastępcze, które przybliżają zachowanie oryginalnego modelu wokół konkretnego wejścia. Dzięki temu LIME pomaga w zrozumieniu, w jaki sposób poszczególne cechy wpływają na przewidywania złożonych modeli, podając w zasadzie “lokalne” wyjaśnienie, dlaczego model podjął pewną decyzję. Jest to szczególnie przydatne dla użytkowników niebędących specjalistami, ponieważ tłumaczy skomplikowany proces podejmowania decyzji modeli na bardziej zrozumiałe pojęcia.

SHAP, z drugiej strony, czerpie inspirację z teorii gier, a konkretnie z pojęcia wartości Shapleya. Przypisuje “wagę” każdej cechy, wskazując, jak bardzo każda cecha przyczynia się do różnicy między rzeczywistą przewidywaniem a przewidywaniem podstawowym (średnim przewidywaniem we wszystkich wejściach). Siła SHAP tkwi w jego spójności i zdolności do zapewnienia globalnej perspektywy — nie tylko wyjaśnia poszczególne przewidywania, ale także dostarcza wglądu w cały model. Jest to szczególnie cenne w modelach głębokiego uczenia, gdzie połączone warstwy i liczne parametry często sprawiają, że proces przewidywania wydaje się podróżą przez labirynt. SHAP demistyfikuje to, ilustrując wkład każdej cechy, oferując jaśniejszą mapę ścieżek podejmowania decyzji modelu.

SHAP (Source)

Obie techniki, LIME i SHAP, stały się niezbędnymi narzędziami w dziedzinie sztucznej inteligencji i uczenia maszynowego, odpowiadając na krytyczną potrzebę przejrzystości i wiarygodności. Im bardziej integrujemy sztuczną inteligencję w różne sektory, tym bardziej zdolność do interpretacji i zrozumienia tych modeli staje się nie tylko techniczną koniecznością, ale podstawowym wymogiem dla etycznego i odpowiedzialnego rozwoju sztucznej inteligencji. Te techniki reprezentują znaczące postępy w rozwiązywaniu złożoności modeli uczenia maszynowego i głębokiego uczenia, przekształcając je z nieprzezroczystych “czarnych skrzynek” w zrozumiałe systemy, których decyzje i zachowania mogą być zrozumiane, zaufane i skutecznie wykorzystywane.

Skala i Złożoność LLM

Skala tych modeli dodatkowo zwiększa ich złożoność. Weźmy na przykład GPT-3, z jego 175 miliardami parametrów, i nowsze modele posiadające biliony. Każdy parametr oddziałuje w skomplikowany sposób w sieci neuronowej, przyczyniając się do powstania emergentnych zdolności, które nie są przewidywalne przez analizę poszczególnych składników. Ta skala i złożoność sprawiają, że niemal niemożliwe jest pełne zrozumienie ich wewnętrznej logiki, stanowiąc przeszkodę w diagnozowaniu uprzedzeń lub niepożądanych zachowań w tych modelach.

Kompromis: Skala a Interpretowalność

Zmniejszenie skali LLM mogłoby poprawić interpretowalność, ale kosztem ich zaawansowanych możliwości. Skala jest tym, co umożliwia zachowania, których mniejsze modele nie mogą osiągnąć. To przedstawia wewnętrzny kompromis między skalą, możliwościami i interpretowalnością.

Wpływ Problemu Czarnego Pudełka LLM

1. Wadliwe Podejmowanie Decyzji

Nieprzezroczystość w procesie podejmowania decyzji przez LLM, takie jak GPT-3 lub BERT, może prowadzić do niewykrytych uprzedzeń i błędów. W dziedzinach, takich jak opieka zdrowotna lub wymiar sprawiedliwości, gdzie decyzje mają dalekosiężne konsekwencje, brak możliwości audytu LLM pod kątem etycznego i logicznego poprawności jest poważnym problemem. Na przykład, model diagnostyki medycznej LLM opierający się na przestarzałych lub tendencyjnych danych może podawać szkodliwe zalecenia. Podobnie, LLM w procesach rekrutacji może nieumyślnie utrwalać uprzedzenia płciowe. Nieprzezroczystość nie tylko ukrywa wady, ale może również potencjalnie je nasilić, wymagając proaktywnego podejścia w celu poprawy przejrzystości.

2. Ograniczona Adaptowalność w Różnych Kontekstach

Brak wglądu w wewnętrzne mechanizmy LLM ogranicza ich adaptowalność. Na przykład, LLM do rekrutacji może być niewydajne w ocenie kandydatów na stanowisko, które ceni umiejętności praktyczne ponad kwalifikacje akademickie, z powodu braku możliwości dostosowania swoich kryteriów oceny. Podobnie, model medyczny LLM może mieć trudności z diagnozowaniem rzadkich chorób z powodu nierównowagi danych. Ta nieelastyczność podkreśla potrzebę przejrzystości w celu ponownego skalibrowania LLM dla konkretnych zadań i kontekstów.

3. Uprzedzenia i Luki Wiedzy

Przetwarzanie ogromnych zbiorów danych szkoleniowych przez LLM jest poddane ograniczeniom narzucanym przez ich algorytmy i architektury modeli. Na przykład, model medyczny LLM może wykazywać demograficzne uprzedzenia, jeśli został wyszkolony na niezrównoważonych zbiorach danych. Również umiejętność LLM w dziedzinach niszowych może być myląca, prowadząc do zbyt pewnych, błędnych danych wyjściowych. Rozwiązywanie tych uprzedzeń i luk wiedzy wymaga więcej niż tylko dodatkowych danych; wymaga analizy mechanizmów przetwarzania modelu.

4. Prawna i Etyczna Odpowiedzialność

Nieprzezroczysty charakter LLM tworzy szarą strefę prawną dotyczącą odpowiedzialności za szkody spowodowane przez ich decyzje. Jeśli LLM w środowisku medycznym dostarcza błędnych wskazówek, prowadząc do szkody pacjenta, określenie odpowiedzialności staje się trudne z powodu nieprzezroczystości modelu. Ta niepewność prawna niesie ze sobą ryzyko dla podmiotów wdrażających LLM w wrażliwych obszarach, podkreślając potrzebę jasnego zarządzania i przejrzystości.

5. Problemy z Ufnością w Wrażliwych Aplikacjach

Dla LLM stosowanych w krytycznych obszarach, takich jak opieka zdrowotna i finanse, brak przejrzystości podważa ich wiarygodność. Użytkownicy i regulatorzy muszą zapewnić, że te modele nie zawierają uprzedzeń ani nie podejmują decyzji na podstawie niesprawiedliwych kryteriów. Weryfikacja braku uprzedzeń w LLM wymaga zrozumienia ich procesów podejmowania decyzji, podkreślając znaczenie wyjaśnialności dla etycznego wdrożenia.

6. Ryzyko z Danych Osobowych

LLM wymagają obszernych danych szkoleniowych, które mogą zawierać wrażliwe informacje osobowe. Nieprzezroczysty charakter tych modeli budzi obawy dotyczące tego, jak te dane są przetwarzane i wykorzystywane. Na przykład, model medyczny LLM szkolony na danych pacjentów budzi pytania dotyczące prywatności i wykorzystania danych. Zapewnienie, że dane osobowe nie są nadużywane lub wykorzystywane, wymaga przejrzystych procesów przetwarzania danych w ramach tych modeli.

Pojawiające się Rozwiązania dla Interpretowalności

Aby rozwiązać te wyzwania, rozwijane są nowe techniki. Obejmują one metody przybliżonej kontrfaktualności (CF). Pierwsza metoda polega na nakłonieniu LLM do zmiany konkretnego pojęcia tekstu, przy zachowaniu innych pojęć w stałej postaci. Ten podejście, choć skuteczne, jest zasobożerne w czasie inferencji.

Druga metoda polega na utworzeniu dedykowanego przestrzeni wektorowej podczas szkolenia LLM. Ta przestrzeń jest wyrównana z grafem przyczynowym i pomaga identyfikować dopasowania przybliżone do kontrfaktualności. Metoda ta wymaga mniej zasobów w czasie testowym i okazała się skuteczna w wyjaśnianiu przewidywań modelu, nawet w LLM z miliardami parametrów.

Podejścia te podkreślają znaczenie wyjaśnień przyczynowych w systemach NLP, aby zapewnić bezpieczeństwo i ustanowić zaufanie. Przybliżenia kontrfaktualne zapewniają sposób wyobrażenia sobie, jak dany tekst zmieniłby się, gdyby pewne pojęcie w jego procesie generowania było inne, ułatwiając praktyczną estymację efektu przyczynowego wysokopoziomowych pojęć w modelach NLP.

Głębokie Zanurzenie: Metody Wyjaśniania i Przyczynowości w LLM

Narzędzia Sondowania i Wagi Cech

Sondowanie to technika stosowana w celu rozgryzienia, co wewnętrzne reprezentacje w modelach zakodują. Może to być albo nadzorowane, albo nienadzorowane i jest ukierunkowane na określenie, czy określone pojęcia są zakodowane w określonych miejscach sieci. Chociaż skuteczne do pewnego stopnia, sondy nie dają pełnych wyjaśnień przyczynowych, jak podkreślili Geiger i inni (2021).

Narzędzia wagi cech, inny rodzaj metody wyjaśniania, często koncentrują się na cechach wejściowych, chociaż niektóre metody oparte na gradientach rozciągają to na stany ukryte. Przykładem jest metoda Zintegrowanych Gradientów, która oferuje interpretację przyczynową, badając dane wejściowe podstawowe (kontrfaktualne, CF). Pomimo ich przydatności, metody te nadal mają trudności w połączeniu swoich analiz z pojęciami świata rzeczywistego, wykraczającymi poza proste właściwości wejściowe.

Metody Oparte na Interwencji

Metody oparte na interwencji obejmują modyfikowanie danych wejściowych lub wewnętrznych reprezentacji w celu zbadania efektów na zachowanie modelu. Metody te mogą tworzyć stany kontrfaktualne, aby oszacować efekty przyczynowe, ale często generują nieprawdopodobne dane wejściowe lub stany sieci, chyba że są starannie kontrolowane. Model Causal Proxy (CPM), zainspirowany pojęciem S-learner, jest nowatorskim podejściem w tej dziedzinie, naśladując zachowanie wyjaśnianego modelu pod danych wejściowych kontrfaktualnych. Niemniej, potrzeba odrębnego wyjaśniacza dla każdego modelu jest znaczącą ograniczeniem.

Przybliżanie Kontrfaktualności

Kontrfaktualności są powszechnie stosowane w uczeniu maszynowym do augmentacji danych, obejmując perturbacje różnych czynników lub etykiet. Mogą one być generowane przez edycję ręczną, heurystyczną zamianę słów kluczowych lub automatyczne przepisywanie tekstu. Chociaż edycja ręczna jest dokładna, jest również zasobożerna. Metody oparte na słowach kluczowych mają swoje ograniczenia, a podejścia generatywne oferują balans między płynnością a pokryciem.

Wiernie Wyjaśnienia

Wiernie wyjaśnienia odnoszą się do dokładnego przedstawienia wewnętrznej logiki modelu. Nie ma powszechnie akceptowanej definicji wierności, co prowadzi do jej charakteryzacji przez różne metryki, takie jak Wrażliwość, Spójność, Zgodność Wagi Cech, Wytrzymałość i Symulowalność. Większość tych metod koncentruje się na wyjaśnieniach na poziomie cech i często łączy korelację z przyczynowością. Nasza praca ma na celu dostarczenie wyjaśnień na poziomie wysokich pojęć, wykorzystując literaturę na temat przyczynowości, aby zaproponować intuicyjny kryterium: Porządkową Wierność.

Zanurzyliśmy się w wewnętrzne złożoności LLM, zrozumieliśmy ich “czarną skrzynkę” i znaczące wyzwania, jakie stwarza. Od ryzyka wadliwego podejmowania decyzji w wrażliwych obszarach, takich jak opieka zdrowotna i finanse, po etyczne dylematy związane z uprzedzeniami i sprawiedliwością, potrzeba przejrzystości w LLM jest bardziej widoczna niż kiedykolwiek.

Przyszłość LLM i ich integracja z naszym codziennym życiem i procesami podejmowania decyzji zależy od naszej zdolności do uczynienia tych modeli nie tylko bardziej zaawansowanych, ale także bardziej zrozumiałych i odpowiedzialnych. Pogoń za wyjaśnialnością i interpretowalnością nie jest tylko przedsięwzięciem technicznym, ale podstawowym aspektem budowania zaufania do systemów sztucznej inteligencji. Im bardziej LLM stają się częścią społeczeństwa, tym bardziej rośnie popyt na przejrzystość, nie tylko ze strony praktyków sztucznej inteligencji, ale każdego użytkownika, który wchodzi w interakcje z tymi systemami.