Kąt Andersona

Transmisja avatarów AI jak w 1999 roku

Naukowcy przedstawili sposób transmisji wyglądających jak żywe trójwymiarowych avatarów, które pojawiają się niemal natychmiast i stają się ostrzejsze w czasie rzeczywistym, zamiast zmuszać użytkowników do oczekiwania na zakończenie ogromnych pobierania.

W wielu ways, ogromne wymagania zasobowe generatywnej sztucznej inteligencji i systemów renderowania wspomaganych przez sztuczną inteligencję cofnęły gotowość konsumentów o dwadzieścia lub więcej lat. Dopiero w 2023 roku, przydział 64GB pamięci RAM w laptopie lub komputerze stacjonarnym wydawał się nadmiarem; teraz, ze względu na rosnącą popularność pamięci RAM i/lub przeładunku CPU, 64GB jest dość skromne dla lokalnych potrzeb sztucznej inteligencji; a te niegdyś banalne i tanie elementy komputerów nadal rosną w cenie ponieważ korporacje walczą o zaspokojenie popytu na usługi sztucznej inteligencji.

Skala i chciwość sztucznej inteligencji i jej procesów i środowisk zwykle przewyższa sprzęt konsumentów, a nawet uruchamianie “zredukowanych” modeli lokalnych jako wersje GGUF zwykle obciąża przeciętny system.

Nawet usługi sztucznej inteligencji oparte na tekście, takie jak ChatGPT, są narażone na znaczne obciążenie zarówno na poziomie klienta, jak i serwera. Dlatego, gdy sztuczna inteligencja jest zlecona do dostarczania online doświadczeń multimedialnych w czasie rzeczywistym, możemy rozsądnie oczekiwać pewnych poważnych kompromisów w opóźnieniu i/lub jakości – podobnie jak wczesne problemy internetu ze strumieniowaniem multimediów i nienawidzonymi animowanymi ikonami “buforowania” RealPlayer i QuickTime.

Ostatni raz, gdy problemy multimedialne i sieciowe tworzyły tarcie w doświadczeniu użytkownika, sprzęt konsumentów był nadal ewoluował za pomocą prawa Moore’a, stając się niemal wykładniczo lepszym każdego roku, nawet gdy systemy operacyjne, sieci i inne infrastruktury wspierające ewoluowały, aby zaspokoić popyt; a przez ostatnie dziesięć lat, możliwości technologii konsumentów przewyższały wymagania multimedialne (może nawet do punktu, w którym konieczne było zainicjowanie wymiany, aby utrzymać sprzedaż).

Ale ten nadmiar lokalnej zdolności może wkrótce dojść do końca, ponieważ lokalny sprzęt staje się mniej wydajny i droższy, a usługi oparte na sztucznej inteligencji wymagają wyższych zasobów po stronie serwera i lokalnej.

Pobieranie przewagi

W erze przed szerokopasmową, nawet przed najwcześniejszymi użytecznymi strumieniami wideo, użytkownicy internetu byli przyzwyczajeni do obrazów, które powoli dochodziły do ostrości, ponieważ postępowe JPEG pozwalały użytkownikom z ograniczonymi przepustowościami obserwować pobieranie obrazu, czasem bardzo wolno, gdy więcej danych obrazu było ładowanych lokalnie.

Teraz wydaje się, że możemy mieć podobne doświadczenie z avatarami wspomaganymi przez sztuczną inteligencję Gaussian Splat:

Kliknij, aby odtworzyć. Z nowego projektu ProgressiveAvatars, porównanie strumieniowania avatarów Gaussian. Źródło

Powierzchnia wyświetlamy dwa wersje awatara opartego na Gaussian Splat – reprezentację człowieka umożliwioną częściowo przez nie-AI technikę renderowania, która pochodzi z wczesnych lat 90., a także przez nowocześniejsze metody, takie jak FLAME parametryczny model człowieka, i podejścia oparte na sztucznej inteligencji:

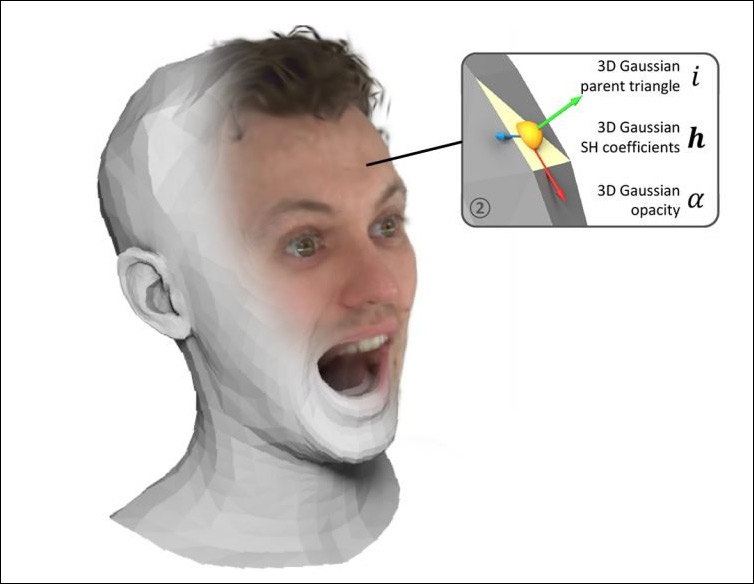

Gaussian Splatting używa reprezentacji Gaussa koloru i informacji 3D zamiast piksela lub vokselu i mapuje tę ultra-realistyczną teksturę na bardziej tradycyjną sieć CGI, która sama jest ułatwiona przez ‘parametrycznego człowieka’, CGI twarz i/lub ciało, w systemach takich jak FLAME i STAR. Źródło

Na lewo w powyższym filmie widać, że tradycyjna implementacja awatara Gaussian Splat wygląda dość okropnie, gdy czekamy na załadowanie danych. Na prawo, nowa implementacja z Chin, nazwana ProgressiveAvatars, może rozwiązać problem znacznie bardziej elegancko, prezentując niealarmujący obraz człowieka od samego początku.

Autorzy twierdzą, że ich metoda jest pierwszą, która naprawdę “strumieniuje” awatara Gaussian, i z pewnością pierwszą, która robi to w sposób postępowy, gdzie obraz buduje się elegancko, a najważniejsze obszary – takie jak oczy i usta – mogą być priorytetowe, aby awatar mógł stać się rozmowny, nawet gdy jest tylko częściowo załadowany:

Click to play. From the ProgressiveAvatars project site, an illustration of attention-aware loading.

Przed tym, podejście “poziomu szczegółowości” (LOD) było używane w poprzednich próbach zredukowania “GSplat” awatarów, podobnie do optymalizacji gier wideo, gdzie sukcesywnie bardziej szczegółowe wersje osoby są ładowane w zależności od tego, czy zajmują wystarczająco dużo viewportu lub uwagi widza, aby być warte wysiłku.

Oczywiście, wymaga to znacznej ilości redundantnych “zapasowych” awatarów, a autorzy przedstawiają swoje podejście jako bardziej racjonalny system. W Domino, metoda tego rodzaju pozwala również na wprowadzanie zmian w postaci GSplat (tj. dostosowywania) bez potrzeby propagowania takich zmian przez łańcuch różnych wersji LOD “bliźniaków”.

Wygrywający obszar

Jeśli to wydaje się niszą problemem, to tak samo było ze strumieniowaniem wideo, w czasach gdy uzyskanie najwcześniejszych wtyczek do pracy było zlecone najbliższemu dostępnemu nerdowi. Ponadto, potencjał reprezentacji opartych na sztucznej inteligencji sięga poza awatary ludzkie, rozszerzając się na generowanie miast, gry, i 3D-oparte* wersje praktycznie każdej domeny online – takiej jak Virtual Try-On, dla zakupów odzieży:

Kliknij, aby odtworzyć. From a 2024 project, a rough look at the future of online ‘try-on’. Other projects seek to add motion and interactivity – demanding facets to stream and manage. Źródło

Właśnie tak, jak podejścia oparte na LOD były dotychczas głównie wykorzystywane przez gry wideo, wiele innych rozważań, które były dotychczas wyłączną domeną rozwoju gier, prawdopodobnie wpłynie na reprezentacje oparte na splatach. Na przykład, większość tych wczesnych wypadków GSplat przedstawia pojedynczego człowieka gryzącego i mrużącego, lub perhaps mówiącego; ale wiele sytuacji będzie wymagało kilku ludzi, a także elementów środowiskowych i atmosfery – scenariusz, w którym bardzo wydajne systemy “triage” określą, gdzie strumieniowane dane muszą być priorytetowe, aby utrzymać widza w chwili.

Nowy artykuł nosi tytuł ProgressiveAvatars: Progressive Animatable 3D Gaussian Avatars, i pochodzi od trzech badaczy z University of Science and Technology of China w Hefei.

Metoda

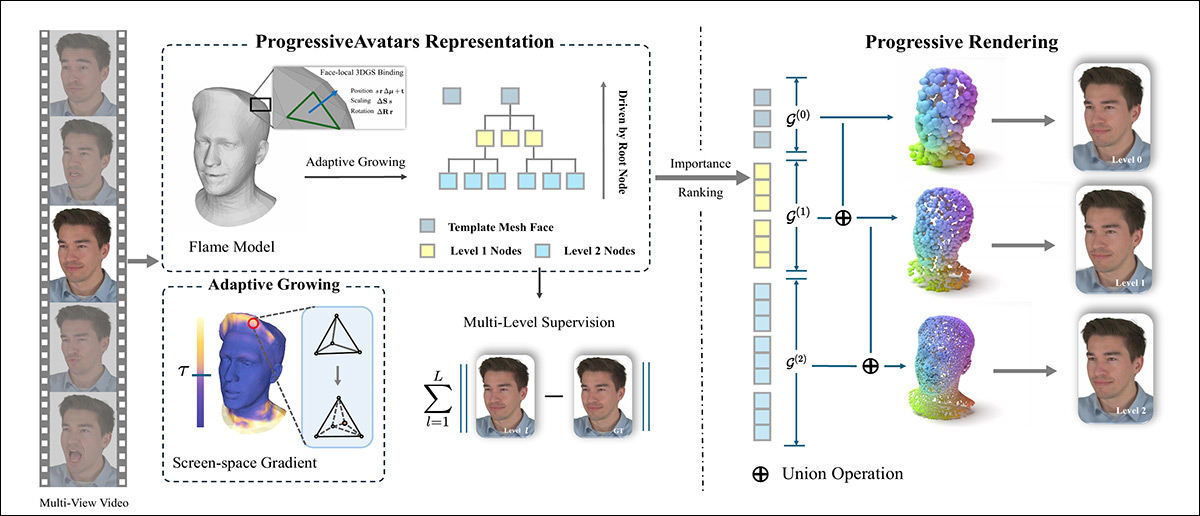

Podejście wykorzystuje wstępnie film wideo głowy osoby. Dla każdego klatki, standardowy FLAME parametryczny model twarzy jest dopasowany, tak aby kształt i wyraz twarzy zmieniały się w czasie, podczas gdy podstawowa struktura siatki pozostaje niezmieniona. Ponieważ podstawowa topologia nie ulega zmianie, stabilny szablon FLAME może być ponownie wykorzystany i udoskonalony zamiast odbudowany od podstaw w każdej chwili, jak to ma miejsce w podobnych poprzednich pracach:

Head video is first fitted with a tracked FLAME mesh, after which 3D Gaussians are attached to each face and grown hierarchically where screen-space gradients indicate missing detail. During training, this adaptive subdivision builds a multi-level representation under multi-view supervision, and at inference, per-face importance scores determine which Gaussians are streamed first, allowing the avatar to appear quickly and refine progressively as higher-detail levels are added.

Nad tą podstawową strukturą, dodaje się szczegóły warstwami; powierzchnia jest niejawnie podzielona na hierarchię, a małe trójwymiarowe Gaussowskie są dołączone do twarzy na każdym poziomie szczegółowości.

Chociaż początkowe bardziej ogólne warstwy ujmują ogólny kształt głowy i ruch, następne drobniejsze warstwy dostarczają zmarszczki, delikatne deformacje i wysokoczęstotliwościową teksturę. Obrazy są następnie renderowane z tych Gaussowskich za pomocą różniczkowalnego rasterizera Gaussowskiego i szkolonego przeciwko wielowidokowym filmom, tak aby awatar nauczył się odtwarzać wygląd prawdziwej osoby.

Podczas szkolenia, ta hierarchia rośnie automatycznie: regiony, które wymagają więcej szczegółów, są podzielone dalej, kierowane przez sygnały przestrzeni ekranu, tak aby wysiłek obliczeniowy koncentrował się tam, gdzie oko widza jest najbardziej prawdopodobne, aby zauważyć błędy.

Podczas inferencji, ta sama hierarchia umożliwia postępowe strumieniowanie, w którym szkic awatara może być wyświetlony najpierw, a gdy dodatkowe warstwy są ładowane, nowe Gaussowskie mogą być dodane bez zmiany tego, co już jest wyświetlane, umożliwiając animowany awatar głowy, który pojawia się szybko i staje się ostrzejszy i bardziej szczegółowy, gdy więcej danych przychodzi.

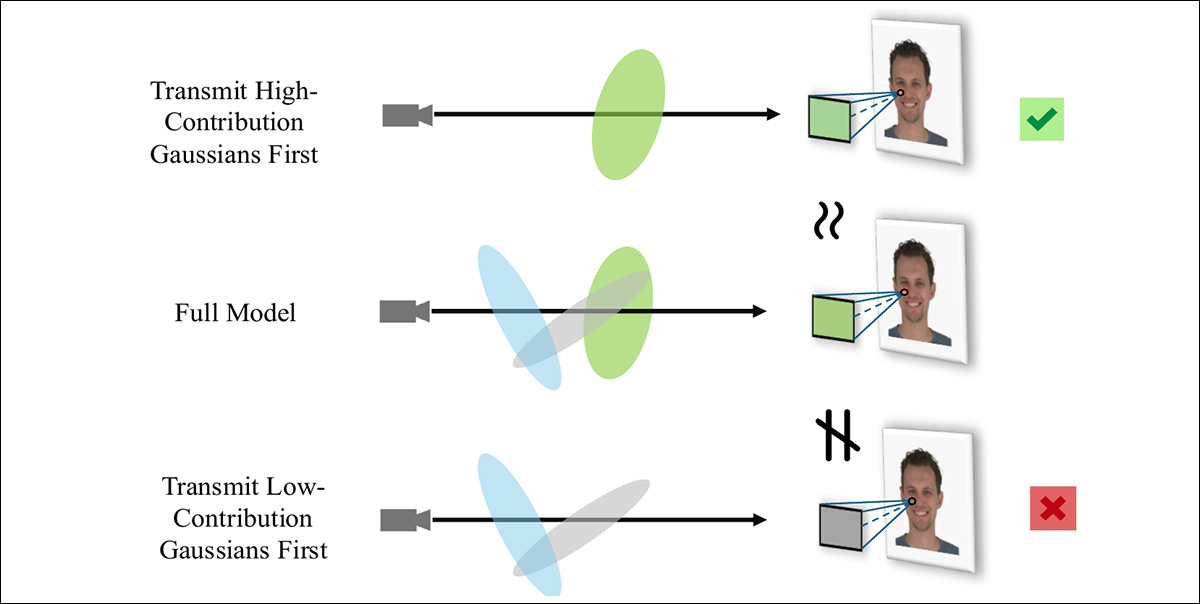

Autorzy obserwują, że cały system zależy od priorytetu przychodzących danych:

When all Gaussians at a given level are available, the full model is rendered with maximum fidelity; but during streaming, sending the highest-contribution Gaussians first allows early partial results to closely match the final image, whereas transmitting low-contribution Gaussians first distorts color balance and emphasizes minor components.

Dane i testy

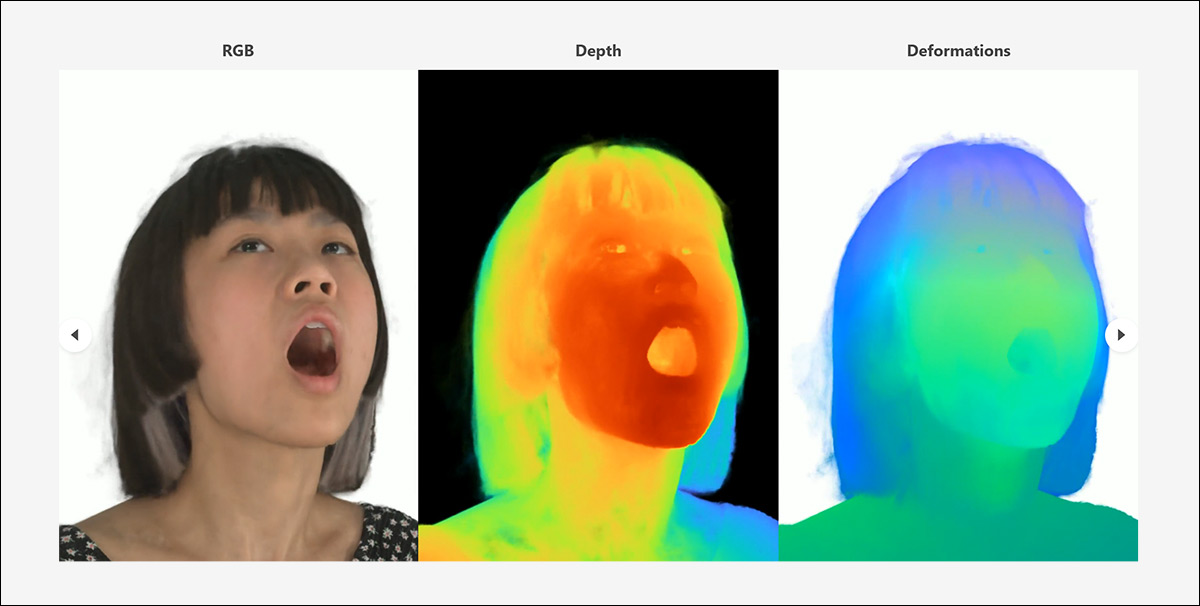

Do testów, nowa metoda została oceniona na NeRSemble zestawie danych, który składa się z wielowidokowych filmów dla każdego obiektu, z skalibrowanymi parametrami we wszystkich widokach:

Examples of diverse interpretations of subjects included in the NeRSemble dataset used in tests for ProgressiveAvatars. Źródło

Zgodnie z oryginalną GaussianAvatars metodologią, obrazy zostały zmniejszone do 802x550px a maska tła wygenerowana, i oryginalny projekt szkolenia/test split został przyjęty.

Optymalizator Adam został użyty do aktualizacji parametrów, z współczynnikiem uczenia 1×10-2 we wszystkich barycentrycznych współrzędnych. Szkolenie trwało 60,000 iteracji, z hierarchią automatycznie rozszerzaną co 2,000 iteracji.

Początkowo, autorzy testowali rekonstrukcję i animację – zadanie konwersji płaskiego wideo w system 3D-świadomy (x/y/x), używając FLAME’owskiego kanonicznego CGI reprezentacji jako kotwicy siatki. Dla tego, wszystkie podstawy były szkolone od podstaw, a rywalizujące ramy testowe były wspomnianymi GaussianAvatars, i PointAvatar.

Dla tych testów, metryki użyte były Peak Signal-to-Noise Ratio (PSNR), Structural Similarity Index (SSIM), i Learned Perceptual Image Patch Similarity (LPIPS):

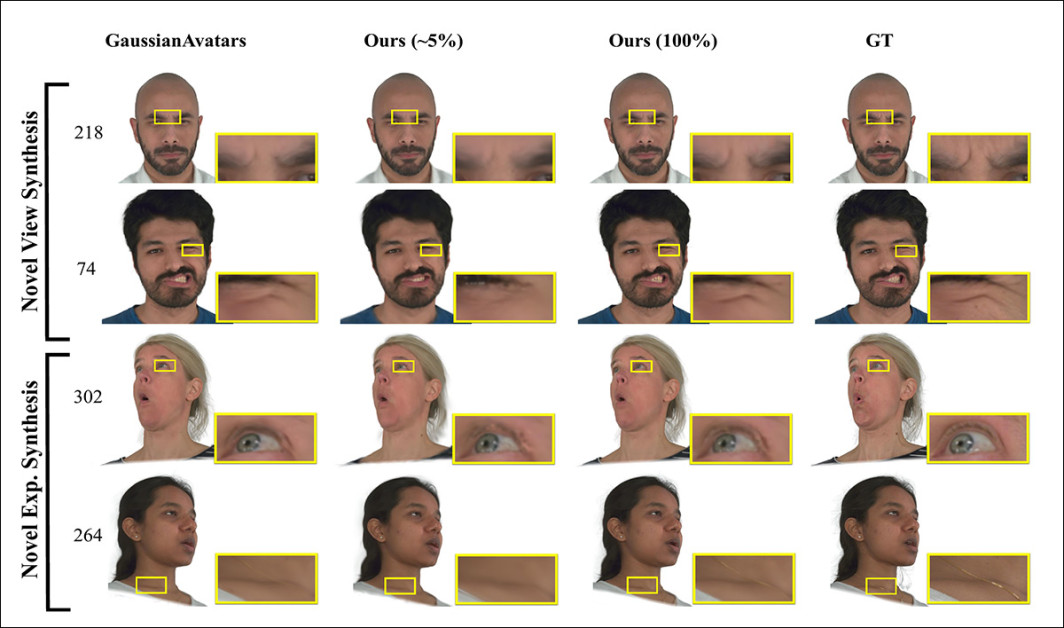

Qualitative comparison on novel-view and novel-expression synthesis. The baseline GaussianAvatars struggles with fine detail around eyes, wrinkles, and skin texture, while the proposed method already preserves key facial structure at roughly five percent of transmitted data and converges toward ground truth as more Gaussians are streamed, closely matching the full model and reference images (ground truth).

Odnośnie tych wyników, autorzy twierdzą:

‘[Nasza] metoda rekonstruuje ostrzejsze szczegóły w kilku regionach, szczególnie wokół szyi, ramion i ubrania. Te obszary są relatywnie grubo siatkowane w szablonie FLAME w porównaniu z wysokimi strefami saliency (np. okolicą oczu).

‘W konsekwencji, poprzednie metody często przydzielają zbyt mało 3D Gaussowskich do tych obszarów, aby wiernie uchwycić ich drobne szczegóły. W przeciwieństwie do tego, nasza strategia adaptacyjnego wzrostu zwiększa liczbę Gaussowskich i udoskonala hierarchię tylko tam, gdzie jest to potrzebne, czyniąc przydział niewrażliwym na nierównomierną siatkę FLAME.’

Autorzy zauważają ponadto, że ich podejście jest na parze z najlepszymi metodami, dającymi funkcjonalny awatar z trywialnym 5% limitem przepustowości:

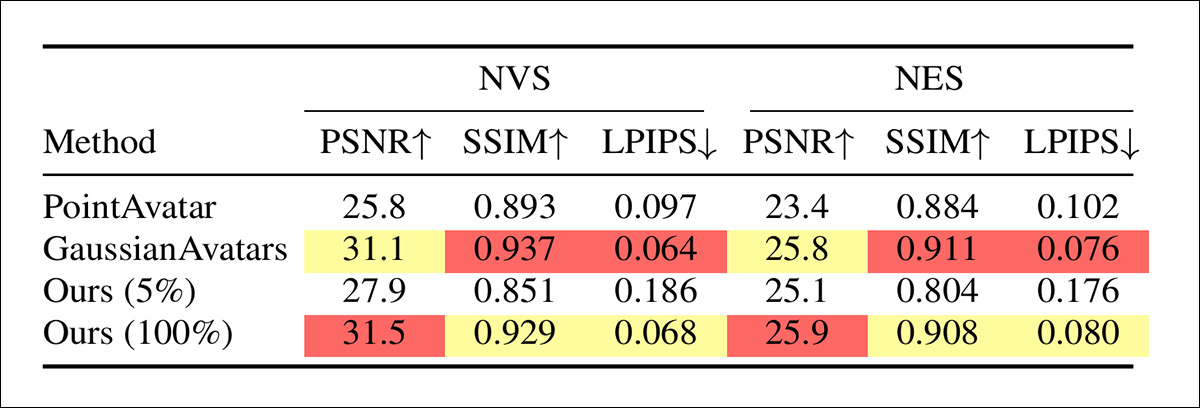

Quantitative comparison on novel view synthesis and novel expression synthesis using PSNR, SSIM, and LPIPS. At full transmission, the proposed method achieves the highest PSNR on both tasks and remains competitive with GaussianAvatars on perceptual metrics, while the 5% setting illustrates the quality trade-off under extreme bandwidth constraints.

Następnie, badacze testowali postępowe renderowanie same. To było przeprowadzone na NVIDIA RTX 4090, z 24Gb pamięci VRAM, przy rozdzielczości 550x802px. W tym scenariuszu, autorzy zauważają, że budżet 25% wykorzystałby wszystkie “poziom 1” Gaussowskie, a także podzbiór Gaussowskich poziomu 2, co daje ogólne pojęcie o tym, jak grupy Gaussowskie gromadzą szczegóły w wyższych grupach, i że niższe grupy budują podstawową kanwę:

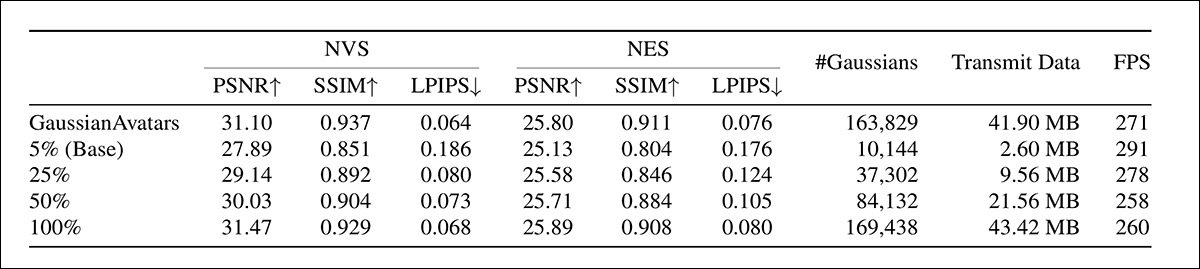

Performance under different transmission budgets for novel view and novel expression synthesis, showing that quality steadily approaches or exceeds GaussianAvatars as more Gaussians and data are streamed, while real time speeds are maintained, on an RTX 4090.

Autorzy komentują:

‘Z tylko 2.60 MB przesłanych (5% budżet), awatar już osiąga rozsądną jakość. Gdy wyższe poziomy Gaussowskie są strumieniowane, drobne struktury, takie jak guziki koszuli, zęby i włosy, stopniowo wyraźnie, podczas gdy stabilność czasowa jest utrzymywana.

‘Przy 100% transmisji, nasze podejście osiąga jakość renderowania porównywalną z najlepszymi metodami. Godne uwagi jest to, że szybkość klatek nie spada znacznie, co sugeruje, że obciążenie 3DGS nie nasyciło jeszcze GPU.’

Jednak autorzy zauważają, że w scenariuszach wieloużytkowych VR, liczba 3D Gaussowskich szybko wzrośnie do punktu, w którym rasterizacja GPU stanie się wąskim gardłem. W tych cięższych scenariuszach, proponowane podejście oferuje przewagę, pozwalając systemowi na wymianę liczby prymitywów na jakość wizualną, ułatwiając obciążenie bez upadku renderowania.

Chociaż artykuł nie szczegółowo opisuje tego, strona projektu zawiera dodatkowe porównania testowe, również z MeGA hybrydowym projektem awatara siatki-Gaussa:

Kliknij, aby odtworzyć. One of a series of supplementary videos from the paper’s accompanying project site, this one comparing the new approach in terms of novel view synthesis.

Wnioski

Gaussian Splatting może lub nie przetrwać, lub nawet być pamiętany bardziej niż RealPlayer w odniesieniu do wschodu interaktywnego strumieniowania: AI-napędzanych lub AI-wspomaganych 3D-świadomych reprezentacji doświadczeń, w tym wideo czatu, wirtualnych zakupów, nawigacji tras i różnych aplikacji rozrywkowych. Może to być, że alternatywne technologie lub podejścia wyjdą na pierwszy plan, lub że GSplat okazuje się najbardziej niezawodnym AI-wideo reprezentacją.

Jeśli nic innego, ten interesujący nowy artykuł zwiastuje nieco zakresu tej nowej domeny, przypominając nam, może nostalgicznie, o pasmie internetu z przeszłości.

* Przez ‘3D’, nie mam na myśli rodzaju doświadczenia, które wymaga specjalnych okularów, ale raczej doświadczenia, w którym multimediów mają pewne zrozumienie współrzędnych X/Y/Z.

Pierwotnie opublikowane w środę, 18 marca 2026