Ochrona zdrowia

Rozpoznawanie stresu pracowników za pomocą analizy twarzy w miejscu pracy

W kontekście zmieniającej się kultury wokół etykiety spotkań za pomocą Zoom oraz pojawienia się zmęczenia Zoom, badacze z Cambridge opublikowali badanie, które wykorzystuje uczenie maszynowe do określenia naszych poziomów stresu za pomocą kamer internetowych z funkcją sztucznej inteligencji, monitorujących nasze wyrażenia twarzy w miejscu pracy.

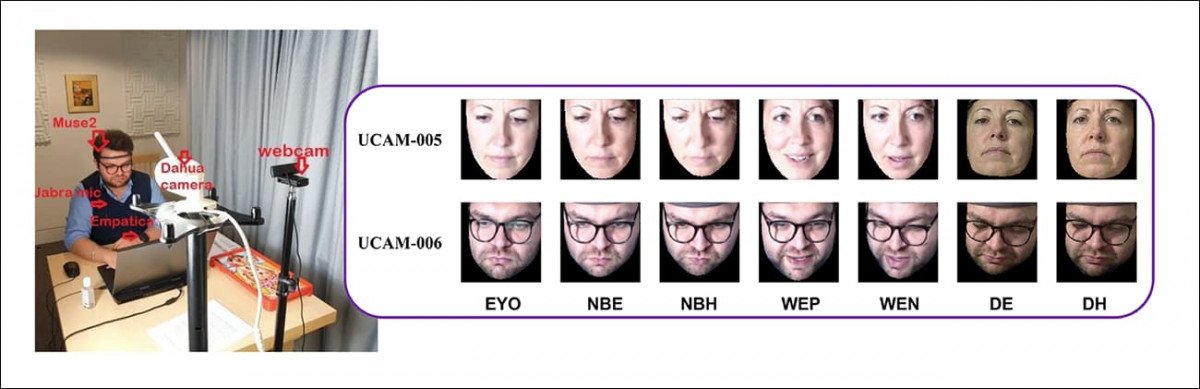

Po lewej stronie, środowisko zbierania danych, z wieloma urządzeniami monitorującymi albo skierowanymi na wolontariusza, albo dołączonymi do niego; po prawej stronie, przykładowe wyrażenia twarzy wygenerowane przez osoby testowe na różnych poziomach trudności zadania. Źródło: https://arxiv.org/pdf/2111.11862.pdf

Badanie jest przeznaczone do analizy afektu (tj. rozpoznawania emocji) w systemach “Ambient Assistive Living”, i prawdopodobnie jest zaprojektowane w celu umożliwienia ram video-opartych systemów monitorowania wyrażeń twarzy w takich systemach; chociaż artykuł nie rozwija tego aspektu, wysiłek badawczy nie ma sensu w żadnym innym kontekście.

Konkretny zakres projektu polega na uczeniu się wzorców wyrażeń twarzy w środowiskach pracy – w tym również w przypadku pracy zdalnej – a nie “wypoczynku” lub “biernych” sytuacjach, takich jak podróżowanie.

Rozpoznawanie emocji na twarzy w miejscu pracy

Podczas gdy “Ambient Assistive Living” może brzmieć jak plan opieki nad osobami starszymi, jest to daleko idące uproszczenie. Mówiąc o zamierzonych “użytkownikach końcowych”, autorzy stwierdzają*:

‘Systemy stworzone dla ambient assistive living environments [†] mają na celu wykonywanie automatycznej analizy afektu i reagowania. Ambient assistive living opiera się na wykorzystaniu technologii informacji i komunikacji (ICT) w celu wspomagania osób w ich codziennym środowisku życia i pracy, aby utrzymać ich zdrowie i aktywność na dłużej, oraz umożliwić im samodzielne życie, gdy starzeją się. Zatem, ambient assistive living ma na celu ułatwić pracę pracownikom służby zdrowia, pielęgniarkom, lekarzom, pracownikom fabryk, kierowcom, pilotom, nauczycielom, a także różnym branżom za pomocą sensorycznego, oceniającego i interweniującego.

‘System jest przeznaczony do określenia fizycznego, emocjonalnego i psychicznego obciążenia i reagowania oraz dostosowywania się w razie potrzeby, na przykład, samochód wyposażony w system wykrywania senności może poinformować kierowcę, aby był czujny i może zasugerować, aby zrobił krótką przerwę, aby uniknąć wypadków [††].’

Artykuł artykuł nosi tytuł Inferring User Facial Affect in Work-like Settings, i pochodzi od trzech badaczy z Affective Intelligence & Robotics Lab w Cambridge.

Warunki testowe

Ponieważ poprzednie badania w tej dziedzinie opierały się w dużej mierze na przypadkowych zbiorach obrazów pobranych z Internetu, badacze z Cambridge przeprowadzili eksperymenty lokalnego zbierania danych z 12 wolontariuszami, 5 mężczyznami i 7 kobietami. Wolontariusze pochodzili z dziewięciu krajów i mieli od 22 do 41 lat.

Celem projektu było odtworzenie trzech potencjalnie stresujących środowisk pracy: biura; linii produkcyjnej fabryki; oraz wideokonferencji – takiej jak grupowe rozmowy za pomocą Zoom, które stały się częstym elementem pracy zdalnej od czasu pandemii.

Osoby badane były monitorowane za pomocą różnych środków, w tym trzech kamer, mikrofonu Jabra noszonego na szyi, opaski Empatica (bezprzewodowego, wieloczujnikowego urządzenia noszonego na nadgarstku, które oferuje informacje zwrotne w czasie rzeczywistym), oraz czujnika Muse 2 (który również oferuje informacje zwrotne). Dodatkowo, wolontariuszom kazano wypełnić ankiety i okresowo ocenić swój nastrój.

Jednakże, nie oznacza to, że przyszłe systemy Ambient Assistive Living będą “podłączać” Cię w ten sposób (jeśli tylko z powodów ekonomicznych); wszystkie niekamerowe urządzenia monitorujące i metody użyte w zbieraniu danych, w tym ankiety pisemne, są przeznaczone do potwierdzenia systemów rozpoznawania emocji opartych na twarzy, które są umożliwione przez nagrania wideo.

Zwiększanie ciśnienia: Scenariusz biurowy

W pierwszych dwóch scenariuszach (‘Biuro’ i ‘Fabryka’), wolontariusze zaczynali od łatwego tempa, a ciśnienie stopniowo rosło w czterech fazach, z różnymi typami zadań dla każdej.

Na najwyższym poziomie wywołanego stresu, wolontariusze musieli również znosić “efekt białego kitla” kogoś, kto patrzy im przez ramię, plus 85 decybeli dodatkowego hałasu, co jest o pięć decybeli poniżej limitu prawnego dla środowiska biurowego w Stanach Zjednoczonych, i jest to dokładnie maksymalny limit określony przez Narodowy Instytut Bezpieczeństwa i Higieny Pracy (NIOSH).

W fazie zbierania danych w środowisku biurowym, osoby badane były zobowiązane do zapamiętania poprzednich liter, które pojawiały się na ich ekranie, z rosnącym poziomem trudności (takim jak zapamiętanie sekwencji dwóch liter, które wystąpiły dwa ekrany temu).

Scenariusz fabryczny

Aby symulować środowisko pracy fizycznej, osoby badane były zobowiązane do gry w grę Operation, która wymaga od gracza umiejętności manualnych, aby wyjąć małe obiekty z deski przez wąskie, metalowe otwory bez dotyku, co powoduje uruchomienie sygnału “awaria”.

Do czasu, gdy nadszedł najtrudniejszy etap, wolontariusz był zobowiązany do wyjęcia wszystkich 12 obiektów bez błędu w ciągu jednej minuty. Dla porównania, rekord świata w tym zadaniu, ustanowiony w Wielkiej Brytanii w 2019 roku, wynosi 12,68 sekund.

Scenariusz wideokonferencyjny

Wreszcie, w teście pracy zdalnej/telekonferencyjnej, wolontariusze byli zobowiązani przez eksperymentatora podczas połączenia MS Teams do przypomnienia sobie własnych pozytywnych i negatywnych wspomnień. Dla najbardziej stresującej fazy tego scenariusza, wolontariusz był zobowiązany do przypomnienia sobie bardzo negatywnej lub smutnej pamięci ze swojej niedawnej przeszłości.

Różne zadania i scenariusze były wykonywane w losowej kolejności i skompilowane w niestandardową bazę danych o nazwie Working-Environment-Context-Aware Dataset (WECARE-DB).

Metoda i szkolenie

Wyniki samooceny nastroju użytkowników zostały użyte jako punkt odniesienia, i zostały odwzorowane na wymiary walencji i pobudzenia. Nagrania wideo eksperymentów zostały przepuszczony przez sieć wykrywania punktów charakterystycznych twarzy sieci, a obrazów wyrównanych do sieci ResNet-18 przeszkolonej na bazie danych AffectNet.

450 000 obrazów z AffectNet, wszystkie pobrane/oznaczone z Internetu przy użyciu zapytań związanych z emocjami, zostało ręcznie oznaczone, jak podaje artykuł, z wymiarami walencji i pobudzenia.

Następnie badacze udoskonalili sieć wyłącznie na podstawie własnej bazy danych WECARE, podczas gdy kodowanie reprezentacji spektralnej zostało użyte do podsumowania predykcji klatkowych.

Wyniki

Wyniki modelu zostały ocenione według trzech wskaźników zwykle skojarzonych z automatyczną predykcją afektu: współczynnika korelacji, współczynnika korelacji Pearsona oraz błędu średniego kwadratowego (RMSE).

Autorzy zauważają, że model dostosowany do ich własnej bazy danych WECARE przewyższa model ResNet-18, i wnioskują z tego, że sposób, w jaki kontrolujemy nasze wyrażenia twarzy, jest bardzo inny w środowisku pracy niż w bardziej abstrakcyjnych kontekstach, z których pochodziły materiały źródłowe z Internetu.

Stwierdzają:

‘Patrząc na tabelę, obserwujemy, że model dostosowany do WECARE-DB przewyższa model ResNet-18 przeszkolony na [AffectNet], co wskazuje, że zachowania twarzy wyświetlane w środowiskach pracy są różne w porównaniu z ustawieniami internetowymi wykorzystywanymi w bazie danych AffectNet. Zatem, konieczne jest pozyskanie danych i przeszkolenie modeli do rozpoznawania afektu twarzy w środowiskach pracy.’

Jeśli chodzi o przyszłość rozpoznawania afektu w pracy, umożliwionego przez sieci kamer szkolonych na pracownikach i stale dokonujących predykcji ich stanów emocjonalnych, autorzy kończą*:

‘Ostatecznym celem jest wdrożenie i użycie przeszkolonych modeli w czasie rzeczywistym i w rzeczywistych środowiskach pracy, aby dostarczyć dane do systemów wspomagania decyzji w celu promowania zdrowia i dobrostanu ludzi w wieku produkcyjnym w kontekście projektu Unii Europejskiej dotyczącego wieku produkcyjnego.’

* Mój nacisk.

† Tutaj autorzy cytują trzy źródła:

Automatyczne, wymiarowe i ciągłe rozpoznawanie emocji – https://ibug.doc.ic.ac.uk/media/uploads/documents/GunesPantic_IJSE_2010_camera.pdf

Badanie dziedziny ambient assistive living: systematyczny przegląd – https://link.springer.com/article/10.1007/s12652-016-0374-3

Przegląd technologii Internetu Rzeczy dla ambient assistive living environments – https://mdpi-res.com/d_attachment/futureinternet/futureinternet-11-00259/article_deploy/futureinternet-11-00259-v2.pdf

†† Tutaj autorzy cytują dwa źródła:

Wykrywanie senności kierowcy w czasie rzeczywistym dla systemu osadzonego przy użyciu kompresji modelu głębokich sieci neuronowych – https://openaccess.thecvf.com/content_cvpr_2017_workshops/w4/papers/Reddy_Real-Time_Driver_Drowsiness_CVPR_2017_paper.pdf

System wykrywania senności kierowcy w czasie rzeczywistym przy użyciu cech twarzy – https://www.semanticscholar.org/paper/Real-Time-Driver-Drowsiness-Detection-System-Using-Deng-Wu/1f4b0094c9e70bf7aa287234e0fdb4c764a5c532