Sztuczna inteligencja

Generowanie parafraz za pomocą głębokiego uczenia wzmocnionego – Liderzy myśli

Kiedy piszemy lub mówimy, wszyscy zastanawiamy się, czy istnieje lepszy sposób przekazywania pomysłów innym. Jakie słowa powinienem użyć? Jak powinienem zbudować myśl? Jak oni prawdopodobnie zareagują? W Phrasee, spędzamy dużo czasu na myśleniu o języku – co działa, a co nie.

Wyobraź sobie, że piszesz temat linii dla kampanii e-mailowej, która trafi do 10 milionów ludzi na Twojej liście, promując 20% zniżki na nowy, wyśmienity laptop.

Który temat wybrałbyś:

- Możesz teraz dostać dodatkowe 20% zniżki na swoje następne zamówienie

- Priorytet – dodatkowe 20% zniżki

Chociaż przekazują te same informacje, jeden z nich osiągnął prawie 15% wyższy wskaźnik otwierania niż drugi (i zakładam, że nie możesz pokonać naszego modelu w przewidywaniu, który z nich?). Chociaż język można często testować za pomocą testów A/B lub multi-armed bandits, automatyczne generowanie parafraz pozostaje bardzo trudnym problemem badawczym.

Dwa zdania są uważane za parafrazy siebie nawzajem, jeśli mają ten sam znaczenie i mogą być używane zamiennie. Inną ważną rzeczą, która jest często przyjmowana za pewnik, jest to, czy zdanie wygenerowane przez maszynę jest płynne.

W przeciwieństwie do uczenia nadzorowanego, agenci uczenia wzmocnionego (RL) uczą się poprzez interakcje ze swoim środowiskiem i obserwowanie nagród, które otrzymują w wyniku. Ta nieco subtelna różnica ma ogromne implikacje dla tego, jak algorytmy działają i jak modele są szkolone. Głębokie uczenie wzmocnione używa sieci neuronowych jako aproksymatora funkcji, aby pozwolić agentowi nauczyć się, jak przewyższyć ludzi w złożonych środowiskach, takich jak Go, Atari i StarCraft II.

Pomimo tego sukcesu, uczenie wzmocnione nie zostało szeroko zastosowane w rzeczywistych problemach, w tym w przetwarzaniu języka naturalnego (NLP).

W ramach mojego pracy magisterskiej z dziedziny nauki o danych, demonstrujemy, jak głębokie RL można wykorzystać do przewyższenia metod uczenia nadzorowanego w automatycznym generowaniu parafraz wejściowego tekstu. Problem generowania najlepszej parafrazy można uznać za znalezienie serii słów, które maksymalizują podobieństwo semantyczne między zdaniem a zachowaniem płynności w danych wyjściowych. Agenci RL są dobrze przystosowani do znajdowania najlepszego zestawu akcji w celu osiągnięcia maksymalnej oczekiwanej nagrody w środowiskach kontrolnych.

W przeciwieństwie do większości problemów w uczeniu maszynowym, największy problem w większości aplikacji generowania języka naturalnego (NLG) nie leży w modelowaniu, ale raczej w ocenie. Chociaż ocena ludzka jest obecnie uważana za standard złoty w ocenie NLG, cierpi na znaczące wady, w tym jest droga, czasochłonna, trudna do dostrojenia i brakuje jej powtarzalności w doświadczeniach i zbiorach danych (Han, 2016). W związku z tym badacze od dawna szukają automatycznych miar, które są proste, ogólnie dostępne i odzwierciedlają osąd ludzki (Papineni et al., 2002).

Najczęstsze automatyczne metody oceny w ocenie wygenerowanych podpisów obrazów są podsumowane poniżej z ich zaletami i wadami:

Generowanie parafraz za pomocą potoku uczenia wzmocnionego

Rozwinęliśmy system o nazwie ParaPhrasee, który generuje wysokiej jakości parafrazy. System składa się z kilku kroków, aby zastosować uczenie wzmocnione w sposób obliczeniowo wydajny. Krótkie podsumowanie wysokiego poziomu potoku jest pokazane poniżej z więcej szczegółów zawartych w pracy.

Zbior danych

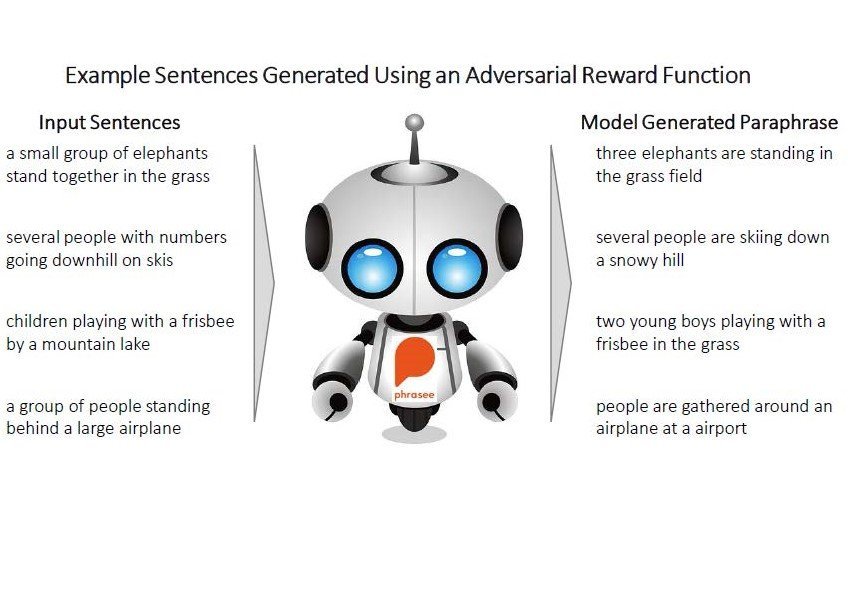

Istnieje kilka zbiorów parafraz, które są używane w badaniach, w tym: korpora parafraz Microsoft, konkurs Semantic Text Similarity ACL, Quora Duplicate Questions i Twitter Shared Links. Wybraliśmy MS-COCO ze względu na jego rozmiar, czystość i użycie jako punkt odniesienia dla dwóch znaczących prac nad generowaniem parafraz. MS-COCO zawiera 120k obrazów zwykłych scen z 5 podpisami obrazu na obraz, dostarczonymi przez 5 różnych ludzkich anotatorów.

Chociaż jest głównie zaprojektowany do badań nad widzeniem komputerowym, podpisów tendencję mają wysokie podobieństwo semantyczne i są interesującymi parafrazami. Ponieważ podpisów obrazu są dostarczane przez różne osoby, tendencję mają lekkie różnice w szczegółach podanych w scenie, dlatego wygenerowane zdania tendencję mają hallucynacje szczegółów.

Model nadzorowany

Chociaż uczenie wzmocnione znacznie poprawiło się pod względem wydajności próbek, czasów szkolenia i najlepszych praktyk, szkolenie modeli RL od podstaw jest nadal porównywalnie bardzo wolne i niestabilne (Arulkumaran et al., 2017). Dlatego zamiast szkolić od podstaw, najpierw szkolimy model nadzorowany, a następnie dostosowujemy go za pomocą RL.

Używamy ramy modelu Encoder-Decoder i oceniamy wydajność kilku modeli nadzorowanych. Podczas dostosowywania modelu za pomocą RL, dostosowujemy tylko sieć dekodera i traktujemy sieć encodera jako statyczną. Jak tak, rozważamy dwie główne ramy:

- Szkolenie modelu nadzorowanego od podstaw za pomocą standardowej ramy encodera-dekodera z GRU

- Użycie wstępnie wytrenowanych modeli osadzania zdań dla encodera, w tym: pulpit osadzania słów (GloVe), InferSent i BERT

Modele nadzorowane tendencję mają dość podobne wyniki w różnych modelach, z BERT i zwykłym encodera-dekodera osiągając najlepsze wyniki.

Chociaż wyniki tendencję są rozsądne, istnieją trzy główne źródła błędów: jąkanie, generowanie fragmentów zdań i hallucynacje. Są to główne problemy, których rozwiązanie ma na celu użycie RL.

Model uczenia wzmocnionego

Wdrożenie algorytmów RL jest bardzo trudne, zwłaszcza gdy nie wiadomo, czy problem można rozwiązać. Mogą wystąpić problemy w implementacji środowiska, agentów, hiperparametrów, funkcji nagrody lub połączenia wszystkich powyższych! Te problemy są nasilone, gdy wykonuje się głębokie RL, ponieważ otrzymuje się dodatkową złożoność debugowania sieci neuronowych.

Jak we wszystkich debugowaniach, jest to niezwykle ważne, aby zacząć prosto. Wdrożyliśmy wariacje dwóch dobrze zrozumianych środowisk RL (CartPole i FrozenLake), aby przetestować algorytmy RL i znaleźć powtarzalną strategię przenoszenia wiedzy z modelu nadzorowanego.

Stwierdziliśmy, że używanie algorytmu Actor-Critic przewyższa REINFORCE w tych środowiskach. W kwestii przenoszenia wiedzy do modelu Actor-Critic, stwierdziliśmy, że inicjowanie wag aktora z wytrenowanym modelem nadzorowanym i wstępne szkolenie krytyka osiągnęło najlepsze wyniki. Stwierdziliśmy, że jest to trudne do uogólnienia sofistykowanych podejść do destylacji polityki do nowych środowisk, ponieważ wprowadzają one wiele nowych hiperparametrów, które wymagają dostrojenia, aby działały.

Wspierani przez te spostrzeżenia, następnie zwracamy się ku opracowaniu podejścia do zadania generowania parafraz. Najpierw musimy utworzyć środowisko.

Środowisko pozwala nam łatwo przetestować wpływ korzystania z różnych metryk oceny jako funkcji nagrody.

Następnie definiujemy agenta, biorąc pod uwagę jego wiele zalet, używamy architektury Actor-Critic. Aktor jest używany do wyboru następnego słowa w sekwencji i ma swoje wagi inicjowane za pomocą modelu nadzorowanego. Krytyk zapewnia szacowaną nagrodę, którą stan prawdopodobnie otrzyma, aby pomóc aktorowi nauczyć się.

Projektowanie odpowiedniej funkcji nagrody

Najważniejszym składnikiem projektowania systemu RL jest funkcja nagrody, ponieważ to, co agent RL próbuje zoptymalizować. Jeśli funkcja nagrody jest niepoprawna, wyniki będą cierpieć, nawet jeśli każda inna część systemu działa!

Klasycznym przykładem jest CoastRunners, gdzie badacze OpenAI ustalili funkcję nagrody jako maksymalizację łącznego wyniku, a nie wygranie wyścigu. Wynikiem jest to, że agent odkrył pętlę, w której mógł uzyskać najwyższy wynik, uderzając turbiny bez ukończenia wyścigu.

https://www.youtube.com/watch?time_continue=2&v=tlOIHko8ySg&feature=emb_title

Ponieważ ocena jakości parafraz jest sama w sobie nierozwiązanym problemem, projektowanie funkcji nagrody, która automatycznie ujmuje ten cel, jest jeszcze trudniejsze. Większość aspektów języka nie rozkłada się ładnie na liniowe metryki i jest zależna od zadania (Novikova et al., 2017).

Agent RL często odkrywa interesującą strategię maksymalizacji nagród, która wykorzystuje słabości w metryce oceny, a nie generuje wysokiej jakości tekst. To tendencję prowadzi do słabej wydajności w metrykach, które agent nie optymalizuje bezpośrednio.

Rozważamy trzy główne podejścia:

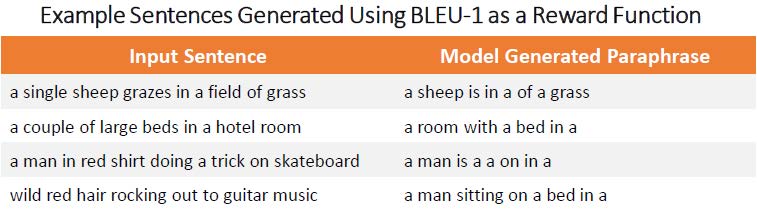

- Metryki nakładające się na słowa

Typowe metryki oceny NLP uwzględniają proporcję nakładających się słów między wygenerowaną parafrazą a zdaniem oceny. Im większe nakładanie, tym większa nagroda. Wyzwaniem w podejściach na poziomie słów jest to, że agent zawiera zbyt wiele słów łącznikowych, takich jak “a jest na z” i nie ma miary płynności. To prowadzi do bardzo niskiej jakości parafraz.

- Metryki podobieństwa i płynności na poziomie zdania

Główne właściwości wygenerowanej parafrazy to to, że musi być płynna i semantycznie podobna do zdania wejściowego. Dlatego próbujemy jawnie ocenić te parametry, a następnie połączyć metryki. Dla podobieństwa semantycznego używamy podobieństwa cosinusowego między osadzaniem zdań z wstępnie wytrenowanych modeli, w tym BERT. Dla płynności używamy wyniku opartego na zaskoczeniu zdania z GPT-2. Im większe podobieństwo cosinusowe i wynik płynności, tym większa nagroda.

Próbowaliśmy wiele różnych kombinacji modeli osadzania zdań i modeli płynności, a chociaż wyniki były rozsądne, głównym problemem, z którym agent się spotkał, było niewystarczające zrównoważenie podobieństwa semantycznego z płynnością. Dla większości konfiguracji agent priorytetowo traktował płynność, co skutkowało usunięciem szczegółów i umieszczeniem większości encji “w środku” czegoś lub przeniesieniem ich “na stół” lub “obok drogi”.

Wieloobiektowe uczenie wzmocnione jest otwartym pytaniem badawczym i jest bardzo trudne w tym przypadku.

- Użycie modelu przeciwnika jako funkcji nagrody

Ponieważ ludzie są uważani za standard złoty w ocenie, szkolimy oddzielny model zwany dyskryminatorem, aby przewidzieć, czy dwa zdania są parafrazami siebie nawzajem (podobnie jak ocena ludzka). Celem modelu RL jest następnie przekonanie tego modelu, że wygenerowane zdanie jest parafrazą wejściową. Dyskryminator generuje wynik, który wskazuje, jak prawdopodobne jest, że dwa zdania są parafrazami siebie nawzajem, który jest używany jako nagroda do szkolenia agenta.

Co 5 000 prób dyskryminator jest informowany, która parafraza pochodzi z zestawu danych, a która została wygenerowana, aby mógł poprawić swoje przyszłe przewidywania. Proces jest kontynuowany przez kilka rund, przy czym agent próbuje oszukać dyskryminatora, a dyskryminator próbuje odróżnić wygenerowane parafrazy od parafraz oceny z zestawu danych.

Po kilku rundach szkolenia agent generuje parafrazy, które przewyższają modele nadzorowane i inne funkcje nagrody.

Podsumowanie i ograniczenia

Podejścia przeciwnika (w tym samą grę dla gier) zapewniają niezwykle obiecujące podejście do szkolenia algorytmów RL, aby przewyższyć poziom ludzki w określonych zadaniach bez definiowania jawnego funkcji nagrody.

Chociaż RL był w stanie przewyższyć uczenie nadzorowane w tym przypadku, dodatkowy nakład w zakresie kodu, obliczeń i złożoności nie jest warte uzyskanego zysku dla większości aplikacji. RL jest najlepszy w sytuacjach, w których uczenie nadzorowane nie może być łatwo zastosowane, a funkcja nagrody jest łatwa do zdefiniowania (takich jak gry Atari). Podejścia i algorytmy są o wiele bardziej dojrzałe w uczeniu nadzorowanym, a sygnał błędu jest znacznie silniejszy, co skutkuje znacznie szybszym i bardziej stabilnym szkoleniem.

Inną kwestią jest to, że jak w przypadku innych podejść opartych na sieciach neuronowych, agent może dramatycznie zawieść w przypadkach, w których dane wejściowe są różne od danych, które wcześniej widział, wymagając dodatkowej warstwy kontroli poprawności dla aplikacji produkcyjnych.

Eksplozja zainteresowania podejściami RL i postęp w infrastrukturze obliczeniowej w ciągu ostatnich kilku lat odblokują ogromne możliwości stosowania RL w przemyśle, zwłaszcza w NLP.