Sztuczna inteligencja

Nasze Podświadome Umiejętności Wykrywania Deepfake Mogą Napędzać Przyszłe Zautomatyzowane Systemy

Nowe badania z Australii sugerują, że nasz mózg jest zdolny do rozpoznawania zaawansowanych deepfake, nawet gdy świadomie uważamy, że widzimy prawdziwe obrazy.

Odkrycie to implikuje również możliwość wykorzystania odpowiedzi neuronalnych ludzi na twarze deepfake (zamiast ich oświadczeń) do szkolenia zautomatyzowanych systemów wykrywania deepfake. Takie systemy byłyby szkolone na cechach deepfake obrazów, a nie na zawyżonych szacunkach prawdopodobieństwa, ale na naszych instynktownych mechanizmach percepcyjnych do rozpoznawania tożsamości twarzy.

‘[A]lthough the brain can ‘recognise’ the difference between real and realistic faces, observers cannot consciously tell them apart. Our findings of the dissociation between brain response and behaviour have implications for how we study fake face perception, the questions we pose when asking about fake image identification, and the possible ways in which we can establish protective standards against fake image misuse.’

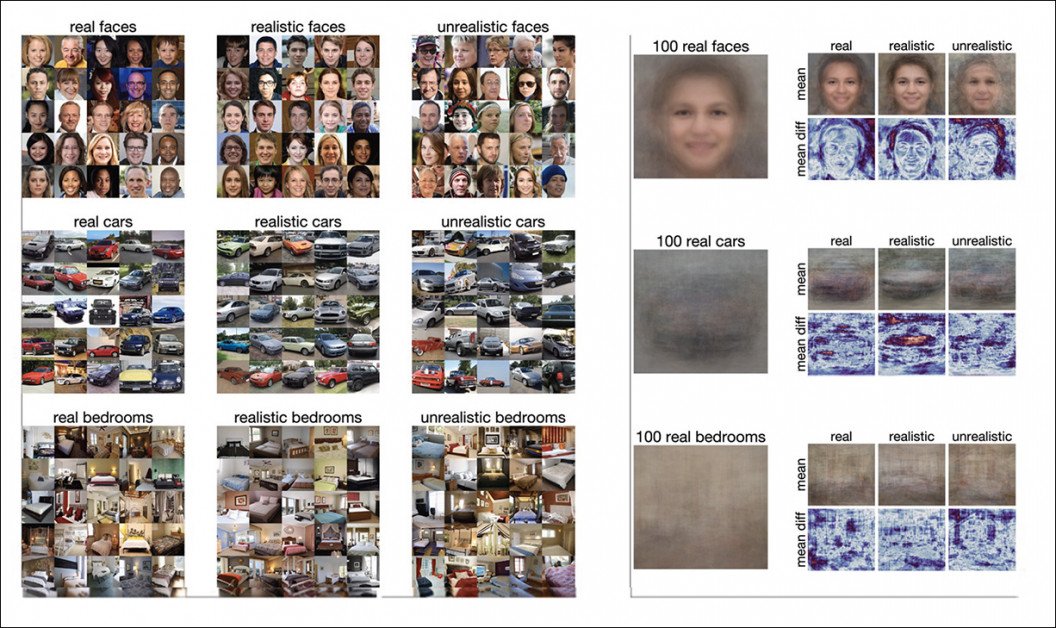

Wyniki pojawiły się w rundach testowych zaprojektowanych w celu oceny sposobu, w jaki ludzie reagują na fałszywe obrazy, w tym obrazy wyraźnie fałszywych twarzy, samochodów, przestrzeni wewnętrznych i odwróconych (tj. do góry nogami) twarzy.

Różne iteracje i podejścia do eksperymentów, które obejmowały dwa grupy osób testowych, które musiały zaklasyfikować krótko wyświetlany obraz jako ‘fałszywy’ lub ‘prawdziwy’. Source: https://tijl.github.io/tijl-grootswagers-pdf/Moshel_et_al_-_2022_-_Are_you_for_real_Decoding_realistic_AI-generated_.pdf

Artykuł twierdzi:

‘Our results demonstrate that given only a brief glimpse, observers may be able to spot fake faces. However, they have a harder time discerning real faces from fake faces and, in some instances, believed fake faces to be more real than real faces.

‘However, using time-resolved EEG and multivariate pattern classification methods, we found that it was possible to decode both unrealistic and realistic faces from real faces using brain activity.

‘This dissociation between behaviour and neural responses for realistic faces yields important new evidence about fake face perception as well as implications involving the increasingly realistic class of GAN-generated faces.’

Artykuł sugeruje, że nowa praca ma ‘kilka implikacji’ w dziedzinie cyberbezpieczeństwa, i że rozwój klasyfikatorów deepfake powinien być napędzany przez podświadome odpowiedzi, jak zmierzone w odczytach EEG w odpowiedzi na fałszywe obrazy, a nie przez świadome szacowanie wiarygodności obrazu.

Autorzy komentują:

‘This is reminiscent of findings that individuals with prosopagnosia who cannot behaviourally classify or recognise faces as familiar or unfamiliar nevertheless display stronger autonomic responses to familiar faces than unfamiliar faces.

‘Similarly, what we have shown in this study is that whilst we could accurately decode the difference between real and realistic faces from neural activity, that difference was not seen behaviourally. Instead, observers incorrectly identified 69% of the real faces as being fake.’

Nowa praca jest zatytułowana Are you for real? Decoding realistic AI-generated faces from neural activity, i pochodzi od czterech badaczy z University of Sydney, Macquarie University, Western Sydney University i The University of Queensland.

Dane

Wyniki pojawiły się z szerszego badania ludzkiej zdolności do rozróżniania fałszywych, hiper-realnych (ale nadal fałszywych) i prawdziwych obrazów, przeprowadzonego w dwóch rundach testowych.

Badacze użyli obrazów utworzonych przez Generative Adversarial Networks (GANs), udostępnionych przez NVIDIA.

GAN-generated human face images made available by NVIDIA. Source: https://drive.google.com/drive/folders/1EDYEYR3IB71-5BbTARQkhg73leVB9tam

Dane składały się z 25 twarzy, samochodów i sypialni, na poziomach renderowania od ‘nierzystkich’ do ‘realistycznych’. Dla porównania twarzy (tj. dla odpowiedniego materiału nie fałszywego) autorzy użyli wyborów z danych źródłowych NVIDIA’s source Flickr-Faces-HQ (FFHQ) dataset. Dla porównania innych scenariuszy użyli materiału z LSUN dataset.

Obrazy były ostatecznie przedstawiane osobie testowej albo w prawidłowej orientacji, albo odwróconej, i w różnych częstotliwościach, przy czym wszystkie obrazy zostały przeskalowane do 256×256 pikseli.

Po zebraniu wszystkich materiałów, 450 obrazów testowych zostało wybranych do testów.

Testy

Testy same były początkowo przeprowadzane online, przez jsPsych na pavlovia.org, z 200 uczestnikami oceniającymi różne podzbiory zebranych danych testowych. Obrazy były wyświetlane przez 200ms, po których następował pusty ekran, który utrzymywał się do momentu, gdy obserwator podjął decyzję, czy wyświetlany obraz był fałszywy czy prawdziwy. Każdy obraz był wyświetlany tylko raz, a cały test trwał 3-5 minut.

Druga, bardziej ujawniająca runda używała osób testowych podłączonych do maszyn EEG, i była przedstawiana na platformie Psychopy2. Każda z dwudziestu sekwencji zawierała 40 obrazów, z 18 000 obrazów przedstawionych w całej partii danych testowych.

Zebrane dane EEG zostały odkodowane za pomocą MATLAB z toolboxem CoSMoMVPA, przy użyciu schematu leave-one-out cross-validation pod Linear Discriminant Analysis (LDA).

Klasyfikator LDA był składnikiem, który mógł rozróżnić reakcję mózgu na fałszywe bodźce, i opinie osób testowych na temat tego, czy obraz jest fałszywy.

Wyniki

Zainteresowani tym, czy osoby testowe podłączone do EEG mogą rozróżnić fałszywe i prawdziwe twarze, badacze agregowali i przetwarzali wyniki, stwierdzając, że uczestnicy mogli łatwo rozróżnić prawdziwe twarze od nierzeczywistych, ale wydawało się, że mają trudności z identyfikacją realistycznych, wygenerowanych przez GAN fałszywych twarzy. Czy obraz był odwrócony, czy nie, wydawało się nie mieć większego znaczenia.

Rozróżnianie behawioralne prawdziwych i wygenerowanych syntetycznie twarzy, w drugiej rundzie.

Jednak dane EEG opowiedziały inną historię.

Artykuł stwierdza:

‘Although observers had trouble distinguishing real from fake faces and tended to overclassify fake faces, the EEG data contained signal information relevant to this distinction which meaningfully differed between realistic and unrealistic, and this signal appeared to be constrained to a relatively short stage of processing.’

Tutaj rozbieżność między dokładnością EEG a zgłaszaną opinią osób testowych (tj. czy twarze były fałszywe, czy nie) nie są identyczne, z danymi EEG zbliżającymi się do prawdy bardziej niż jawne postrzeganie osób zaangażowanych.

Badacze konkludują, że chociaż obserwatorzy mogą mieć trudności z nieświadomym identyfikowaniem fałszywych twarzy, te twarze mają ‘odrębne reprezentacje w ludzkim systemie wzrokowym’.

Rozbieżność ta spowodowała, że badacze spekulują o potencjalnym zastosowaniu swoich odkryć w przyszłych mechanizmach bezpieczeństwa:

‘In an applied setting such as cyber security or Deepfakes, examining the detection ability for realistic faces might be best pursued using machine learning classifiers applied to neuroimaging data rather than targeting behavioural performance.’

Kończą:

‘Understanding the dissociation between brain and behaviour for fake face detection will have practical implications for the way we tackle the potentially detrimental and universal spread of artificially generated information.’

* Moja konwersja cytatów wewnętrznych do łączy.

Pierwotnie opublikowane 11 lipca 2022.