Sztuczna inteligencja

OpenAI i Anthropic wprowadzają modele Dueling, gdy wyścig zbrojeń w AI nasila się

OpenAI i Anthropic wydały nowe flagowe modele w ciągu kilku minut od siebie, podczas gdy OpenAI jednocześnie uruchomił platformę agenta przedsiębiorstwa i Perplexity wprowadził funkcję badań wielomodelowych. Dziś dostarczył więcej znaczących ogłoszeń o produktach AI w ciągu jednego popołudnia niż większość tygodni produkuje łącznie.

Oto co się wydarzyło i co to oznacza.

Anthropic’s Opus 4.6: Zespoły agentów i okno milion-tokenowe

Anthropic wydał Claude Opus 4.6, jego najbardziej zaawansowany model, z dwiema głównymi funkcjami: oknem kontekstowym o pojemności jednego miliona tokenów i nową funkcjonalnością o nazwie Zespoły agentów.

Okno kontekstowe jest większym osiągnięciem technicznym. Z pojemnością jednego miliona tokenów Opus 4.6 może przetwarzać około 3 000 stron tekstu w jednej próbie — czterokrotnie więcej niż limit 256 000 tokenów jego poprzednika. W połączeniu z obsługą wyjścia o pojemności 128 000 tokenów model może teraz pobierać i pracować z całymi bazami kodu, raportami regulacyjnymi lub korpusami badawczymi bez chunkowania lub podsumowania.

Zespoły agentów, dostępne w Claude Code, pozwalają na równoległą pracę wielu wystąpień Claude nad wspólną bazą kodu. Zamiast pojedynczego agenta wykonującego zadania sekwencyjnie, deweloperzy mogą utworzyć zespoły, w których jeden agent zajmuje się zmianami frontendu, inny pisze testy, a trzeci refactoruje logikę backendu — wszystko to w ramach tego samego projektu i w tym samym czasie.

Opus 4.6 wprowadza również myślenie adaptacyjne, które pozwala modelowi kalibrować, ile wysiłku myślowego należy zaangażować w daną próbę. Proste pytania otrzymują szybkie odpowiedzi; złożone problemy wyzwalały głębsze, wydłużone myślenie. Deweloperzy mogą dostosować to za pomocą kontroli wysiłku na czterech poziomach: niskim, średnim, wysokim i maksymalnym.

W przypadku benchmarków Opus 4.6 uzyskuje najwyższe wyniki w Terminal-Bench 2.0 dla kodowania agentywnego i prowadzi w Humanity’s Last Exam, złożonej oceny rozumowania. Anthropic twierdzi, że ma 144-punktową przewagę Elo nad GPT-5.2 w ocenie GDPval-AA i 190-punktową poprawę w stosunku do Opus 4.5.

Cennik API pozostaje bez zmian, wynosząc 5 dolarów za milion tokenów wejściowych i 25 dolarów za milion tokenów wyjściowych, chociaż próby przekraczające 200 000 tokenów są objęte premią w wysokości 10/37,50 dolarów.

W godnym uwagi ruchu przedsiębiorstwa Anthropic ogłosił wersję zapoznawczą Claude w Microsoft PowerPoint, gdzie model może odczytać istniejące układy i szablony slajdów oraz generować lub edytować prezentacje, zachowując formatowanie marki.

OpenAI’s GPT-5.3-Codex: Model, który pomógł zbudować samego siebie

Kilka minut po ogłoszeniu Anthropic OpenAI wydał GPT-5.3-Codex, swój najbardziej zaawansowany model kodowania. Wersja ta łączy graniczną wydajność kodowania GPT-5.2-Codex z możliwościami rozumowania i wiedzy profesjonalnej GPT-5.2 w jednym systemie, który jest również o 25 procent szybszy.

Najbardziej godne uwagi twierdzenie: GPT-5.3-Codex pomógł zbudować samego siebie. Zespół OpenAI Codex wykorzystał wczesne wersje modelu podczas procesu szkolenia — debugowania uruchomień szkoleniowych, zarządzania infrastrukturą wdrożeniową i diagnozowania wyników oceny. To pierwsze publiczne uznanie OpenAI, że model odegrał istotną rolę w swoim własnym rozwoju, kamień milowy, który podnosi zarówno kwestie wydajności, jak i bezpieczeństwa.

GPT-5.3-Codex ustanawia nowe rekordy branży w SWE-Bench Pro i Terminal-Bench, benchmarkach, które oceniają zadania inżynierii oprogramowania w świecie rzeczywistym. Model może obsługiwać długotrwałe zadania obejmujące badania, użycie narzędzi i złożoną wykonywalność, a użytkownicy mogą wchodzić w interakcje z nim w trakcie zadania bez utraty kontekstu — bardziej jak współpraca z kolegą niż wydawanie poleceń.

Model jest dostępny teraz dla wszystkich użytkowników planu płatnego ChatGPT za pośrednictwem aplikacji Codex, CLI, rozszerzenia IDE i interfejsu sieciowego. Dostęp do API jest wkrótce planowany.

Dla deweloperów wybierających się między generatorami kodu AI obraz konkurencyjny jest teraz wyraźnie zdefiniowany: Opus 4.6 prowadzi w koordynacji agentów i pracy z długim kontekstem, podczas gdy GPT-5.3-Codex podkreśla szybkość i zintegrowane rozumowanie. Obie strony twierdzą, że zajmują najwyższe miejsca w nakładających się benchmarkach, a narzędzia takie jak Cursor i Apple’s Xcode obsługują oba, więc deweloperzy mogą swobodnie przełączać się między nimi.

OpenAI Frontier: Agenci przedsiębiorstw otrzymują własną platformę

Wraz z wydaniem modelu OpenAI wprowadził Frontier, platformę przedsiębiorstwa do tworzenia, wdrażania i zarządzania agentami AI. Frontier łączy się z bazami danych, systemami CRM, platformami HR, narzędziami do obsługi biletów i innymi aplikacjami biznesowymi, a następnie pozwala agentom AI wykonywać procesy w całym systemie.

OpenAI opisał Frontier jako “warstwę semantyczną dla przedsiębiorstwa”, gdzie pracownicy ludzie i agenci AI działają na tej samej platformie z udostępnionym dostępem do danych i kontrolami bezpieczeństwa. Agenci otrzymują identyfikatory pracowników, wspólny kontekst organizacyjny i uprawnienia na poziomie przedsiębiorstwa.

Platforma jest niezależna od modelu — firmy mogą zarządzać agentami zbudowanymi na modelach OpenAI obok tych z Google, Microsoft i Anthropic. Początkowi klienci obejmują Intuit, State Farm, Thermo Fisher i Uber.

Frontier pozycjonuje OpenAI, aby konkurować bezpośrednio z platformami przedsiębiorstwa, takimi jak Salesforce’s Agentforce i ServiceNow’s AI agents. Różnica: OpenAI buduje od warstwy modelu w górę, podczas gdy dotychczasowi liderzy dodają AI do istniejących narzędzi przepływu pracy. Czy przedsiębiorstwa wolą infrastrukturę agenta od swojego dostawcy AI czy oprogramowania, to zdefiniuje konkurencję AI w 2026 roku.

Perplexity’s Model Council: Trzy modele, jedna odpowiedź

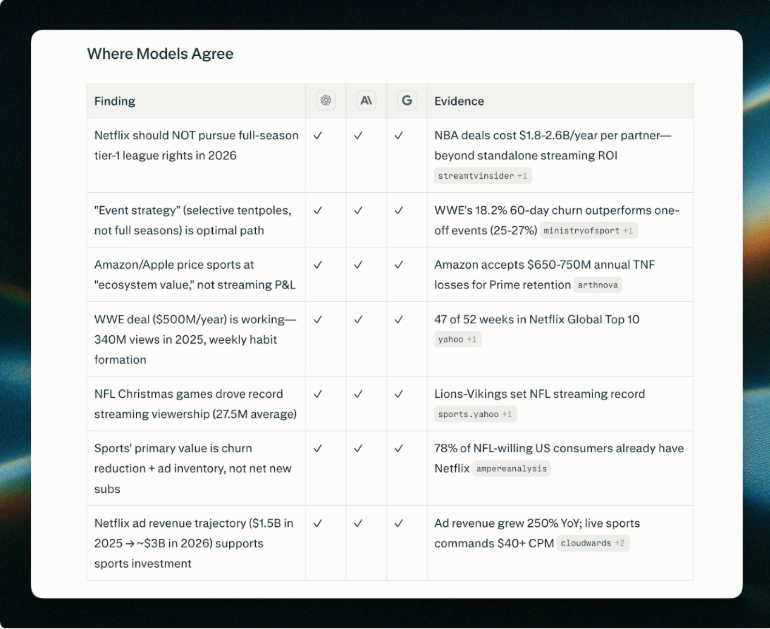

Perplexity wprowadził Model Council, funkcję, która uruchamia tę samą kwerendę na trzech modelach jednocześnie — Claude Opus, GPT i Gemini — a następnie wykorzystuje model syntezatora do połączenia ich danych wyjściowych w jedną odpowiedź, która flaguje obszary zgodności i niezgodności.

Image: Perplexity

Założenie jest takie, że żaden pojedynczy model nie jest niezawodnie najlepszy we wszystkich kwerendach. Kiedy trzy modele graniczne konwergują na tę samą odpowiedź, zaufanie jest wysokie. Kiedy się rozbiegają, użytkownicy wiedzą, że należy dalej badać. Model Council jest dostępny dla subskrybentów Max i jest pozycjonowany dla badań inwestycyjnych, analiz strategicznych i podejmowania złożonych decyzji.

Funkcja ta odzwierciedla strategię Perplexity, która różnicuje się poprzez orkiestrację wielomodelową, a nie budowanie modeli podstawowych. Jeśli Model Council okaże się przydatny, to sugeruje, że przyszłość nie polega na wyborze między Claude a GPT — ale na użyciu obu.

Co to wszystko oznacza

Te wydania potwierdzają, że konkurencja AI przesunęła się z możliwości modelu do infrastruktury produktu. Zarówno OpenAI, jak i Anthropic mają modele, które zajmują najwyższe miejsca w tych samych benchmarkach; różnicowanie teraz tkwi w tym, co można zbudować na ich podstawie.

Perplexity tymczasem przedstawia cichy argument, że wojny modelowe mogą być mniej ważne niż to, jak łączy się modele. Jeśli Model Council okaże się przydatny, to sugeruje, że przyszłość nie polega na wyborze między Claude a GPT — ale na użyciu obu.

Dla deweloperów i przedsiębiorstw oceniających swój stos AI to tylko utrudniło decyzję.