Sztuczna inteligencja

NeRF: Szkolenie dronów w środowiskach Neural Radiance

Badacze z Uniwersytetu Stanforda opracowali nowy sposób szkolenia dronów do nawigacji w fotorealistycznych i bardzo dokładnych środowiskach, wykorzystując recent lawinę zainteresowania Neural Radiance Fields (NeRF).

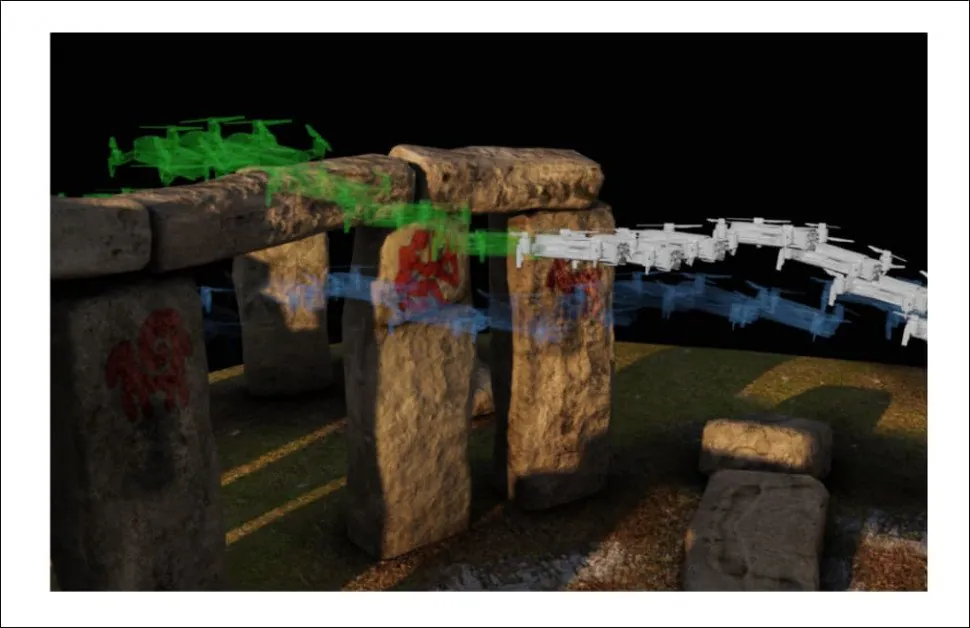

Drony mogą być szkolone w wirtualnych środowiskach mapowanych bezpośrednio z rzeczywistych lokalizacji, bez potrzeby specjalistycznej rekonstrukcji scen 3D. Na tym obrazie z projektu dodano zaburzenie wiatru jako potencjalną przeszkodę dla drona, i możemy zobaczyć, jak dron jest chwilowo odwrócony od jego trajektorii i kompensuje to w ostatniej chwili, aby uniknąć potencjalnej przeszkody. Source: https://mikh3x4.github.io/nerf-navigation/

Metoda oferuje możliwość interaktywnego szkolenia dronów (lub innych typów obiektów) w wirtualnych scenariuszach, które automatycznie obejmują informacje o objętości (do obliczania unikania kolizji), teksturę pobraną bezpośrednio z rzeczywistych zdjęć (aby pomóc w szkoleniu sieci rozpoznawania obrazów dronów w bardziej realistyczny sposób), oraz oświetlenie z rzeczywistego świata (aby zapewnić, że sieć jest szkolona w różnych scenariuszach oświetlenia, unikając przeuczenia lub przeszczegółowego dostosowania do oryginalnego zdjęcia sceny).

Obiekt-couch nawiguje skomplikowane wirtualne środowisko, które byłoby bardzo trudne do mapowania przy użyciu geometrii i retuszowania w tradycyjnych workflow-ach AR/VR, ale które zostało automatycznie odtworzone w NeRF z ograniczonej liczby zdjęć. Source: https://www.youtube.com/watch?v=5JjWpv9BaaE

Typowe implementacje NeRF nie obejmują mechanizmów trajektorii, ponieważ większość projektów NeRF z ostatnich 18 miesięcy koncentrowała się na innych wyzwaniach, takich jak odświetlenie sceny, renderowanie odbić, kompozycja i rozłączenie przechwyconych elementów.

NeRF jako VR/AR

Nowy artykuł nosi tytuł Nawigacja robota za pomocą wyłącznie wizji w świecie Neural Radiance, i jest współpracą między trzema wydziałami Uniwersytetu Stanforda: Aeronautyki i Astronautyki, Inżynierii Mechanicznej oraz Informatyki.

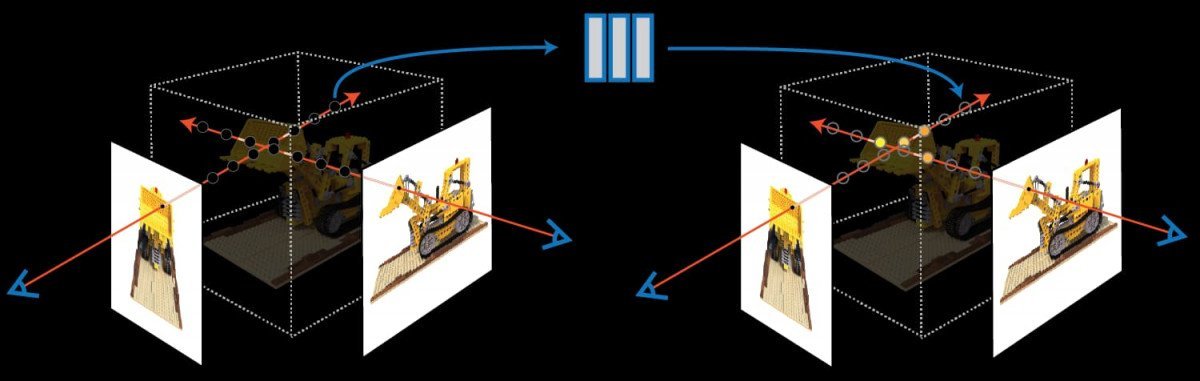

Praca proponuje ramy nawigacyjne, które zapewniają robotowi pre-trenowane środowisko NeRF, którego gęstość objętości wyznacza możliwe ścieżki dla urządzenia. Obejmuje również filtr do oszacowania, gdzie robot znajduje się w wirtualnym środowisku, na podstawie rozpoznawania obrazu z kamery RGB na pokładzie robota. W ten sposób dron lub robot może “halucynować” bardziej dokładnie, co może się spodziewać w danym środowisku.

Optymalizator trajektorii projektu nawiguje przez model NeRF Stonehenge, który został wygenerowany za pomocą fotogrametrii i interpretacji obrazu (w tym przypadku modeli siatkowych) w środowisku Neural Radiance. Planista trajektorii oblicza kilka możliwych ścieżek przed ustaleniem optymalnej trajektorii nad łukiem.

Ponieważ środowisko NeRF zawiera w pełni ukształtowane occlusion, dron może nauczyć się obliczać przeszkody w łatwiejszy sposób, ponieważ sieć neuronowa za NeRF może mapować relację między occlusion a tym, jak systemy nawigacji opartych na wizji na pokładzie drona postrzegają środowisko. Zautomatyzowany pipeline generacji NeRF oferuje stosunkowo trywialną metodę tworzenia hiper-realistycznych przestrzeni szkoleniowych z tylko kilku zdjęć.

Rozwinięty w ramach projektu Stanforda framework planowania online ułatwia wytrzymałą i w pełni opartą na wizji pipeline nawigacji.

Inicjatywa Stanforda jest jedną z pierwszych, które rozważają możliwości eksploracji przestrzeni NeRF w kontekście nawigowalnego i immersyjnego środowiska VR. Pola Neural Radiance są technologią w fazie rozwoju, i obecnie są przedmiotem wielu wysiłków akademickich, aby zoptymalizować ich wysokie wymagania obliczeniowe, a także aby rozłączyć przechwycone elementy.

NeRF nie jest (naprawdę) CGI

Ponieważ środowisko NeRF jest przestrzenią 3D, stało się technologią niezrozumianą od momentu jej pojawienia się w 2020 roku, często postrzeganą jako metoda automatyzacji tworzenia siatek i tekstur, zamiast zastępowania środowisk 3D znanych widzom z działów efektów wizualnych Hollywood i fantastycznych scen środowisk AR i VR.

NeRF wyodrębnia informacje geometryczne i teksturę z bardzo ograniczonej liczby punktów widzenia, obliczając różnicę między obrazami jako informację objętościową. Source: https://www.matthewtancik.com/nerf

W rzeczywistości, środowisko NeRF jest bardziej jak “na żywo” przestrzeń renderowania, gdzie połączenie informacji pikseli i oświetlenia jest zachowane i nawigowane w aktywnej i działającej sieci neuronowej.

Kluczem do potencjału NeRF jest to, że wymaga tylko ograniczonej liczby zdjęć, aby odtworzyć środowiska, i że wygenerowane środowiska zawierają wszystkie niezbędne informacje do wysokiej jakości rekonstrukcji, bez potrzeby usług modelarzy, artystów tekstur, specjalistów od oświetlenia i innych współpracowników “tradycyjnego” CGI.

Segmentacja semantyczna

Nawet jeśli NeRF skutecznie stanowi “Computer-Generated Imagery” (CGI), oferuje całkowicie inną metodologię, i wysoko zautomatyzowany pipeline. Dodatkowo, NeRF może izolować i “zawierać” poruszające się części sceny, tak aby mogły być dodane, usunięte, przyspieszone, i ogólnie działać jako niezależne elementy w środowisku wirtualnym – możliwość, która jest znacznie poza obecnym stanem techniki w “hollywoodzkim” rozumieniu CGI.

Współpraca z Uniwersytetu Technologicznego w Szanghaju, opublikowana latem 2021 roku, oferuje metodę indywidualizacji poruszających się elementów NeRF w “wklejane” elementy sceny. Source: https://www.youtube.com/watch?v=Wp4HfOwFGP4

Negatywnie, architektura NeRF jest trochę “czarną skrzynką”; nie jest obecnie możliwe wyodrębnienie obiektu z środowiska NeRF i bezpośrednie manipulowanie nim przy użyciu tradycyjnych narzędzi opartych na siatkach i obrazach, chociaż kilka wysiłków badawczych zaczyna robić przełomy w dekonstrukcji macierzy za środowiskami renderowania na żywo NeRF.

https://www.youtube.com/watch?v=5JjWpv9BaaE