Sztuczna inteligencja

Mistral AI: Ustawianie nowych benchmarków poza Llama2 w przestrzeni open-source

Duże modele językowe (LLM) ostatnio zajęły centralne miejsce, dzięki wyróżniającym się wykonawcom, takim jak ChatGPT. Kiedy Meta wprowadziła swoje modele Llama, wznowiło to zainteresowanie open-source’owymi LLM. Celem było stworzenie przystępnych, open-source’owych LLM, które są tak dobre, jak najlepsze modele, takie jak GPT-4, ale bez wysokiej ceny lub złożoności.

Ten mix przystępności i wydajności nie tylko otworzył nowe możliwości dla badaczy i deweloperów, ale także ustawił scenę dla nowej ery postępów technologicznych w przetwarzaniu języka naturalnego.

Ostatnio startupy z dziedziny sztucznej inteligencji były na fali z funduszami. Razem zebrali 20 milionów, aby kształtować open-source’owe AI. Anthropic również zebrał imponujące 450 milionów, a Cohere, w partnerstwie z Google Cloud, zabezpieczył 270 milionów w czerwcu tego roku.

Wprowadzenie do Mistral 7B: Rozmiar i dostępność

Mistral AI, z siedzibą w Paryżu i założona przez absolwentów Google DeepMind i Meta, ogłosiła swój pierwszy duży model językowy: Mistral 7B. Ten model może być łatwo pobrany przez każdego z GitHub i nawet za pomocą 13,4-gigabajtowego torrentu.

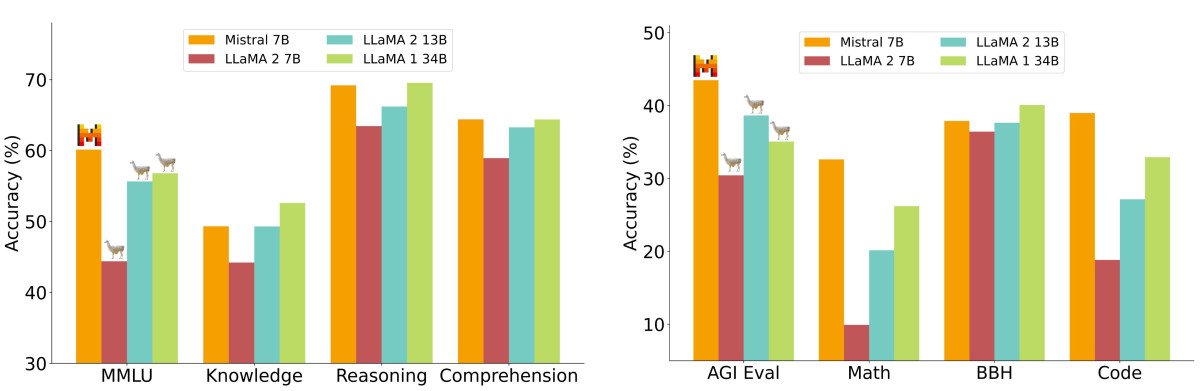

Ten startup zdołał zabezpieczyć rekordowe finansowanie na etapie seed, zanim jeszcze miał produkt. Mistral AI pierwszy model z 7 miliardami parametrów przewyższa wyniki Llama 2 13B we wszystkich testach i pokonuje Llama 1 34B w wielu metrykach.

W porównaniu z innymi modelami, takimi jak Llama 2, Mistral 7B oferuje podobne lub lepsze możliwości, ale z mniejszym obciążeniem obliczeniowym. Podczas gdy podstawowe modele, takie jak GPT-4, mogą osiągnąć więcej, są one droższe i mniej przyjazne dla użytkownika, ponieważ są głównie dostępne przez API.

Jeśli chodzi o zadania związane z kodowaniem, Mistral 7B daje CodeLlama 7B szansę na wygraną. Ponadto jest wystarczająco kompaktowy, aby działać na standardowych maszynach.

Dodatkowo, Mistral 7B Instruct, dostosowany specjalnie do instruktażowych zbiorów danych na Hugging Face, wykazał świetne wyniki. Przewyższa inne modele 7B w MT-Bench i stoi równo z 13B modelami czatowymi.

Hugging Face Mistral 7B Przykład

Testowanie wydajności

W szczegółowej analizie wydajności, Mistral 7B został zmierzone przeciwko modelom Llama 2. Wyniki były jasne: Mistral 7B znacznie przewyższył Llama 2 13B we wszystkich benchmarkach. W rzeczywistości, dopasował się do wyników Llama 34B, szczególnie wyróżniając się w testach kodu i rozumowania.

Testy były organizowane w kilku kategoriach, takich jak zdrowy rozsądek, wiedza o świecie, zrozumienie czytania, matematyka i kod, wśród innych. Szczególnie godne uwagi było to, że Mistral 7B wykazał wyniki porównywalne do modelu Llama 2 trzykrotnie większego, co oznacza potencjalne oszczędności w pamięci i wzrost wydajności. Jednak w testach wiedzy, Mistral 7B był zbliżony do Llama 2 13B, co jest prawdopodobnie spowodowane ograniczeniami parametrów, wpływającymi na kompresję wiedzy.

Czym tak naprawdę Mistral 7B jest lepszy od innych modeli językowych?

Uproszczenie mechanizmów uwagi

Chociaż subtelności mechanizmów uwagi są techniczne, ich podstawowa idea jest dość prosta. Wyobraź sobie czytanie książki i podkreślanie ważnych zdań; jest to podobne do tego, jak mechanizmy uwagi “podkreślają” lub nadają wagę określonym punktom danych w sekwencji.

W kontekście modeli językowych, te mechanizmy umożliwiają modelowi skupienie się na najważniejszych częściach danych wejściowych, zapewniając, że wynik jest spójny i poprawny pod względem kontekstu.

W standardowych transformatatorach, wyniki uwagi są obliczane za pomocą wzoru:

Wzór dla tych wyników obejmuje kluczowy krok – mnożenie macierzy Q i K. Wyzwaniem tutaj jest to, że wraz ze wzrostem długości sekwencji, obie macierze rosną odpowiednio, prowadząc do procesu obliczeniowego. To jest jeden z głównych powodów, dla których standardowe transformatory mogą być wolne, szczególnie przy radzeniu sobie z długimi sekwencjami.

Uwaga wielu zapytań (MQA) przyspiesza rzeczy, używając jednego zestawu “klucz-wartość” głów, ale czasem poświęca jakość. Teraz możesz się zastanawiać, dlaczego nie połączyć szybkości MQA z jakością wielogłowej uwagi? To jest miejsce, w którym pojawia się uwaga grupowa (GQA).

Uwaga grupowa (GQA)

GQA jest rozwiązaniem pośrednim. Zamiast używać tylko jednej lub wielu “klucz-wartość” głów, grupuje je. W ten sposób GQA osiąga wyniki porównywalne do szczegółowej wielogłowej uwagi, ale z szybkością MQA. Dla modeli, takich jak Mistral, oznacza to wydajną wydajność bez kompromisów w jakości.

Uwaga okienkowa (SWA)

Okienko przesuwne jest inną metodą przetwarzania sekwencji uwagi. Ta metoda używa okienka uwagi o stałym rozmiarze wokół każdego tokenu w sekwencji. Z wieloma warstwami, które stosują tę okienkową uwagę, warstwy najwyższe ostatecznie zdobywają szerszą perspektywę, obejmując informacje z całego wejścia. Ten mechanizm jest analogiczny do pól receptywnych widocznych w sieciach neuronowych CNN.

Z drugiej strony, “okienko przesuwne z rozcieńczeniem” modelu Longformer, który jest pojęciowo podobny do metody okienka przesuwnego, oblicza tylko kilka przekątnych macierzy . To zmiana powoduje, że użycie pamięci rośnie liniowo, a nie kwadratowo, co czyni ją bardziej wydajną metodą dla dłuższych sekwencji.

Przezroczystość Mistral AI a obawy bezpieczeństwa w decentralizacji

W swoim ogłoszeniu, Mistral AI również podkreślił przezroczystość, stwierdzając: “Bez sztuczek, bez danych własnościowych.” Ale jednocześnie ich jedyny dostępny model na razie, ‘Mistral-7B-v0.1’, jest wstępnie wytrenowanym modelem podstawowym, więc może generować odpowiedzi na każde zapytanie bez moderacji, co podnosi potencjalne obawy bezpieczeństwa. Podczas gdy modele, takie jak GPT i Llama, mają mechanizmy, aby rozpoznać, kiedy odpowiedzieć, w pełni zdecentralizowana natura Mistral może być wykorzystana przez złe podmioty.

Jednak decentralizacja dużych modeli językowych ma swoje zalety. Chociaż niektórzy mogą ją nadużywać, ludzie mogą wykorzystać jej moc dla dobra społecznego i uczynić inteligencję dostępną dla wszystkich.

Elastyczność wdrożeniowa

Jednym z najważniejszych punktów jest to, że Mistral 7B jest dostępny na licencji Apache 2.0. Oznacza to, że nie ma prawdziwych barier dla jego użycia – niezależnie od tego, czy używasz go do celów osobistych, dużej korporacji czy nawet jednostki rządowej. Wystarczy, że masz odpowiedni system do jego uruchomienia, lub możesz musieć zainwestować w zasoby chmurowe.

Chociaż istnieją inne licencje, takie jak prosta licencja MIT i kooperatywna licencja CC BY-SA-4.0, która wymaga podania źródła i podobnej licencji dla pochodnych, licencja Apache 2.0 zapewnia solidną podstawę dla dużych przedsięwzięć.

Podsumowanie

Wzrost open-source’owych dużych modeli językowych, takich jak Mistral 7B, oznacza przełomowy zwrot w branży AI, czyniąc wysokiej jakości modele językowe dostępnymi dla szerszego grona odbiorców. Innowacyjne podejścia Mistral AI, takie jak uwaga grupowa i okienkowa, obiecują wydajną wydajność bez kompromisów w jakości.

Chociaż zdecentralizowana natura Mistral stwarza pewne wyzwania, jej elastyczność i otwarta licencja podkreślają potencjał dla demokratyzacji AI. W miarę ewolucji krajobrazu, uwaga będzie koniecznie skupiona na równowadze mocy tych modeli z uwzględnieniem etyki i mechanizmów bezpieczeństwa.

Co dalej dla Mistral? Model 7B był tylko początkiem. Zespół planuje uruchomić jeszcze większe modele wkrótce. Jeśli te nowe modele dorównają wynikom 7B, Mistral może szybko stać się jednym z czołowych graczy w branży, wszystko w ciągu pierwszego roku.