Kąt Andersona

Układanki Jigsaw Zwiększają Rozumowanie Wizualne AI

Nowe badania wskazują, że modele AI mogą stać się mądrzejsze w widzeniu, rozwiązywać układanki jigsaw. Przebudowanie pomieszanego obrazu, filmów i scen 3D pomaga im naostrzyć swoje umiejętności wizualne bez potrzeby dodatkowych danych, etykiet lub narzędzi.

W obecnej walce, by popchnąć Multimodalne Duże Modele Językowe (MLLM) do przodu stada (lub przynajmniej pozostać trzy wydania przed najbliższym rywalem), jest niewiele łatwych zwycięstw i nie ma bezpłatnych lunchów.

Chociaż wiele chińskich wydań FOSS z 2025 roku ma niższe koszty rozwoju i eksploatacji, zachodnie wydania mają tendencję do rzucania więcej w problem: więcej objętości danych, więcej mocy inferencyjnej, więcej prądu (chociaż nie, jak ostatnio zauważyliśmy, więcej rzeczywistych anotatorów ludzkich, ponieważ jest to zbyt drogie nawet dla rewolucji AI w skali $trylion+).

W literaturze badawczej większość tak zwanych “bezpłatnych” podejść do ewolucji architektur AI ma tylko nieznaczne przyrosty; lub też ulepszenia w dziedzinach, które nie są najbardziej intensywnie prowadzone. Niemniej, poszukiwanie dotąd nieodkrytych “podstawowych zasad”, które mogłyby przyspieszyć tempo rozwoju, jest zbyt kuszące, by je porzucić.

Zbieranie kawałków

Podczas gdy nie jest to całkiem w tej samej kategorii, nowe współpraca akademicka między chińskimi instytucjami twierdzi, że określa, iż zmuszanie VLM do rozwiązywania układanek jigsaw znacznie poprawia ich wydajność, chociaż ten reinforcement learning podejście wcześniej osiągnęło słabe wyniki w tej dziedzinie, i chociaż wymaga to żadnych dodatkowych systemów, pomocniczych modeli lub innych “bolt-on” procesów:

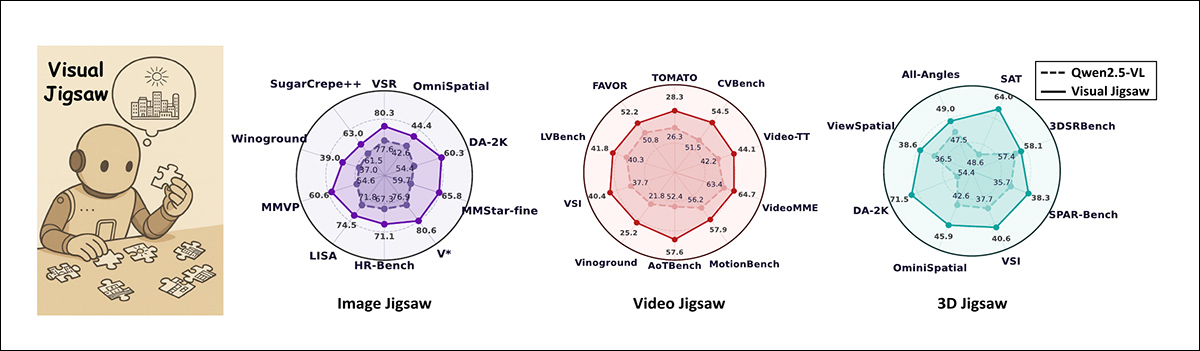

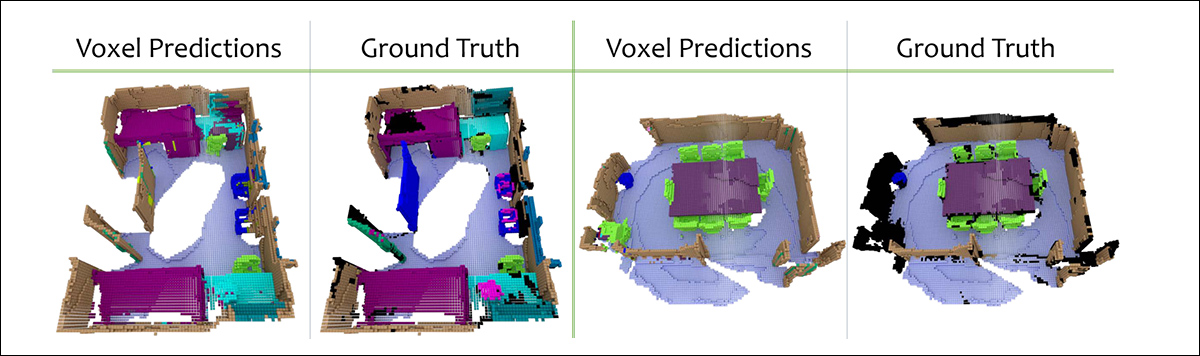

Visual Jigsaw jest samouczącym się frameworkiem post-trenowania, który poprawia umiejętności wizualne w multimodalnych dużych modelach językowych. Przez trenowanie na zadaniach jigsaw w obrazach, filmach i danych 3D, modele zyskują bardziej wyrafinowane, drobne, przestrzenne i kompozycyjne postrzeganie w obrazach, silniejsze rozumowanie czasowe w filmach i ulepszoną geometrię w scenach 3D. Radarowe wykresy na powyższym obrazie pokazują spójne zyski w porównaniu z modelem Qwen2.5-VL, z skalami wartości dostosowanymi do każdego benchmarku dla wyjaśnienia. Source: https://arxiv.org/pdf/2509.25190

System opracowany przez badaczy nosi tytuł Visual Jigsaw, i obejmuje trenowanie istniejących MLLM na materiałach, które zostały rozdrobnione i losowo rozproszone, jak układanka. Autorzy opracowali trzy modalności dla tego podejścia: obraz, film i 3D (tj. CGI-style meshes), i stwierdzili, że umiarkowana adaptacja tego samego procesu przyniosła korzyści wszystkim trzem dziedzinom:

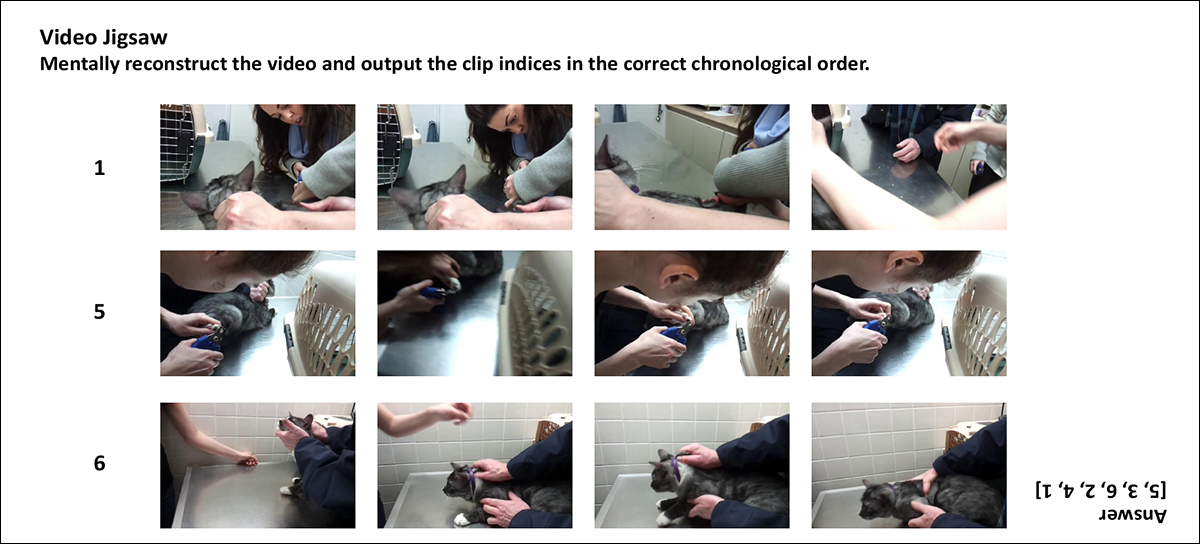

Przedstawienie trzech zadań Visual Jigsaw. W Image Jigsaw, obraz jest podzielony na fragmenty, pomieszany, a model przewiduje poprawny układ; w Video Jigsaw, klipy są pomieszane, a model przywraca ich kolejność w czasie; w 3D Jigsaw, punkty o różnych głębiach są pomieszane, a model klasyfikuje je od najbliższych do najdalszych. Wyniki modelu są oceniane w stosunku do danych odniesienia, z częściowym kredytem za częściowo poprawne rozwiązania.

Metoda treningowa Visual Jigsaw pomaga modelom AI poprawić zrozumienie informacji wizualnych, zmuszając je do ponownego złożenia tych pomieszanych obrazów, fragmentów filmów lub danych 3D.

Proces opiera się na słowach, a nie na obrazach, i dlatego nie ma potrzeby, aby model generował obrazy lub używał dodatkowych składników wizualnych. To podejście pasuje do systemu zwanego Reinforcement Learning from Verifiable Rewards (RLVR), gdzie model otrzymuje nagrodę za poprawne odpowiedzi na podstawie jasnych, automatycznych zasad; i gdzie, zatem, nie jest wymagane etykietowanie przez człowieka.

Ten kluczowy fakt jest tak naprawdę trudny do zrozumienia z nowego artykułu: że system jest montowany semantycznie, przez opisy, a nie w sposób reprezentatywny, w jaki ludzie uczą się rozwiązywać takie układanki:

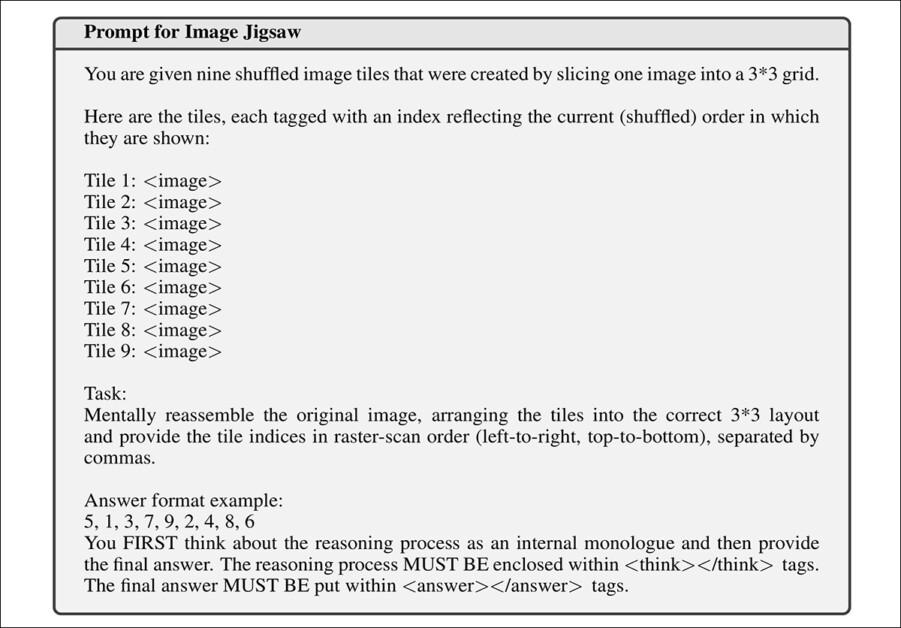

Z materiału uzupełniającego nowego artykułu, przykład zadania RL, ilustrujący tekstowy charakter tego procesu uczenia się. Obrazy, które byłyby wyświetlane modelowi MLLM, nie są tutaj przedstawione.

Chociaż MLLM zajmuje się obszernie zadaniami związanymi z widzeniem, są to językowe architektury, a nie zaprojektowane do generowania obrazów, filmów lub reprezentacji kształtu, takich jak siatki 3D.

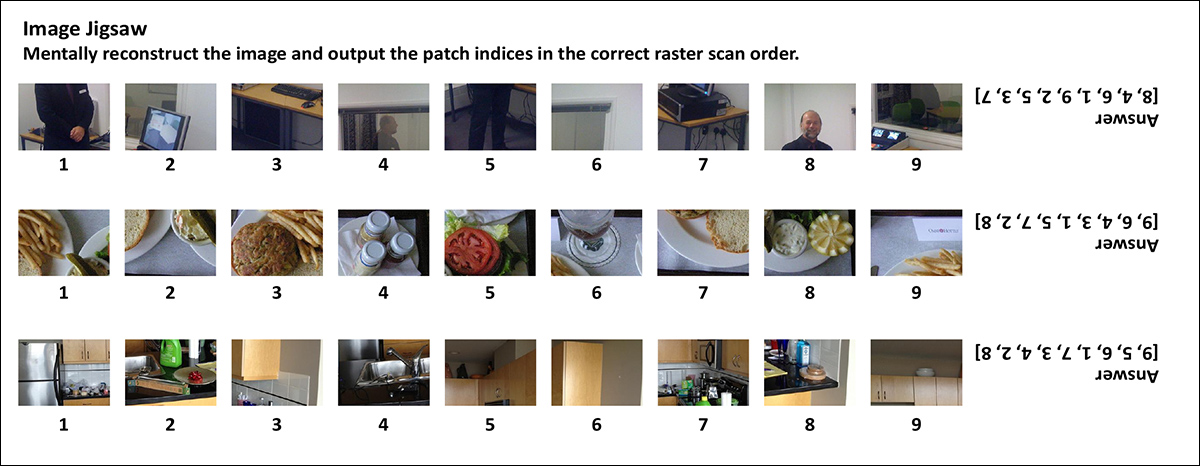

Przykłady z zadania image jigsaw. Każdy wiersz pokazuje pomieszane fragmenty, które model musi uporządkować w ich oryginalnym układzie, z poprawnym układem pokazanym po prawej.

W każdym przypadku ten rodzaj treningu jest wykonywany po głównej fazie nauki, kiedy model już ma pewne zdolności do zrozumienia obrazów.

Poprzednie podejścia, takie jak szwajcarski artykuł z 2017 roku Niesupervised Learning of Visual Representations by Solving Jigsaw Puzzles, używały tego rodzaju podejścia wzmocnienia z mniejszym powodzeniem, na sieciach neuronowych convolutional (CNN), co jest dość odmienną architekturą w porównaniu z nowoczesnym MLLM.

Z wydania z 2017 roku ‘Unsupervised Learning of Visual Representations by Solving Jigsaw Puzzles ‘, wczesny przykład użycia fragmentacji jako nagrodzonego wyzwania dla systemu neuronalnego. Source: https://arxiv.org/pdf/1603.09246

W testach Visual Jigsaw doprowadził do tego, co autorzy twierdzą, że są spójne i mierne ulepszenia w szerokim zakresie benchmarków: zadanie image jigsaw poprawiło drobne postrzeganie, zrozumienie układu przestrzennego i rozumowanie kompozycyjne; zadanie video jigsaw wzmocniło zdolność modelu do śledzenia sekwencji czasowych i rozumowania o kolejności zdarzeń; i zadanie 3D jigsaw wzmocniło zrozumienie oparte na głębi i rozumowanie przestrzenne przy użyciu tylko RGB-D wejść.

Przez wszystkie trzy modalności, artykuł powtarza, nowa metoda przewyższyła kilka konkurencyjnych benchmarków, pomimo braku potrzeby zmian architektonicznych, dodatkowych modułów wizualnych lub dodatkowych danych nadzorowanych:

‘Obszerne eksperymenty dowodzą znacznych ulepszeń w drobnym postrzeganiu, rozumowaniu czasowym i zrozumieniu przestrzennym 3D. Nasze wyniki podkreślają potencjał samouczących się zadań wizualnych w post-trenowaniu MLLM i mają na celu zainspirować dalsze badania nad projektami wstępnymi.’

Nowy artykuł nosi tytuł Visual Jigsaw Post-Training Improves MLLMs, i pochodzi od sześciu badaczy z Nanyang Technological University, Linköping University i SenseTime Research. Artykuł jest zaopatrzony w stronę projektu z aktywnymi demonstracjami (i możesz nawet załadować własny obraz do demonstracji image-based jigsaw). Kod i wagi dla projektu zostały udostępnione,

Metoda

Chociaż powinniśmy przyjrzeć się, jak informacje są dzielone, aby dostosować się do trzech testowanych modalności, powinniśmy najpierw rozważyć projekt nagrody dla nowego systemu.

Podejście Visual Jigsaw ocenia odpowiedzi modelu przy użyciu stopniowej nagrody, a nie tylko prostego pass lub fail. Jeśli model przewiduje dokładną poprawną kolejność kawałków układanki, otrzymuje pełną nagrodę; jeśli odpowiedź jest w większości poprawna, ale nie idealna, model otrzymuje częściową nagrodę, skalowaną przez czynnik dyskontowy, aby uniknąć przeceniania niemal-trafień (to uniemożliwia modelowi oszukiwanie systemu, powtarzając zgadywania, które są tylko częściowo poprawne).

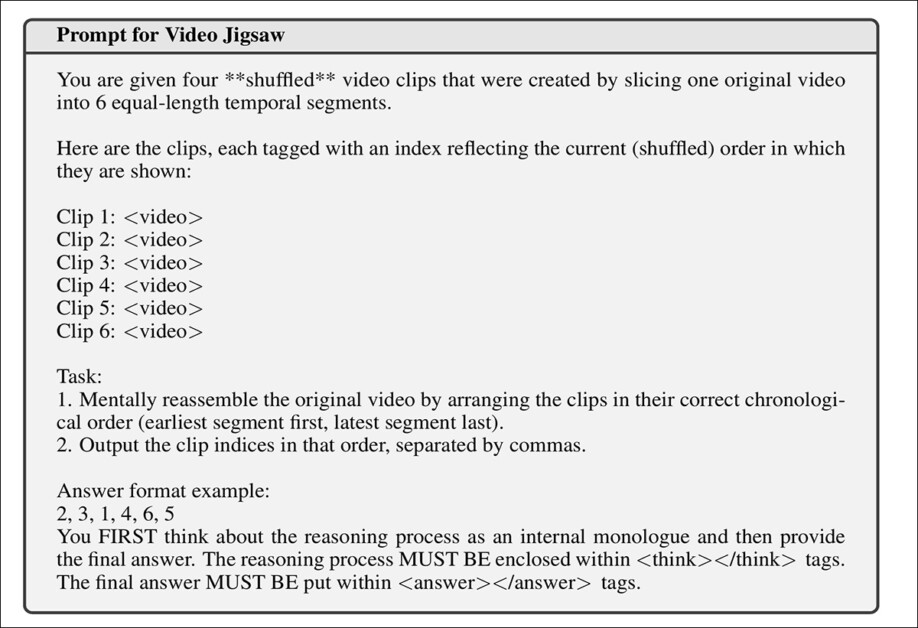

Nieważne odpowiedzi, takie jak “oszustwo” polegające na użyciu tego samego numeru wielokrotnie, otrzymują wynik zero. Aby zachęcić do spójnego formatowania, model musi umieścić swoje rozumowanie wewnątrz <think> tagów i swoją ostateczną odpowiedź wewnątrz <answer> tagów. Otrzymuje małą premię, jeśli ten format jest używany poprawnie.

Obrazy

Aby stworzyć puzzle dla obrazów modalności, obraz jest najpierw podzielony na siatkę fragmentów, rozcinając go na równe bloki:

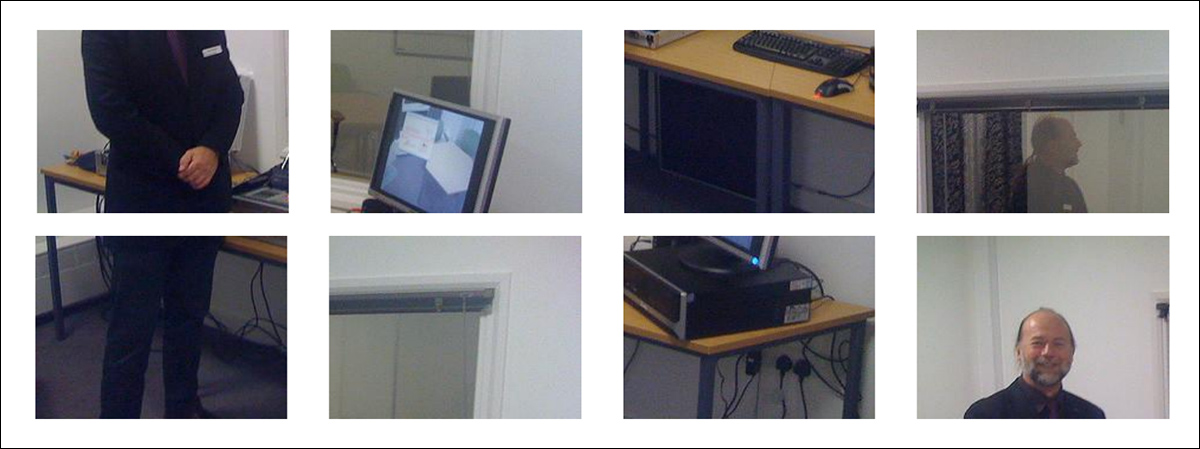

Przykłady fragmentów obrazu dla systemu do rozwiązania.

Fragmenty są ułożone w ustalonej kolejności od lewego górnego rogu do prawego dolnego, jak kolejność czytania na stronie, zanim zostaną pomieszane losowym tasowaniem. Model jest następnie narażony na to pomieszaną kolekcję fragmentów i musi odgadnąć oryginalną kolejność, przewidując poprawną permutację, która przywraca oryginalny układ.

W treningu użyto 118 000 obrazów z COCO dataset, z których każdy obraz dawał dziewięć fragmentów (tj. “kawałków układanki”). Wyzwanie przedstawione systemowi jest pokazane wcześniej w tym artykule (obraz powyżej z podpisem zaczynającym się ‘Z materiału uzupełniającego nowego artykułu’).

Video

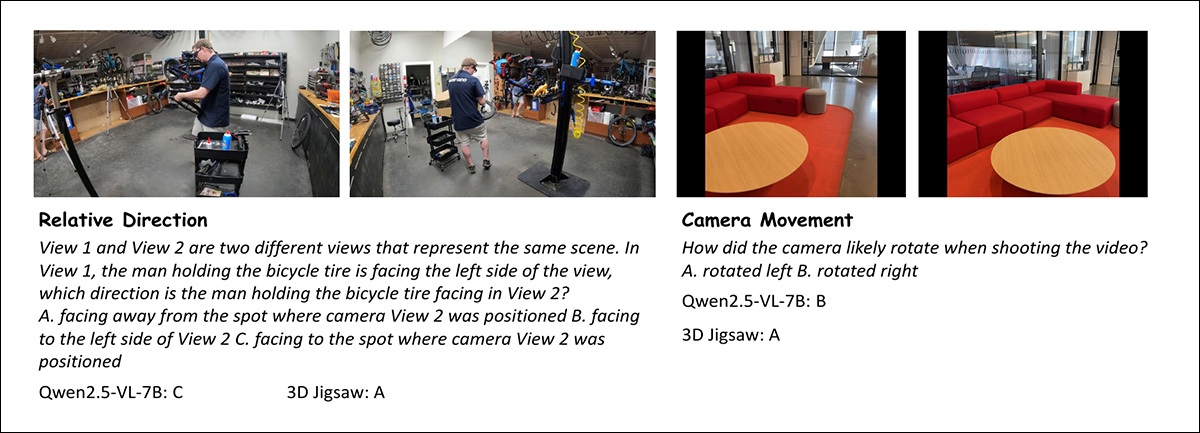

Dla zadania video jigsaw, film jest podzielony na sekwencję klipów, rozcinając go równomiernie w czasie, a następnie tasując segmenty klipów. Model jest następnie pokazywany tej pomieszaną sekwencji i musi odgadnąć ich poprawną, oryginalną kolejność chronologiczną.

Przykłady zadania video puzzle, z materiału uzupełniającego artykułu.

Trening dla tej modalności używał 100 000 filmów z LLaVA-Video dataset, z których każdy film był podzielony na sześć klipów. Aby uniemożliwić modelowi wykorzystanie oczywistych wskazówek ramkowych w klipach, 5% ramkek na początku i końcu każdego klipu zostało obciętych.

Klipy zawierały nie więcej niż 12 ramkek, każdy o maksymalnej rozdzielczości 128x28x28 pikseli. Filmy krótsze niż 24 sekundy zostały wykluczone.

Wyzwanie dla tego zadania jest poniżej:

Wyzwanie uczenia wzmocnienia przedstawione MLLM dla zadania video, bez klipów, które byłyby przedstawione MLLM..

Dane 3D

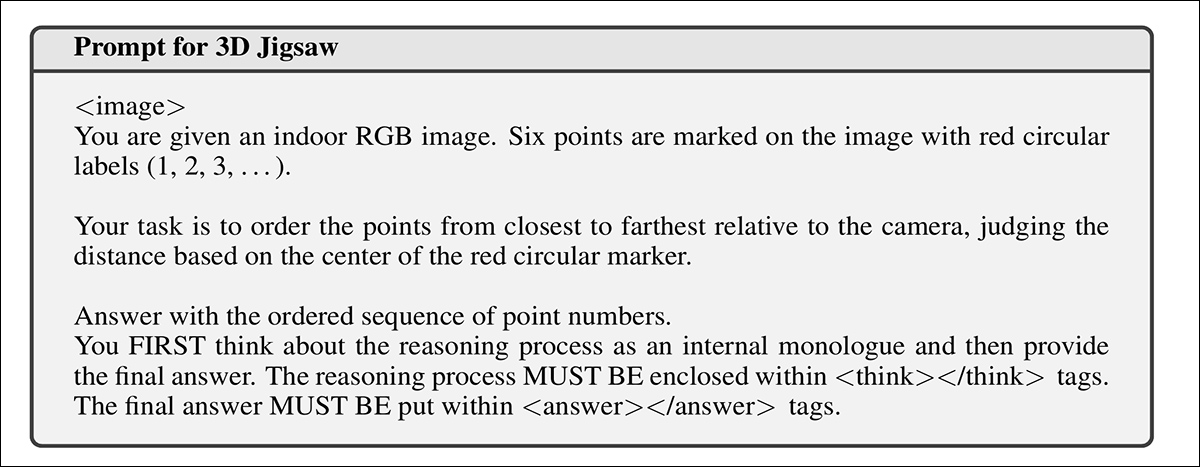

Pełne zadanie 3D jigsaw zwykle wymagałoby rozbicia przestrzeni 3D (takiej jak voxel bloki lub punkt chmury fragmentów) na mniejsze kawałki i trenowania modelu do odtworzenia ich oryginalnego układu przestrzennego.

Jednakże, przeciętny MLLM nie jest wyposażony w bezpośrednie przetwarzanie surowych danych 3D, zamiast tego polegając na wejściach obrazu lub filmu, które są semantycznie interpretowane. Dlatego, aby stworzyć zadanie, które nadal wykorzystuje rozumowanie 3D, ale pozostaje kompatybilne z bieżącymi MLLM, autorzy wprowadzili bardziej przydatną wersję, używając wspomnianych wcześniej obrazów RGB-D (tj. 2D obrazów, które zawierają informację o głębi dla każdego piksela).

Przykłady pytań z 3D Spatial Understanding Benchmark użytych do oceny wydajności w rozumowaniu względnym i ruchu kamery. Model 3D Jigsaw poprawnie wnioskuje zarówno przestrzenne relacje między dwoma widokami sceny, jak i prawdopodobny kierunek obrotu kamery, przewyższając podstawowy model Qwen2.5-VL-7B.

Z każdego obrazu RGB-D model otrzymuje pomieszaną listę punktów, które pierwotnie miały różne głębi, sięgające od najbliższych do najdalszych, a celem jest odzyskanie ich poprawnej kolejności opartej na głębi, używając tylko 2D obrazu jako odniesienia:

Wyzwanie RL dla 3D jigsaw.

Każdy punkt jest oznaczony na obrazie (który jest pokazywany modelowi, ale nie jest wizualizowany w przykładzie wyzwania powyżej), a model musi przewidzieć, który był najbliższy, drugi najbliższy itd., skutecznie odtwarzając oryginalną sekwencję głębi bez dostępu do surowych wartości głębi.

Zadanie 3D jigsaw jest trenowane na obrazach RGB-D z ScanNet dataset, używając 300 000 próbek utworzonych przez wybranie losowych zestawów sześciu punktów głębi na obraz.

Przykłady chmur punktów z datasetu ScanNet użytych w 3D jigsaw. Source: https://arxiv.org/pdf/1702.04405

Każdy punkt musiał leżeć w zakresie głębi od 0,1 do 10 metrów, a aby promować różnorodność, żaden punkt w zestawie nie mógł być bliżej niż 40 pikseli w płaszczyźnie obrazu lub mniej niż 0,2 metra w głębi.

Testy

Do początkowych testów system wykorzystywał Qwen2.5-VL-7B-Instruct jako podstawowy multimodalny model. Trening używał algorytmu Group Relative Policy Optimization (GRPO), z usuniętymi KL regulacją i stratą entropii.

Dla częściowych przewidywań zastosowano czynnik dyskontowy 0,2. Trening image jigsaw używał globalnego rozmiaru partii 256, podczas gdy video i 3D jigsaws używały 128. Stawka uczenia została ustalona na 1×10⁻⁶.

Dla każdego wyzwania model generował 16 odpowiedzi przy temperaturze dekodowania 1,0. Zarówno zadania image jigsaw, jak i video jigsaw były trenowane przez 1 000 kroków, podczas gdy zadanie 3D jigsaw było trenowane przez 800 kroków.

Image Jigsaw

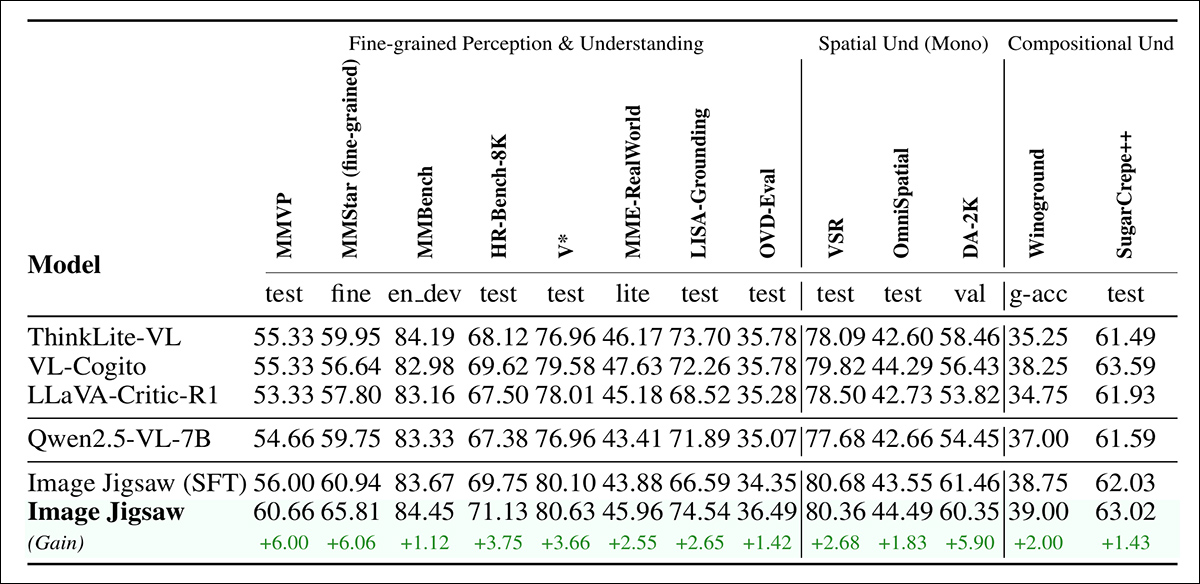

Model image jigsaw został przetestowany w trzech kategoriach benchmarków wizualnych: dla postrzegania i zrozumienia drobnoziarnistego, MMVP, podzbiór drobnoziarnistego postrzegania MMStar; MMBench; HR-Bench; V*; MME-RealWorld (lite); LISA-Grounding; i OVD-Eval.

Dla monocularnego zrozumienia przestrzennego, benchmarki były VSR; OmniSpatial; i Depth Anything V2 (DA-2K). Dla kompozycyjnego zrozumienia wizualnego, testy wykorzystywały Winoground i SugerCrepe++.

Trzy linie bazowe zostały przetestowane, wszystkie pochodzące z Qwen2.5-VL-7B: ThinkLite-VL dla multimodalnego rozumowania; VL-Cogito dla ogólnych zadań wizualnych i naukowych; i LLaVA-Critic-R1 dla postrzegania obrazu.

Wszystkie zostały ocenione przy użyciu tylko krótkich odpowiedzi, ponieważ chain-of-thought (CoT) rozumowanie czasami zmniejszało wydajność.

Wyniki oceny na benchmarkach obrazu. Image Jigsaw poprawił wyniki w porównaniu z modelem Qwen2.5-VL-7B na wszystkich kategoriach zadań (tj. drobnoziarniste postrzeganie i zrozumienie; monocularne zrozumienie przestrzenne; i kompozycyjne rozumowanie wizualne), przewyższając poprzednie linie bazowe po treningu.

Z wyników dla image jigsaw, pokazanych powyżej, autorzy stwierdzają:

‘[Obraz powyżej] pokazuje, że nasza metoda konsekwentnie poprawia zdolności wizualne na trzech typach benchmarków. Te wyniki potwierdzają, że włączenie treningu image jigsaw znacznie wzmacnia umiejętności MLLM do postrzegania i zrozumienia drobnoziarnistego, przewyższając strategie treningu ukierunkowanego na rozumowanie.

‘Przypisujemy te ulepszenia temu, że rozwiązywanie zadań image jigsaw wymaga od modelu, aby zwrócić uwagę na szczegóły fragmentów, wywnioskować globalne układy przestrzenne i rozumować o relacjach między fragmentami, co bezpośrednio korzysta z drobnoziarnistego, przestrzennego i kompozycyjnego zrozumienia.’

Video Jigsaw

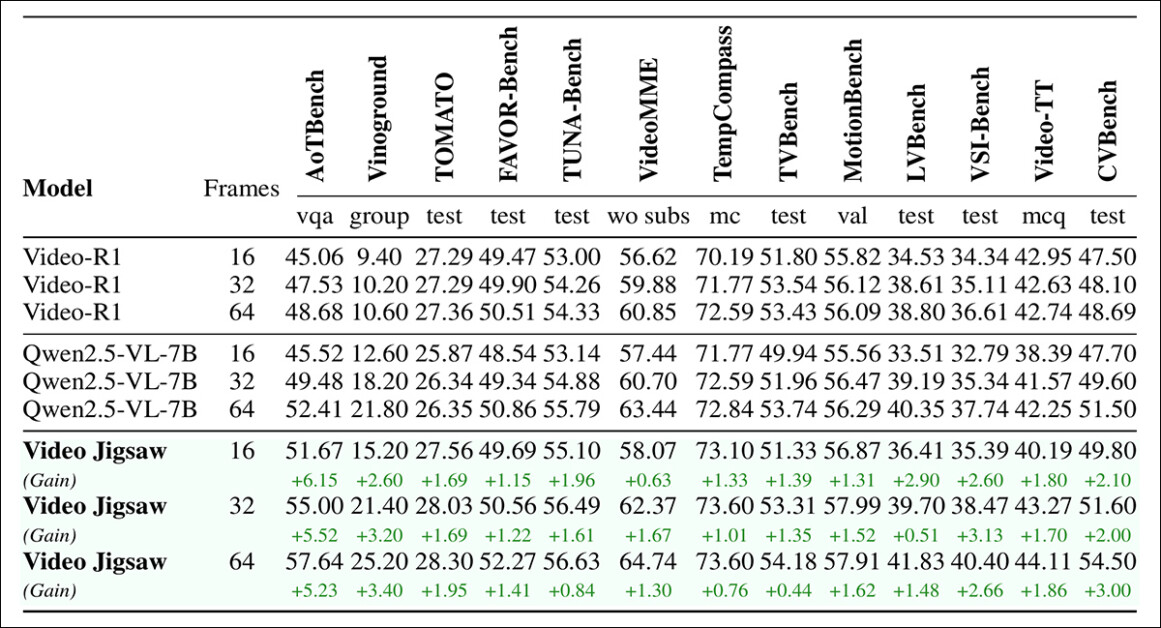

Dla video jigsaw, ocena została przeprowadzona na AoTBench; Vinoground; TOMATO; FAVOR-Bench; TUNA-Bench; Video-MME; TempCompass; TVBench; MotionBench; LVBench; VSI-Bench; Video-TT; i CVBench.

Video-R1 został użyty jako linia bazowa, który został wytrenowany z zimnym startem nadzorowanym dostrajaniem, a następnie uczeniem wzmocnienia dla zrozumienia i rozumowania wideo. W tym przypadku oceny obejmowały pełny proces rozumowania, ponieważ to konsekwentnie dawało lepsze wyniki niż bezpośrednie odpowiedzi.

Wszystkie modele były ograniczone do 256x28x28 pikseli i przetestowane w trzech ustawieniach klatki – 16, 32 i 64:

Wyniki oceny na benchmarkach wideo, z Video Jigsaw przewyższającym bazową linię w sposób ciągły we wszystkich zadaniach i ustawieniach klatki.

Video Jigsaw wyprodukował spójne ulepszenia we wszystkich benchmarkach zrozumienia wideo i ustawieniach klatki, z zyskami szczególnie silnymi w zadaniach wymagających rozumowania czasowego i kierunkowości, takich jak te w AoTBench, oraz w benchmarkach rozumowania między-wideo, takich jak CVBench:

‘Te wyniki potwierdzają, że rozwiązywanie zadań video jigsaw zachęca model do lepszego pochwycenia ciągłości czasowej, zrozumienia relacji między filmami, rozumowania o spójności kierunkowej i uogólniania do holistycznych i ogólnych scenariuszy zrozumienia wideo.’

Dane 3D

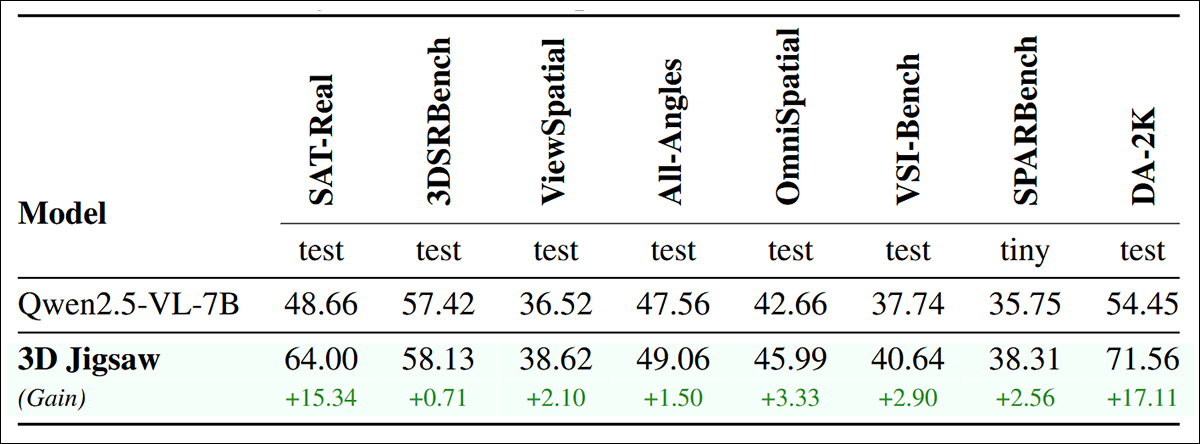

Dla modalności 3D, model został oceniony na SAT-Real; 3DSRBench; ViewSpatial; All-Angles; wspomniany wcześniej OmniSpatial; VSI-Bench; SPARBench (tiny); i wspomniany wcześniej DA-2K.

Wyniki oceny na benchmarkach 3D: 3D Jigsaw poprawił wydajność w zadaniach porównywania głębi, takich jak DA-2K, oraz w szerszych benchmarkach percepcji 3D, obejmujących wejścia jednowidokowe, wielowidokowe i wideo egocentryczne.

Tu autorzy stwierdzają:

‘[3D] Jigsaw osiąga znaczne ulepszenia we wszystkich benchmarkach. Niezbyt zaskakująco, największy zysk jest w DA-2K, benchmarku estymacji głębi, który jest bezpośrednio związany z naszym zadaniem pre-trenowania porządkowania głębi. Co więcej, obserwujemy spójne ulepszenia w szerokim zakresie innych zadań, w tym tych z wejściami jednowidokowymi (np. 3DSRBench, [OmniSpatial]), wielowidokowymi (np. ViewSpatial, All-Angles) i wideo egocentrycznymi (np. VSI-Bench).

‘Te wyniki dowodzą, że nasze podejście nie tylko uczy konkretnego umiejętności porządkowania głębi, ale także skutecznie wzmacnia ogólną zdolność modelu do postrzegania i rozumienia struktury przestrzennej 3D.’

Wnioski

Co nie jest całkiem jasne z tego artykułu, to dokładna relacja między obrazem a opisem, która napędza to ulepszenie wydajności MLLM.

Na pierwszy rzut oka, proces uczenia się przez rozwiązywanie układanek wydaje się bardzo analogiczny do naszych własnych wczesnych prób i rozwoju. Jednak nasze własne przestrzenne interpretowanie świata intuicyjnie wydaje się mniej semantyczne i związane z językiem, a głębszy rzut oka na artykuł ujawnia stopień, w jakim język służy MLLM jako interesująca przeprawa między wizualną i semantyczną rzeczywistością.

* Proszę zauważyć, że autorzy artykułu preferują mniej powszechny termin ‘Multimodalne Duże Modele Językowe’, skrót do ‘MLLM’. Jest to pojęcie, które powstaje lub rzadko używane, i odnosi się do modeli, które obszernie rozumieją i analizują obrazy przestrzennie, ale które nie generują obrazów. Jak nowe paradygmaty i modele pojawiają się, ten leksykon jest pod stałą rewizją.

Pierwotnie opublikowane w czwartek, 2 października 2025