Partnerstwa

Technologie Infineon i d-Matrix współpracują przy niskiej latencji infrastruktury AI

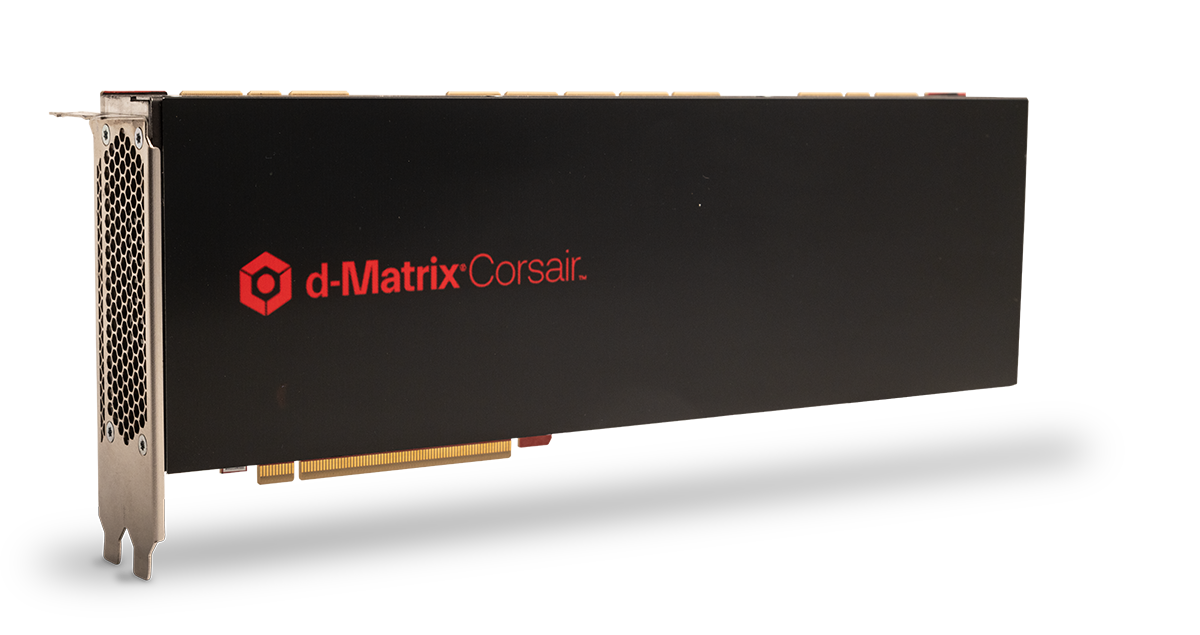

Infineon Technologies ogłosiło współpracę z d-Matrix w celu poprawy wydajności i efektywności energetycznej systemów inferencji AI stosowanych w nowoczesnych centrach danych. Współpraca koncentruje się wokół platformy Corsair AI inference accelerator d-Matrix i modułów OptiMOS dual-phase power Infineon, które są zaprojektowane do wspierania środowisk obliczeniowych o wysokiej gęstości dla interaktywnych obciążeń AI.

Ogłoszenie podkreśla rosnący trend w branży sprzętu AI. Podczas gdy większość boomu infrastrukturalnego w ciągu ostatnich kilku lat koncentrowała się na szkoleniu coraz większych modeli AI, branża teraz szybko rozprzestrzenia się na inferencję — proces faktycznego uruchamiania modeli w rzeczywistych aplikacjach, takich jak czatboty, systemy AI, piloty, wyszukiwarki, analiza finansowa i wsparcie decyzji medycznych. Te obciążenia stawiają inne wymagania dotyczące sprzętu, szczególnie wokół opóźnień, responsywności i zużycia energii.

Dlaczego inferencja AI staje się głównym polem bitwy sprzętu

Inferencja AI wyłoniła się jako jeden z najszybciej rozwijających się segmentów rynku infrastruktury AI, ponieważ interaktywne systemy AI wymagają odpowiedzi w milisekundach, a nie sekundach. d-Matrix pozycjonowało Corsair specjalnie dla tych obciążeń, podkreślając ultra-niską latencję i efektywną inferencję dla dużych modeli językowych i agentów AI.

Zgodnie z oświadczeniem d-Matrix, Corsair został zaprojektowany wokół cyfrowej architektury obliczeń w pamięci, mającej na celu zmniejszenie wąskich gardeł pamięci, które często spowalniają inferencję AI generatywną. Firma twierdzi, że platforma może znacznie obniżyć opóźnienia i poprawić przepływność w porównaniu z tradycyjnymi systemami inferencji opartymi na GPU, szczególnie dla aplikacji interaktywnych.

Współpraca z Infineon rozwiązuje kolejne coraz bardziej krytyczne wyzwanie: dostawę energii.

Ponieważ serwery AI zwiększają swoją gęstość, efektywna dostawa energii do przyspieszaczy stała się czynnikiem ograniczającym skalowalność infrastruktury. Moduły OptiMOS TDM2254xx Infineon są zaprojektowane dla architektur dostarczania energii pionowej, które pomagają zmniejszyć straty elektryczne, jednocześnie poprawiając gęstość energii w kompaktnych systemach serwerowych.

Przesunięcie w kierunku systemów AI w czasie rzeczywistym

Spółki scharakteryzowały współpracę wokół pojawienia się „interaktywnej AI”, gdzie systemy inferencji muszą nieprzerwanie generować dane wyjściowe z ekstremalnie niskim opóźnieniem. Obejmuje to AI konwersacyjną, agenci AI, systemy rozumnienia w czasie rzeczywistym i aplikacje wymagające szybkiej generacji tokenów z dużych modeli językowych.

Założyciel i CEO d-Matrix, Sid Sheth, powiedział, że architektura Corsair została zaprojektowana specjalnie dla latencji tokenów poniżej 2 milisekund, co stało się coraz bardziej istotne, gdy przedsiębiorstwa przenoszą systemy AI z eksperymentów do środowisk skierowanych do klientów.

Szeroka branża AI zaczyna również rozpoznawać, że infrastruktura inferencji może ewoluować inaczej niż infrastruktura szkoleniowa. Podczas gdy klastry GPU dominowały w pierwszej fazie ekspansji AI generatywnej, inferencja coraz bardziej nagradza architektury zoptymalizowane pod kątem przepustowości pamięci, opóźnień, sieci i efektywności energetycznej, a nie samej mocy obliczeniowej.

Efektywność energetyczna staje się centralnym elementem skalowania AI

Jednym z największych ograniczeń, z którymi mierzą się hyperscalers i dostawcy chmury AI, jest popyt na energię elektryczną. Obciążenia inferencji AI mogą działać nieprzerwanie przez miliony żądań dziennie, co sprawia, że efektywność operacyjna jest kluczowa dla kosztów wdrożenia.

Infineon dynamicznie rozszerza swoją pozycję w infrastrukturze AI za pomocą technologii półprzewodnikowych opartych na krzemie, węglu krzemu (SiC) i azotku galu (GaN). Firma coraz bardziej koncentruje się na dostarczaniu warstwy dostarczania energii pod przyspieszacze AI i infrastrukturę serwerową.

Współpraca z d-Matrix odzwierciedla, jak firmy półprzewodnikowe stają się coraz bardziej zintegrowane z startupami przyspieszaczy AI, gdy branża szuka alternatyw dla konwencjonalnych architektur opartych na GPU.

Infrastruktura AI rozszerza się poza tradycyjne GPU

Współpraca następuje również podczas szerszej fali eksperymentów w sprzęcie AI. Rosnąca liczba startupów rozwija specjalistyczne przyspieszacze skoncentrowane specjalnie na inferencji, obliczeniach zorientowanych na pamięć lub sieciach AI.

d-Matrix wyróżniło się poprzez podkreślenie technologii obliczeń w pamięci i systemów inferencji o niskiej latencji dostosowanych do AI generatywnej. Firma rozszerzyła również swoją strategię infrastrukturalną poza same chipy przyspieszaczy, ostatnio podkreślając sieci, infrastrukturę komponowalną i optymalizację systemową dla klastrów inferencji.

W miarę jak aplikacje AI stają się coraz bardziej interaktywne i autonomiczne, dostawcy infrastruktury są wymagani do większego nacisku na redukcję opóźnień, obniżenie zużycia energii i poprawę efektywności systemowej na całych stosach centrów danych, a nie tylko na surowej mocy obliczeniowej.