Sztuczna inteligencja

HD-Painter: Wysokorozdzielcze, tekstowo sterowane wypełnianie obrazu z modelami dyfuzji

Modele dyfuzji zdecydowanie rewolucjonizują branżę AI i ML, a ich aplikacje w czasie rzeczywistym stają się integralną częścią naszego codziennego życia. Po tym, jak modele tekst-obraz pokazały swoje niezwykłe możliwości, techniki manipulacji obrazem oparte na dyfuzji, takie jak kontrolowana generacja, specjalistyczna i personalizowana synteza obrazu, edycja obrazu na poziomie obiektu, wariancje i edycja warunkowa, stały się gorącymi tematami badawczymi ze względu na ich zastosowanie w branży komputerowego widzenia.

Jednakże, pomimo ich imponujących możliwości i wyjątkowych wyników, ramy tekst-obraz, a w szczególności ramy wypełniania tekst-obraz, nadal mają potencjalne obszary rozwoju. Obejmują one zdolność do zrozumienia globalnych scen, szczególnie podczas usuwania szumu z obrazu w wysokich krokach dyfuzji. Aby rozwiązać ten problem, badacze wprowadzili HD-Painter, całkowicie bezszkoleniowy framework, który dokładnie wykonuje instrukcje podane w tekście i skaluje się do wysokorozdzielczego wypełniania obrazu w sposób spójny. Framework HD-Painter wykorzystuje warstwę Prompt Aware Introverted Attention (PAIntA), która wykorzystuje informacje z tekstu do poprawy wyników uwagi siebie, co skutkuje lepszą generacją tekstu.

Aby dalej poprawić spójność podanego tekstu, model HD-Painter wprowadza podejście Reweighting Attention Score Guidance (RASG). Podejście to integruje strategię próbkowania post-hoc z ogólną postacią składnika DDIM, co zapobiega przesunięciom latentnym poza dystrybucją. Dodatkowo, framework HD-Painter posiada specjalistyczną technikę super-rozdzielczości dostosowaną do wypełniania, co pozwala mu rozszerzyć się do większych skal i uzupełnić brakujące obszary w obrazie z rozdzielczością do 2K.

HD-Painter: Tekstowo sterowane wypełnianie obrazu

Modele dyfuzji tekst-obraz były naprawdę znaczącym tematem w branży AI i ML w ostatnich miesiącach, z modelami demonstrującymi imponujące możliwości w czasie rzeczywistym w różnych praktycznych aplikacjach. Wstępnie wytrenowane modele generacji tekst-obraz, takie jak DALL-E, Imagen i Stable Diffusion, wykazały swoją przydatność do uzupełniania obrazu, łącząc usunięte (wygenerowane) nieznane obszary z rozmytymi znanymi obszarami podczas procesu dyfuzji wstecznej. Pomimo produkcji wizualnie atrakcyjnych i dobrze harmonizujących wyników, istniejące modele mają trudności z zrozumieniem globalnej sceny, szczególnie podczas procesu usuwania szumu w wysokich krokach dyfuzji. Poprzez modyfikację wstępnie wytrenowanych modeli tekst-obraz dyfuzji, aby uwzględnić dodatkowe informacje kontekstowe, mogą one być dostosowane do tekstowo sterowanego uzupełniania obrazu.

Dodatkowo, w ramach modeli dyfuzji, tekstowo sterowane wypełnianie i tekstowo sterowane uzupełnianie obrazu są głównymi obszarami zainteresowania badaczy. To zainteresowanie wynika z faktu, że modele wypełniania tekstowo sterowanego mogą generować treści w określonych obszarach obrazu wejściowego na podstawie podanych tekstów, co prowadzi do potencjalnych aplikacji, takich jak retuszowanie określonych obszarów obrazu, modyfikowanie atrybutów obiektów, takich jak kolory lub ubrania, oraz dodawanie lub zastępowanie obiektów. Podsumowując, modele dyfuzji tekst-obraz osiągnęły niedawno bezprecedensowy sukces ze względu na ich wyjątkowo realistyczne i wizualnie atrakcyjne możliwości generowania.

Jednak większość istniejących frameworków demonstruje zaniedbanie podanego tekstu w dwóch scenariuszach. Pierwszym jest dominacja tła, kiedy model uzupełnia nieznane obszary ignorując podany tekst na tle, podczas gdy drugim scenariuszem jest dominacja obiektów w pobliżu, kiedy model propaguje znane obszary obiektów do nieznanych obszarów, używając prawdopodobieństwa kontekstowego wizualnego zamiast podanego tekstu. Jest możliwe, że oba te problemy mogą być wynikiem zdolności modelu dyfuzji do interpretacji podanego tekstu lub mieszania go z informacjami kontekstowymi uzyskanymi z znanego obszaru.

Aby rozwiązać te problemy, framework HD-Painter wprowadza warstwę Prompt Aware Introverted Attention (PAIntA), która wykorzystuje informacje z podanego tekstu do poprawy wyników uwagi siebie, co skutkuje lepszą generacją tekstu. PAIntA wykorzystuje podany tekst do wzmocnienia wyników uwagi siebie w celu zmniejszenia wpływu nieistotnych informacji z obszaru obrazu i zwiększenia wkładu znanych pikseli wyrównanych z podanym tekstem. Aby dalej poprawić wyrównanie tekstu generowanych wyników, framework HD-Painter implementuje metodę post-hoc guidance, która wykorzystuje wyniki uwagi krzyżowej. Jednak implementacja metody post-hoc guidance może spowodować przesunięcia poza dystrybucją, co skutkuje degradacją jakości generowanego obrazu. Aby rozwiązać ten problem, framework HD-Painter implementuje Reweighting Attention Score Guidance (RASG), metodę, która integruje strategię próbkowania post-hoc z ogólną postacią składnika DDIM, co pozwala frameworkowi generować wizualnie przekonywające wyniki wypełniania, prowadząc próbkę w kierunku wyrównanego z podanym tekstem latentu i utrzymując ją w jej domenie szkoleniowej.

Poprzez wdrożenie obu komponentów RASH i PAIntA w swojej architekturze, framework HD-Painter posiada znaczną przewagę nad istniejącymi, w tym najnowocześniejszymi, modelami wypełniania i dyfuzji tekst-obraz, ponieważ rozwiązuje istniejący problem zaniedbania podanego tekstu. Dodatkowo, oba komponenty RASH i PAIntA oferują funkcjonalność plug and play, co pozwala im być kompatybilnymi z modelami dyfuzji wypełniania, aby rozwiązać wymienione wyzwania. Ponadto, poprzez implementację techniki blendowania czasowo-iteracyjnego i wykorzystanie możliwości modeli dyfuzji wysokiej rozdzielczości, potok HD-Painter może działać skutecznie dla wypełniania do rozdzielczości 2K.

Podsumowując, HD-Painter ma na celu wniesienie następujących wkładów w dziedzinie:

- Ma na celu rozwiązanie problemu zaniedbania podanego tekstu w tle i dominacji obiektów w pobliżu, doświadczanego przez ramy wypełniania tekst-obraz, poprzez implementację warstwy Prompt Aware Introverted Attention (PAIntA) w swojej architekturze.

- Ma na celu poprawę wyrównania tekstu generowanych wyników poprzez implementację warstwy Reweighting Attention Score Guidance (RASG) w swojej architekturze, co umożliwia frameworkowi HD-Painter wykonywanie próbkowania post-hoc przy jednoczesnym zapobieganiu przesunięciom poza dystrybucją.

- Ma na celu zaprojektowanie skutecznego, bezszkoleniowego potoku wypełniania tekst-obraz, który przewyższa istniejące ramy najnowocześniejsze, oraz wykorzystanie prostej, ale skutecznej techniki super-rozdzielczości dostosowanej do wypełniania, aby wykonywać wypełnianie tekst-obraz do rozdzielczości 2K.

HD-Painter: Metoda i Architektura

Zanim przyjrzymy się architekturze, ważne jest zrozumienie trzech podstawowych pojęć, które tworzą fundament frameworku HD-Painter: Wypełnianie obrazu, Post-Hoc Guidance w frameworkach dyfuzji, oraz Bloki architektury specyficzne dla wypełniania.

Wypełnianie obrazu jest podejściem, które ma na celu wypełnienie brakujących obszarów w obrazie, zapewniając jednocześnie wizualną atrakcyjność generowanego obrazu. Tradycyjne frameworki głębokiego uczenia implementowały metody, które wykorzystywały znane obszary do propagowania głębokich cech. Jednak wprowadzenie modeli dyfuzji spowodowało ewolucję modeli wypełniania, szczególnie frameworków wypełniania tekst-obraz. Tradycyjnie, wstępnie wytrenowany model dyfuzji tekst-obraz zastępuje niezamaskowany obszar latentu za pomocą szumionej wersji znanego obszaru podczas procesu próbkowania. Chociaż ten podejście działa do pewnego stopnia, znacznie obniża jakość generowanego obrazu, ponieważ sieć usuwania szumu widzi tylko szumioną wersję znanego obszaru. Aby rozwiązać ten problem, kilka podejść miało na celu dostosowanie wstępnie wytrenowanego modelu dyfuzji tekst-obraz do wypełniania tekst-obraz. Poprzez implementację tego podejścia, framework jest w stanie generować losową maskę za pomocą konkatenacji, ponieważ model może warunkować framework usuwania szumu na niezamaskowanym obszarze.

Przechodząc dalej, tradycyjne modele głębokiego uczenia implementowały specjalne warstwy projektowe dla efektywnego wypełniania, z niektórymi frameworkami, które mogły wydobywać informacje skutecznie i produkować wizualnie atrakcyjne obrazy, wprowadzając specjalne warstwy konwolucyjne do radzenia sobie z znanymi obszarami obrazu. Niektóre frameworki nawet dodały warstwę uwagi kontekstowej w swojej architekturze, aby zmniejszyć niepożądane, ciężkie wymagania obliczeniowe wszystkich do wszystkich uwagi siebie dla wysokiej jakości wypełniania.

Wreszcie, metody post-hoc guidance są metodami próbkowania dyfuzji wstecznej, które prowadzą następne przewidywania latentu w kierunku określonego celu minimalizacji. Metody post-hoc guidance są bardzo przydatne przy generowaniu treści wizualnej, szczególnie w obecności dodatkowych ograniczeń. Jednak metody post-hoc guidance mają znaczącą wadę: są znane z powodowania degradacji jakości obrazu, ponieważ tendencja do przesunięcia procesu generowania latentu przez termin gradientu.

Przechodząc do architektury HD-Painter, framework najpierw formułuje problem wypełniania tekst-obraz, a następnie wprowadza dwa modele dyfuzji, a mianowicie Stable Inpainting i Stable Diffusion. Następnie model HD-Painter wprowadza bloki PAIntA i RASG, a na końcu mamy technikę super-rozdzielczości specyficznej dla wypełniania.

Stable Diffusion i Stable Inpainting

Stable Diffusion jest modelem dyfuzji, który działa w przestrzeni latentnej autoenkodera. Dla syntezy tekst-obraz, framework Stable Diffusion implementuje tekstowy prompt, aby prowadzić proces. Funkcja prowadząca ma strukturę podobną do architektury UNet, a warstwy uwagi krzyżowej warunkują ją na podanych tekstach. Ponadto, model Stable Diffusion może wykonywać wypełnianie obrazu z pewnymi modyfikacjami i dostosowaniami. Aby to osiągnąć, cechy obrazu zamaskowanego wygenerowanego przez enkoder są łączone z pomniejszoną maską binarną do latentów. Wynikowy tensor jest następnie wprowadzany do architektury UNet, aby uzyskać oszacowany szum. Następnie framework inicjuje nowo dodane filtry konwolucyjne zerami, podczas gdy reszta UNet jest inicjowana za pomocą wstępnie wytrenowanych punktów kontrolnych z modelu Stable Diffusion.

Powyższy rysunek pokazuje przegląd frameworku HD-Painter, składający się z dwóch etapów. W pierwszym etapie, framework HD-Painter implementuje tekstowo sterowane malowanie obrazu, natomiast w drugim etapie, model wypełnia określoną super-rozdzielczość wyjściowego obrazu. Aby wypełnić brakujące obszary i zachować spójność z podanym tekstem, model wykorzystuje wstępnie wytrenowany model dyfuzji wypełniania, zastępuje warstwy uwagi siebie warstwami PAIntA i implementuje mechanizm RASG, aby wykonać proces dyfuzji wstecznej. Następnie model dekoduje ostateczny oszacowany latent, co skutkuje wypełnionym obrazem. HD-Painter implementuje następnie model super-stabilnej dyfuzji, aby wypełnić obraz oryginalnej wielkości, oraz implementuje proces dyfuzji wstecznej frameworku Stable Diffusion, warunkowany na niskiej rozdzielczości obrazu wejściowego. Model łączy przewidywania odszumione z kodowaniem oryginalnego obrazu w znanym obszarze po każdym kroku i wyznacza następny latent. Na końcu, model dekoduje latent i implementuje blendowanie Poissona, aby uniknąć artefaktów krawędzi.

Prompt Aware Introverted Attention (PAIntA)

Istniejące modele wypełniania, takie jak Stable Inpainting, tendencję mają do polegania bardziej na kontekście wizualnym wokół obszaru wypełniania i ignorowania podanych tekstów. Na podstawie doświadczeń użytkowników, ten problem można zaklasyfikować do dwóch kategorii: dominacji obiektów w pobliżu i dominacji tła. Problem dominacji kontekstu wizualnego nad podanym tekstem może być wynikiem tylko-przestrzennego i bez-tekstowego charakteru warstw uwagi siebie. Aby rozwiązać ten problem, framework HD-Painter wprowadza Prompt Aware Introverted Attention (PAIntA), która wykorzystuje macierze uwagi krzyżowej i maskę wypełniania, aby kontrolować wynik warstw uwagi siebie w nieznanym obszarze.

Komponent Prompt Aware Introverted Attention najpierw stosuje warstwy projekcyjne, aby uzyskać klucz, wartości i zapytania wraz z macierzą podobieństwa. Następnie model dostosowuje wynik uwagi siebie znanych pikseli, aby złagodzić silny wpływ znanego obszaru na niezany obszar, i definiuje nową macierz podobieństwa, wykorzystując podany tekst.

Reweighting Attention Score Guidance (RASG)

Framework HD-Painter przyjmuje podejście próbkowania post-hoc, aby dalej poprawić wyrównanie generowanych wyników z podanym tekstem. Wraz z funkcją celu, podejście post-hoc guidance ma na celu wykorzystanie właściwości segmentacji otwartej słownictwa warstw uwagi krzyżowej. Jednak podejście post-hoc guidance może spowodować przesunięcie domeny latentu dyfuzji, co może obniżyć jakość generowanego obrazu. Aby rozwiązać ten problem, model HD-Painter implementuje mechanizm Reweighting Attention Score Guidance (RASG), który wprowadza mechanizm przypisania gradientu, co skutkuje zachowaniem domeny latentu.

HD-Painter: Eksperymenty i Wyniki

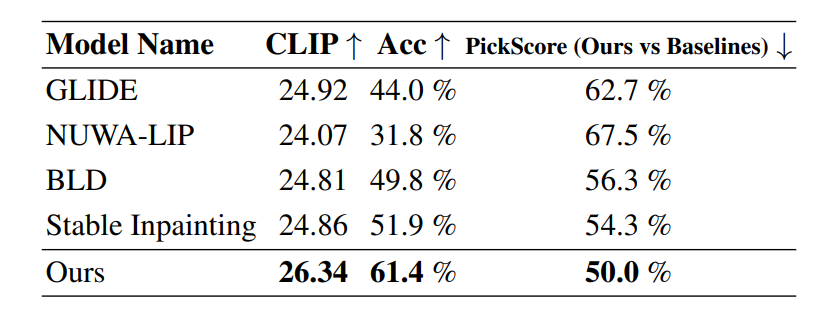

Aby przeanalizować swoją wydajność, framework HD-Painter jest porównywany z aktualnymi modelami najnowocześniejszymi, w tym Stable Inpainting, GLIDE i BLD lub Blended Latent Diffusion, na 10000 losowych próbkach, gdzie podany tekst jest wybrany jako etykieta wybranej maski instancji.

Jak można zauważyć, framework HD-Painter przewyższa istniejące frameworki w trzech różnych metrykach o znaczną różnicę, szczególnie poprawę o 1,5 punktu w metryce CLIP i różnicę w generowanej dokładności wyniku o około 10% w porównaniu z innymi metodami najnowocześniejszymi.

Przechodząc dalej, poniższy rysunek pokazuje porównanie jakościowe frameworku HD-Painter z innymi frameworkami wypełniania. Jak można zauważyć, inne modele bazowe albo odtwarzają brakujące obszary w obrazie jako kontynuację znanych obszarów obiektów, ignorując podane teksty, albo generują tło. Z drugiej strony, framework HD-Painter jest w stanie wygenerować docelowe obiekty pomyślnie dzięki implementacji komponentów PAIntA i RASG w swojej architekturze.

Podsumowanie

W tym artykule omówiliśmy HD-Painter, bezszkoleniowy, tekstowo sterowany podejście do wypełniania obrazu o wysokiej rozdzielczości, które rozwiązuje wyzwania doświadczane przez istniejące frameworki wypełniania, w tym zaniedbanie podanego tekstu i dominację obiektów w pobliżu. Framework HD-Painter implementuje warstwę Prompt Aware Introverted Attention (PAIntA), która wykorzystuje informacje z podanego tekstu do poprawy wyników uwagi siebie, co skutkuje lepszą generacją tekstu.

Aby dalej poprawić spójność podanego tekstu, model HD-Painter wprowadza podejście Reweighting Attention Score Guidance (RASG), które integruje strategię próbkowania post-hoc z ogólną postacią składnika DDIM, co pozwala frameworkowi zapobiec przesunięciom poza dystrybucją latentu. Ponadto, framework HD-Painter wprowadza specjalistyczną technikę super-rozdzielczości dostosowaną do wypełniania, co skutkuje rozszerzeniem do większych skal i umożliwia frameworkowi HD-Painter wypełnianie brakujących obszarów w obrazie z rozdzielczością do 2K.