Cyberbezpieczeństwo

Google Details Security Architecture for Chrome’s AI Agent Features

Google opublikował szczegółową ramę bezpieczeństwa dla nadchodzących funkcji agentic AI w Chrome, wprowadzając wiele warstw obronnych zaprojektowanych w celu ochrony użytkowników, gdy agenci zasilani przez Gemini wykonują zadania przeglądania w sposób autonomiczny.

Ogłoszenie od inżyniera bezpieczeństwa Chrome, Nathana Parkera przedstawia cztery podstawowe filary bezpieczeństwa, które będą regulować, w jaki sposób agenci AI wchodzą w interakcje z witrynami w imieniu użytkowników. Architektura adresuje ryzyka, które dotknęły wczesne systemy agentic, w tym ataki iniekcji podpowiedzi, nieautoryzowany dostęp do danych oraz transakcje fałszywe.

Podejście Google pojawia się, gdy konkurenci rywalizują o wprowadzenie agentów AI opartych na przeglądarce. OpenAI uruchomił ChatGPT Atlas w październiku z możliwościami trybu agenta, podczas gdy Perplexity wydał przeglądarkę Comet w lipcu. Ramy bezpieczeństwa sygnalizują zamiar Google, aby poruszać się bardziej ostrożnie niż rywale, których funkcje agentic już okazały się podatne na wykorzystanie.

Cztery filary bezpieczeństwa agenta

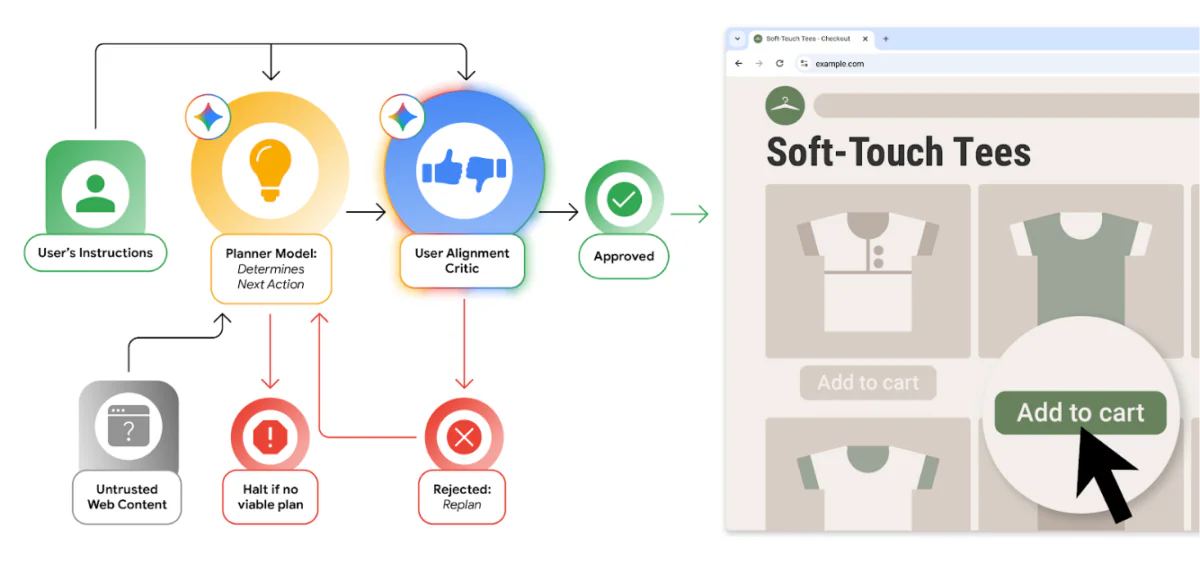

Krytyk wyrównania użytkownika tworzy pierwszą warstwę obrony – oddzielny model Gemini, który weryfikuje każde działanie, które proponuje podstawowy agent AI. Ten krytyk działa w izolacji i analizuje tylko metadane dotyczące proponowanych działań, a nie pełną zawartość strony, zmniejszając jego narażenie na niebezpieczne dane wejściowe. Jeśli działanie wydaje się ryzykowne lub nieistotne dla deklarowanego celu użytkownika, krytyk może nakazać ponowienie lub zwrócić kontrolę użytkownikowi.

Zbiory pochodzenia ograniczają, które witryny i elementy strony agent może uzyskać dostęp podczas wykonywania zadania. System rozróżnia pomiędzy źródłami tylko do odczytu, gdzie agent może spożywać zawartość, a źródłami do odczytu i zapisu, gdzie może wykonywać działania. Nieużywane witryny i ramki są całkowicie wykluczone, a wymagana jest zaufana funkcja bramkowa do zatwierdzenia dostępu do nowych domen. Zapobiega to wyciekowi danych między witrynami i ogranicza potencjalne szkody w przypadku naruszenia bezpieczeństwa agenta.

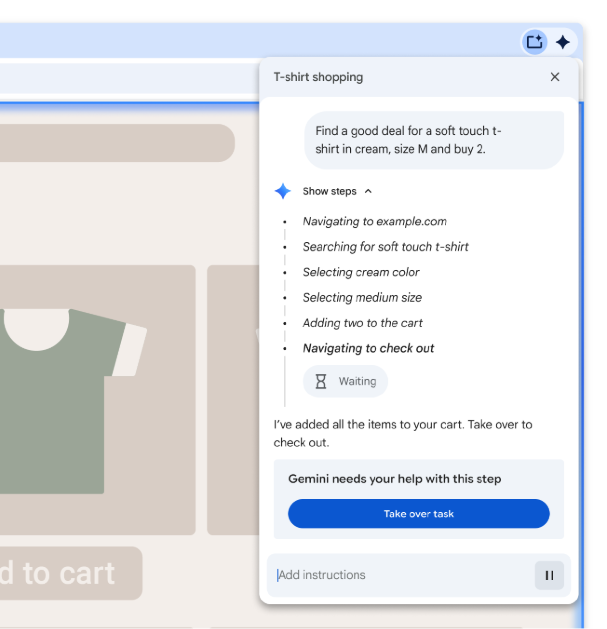

Nadzór użytkownika wymaga ręcznego potwierdzenia dla wrażliwych operacji. Gdy agent napotyka portale bankowe, strony z danymi medycznymi lub musi uzyskać dostęp do przechowywanych poświadczeń z Menedżera haseł Google, Chrome wstrzymuje i prosi użytkownika o zatwierdzenie działania. To samo dotyczy zakupów lub wysyłania wiadomości – agent nie może wykonać tych działań w sposób autonomiczny.

Wykrywanie wstrzyknięcia podpowiedzi wykorzystuje dedykowany klasyfikator skanujący strony w czasie rzeczywistym pod kątem pośrednich prób wstrzyknięcia podpowiedzi. Ten system działa obok istniejącej infrastruktury Safe Browsing w Chrome i wykrywania oszustw na urządzeniu, aby zablokować podejrzane treści złośliwe przed wykonaniem ich przez agenta.

Automatyczne testy czerwone i programy bug bounty

Google opracował automatyczne systemy testów czerwonych, które generują testowe strony i ataki napędzane przez LLM w celu ciągłego walidowania architektury bezpieczeństwa. Firma priorytetowo testuje wektory ataków, które mogą spowodować trwałe szkody, szczególnie te ukierunkowane na transakcje finansowe lub kradzież poświadczeń.

Mechanizm automatycznej aktualizacji Chrome dostarczy naprawy szybko, gdy zostaną odkryte nowe słabości. Aby zachęcić do zewnętrznych badań bezpieczeństwa, Google ogłosił płatności za bug bounty do 20 000 dolarów dla badaczy, którzy zidentyfikują słabości w ramach agentic browsing.

Zapory obronne odzwierciedlają lekcje wyniesione z wczesnych rozszerzeń przeglądarki AI i integracji czatbotów, gdzie ataki iniekcji podpowiedzi okazały się zaskakująco skuteczne w manipulowaniu zachowaniem AI. Poprzez izolację modelu krytyka i ograniczenie dostępu do pochodzenia na poziomie przeglądarki, Google ma na celu uniemożliwienie samej stronie internetowej stania się powierzchnią ataku.

Wnioski dla wyścigu przeglądarek AI

Szczegółowe ujawnienie bezpieczeństwa przez Google kontrastuje z relatywną nieprzezroczystością wokół konkurujących systemów przeglądarek agentic. Firma wydaje się stawiać na to, że użytkownicy przedsiębiorstw i świadomi bezpieczeństwa będą cenić przejrzyste zabezpieczenia bardziej niż funkcje pierwszych przesyłek.

Architektura sugeruje również, co Google uważa za dopuszczalną autonomię agentów AI. Zakupy, badania i wypełnianie formularzy mogą postępować z nadzorem, ale wszystko, co dotyka kont finansowych, danych zdrowotnych lub przechowywanych poświadczeń, wymaga jawnej akceptacji ludzkiej.

Dla deweloperów budujących na platformie Chrome, ograniczenia zestawu pochodzenia będą wymagać starannej uwagi, w jaki sposób funkcje agentic wchodzą w interakcje z wielostronicowymi przepływami pracy. Aplikacje, które oczekują, że agenci swobodnie nawigują po domenach, mogą wymagać zmian architektonicznych, aby działać w ramach modelu bezpieczeństwa Google.

Google nie ogłosił jeszcze daty wydania funkcji przeglądania agentic w Chrome, ale szczegółowa ramy bezpieczeństwa sugerują, że wdrożenie jest bliskie. Chęć firmy do opublikowania architektury obronnej przed uruchomieniem wskazuje na zaufanie do podejścia – oraz niejawne wyzwanie dla konkurentów, aby dopasować się do jego przejrzystości.