Kąt Andersona

Łańcuchowe rozumowanie udowodnione jako „dekoracyjne” w głównych modelach językowych

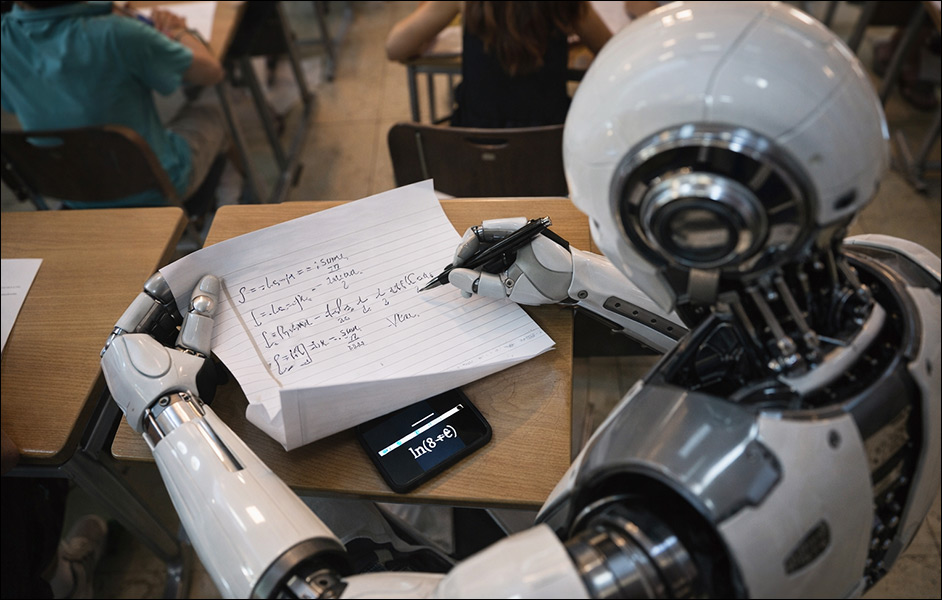

Nowe badania oferują prosty sposób na ustalenie, że wypolerowane, krok po kroku wyjaśnienia wszystkich obecnych wiodących modeli językowych AI – w tym ChatGPT i Claude – są jedynie „dekoracyjne” i zwykle są wymyślane po tym, jak AI zdecydowała, jaka jest odpowiedź.

W zeszłym roku seria głośnych badań od firm zajmujących się AI, w tym Anthropic i Apple, wskazała, że tak zwane „rozumujące AI” często produkują wyjaśnienia krok po kroku, które nie odzwierciedlają tego, co faktycznie wpłynęło na ich odpowiedzi.

Z różnych powodów debata szybko przerodziła się w chaotyczne repliki i różnorodne interpretacje (w tym na tej stronie), pozostawiając nierozstrzygnięte pytanie, czy łańcuchowe rozumowanie (CoT) to jedynie kosmetyczny dodatek zaprojektowany, by uspokoić użytkowników końcowych, czy dowód prawdziwego procesu rozumowania.

ChatGPT ‘pokazuje swoją pracę’ – ale czy już zdecydował, co odpowiedzieć?

Pokaż i powiedz

Teraz, ciekawy nowy artykuł z Indii oferuje tanią i łatwą do powielenia metodę oceny, czy te imponujące „animacje dedukcji” w interfejsach ChatGPT i innych głównych dużych modeli językowych (LLM) naprawdę wskazują, że AI przechodzi przez kroki do wniosku.

Nowe badania pochodzą od dwóch badaczy z Indian Institute of Information Technology Allahabad (IIITA) w Allahabad oraz National Institute of Electronics and Information Technology (NIELIT) w Delhi.

Autorzy odkryli, że w niemal wszystkich przypadkach, w szerokim przekroju własnościowych i otwartoźródłowych LLM, łańcuchowe rozumowanie przedstawiane użytkownikom jest „dekoracyjne”, wymyślane po tym, jak AI ustaliła odpowiedź, którą przedstawi.

Testując takie modele jak ChatGPT5.4, Claude Opus 4.6-R i DeepSeek-V3.2, autorzy odkryli, że usunięcie dowolnego pojedynczego kroku z 10-15 wskazań CoT faktycznie zmieniało odpowiedź w mniej niż 17% przypadków, oraz że każdy pojedynczy krok sam w sobie był wystarczający, aby odzyskać prawidłową odpowiedź.

Autorzy stwierdzają*:

‘Ramy regulacyjne dla AI w opiece zdrowotnej, finansach i prawie coraz częściej wymagają „wyjaśnialnych” [systemów]. Nasze wyniki sugerują, że standardowe podejście – proszenie modelu o pokazanie swojej pracy – zapewnia iluzję przejrzystości.

‘Wyjaśnienia są płynne, odpowiednie dla domeny i błędne w subtelny sposób: opisują rozumowanie, którego model nie wykonał.

‘Medyczna AI, która pisze „eozynofilia sugeruje proces zatorowy”, niekoniecznie w ogóle rozważała eozynofilię. Może dopasowała wzorzec od pytania do odpowiedzi i zmyśliła rozumowanie później.

‘Zgodnie z ustawą UE o sztucznej inteligencji (art. 13), system AI wysokiego ryzyka musi dostarczać „znaczące informacje o zaangażowanej logice”. Nasze ustalenia sugerują, że wyjaśnienia łańcuchowe od większości modeli granicznych nie spełniają tego standardu – „logika zaangażowana” w uzyskanie odpowiedzi nie jest logiką opisaną w wyjaśnieniu.’

Autorzy zauważają, że dwa z mniejszych testowanych modeli złamały jednak wspólny wzorzec dwulicowości, ale tylko w bardzo szczególnych okolicznościach: MiniMax-M25 wykazał prawdziwą zależność od kroków podczas pracy z analizą sentymentu, podczas gdy Kimi-K25 wykazało prawdziwe 39% zapotrzebowania na przetwarzanie CoT – ale tylko podczas pracy z klasyfikacją tematyczną.

We wszystkich innych przypadkach, podobnie jak w przypadku większych i lepiej znanych modeli, demonstrowane kroki rozumowania wydawały się całkowicie performatywne, a modele zamiast tego używały skrótów.

Mniejsze modele starają się bardziej

Poza dziesięcioma testowanymi modelami API, autorzy przetestowali również szereg mniejszych modeli otwartej wagi†, mieszczących się w zakresie od 0,8 do 8 miliardów parametrów (co jest obecnie dość skromne), i odkryli, że te mniejsze AI naprawdę rozumują, oraz że CoT, który pokazują, jest zwykle – choć nie zawsze – niezbędny do osiągnięcia użytecznych i dokładnych wniosków.

Mniejsze modele wykazały 55% zapotrzebowania na rozumowanie krokowe, w przeciwieństwie do średniego 11% zapotrzebowania wśród większych modeli, które, jak twierdzą autorzy, ‘nauczyły się całkowicie omijać wieloetapowe rozumowanie, dochodząc do poprawnych odpowiedzi poprzez wewnętrzne skróty, których ich pisemne rozumowanie nie odzwierciedla’.

Autorzy zakładają, że im lepszy jest model w zadaniu, tym mniej wymaga kroków rozumowania (choć jest to bardziej dyplomatyczne ujęcie koncepcji unikania racjonalnej analizy na rzecz odpowiedzi, która była najsilniejsza w rozkładzie danych treningowych)††:

‘Małe modele wiernie rozumują w matematyce, ponieważ muszą – brakuje im wiedzy parametrycznej, aby użyć skrótu.

‘Modele graniczne przyswoiły sobie wystarczająco dużo wzorców matematycznych, że jawny łańcuch rozumowania staje się zbędny. CoT nadal poprawia dokładność (poprzez strukturyzowanie generowania), ale poszczególne kroki nie niosą już unikalnych informacji.’

Metoda

Metoda użyta do testowania modeli opiera się na trzech kryteriach:

Konieczność usuwa każdy krok CoT po kolei, a następnie sprawdza, czy odpowiedź się zmienia. Każdy krok, którego usunięcie zmienia wynik, jest liczony jako „konieczny”; Wystarczalność izoluje każdy krok i testuje, czy sam może odzyskać odpowiedź, przy czym każdy taki krok jest liczony jako wystarczający; a Wrażliwość na kolejność przestawia kroki i obserwuje, czy odpowiedź się zmienia (ponieważ prawdziwe rozumowanie powinno zależeć od sekwencji, a nie od słów kluczowych).

Razem wzięte, wysoka konieczność i niska wystarczalność wskazują na prawdziwe rozumowanie krok po kroku, podczas gdy niska konieczność i wysoka wystarczalność wskazują na wyjaśnienia, które można usunąć, przestawić lub zredukować bez wpływu na wynik.

Autorzy zauważają, że ta metoda eliminuje potrzebę dostępu do modelu typu white-box, ponieważ można ją przeprowadzić za zaledwie kilka dolarów na modelach zamkniętych, dostępnych tylko przez API, takich jak ChatGPT i Claude, i oczywiście równie skutecznie na modelach otwartej wagi, które można zainstalować lokalnie.

Zauważają również, że wcześniejsze badania albo używały modeli otwartej wagi, które ułatwiały analizę wewnętrzną, albo używały prostszych, binarnych odpowiedzi tak/nie, które ujawniają znacznie mniej wewnętrznych procesów rozumowania modelu API.

Minimalne koszty

Autorzy definiują prawdziwe rozumowanie poprzez konieczność i wystarczalność, przy czym wysoka konieczność i niska wystarczalność wskazują, że każdy krok ma unikalną wagę. Odwrotnie, dekoracyjne rozumowanie wykazuje niską konieczność i wysoką wystarczalność, co oznacza, że kroki można usunąć lub użyć samodzielnie bez zmiany odpowiedzi.

Konieczność sama w sobie, jak stwierdzają, może to zaciemniać, ponieważ może istnieć wiele prawidłowych ścieżek. Dlatego wystarczalność służy do przetestowania, czy jakikolwiek pojedynczy krok już koduje wynik, a wrażliwość na kolejność sprawdza, czy model zależy od sekwencji, a nie od powierzchownych wskazówek.

Podejście to opiera się na ramach Intervention-Consistent Explanation (ICE), wymaga jedynie dostępu API typu text-in, text-out, a dla łańcucha sześciokrokowego obejmuje 15 ewaluacji, przy koszcie około 1–2 dolarów za model.

Ramy ICE klasyfikują zachowanie modelu według konieczności i wystarczalności na trzy wzorce: Dekoracyjny wykazuje niską konieczność i wysoką wystarczalność, co oznacza, że kroki są zbędne, a odpowiedź i tak zostałaby osiągnięta. Dominuje to w większości modeli i zadań; Naprawdę wierny wykazuje wysoką konieczność i wysoką wystarczalność, co oznacza, że każdy krok niesie prawdziwy sygnał (i, jak wspomniano wcześniej, pojawia się to w MiniMax-M2.5 przy sentymencie); oraz Zależny od kontekstu wykazuje wysoką konieczność i niską wystarczalność, co oznacza, że kroki działają tylko razem w sekwencji (co pojawia się w Kimi-K2.5 i MiniMax przy klasyfikacji tematycznej oraz w małych modelach podczas pracy z matematyką).

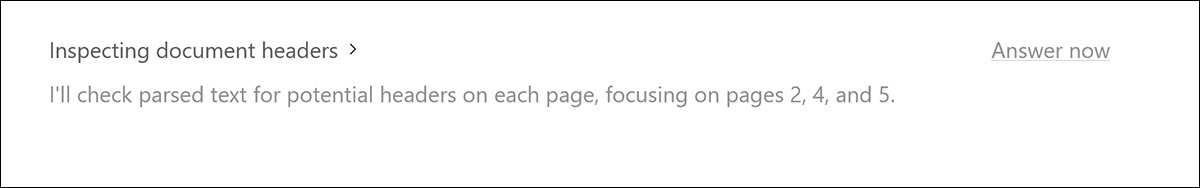

Testy

Dziesięć głównie dostępnych tylko przez API modeli przetestowanych zmodyfikowanym podejściem ICE to: ChatGPT-5.4; Claude Opus 4.6-R; DeepSeek-V3.2; GPT-OSS-120B; Kimi-K2.5; Qwen3.5-397B; Qwen3.5-122B; MiniMax-M2.5; GLM-5; oraz Nemotron-Ultra (253B parametrów).

Każdy model został przetestowany pod kątem czterech zadań: klasyfikacji sentymentu (przy użyciu (SST-2); matematycznych problemów słownych (przy użyciu GSM8K); klasyfikacji tematycznej (przy użyciu AG News); oraz odpowiadania na pytania medyczne (przy użyciu (MedQA). Testy wstępne dotyczyły Sentymentu i Matematyki:

<img class=" wp-image-405574" src="https://www.unite.ai/wp-content/uploads/2026/03/table-1-3.jpg" alt="Testy dziesięciu wiodących modeli językowych, oceniające, jak radzą sobie z rozumowaniem krok