Kąt Andersona

Przenoszenie zmysłu węchu do rozwoju AI

Nowy zestaw danych AI uczy maszyny węchu, kojarząc dane węchu z obrazami, pozwalając modelom dopasowywać woń do obiektów, scen i materiałów.

Prawdopodobnie dlatego, że maszyny wytwarzające woń mają tak burzliwą historię, węch jest dość zaniedbanym zmysłem w literaturze badawczej AI. Chyba, że planowano wyprodukować kolejny odcinek długiej (ponad stuletniej) sagi smell-o-vision, przypadki użycia zawsze wydawały się dość “niszowe” w porównaniu z potencjalnym wykorzystaniem zestawów danych obrazów, dźwięków i filmów oraz modeli AI szkolonych z nich.

W rzeczywistości możliwość zautomatyzowania, uprzemysłowienia i spopularizowania rodzaju urządzeń wykrywających, oferowanych przez psy wykrywające bomby, psy wykrywające zwłoki, psy wykrywające choroby oraz różne inne rodzaje jednostek węszenia psów, byłby znaczącą korzyścią w usługach komunalnych i bezpieczeństwa.

Pomimo wysokiego popytu, znacznie przewyższającego podaż, szkolenie i utrzymanie psów wykrywających jest drogim interesem, który nie zawsze oferta dobrej wartości za pieniądze.

Do tej pory większość badań, które wkroczyły w tę dziedzinę, była ograniczona do laboratoriów, z kuratorowanymi kolekcjami składającymi się z przykładów o ręcznie wykonanych cechach – profilu nachylonego bardziej ku rozwiązaniom w stylu domowego przemysłu niż aplikacjom przemysłowym.

Przodem o nos

W tym dość zatęchłym klimacie pojawia się ciekawa nowa współpraca akademicko-przemysłowa z USA, w której zespół badaczy spędził kilka miesięcy na katalogowaniu różnych woń w środowiskach wewnętrznych i zewnętrznych w Nowym Jorku – i po raz pierwszy, gromadząc obrazy związane z odłowionymi wońmi:

Zwróć uwagę na centralny czujnik, ‘nos’ urządzenia węchowego. Uczony tylko woń, model zgaduje, czy wącha granit, plastik czy skórę – i nawet identyfikuje pokój, w którym się znajduje, bez zobaczenia jednego piksela. Źródło

To badanie doprowadziło autorów nowej pracy do opracowania wariacji na popularnej ramie Contrastive Language-Image Pretraining (CLIP), która łączy tekst i obrazy, w postaci Contrastive Olfaction-Image Pretraining (COIP) – która łączy woń i obrazy.

Góra: zsynchronizowane dane wideo i czujnika węchu są przechwytywane w naturalnych ustawieniach przy użyciu kamery z czujnikiem e-nosa. Dół lewy (b): wspólna osadzona jest uczona przez samo-nadzorowaną cross-modalną. (c): system pobiera wizualne dopasowania wyłącznie na podstawie zapytania węchu. (d): indywidualne próbki węchu są używane do klasyfikacji kategorii środowiska, obiektu i materiału. (e): bardzo podobne woń, takie jak dwa rodzaje trawy, są rozróżniane bez wejścia wizualnego. Źródło

Nowy zestaw danych, zatytułowany Nowy Jork woń, zawiera 7 000 par woń-obrazy, w tym 3 500 różnych obiektów. Podczas szkolenia w testach nowe dane okazały się lepsze od popularnych ręcznie wykonanych cech w relatywnie małej liczbie podobnych wcześniejszych zestawów danych.

Autorzy mają nadzieję, że ich pierwsze wydanie otworzy drogę do późniejszych i następujących prac nad systemami wykrywania węchu zaprojektowanymi do pracy w terenie, podobnie jak psy węszące*:

‘Widzimy ten zestaw danych jako krok w kierunku w terenie, wielomodalnego postrzegania węchu, a także krok w kierunku połączenia wzroku z woń.

‘Na przykład, jako ludzie, stale używamy naszego zmysłu węchu, aby ocenić jakość jedzenia, zidentyfikować zagrożenia i wykryć niewidoczne obiekty.

‘Ponadto, wiele zwierząt, takich jak psy, niedźwiedzie i myszy, pokazuje nadludzkie zdolności węchu możliwości, sugerując, że ludzkie postrzeganie węchu jest daleko od granicy możliwości maszyn.’

Chociaż nowy artykuł, zatytułowany Nowy Jork woń: Duży wielomodalny zestaw danych dla węchu, obiecuje, że dane i kod będą udostępnione, plik danych o wielkości 27 GB jest już dostępny za pośrednictwem strony projektu. Artykuł został wyprodukowany przez dziewięciu badaczy z Uniwersytetu Columbia, Uniwersytetu Cornell i Osmo Labs.

Metoda

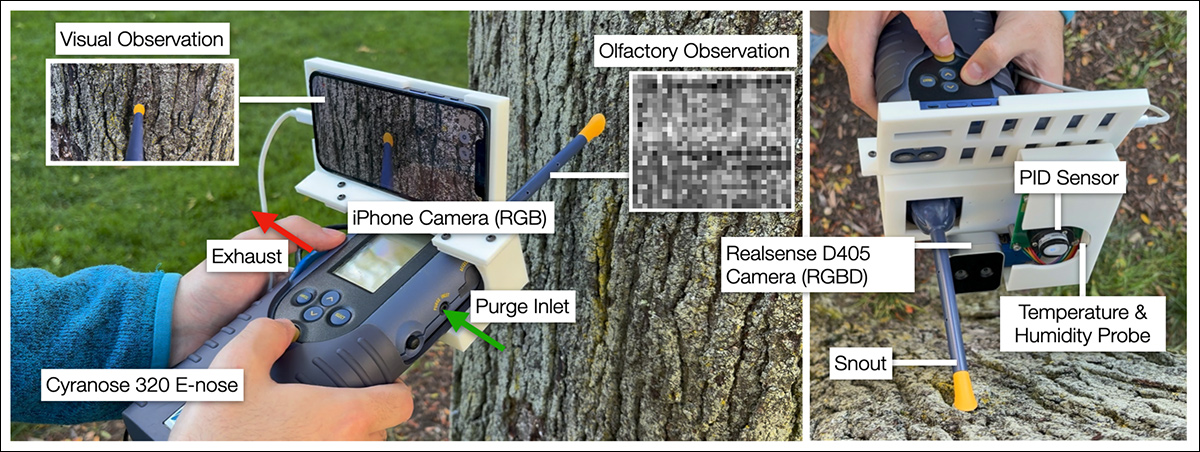

Aby zebrać materiał do nowej kolekcji, badacze użyli Cyranose 320 elektronicznego nosa, z iPhone’m zamontowanym nad przednim wlotem, aby przechwycić wizualnie, jakie woń były rejestrowane:

Przenośny czujnik zbiera sparowane dane wideo i węchu, montując aparat iPhone na Cyranose 320 e-nos. Nos jest skierowany na obiekty, podczas gdy wylot i zawór purge zarządzają przepływem powietrza podczas próbkowania. Kamera RGB‑D przechwytuje głębokość, podczas gdy stężenie związków organicznych, temperatura i wilgotność są rejestrowane za pomocą zintegrowanych czujników, w tym modułu PID i sondy środowiskowej.

Urządzenie Cyranose działa z częstotliwością 2Hz, rejestrując 32-wymiarowe kroki czasowe węchu. Stężenia lotnych związków organicznych były rejestrowane za pomocą czujnika MiniPID2 PPM WR.

Przenośna jednostka funkcjonowała jako zwinny czujnik, przekazując dane do bardziej wydajnej stacji mobilnej do przetwarzania.

Aby umieścić celową woń w kontekście, zarejestrowano “bazową woń”, zanim bardziej konkretny obiekt został bezpośrednio nakierowany na “nos” Cyranose. Próbka ambientalna została następnie pobrana z bocznego portu w urządzeniu, aby upewnić się, że jest wystarczająco oddalona od głównego źródła woń, aby nie zostać skażona.

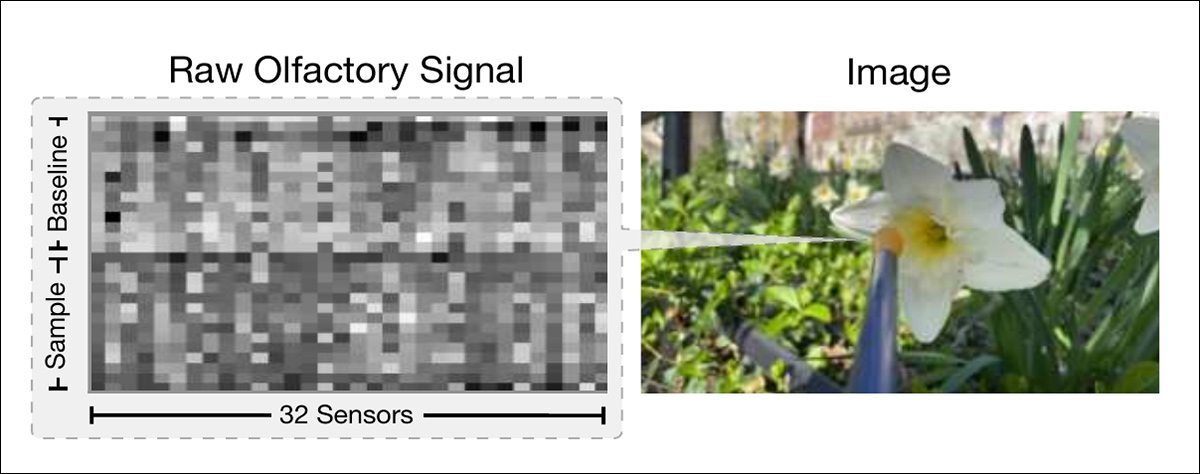

Dwie próbki zostały pobrane przez główny wlot czujnika, z każdej 10-sekundowej rejestracji pobranej z różnych pozycji wokół obiektu, aby poprawić wydajność danych. Próbki zostały następnie połączone z bazową linią bazową, tworząc macierz 28×32, reprezentującą pełne pomiary węchu:

Ten przykład pokazuje sygnał i odpowiadający mu obraz kwiatu. Pełny sygnał węchu składa się z macierzy 28×32, łącząc 14-klatkową linię bazową z dwiema 10-sekundowymi próbkami pobranymi z różnych kątów wokół obiektu docelowego.

Dane i testy

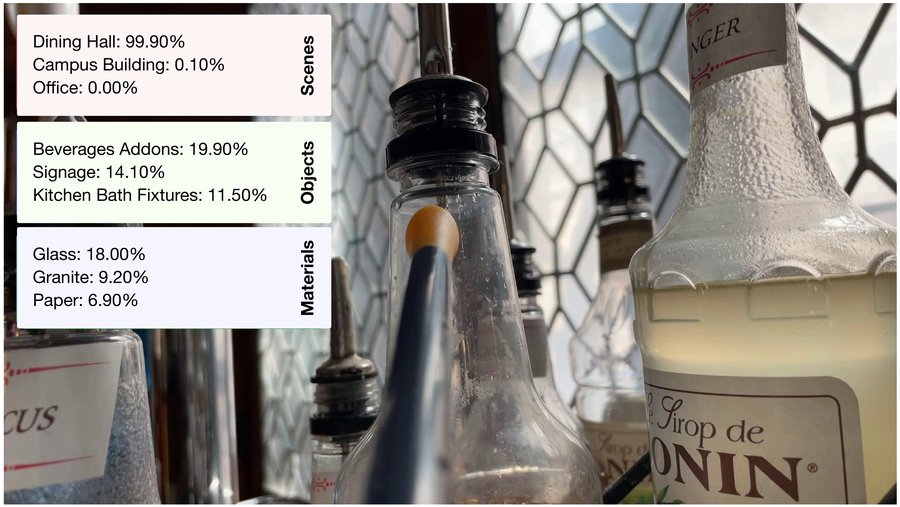

Modele języka i wizji (VLM) zostały użyte do automatycznego oznaczania obiektów i materiałów przechwyconych przez iPhone w urządzeniu Cyranose, z GPT-4o używanym do tego zadania; jednak kategorie scen były oznaczone ręcznie:

Mały przykład z obszernego ilustracji w artykule źródłowym, pokazujący różnorodne źródła węchu i środowiska przechwycone w projekcie.

Zestaw danych został podzielony na szkoleniowe i walidacyjne rozdzielenia, z obiema próbkami z każdego obiektu przypisanymi do tego samego rozdzielenia, aby uniknąć krzyżowego zanieczyszczenia. Ostateczna kolekcja składa się z 7 000 par węchu-wizji, pochodzących z 3 500 nieoznaczonych obiektów, wraz z 70 godzinami wideo i 196 000 kroków czasowych surowych danych węchu z fazy bazowej i próbkowania.

Dane zostały zebrane w 60 sesjach przez okres dwóch miesięcy, obejmujących parki, budynki uniwersyteckie, biura, ulice, biblioteki, mieszkania i jadalnie, z wieloma sesjami przeprowadzonymi w każdej lokalizacji. Wynikowy zestaw danych zawiera 41% środowisk zewnętrznych i 59% środowisk wewnętrznych.

Aby opracować ogólne przedstawienia węchu, autorzy szkolili model kontrastowy, aby skojarzyć zsynchronizowane pary obrazu-węchu z zestawu danych. Ten podejście, wspomniana COIP, używa funkcji straty dostosowanej z CLIP, aby wyalignować osadzenia współwystępujących sygnałów wizualnych i węchu.

Szkolenie używało zarówno kodera wizualnego, jak i kodera węchu, z celem nauczenia modelu, aby dopasować woń i obrazy razem w wspólnym przestrzeni przedstawiania. Wynikające przedstawienia wspierają szereg zadań podrzędnych, w tym odzyskiwanie obrazu-węchu, rozpoznawanie sceny i obiektu, klasyfikację materiału i drobne rozróżnianie woń.

Model został przeszkolony przy użyciu dwóch rodzajów danych węchu: pełnego surowego sygnału i zredukowanego podsumowania, znanego jako smellprint – powszechnie używane cechy w badaniach węchu, które kompresują każdą odpowiedź czujnika w pojedynczą liczbę, porównując szczytowy opór podczas próbkowania z średnim oporem podczas linii bazowej.

W przeciwieństwie do tego, surowy sygnał wejściowy, zarejestrowany w całym Nowym Jorku, składa się z szeregu czasowego z 32 czujników chemicznych w urządzeniu Cyranose, przechwytując, jak każdy czujnik zmieniał się w czasie, reagując na woń.

Dla opracowania zestawu danych, ten niewypracowany sygnał został wprowadzony bezpośrednio do sieci neuronowej, umożliwiając naukę końcową z konwolucyjnym lub transformerowym modelem. Modele zostały przeszkolone przy użyciu zarówno smellprintów, jak i surowych danych wejściowych zebranych z różnych środowisk w Nowym Jorku, z obiema typami danych ocenianymi przy użyciu kontrastowego uczenia.

Odzyskiwanie cross-modalne

Odzyskiwanie cross-modalne zostało ocenione przez osadzenie każdej próbki węchu i jej sparowanego obrazu w wspólnym przestrzeniu przedstawiania i przetestowaniu, czy poprawny obraz może być odzyskany wyłącznie na podstawie danych węchu.

Ranking został określony przez bliskość każdego osadzenia obrazu do zapytania węchu w tym przestrzeniu, a wyniki zostały ocenione przy użyciu średniego rankingu, median rankingu i przypomnienia na wielu progach:

Dokładność odzyskiwania cross-modalnego dla różnych kodera węchu, pokazująca, jak dobrze każdy model identyfikuje poprawny obraz z zapytania węchu. Wyniki porównują architektury przeszkolone na surowych sygnałach węchu z tymi, które używają smellprintów.

W odniesieniu do tych wyników, autorzy stwierdzają:

‘Przeszkolenie z użyciem smellprintów jest lepsze niż losowość we wszystkich miarach. Jednak przeszkolenie kodera węchu na surowym sygnale węchu prowadzi do znacznej poprawy w porównaniu z kodera smellprintu, niezależnie od architektury.

‘To pokazuje bogatsze informacje obecne w surowych danych węchu, odblokowując silniejsze skojarzenia cross-modalne między wzrokiem a woń.’

Szczegół z siódmej ilustracji w artykule źródłowym, który jest zbyt skondensowany, aby go tu odtworzyć. Tutaj, przykłady odzyskiwania cross-modalnego, pokazujące, jak model łączy woń z dopasowanymi obrazami. Każdy wiersz zaczyna się od zapytania węchu, po którym następują najlepsze przewidywania obrazu w wspólnym przestrzeniu osadzania. Poprawny obraz dla każdego zapytania jest otoczony zieloną ramką, ilustrując, jak woń z książek, roślin, kamieni i innych materiałów pociąga model w kierunku wizualnie i semantycznie pokrewnych scen.

Autorzy zauważają również, że wyniki odzyskiwania pokazują wyraźne wzorce semantyczne:

‘Odzyskiwania z naszego modelu często pokazują grupowania semantyczne. Woń książki odzyskuje obrazy innych książek, woń liści odzyskuje obrazy liści.

‘Te wyniki sugerują, że nauczona reprezentacja przechwytuje znaczącą strukturę cross-modalną.’

Rozpoznawanie sceny, obiektu i materiału

Możliwość modelu rozpoznawania węchu bez wejścia wizualnego została oceniona przez przeszkolenie go do identyfikacji scen, obiektów i materiałów wyłącznie na podstawie danych węchu; w tym celu użyto zamrożonej sondy liniowej (prostej klasyfikacji przeszkolonej na zamrożonych reprezentacjach) do oceny, ile informacji jest zakodowanych w nauczonych osadzeniach węchu.

Etykiety pochodziły z połączonych obrazów w zestawie szkoleniowym przy użyciu GPT-4o – ale tylko sygnał węchu był używany podczas klasyfikacji.

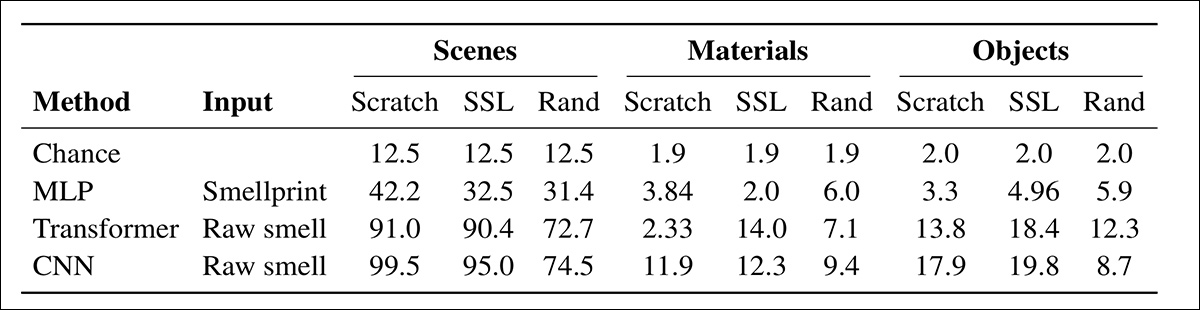

Przetestowano kilka rodzajów kodera: niektóre zainicjowane losowo, niektóre przeszkolone od podstaw, a inne przeszkolone przy użyciu kontrastowego uczenia, aby wyalignować węch i wzrok w wspólnym przestrzeniu reprezentacji, z surowymi danymi i smellprintami ocenianymi:

Dokładność klasyfikacji dla scen, materiałów i obiektów była oceniana przy użyciu danych węchu wyłącznie. Surowy sygnał wejściowy przewyższył smellprinty, z CNN przeszkolonymi od podstaw dającymi najwyższe wyniki, w tym 99,5% dla scen. Przeszkolenie SSL pomogło w niektórych przypadkach, ale było ogólnie przewyższane przez nadzorowane szkolenie. Losowe wagi wskazują, że pojemność modelu sama w sobie jest niewystarczająca.

Znacznie wyższa dokładność została uzyskana, gdy użyto surowych danych węchu, szczególnie w modelach przeszkolonych z cross-modalnym nadzorem. Autorzy komentują**:

‘Modele przeszkolone na surowych danych wejściowych również osiągają wyższą dokładność niż modele przeszkolone z ręcznie wykonanymi cechami smellprintu. Te wyniki pokazują, że głębokie uczenie się z surowych sygnałów węchu jest znacznie lepsze niż ręcznie wykonane cechy.’

Drobne rozróżnianie

Aby ocenić, czy drobne rozróżnienia woń mogą być nauczone, zbudowano benchmark z dwóch gatunków trawy współistniejących na tym samym uniwersyteckim trawniku. Próbki zostały pobrane naprzemiennie w ciągu sześciu 30-minutowych sesji, dając 256 przykładów. Liniowy klasyfikator został przeszkolony na cechach z kontrastowego uczenia węchu i wizji, a oceniony na oddzielonym zestawie 42 próbek:

<img class=" wp-image-226474" src="https://www.unite.ai/wp-content/uploads/2025/11/table-3-4.jpg" alt="Dokładność klasyfikacji gatunku trawy z węchu wyłącznie. Modele były oceniane pod kątem ich zdolności do rozróżnienia dwóch wizualnie podobnych gatunków trawy, używając tylko danych węchu. Wyniki zostały porównane w przypadku smellprintów i surowych danych wejściowych, z modelami albo zlosowanymi losowo, przeszkolonymi od podstaw lub przeszkolonymi przy użyciu samonadzorowanego uczenia (SSL), po którym następowała sonda liniowa. Najwyższa dokładność, 92,9%, została osiągnięta przy użyciu surowych danych węchu z SSL, wskazując, że drobne różnice w woń są najlepiej przechwytywane przez surowe dane wejściowe i szkolenie z wizją.

Tutaj badacze stwierdzają:

‘Przeszkolenie na surowym sygnale węchu (zamiast ręcznie wykonanych cech) daje najwyższą dokładność – przewyższając wszystkie warianty oparte na smellprintach.

‘Te wyniki sugerują, że węchowo-wizualne uczenie zachowuje więcej drobnych informacji niż uczenie się z smellprintami, a nadzór wizualny dostarcza sygnału do wykorzystania tej informacji.’

Wnioski

Chociaż synteza woń wydaje się prawdopodobnie pozostawać nierozwiązanym problemem przez jakiś czas, skuteczny i niedrogi system analizy woń w terenie ma ogromny potencjał, nie tylko dla celów policyjnych, bezpieczeństwa i medycznych, ale także dla monitorowania jakości życia i środowiska.

Na razie sprzęt jest niszowy i zwykle dość drogi; zatem prawdziwy postęp w “węchowym AI” dla wykrywania wydaje się wymagać wizjonerskiego i niedrogiego czujnika w duchu Raspberry PI.

* Moja konwersja cytatów wewnętrznych autorów do linków.

** Proszę zauważyć, że dalsze ilustracje (rysunek 8) są dostępne w artykule źródłowym, ale najlepiej jest je obejrzeć w tym kontekście.

Po raz pierwszy opublikowane w piątek, 28 listopada 2025