Liderzy opinii

Agenci Autonomiczni Potrzebują Więcej Niż Tylko Obserwowalność AI

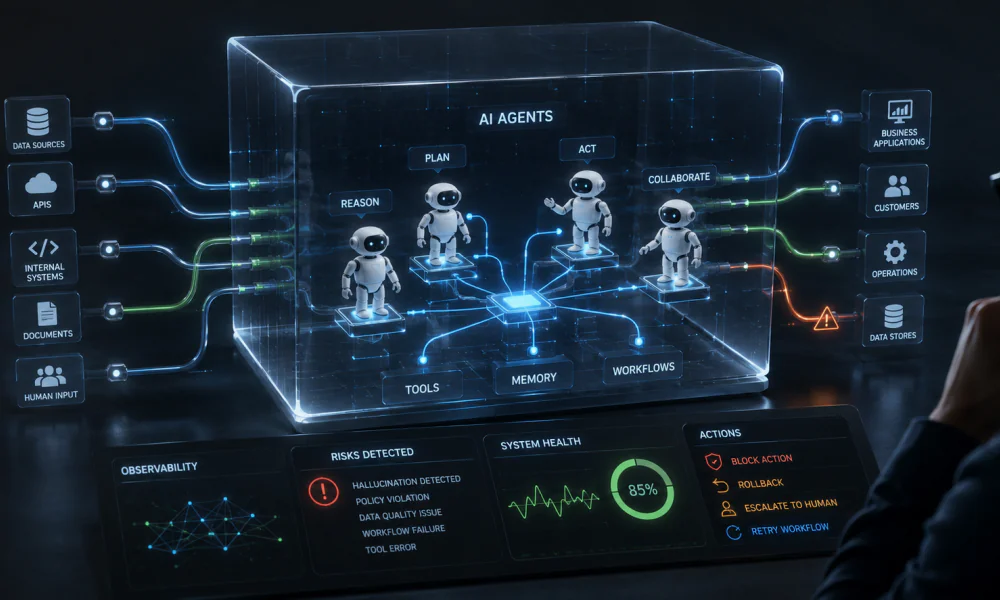

Firmy używają agentów AI do myślenia, działania i inicjowania przepływów pracy, dlatego ważne jest opracowanie planu monitorowania i zarządzania nimi.

Gdy różne składniki systemu AI zaczynają podejmować własne decyzje, obserwowalność sama w sobie nie jest wystarczająca, aby zapewnić, że operacje pozostaną stabilne, bezpieczne i niezawodne.

Aby skutecznie zarządzać agentami AI w całej firmie, przedsiębiorstwa muszą zlikwidować przepaść między identyfikacją problemów a działaniem. Chodzi o coś więcej niż tylko obserwowanie problemów; firmy muszą aktywnie im przeciwdziałać.

Wystąpienie agentów autonomicznych

Pierwsza fala przedsięwzięć AI była oparta na systemach opartych na wprowadzanych danych; użytkownik zadawał pytanie, model odpowiadał, a wymiana kończyła się tam. Chociaż te wczesne technologie były w zasadzie reaktywne, były przydatne do wyszukiwania, współpracy, tworzenia treści i podsumowań.

Następna fala jest inna. Agenci autonomiczni AI nie tylko reagują, ale także myślą przez cele, wybierają narzędzia, ekstrahują informacje, podejmują działania i inicjują przepływy pracy. Czasami pracują w tandemie z innymi agentami lub systemami i coraz częściej pełnią rolę operacyjną w firmie, a nie warstwy interfejsu dla ludzkich instrukcji.

Ta zmiana jest znacząca, ponieważ wpływa na charakterystyki operacyjne AI. Zespoły nie tylko obserwują już wyniki modeli. Zamiast tego, zarządzają dynamicznymi systemami, które mogą natychmiast wpłynąć na klientów, pracowników, infrastrukturę, procesy biznesowe i inne aplikacje.

Możliwości agentów dzisiaj

Umiejętności agentów ewoluują wraz z nimi. Agenci mogą wybrać, co robić dalej, rozbić cel na etapy i wykonać działania na różnych poziomach. Kontaktując się z API, zapytując bazy danych, wyszukując wewnętrzne systemy, aktualizując rekordy i inicjując dalsze działania, koordynują przepływy pracy. Integrując wprowadzane dane, pamięć, reguły biznesowe, pobrane informacje i sygnały operacyjne w czasie rzeczywistym, agenci mogą również podejmować decyzje oparte na kontekście.

Bardziej zaawansowani agenci mogą rozpoznać, kiedy przepływ pracy nie powiedzie się, spróbować ponownie, eskalować problemy lub przesłać zadania do ludzkiego recenzenta. W ramach CRM, ticketingu, infrastruktury chmury, wewnętrznych baz wiedzy, platform obserwacyjnych i aplikacji biznesowych agenci mogą działać niezależnie. Oczekujemy, że te umiejętności będą nadal szybko rozwijać się.

Jak firmy włączają autonomiczne agenci AI

Agenci są włączani do coraz szerszego zakresu operacji organizacyjnych i zbliżają się do procesów operacyjnych, w których szybkość, dokładność, bezpieczeństwo i zarządzanie są ważne. Niektóre z tych operacji obejmują: obsługę klienta i rozwiązywanie przypadków, odpowiedzi na incydenty i operacje IT, przepływy pracy dla DevOps i niezawodności witryn, poprawę kodu i rozwój oprogramowania, planowanie operacyjne i łańcucha dostaw, i wiele więcej.

Występujące operacyjne zagrożenia

Jednak w miarę wzrostu niezależności agentów, firmy muszą radzić sobie z nowym rodzajem ryzyka operacyjnego.

- Złe wybory nie są tylko sugerowane; często są realizowane

- Niewielkie błędy mogą szybko rozprzestrzenić się na inne połączone systemy

- Rzeczywiste działania mogą być wywołane przez halucynacje

- Agenci mogą odbiegać od intencji biznesowych, polityki lub zgodności

- Wzajemne interakcje między wieloma składnikami mogą prowadzić do awarii

- Automatyczne podejmowanie decyzji może podejmować decyzje szybciej niż ludzka ocena

Chociaż zespoły mogą obserwować objawy, muszą również być w stanie zrozumieć powody zachowania systemu. Przedsięwzięcia AI potrzebują kontroli niezawodności oprócz widoczności.

Złożoność systemów AI

Dzisiejsze systemy napędzane przez AI rzadko składają się z jednego modelu. Są to rozproszone, warstwowe systemy składające się z wielu wzajemnie oddziałujących składników, w tym:

- Modeli podstawowych (LLM)

- Dopracowanych lub specyficznych dla zadania małych modeli językowych (SLM)

- Modeli osadzania

- Baz danych wektorowych

- Potoków pobierania i składników RAG

- Szablonów wprowadzanych danych i warstw orkiestracji wprowadzanych danych

- Zestawów danych szkoleniowych i oceny

- Barier ochronnych i warstw polityki

- Agentów i przepływów pracy

- Systemów wywoływania narzędzi

- Telemetrii (znanej również jako dzienniki, metryki i ślady)

- Punktów kontrolnych zatwierdzenia z udziałem człowieka

Ihre ryzyko

Każdy składnik dodaje inny tryb awarii, a sposób, w jaki wzajemnie się oddziałują, dodaje dalszą złożoność. Nawet jeśli system wydaje się silny na poziomie infrastruktury, może nadal podejmować złe decyzje i generować satysfakcjonujące wyniki; wszystko to podczas budowania ryzyka operacyjnego pod powierzchnią.

Niektóre związane z tym ryzyka obejmują: wprowadzenie złych lub skażonych danych przez potoki danych, wąskie gardła infrastruktury, które zmniejszają niezawodność, szkodliwe lub błędne wyniki oraz wąskie gardła operacyjne w odpowiedzi na przegląd ludzki. Dodatkowo, systemy z wieloma agentami lub krokami mogą awaryjnie działać w sposób, który nie jest natychmiast widoczny.

Obserwowalność AI

Tradycyjne monitorowanie jest niewystarczające, aby zrozumieć zachowanie wprowadzanych danych, jakość pobierania, dryf modelu, kanały wykonania agenta lub połączenie między zachowaniem AI a wpływem na działalność biznesową lub operacyjną.

To tam wchodzi obserwowalność AI. Obserwowalność AI umożliwia zespołom zrozumienie, jak systemy AI działają w produkcji, gromadząc, korelując i oceniając dane wejściowe i wyjściowe, pożądane zachowania i sygnały decyzyjne generowane przez te systemy. Jest to niezbędne, ponieważ systemy AI są rozproszone, nieokreślone i wysoce wrażliwe na kontekst.

Obserwowalność AI zapewnia pełną wgląd w przepływy pracy AI, dzięki czemu zespoły, które z niej korzystają, mogą zrozumieć, jak wprowadzane dane, modele, warstwy pobierania, narzędzia i systemy podrzędne wzajemnie się oddziałują podczas wykonania.

Obserwowalność AI umożliwia również monitorowanie wydajności i zachowania, w tym opóźnień, kosztów, użycia tokenów, przepustowości, wskaźników błędów, zachowania modelu i wskaźników jakości wyjściowej. Śledzi i analizuje ścieżki wykonania w złożonych przepływach pracy agentów i pokazuje, jak wyniki są osiągane w kilku krokach i zależnościach.

Obserwowalność AI znajduje również anomalie w sygnałach operacyjnych i AI, ujawniając nietypowe zachowania w modelach, potokach, infrastrukturze lub wynikach zorientowanych na użytkownika przed ich odkryciem przez zespoły ręcznie. Przyspiesza diagnostykę, gdy coś pójdzie nie tak, i ułatwia dochodzenie do przyczyny, włączając do telemetrii systemu (dzienników, metryk, śladów i zdarzeń) operacje specyficzne dla AI.

Obserwowalność sama w sobie nie jest wystarczająca

Pomimo że jest to niezbędna praktyka biznesowa, obserwowalność AI ma wewnętrzne ograniczenia.

Obserwowalność jest diagnostyczna, a nie prewencyjna; zespoły mogą dowiedzieć się, co poszło nie tak, ale niekoniecznie, jak temu zapobiec. Ważne jest, aby zrozumieć, że wiedza o przeszłych działaniach agenta nie automatycznie przekłada się na kontrolę nad przyszłymi działaniami agenta.

W przypadku złożonych systemów nieokreślonych obserwowalność może często przytłaczać zespoły danymi, które prowadzą do niepewności. Zamiast oferować operacyjną odpowiedź, obserwowalność często kończy się na wyjaśnieniu. Nawet jeśli zespoły są świadome problemu, mogą nie mieć automatyzacji, zabezpieczeń i pętli kontroli niezbędnych do podjęcia korygujących działań.

To tworzy operacyjną lukę. Firmy mogą być w stanie zidentyfikować dryf, złe wyniki, niebezpieczne zachowania lub obniżoną produktywność, ale mogą nadal nie być w stanie temu zapobiec, złagodzić skutków lub utrzymać autonomiczne systemy w bezpiecznych parametrach operacyjnych.

Oznacza to, że zespoły nadal działają reaktywnie. Używają interwencji ręcznej, gdy coś pójdzie nie tak, badają incydenty po fakcie i polegają na pracy ludzkiej, aby zrekompensować systemy, które stają się szybsze i bardziej autonomiczne.

Przegląd niezawodności AI

Niezawodność AI wykracza poza samo obserwowanie problemów. Jest to dyscyplina, która zapewnia, że systemy AI działają bezpiecznie, spójnie, przewidywalnie i skutecznie w rzeczywistych środowiskach produkcyjnych. Niezawodność AI rozumie i zarządza całym systemem systemów wokół AI. Zamyka pętlę między wykryciem a działaniem.

Niezawodność AI koncentruje się na tym, czy cały system napędzany przez AI może działać w ramach rozsądnych ograniczeń operacyjnych w czasie, a nie tylko czy model dał dokładną odpowiedź. Jakość, bezpieczeństwo, odporność, wyjaśnialność, zgodność z polityką, efektywność kosztowa i stabilność operacyjna są wszystkie częścią równania.

Przejście od wykrywania do prewencji

Niezawodność AI zmniejsza czas między rozpoznaniem problemu a jego rozwiązaniem. Przenosi rozmowę z “co poszło nie tak?” na “jak szybko nasz AI się poprawi?” Zastosowanie następujących technik przenosi obserwowalność z biernego obserwowania do proaktywnej prewencji:

- Korelowanie sygnałów w modelach, danych i infrastrukturze w celu identyfikacji problemów

- Wczesne wykrywanie problemów przed ich wpływem

- Weryfikacja wszystkich danych wejściowych i wyjściowych w systemach AI prawdopodobieństwa w celu wykrycia subtelnych zmian behawioralnych

- Tworzenie pętli sprzężenia zwrotnego między wykrywaniem niepożądanych wyników w produkcji a używaniem ich do generowania danych dostrajania, które poprawiają dokładność modeli podstawowych

- Śledzenie przepływów pracy wielu agentów w celu zapewnienia możliwości połączenia kropek na temat, dlaczego i jak dane ewoluowały w celu poinformowania złożonych działań

- Zdefiniowane przepływy pracy agentów z udziałem człowieka na potrzeby bezpiecznej odpowiedzi i automatycznej naprawy

Zamknięcie luki między kontrolą a obserwacją

Firmy korzystają z ram, które łączą widoczność i kontrolę, i wymagają więcej niż tylko warstwę obserwowalności na górze generatywnego AI. W systemach deterministycznych i nieokreślonych platforma niezawodności może identyfikować, przewidywać, wyjaśniać i pomagać w kontrolowaniu problemów.

Następujące powinny być uwzględnione w ramach dla niezawodnych operacji AI:

- Zintegrowana telemetria dla systemów IT i AI

- Śledzenie przepływów pracy agentów i zależności systemowych

- Śledzenie zachowania i jakości specyficzne dla AI (wprowadzane dane i oceny)

- Zaawansowane wykrywanie anomalii, niezależnie od źródła

- Przyczynowe rozumowanie i analiza przyczyn

- Alarmy, które automatycznie dostosowują się do Twojego środowiska i nie wymagają ręcznych progów

- Wymuszanie polityki i bariery ochronne

- Ocena ludzka delikatnych lub istotnych działań

- Automatyzacja przepływów pracy i koordynacja naprawy

- Używanie analizy predykcyjnej do zapobiegania problemom

- Pętle sprzężenia zwrotnego, które łączą wykrywanie anomalii z poprawioną jakością modelu AI

Ułatwianie funkcji AI

Systemy AI opierają się na infrastrukturze, usługach, potokach danych i rutynach operacyjnych; nie awaryjnie działają same z siebie. Zespoły mają pełen obraz, gdy łączą się niezawodność AI i IT.

Cienka warstwa LLM nie powinna być podstawą godnego zaufania platformy. Aby zidentyfikować i naprawić problemy, których nie dostrzegają inne narzędzia AI, powinny być brane pod uwagę różne techniki AI, w tym AI nienadzorowane, AI predykcyjne, AI przyczynowe i AI generatywne. Ta kombinacja technik jest powszechnie znana jako “kompozytowy AI”.

AI generatywny jest dobry w podsumowaniu języka naturalnego. Najlepiej nadaje się do sytuacji, w których wymagane jest rozumowanie przez nieustrukturyzowane dane lub interakcje z ludźmi. Ale to nie pasuje do kształtu większości problemów z niezawodnością w produkcji.

AI predykcyjny koncentruje się na identyfikowaniu wczesnych sygnałów przed ich przeobrażeniem się w awarie, złe doświadczenia klientów lub drogie awarie, używając algorytmów wykrywania anomalii.

AI przyczynowy pomaga określić prawdziwe przyczyny, aby ujawnić, czy jakość pobierania, zachowanie modelu, powolność infrastruktury, dryf danych w górę lub awaria systemu w dół była przyczyną spadku wydajności.

AI nienadzorowany samodzielnie odkrywa ukryte wzory, struktury lub anomalie w danych bez ludzkiego kierownictwa. Przewyższa AI generatywny w niezawodności, ponieważ koncentruje się na znajdowaniu ukrytych struktur w złożonych, nieklasyfikowanych danych w celu grupowania podobnych elementów lub znalezienia relacji.

Gdy ryzyko, niepewność lub skutki biznesowe są znaczące, agenci operacyjni AI muszą być w stanie zautomatyzować reakcję, utrzymując przy tym udział ludzi w niezawodnych operacjach.

Model AI może poprawić swoje zrozumienie konkretnego kontekstu biznesowego, używając uczenia wzmocnionego z danych użytkowników w produkcji.

Nawet najbardziej zaawansowane systemy idą dalej niż alarmy; zamknięta naprawa uczy się z każdego incydentu w czasie, automatyzuje rozpoznane reakcje i inicjuje bezpieczne środki.

Przygotowanie do autonomicznych systemów AI

Firmy mogą przygotować się do autonomicznych systemów AI na kilka różnych sposobów. Po pierwsze, agenci powinni być traktowani jako systemy operacyjne, a nie jako narzędzia produktywności. Gdy agent ma możliwość działać, staje się integralną częścią operacji biznesowych i powinien być regulowany odpowiednio.

Zespoły mogą natychmiast rejestrować sygnały z modeli, wprowadzanych danych, narzędzi, przepływów pracy, infrastruktury i wyników użytkowników, instrumentując agenci. To podstawowe nadzorowanie nie powinno być opóźnione do momentu, gdy agenci staną się niezbędni dla firmy.

Ustanowienie standardów niezawodności przed powszechnym wdrożeniem agentów jest również kluczowe. Zamiast być wprowadzonymi po fakcie, dopuszczalne progi dla bezpieczeństwa, opóźnień, wskaźników błędów, ryzyka halucynacji, zgodności z polityką i wpływu biznesowego powinny być wbudowane w ich projekt.

Łączenie zachowania AI z podstawowymi systemami i procedurami, które je wspierają, pozwala firmom łączyć operacje AI i IT. Używanie różnych narzędzi dla infrastruktury i monitorowania modeli tworzy punkty ślepe.

Inżynieria platformy, SRE, zespoły bezpieczeństwa, dane, zespoły AI i właściciele biznesu muszą współpracować, aby zapewnić niezawodne operacje AI, a autonomiczne systemy wykraczają poza konwencjonalne silosy.

Każdy incydent, anomalie i near-miss będą poprawiać system, włączając pętle sprzężenia zwrotnego do operacji, pozwalając firmom ciągle uczyć się z zachowania produkcyjnego.

Wreszcie, kluczowe jest wybranie platform, które są przeznaczone do kontroli, a nie tylko do obserwacji. Firmy skorzystają na systemach, które łączą obserwowalność, predykcję, wyjaśnienie i działanie, gdy agenci AI stają się bardziej autonomiczni. Organizacje, które pomyślnie przechodzą od identyfikowania problemów do bezpiecznego kontrolowania wyników, będą zwycięzcami.

Podsumowanie

AI w firmach jest teraz systemem operacyjnym w środowiskach przedsiębiorstw, a nie narzędziem. W rzeczywistych środowiskach produkcyjnych dodanie niezawodności do systemów AI gwarantuje bezpieczne, spójne, przewidywalne i wydajne operacje.