Sztuczna inteligencja

Wprowadzenie do Vertex AI

Biorąc pod uwagę dynamicznie ewoluujący krajobraz sztucznej inteligencji, jedną z największych przeszkód, których często doświadczają liderzy techniczni, jest przejście od bycia “eksperymentalnym” do bycia “gotowym dla przedsiębiorstw”. Podczas gdy chatboty dla konsumentów i interaktywne platformy pomagają w wyobraźni publicznej, firmy nie mogą odnieść sukcesu tylko dzięki interfejsowi czatu. W erze, w której konkurencja jest bardziej agresywna niż kiedykolwiek wcześniej, firmy potrzebują solidnego, skalowalnego i bezpiecznego ekosystemu, a to właśnie oferuje Google za pomocą Vertex AI, zjednoczonej platformy sztucznej inteligencji i uczenia maszynowego Google Cloud.

Vertex AI próbuje umocnić się jako podstawa integracji sztucznej inteligencji generatywnej z nowoczesną infrastrukturą chmury, oferując kompleksowy zestaw funkcji, który mostkuje lukę między surowymi modelami podstawowymi a aplikacjami gotowymi do produkcji. Vertex AI nie jest po prostu obudową dla dużych modeli językowych (LLM), ale zjednoczonym ekosystemem uczenia maszynowego i sztucznej inteligencji (ML/AI), który traktuje sztuczną inteligencję generatywną jako pierwszorzędne obywatelstwo nowoczesnej infrastruktury chmury.

W sercu Vertex AI znajduje się Ogród Modeli, centralny rynek, który zapewnia dostęp do ponad 200 wyselekcjonowanych modeli podstawowych, w tym potężnego multimodalnego modelu Gemini 2.5 Pro, który posiada imponujące okno kontekstowe o rozmiarze 2 milionów tokenów. W tym artykule rozłożymy na części pierwsze architekturę Vertex AI, zbadać, jak Ogród Modeli służy jako “App Store” dla inteligencji, oraz przyjrzymy się technicznym filarom, które czynią tę platformę podstawą następnej generacji oprogramowania przedsiębiorstw.

Podstawowa Architektura: Zjednoczona Platforma

Vertex AI nie jest luźno połączoną kolekcją narzędzi, ale zjednoczonym ekosystemem danych i sztucznej inteligencji zaprojektowanym w celu przezwyciężenia fragmentacji danych, narzędzi i zespołów, które dotykają uczenia maszynowe do dnia dzisiejszego. Tradycyjnie rozwój sztucznej inteligencji odbywa się w izolowanych środowiskach, a czasem dane są rozproszone i uwięzione w wielu repozytoriach. Na przykład organizacje mogą przechowywać dane klientów w magazynach SQL, podczas gdy nieustrukturyzowane dokumenty są zrzucane do Data Lake. Gdy dane są rozproszone, sztuczna inteligencja widzi tylko “częściową prawdę”, co prowadzi do tendencyjnych wyników lub wysokich wskaźników halucynacji, ponieważ brakuje jej pełnego kontekstu przedsiębiorstwa.

Vertex AI próbuje zintegrować cały cykl życia, od surowego pobierania danych w BigQuery i Cloud Storage do monitorowania produkcji, służąc jako “tkanka łączna” między tymi silosami. Vertex AI integruje się natywnie z Cloud Storage i BigQuery, umożliwiając modelom sztucznej inteligencji pobieranie danych bez skomplikowanych potoków ETL.

Podstawa: AI Hypercomputer Google

Warstwa GenAI w Vertex AI znajduje się na szczycie architektury AI Hypercomputer Google, zintegrowanego systemu superkomputerowego, który składa się z:

TPU v5p & v5e (Tensor Processing Units)

Tensor Processing Units Google to specjalnie zaprojektowane układy ASIC (Application-Specific Integrated Circuits) przeznaczone specjalnie do mnożenia macierzy, które definiuje głębokie uczenie.

- TPU v5p (Wydajność): To jest flagowy przyspieszacz dla ogromnej skali szkolenia. Każdy węzeł TPU v5p może skalować się do 8,960 chipów połączonych przez najwyższy pasmo Inter-Chip Interconnect (ICI) na poziomie 4,800 Gbps. Dla lidera technicznego oznacza to 2,8-krotnie szybsze szkolenie dla modelu o rozmiarze GPT-3 (175B parametrów) w porównaniu z poprzednią generacją, co dramatycznie redukuje czas wprowadzenia na rynek.

- TPU v5e (Wydajność): Zaprojektowany z myślą o “optymalizacji kosztów”, v5e jest pracoholikiem dla średniej skali szkolenia i wysokiej wydajności inferencji. Oferuje do 2,5-krotnie lepszą cenę za wydajność, co czyni go idealnym wyborem dla firm, które muszą uruchamiać inferencję 24/7 bez ogromnego budżetu.

NVIDIA H100/A100 GPU dla elastyczności

Podczas gdy TPU są specjalistyczne, wiele zespołów developerskich polega na ekosystemie NVIDIA CUDA. Vertex AI zapewnia pierwszorzędne wsparcie dla najnowszego sprzętu NVIDIA:

- NVIDIA H100 (Hopper): Idealny do dokształcania największych modeli open-source (jak Llama 3.1 405B), które wymagają ogromnej przepustowości pamięci.

- Jupiter Networking: Aby zapobiec “wąskiemu gardłu sieci”, Google używa swojej sieci Jupiter data center fabric. Zapewnia to, że dane poruszają się między GPU z prędkością błyskawicy, obsługując RDMA (Remote Direct Memory Access), aby ominąć overhead CPU i dostarczyć niemal lokalową wydajność w węzłach rozproszonych.

Dynamiczna Orkiestracja

Najważniejsza techniczna zmiana w Vertex AI to Dynamiczna Orkiestracja. W środowisku legacy, jeśli węzeł GPU ulega awarii podczas 3-tygodniowego uruchomienia szkolenia, całe zadanie może ulec awarii.

- Automatyczna wytrzymałość: Vertex AI, często napędzany przez Google Kubernetes Engine (GKE) pod spodem, posiada “samouzdrawiające się” węzły. Jeśli wykryty zostanie błąd sprzętowy, platforma automatycznie przenosi obciążenie na zdrowy węzeł.

- Dynamiczny planista obciążeń: Narzędzie to pozwala zespołom na żądanie pojemności na podstawie pilności. Można wybrać Flex Start (tańszy, rozpoczyna się, gdy jest dostępna pojemność) lub Gwarantowaną Pojemność dla misji krytycznych.

- Bezserwerowe szkolenie: Dla zespołów, które chcą zerowej administracji infrastruktury, Vertex AI Serverless Training pozwala na przesłanie kodu i danych; platforma zapewnia klaster, uruchamia zadanie i rozmontowuje go, naliczając opłaty tylko za sekundy obliczeniowe użyte.

Trzy punkty wejścia: Odkrycie, Eksperymentowanie i Automatyzacja

Aby uwzględnić różne techniczne osoby – od naukowców danych po developerów aplikacji – Vertex AI zapewnia trzy podstawowe punkty wejścia:

- Ogród Modeli: Rynek dla Odkrycia.

- Vertex AI Studio: Place zabaw dla Eksperymentowania.

- Vertex AI Agent Builder: Fabryka dla Automatyzacji.

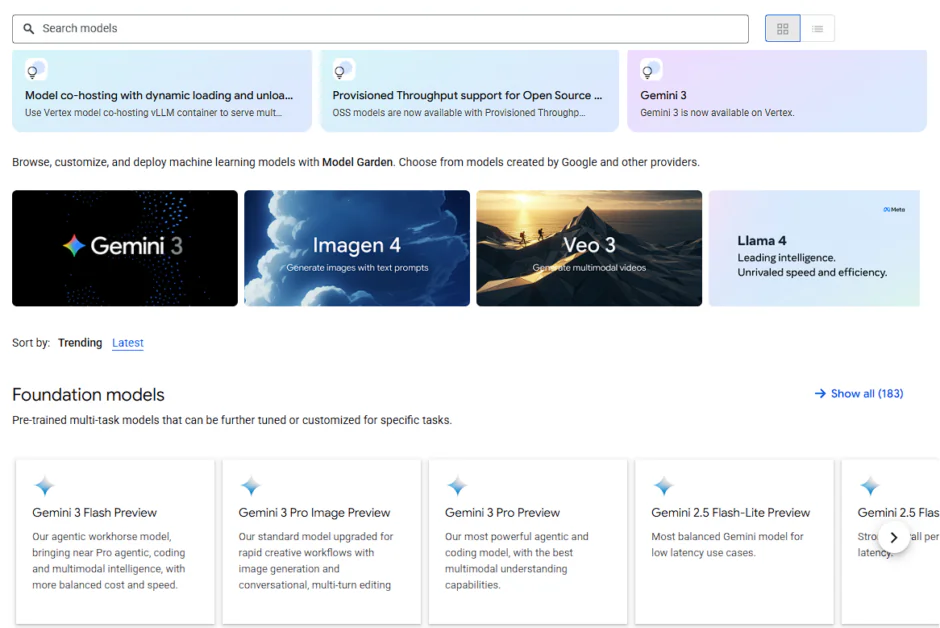

Ogród Modeli: Rynek dla Odkrycia

Ogród Modeli Google Cloud Vertex AI to scentralizowana platforma w ramach Google Cloud do odkrywania, testowania, personalizowania i wdrażania szerokiej gamy modeli sztucznej inteligencji pierwszej, otwartej i trzeciej strony, w tym multimodalnych (wizji, tekstu, kodu) dla różnych potrzeb biznesowych, oferując bezproblemową integrację z narzędziami Vertex AI dla uproszczonego MLOps. Działa jako kompleksowa biblioteka, pomagając developerom i firmom wybrać odpowiedni model (od dużych modeli podstawowych do specjalistycznych) do ich zadań, niezależnie od tego, czy jest to generowanie tekstu, analiza obrazu czy uzupełnianie kodu, i wdrożyć je wydajnie w ramach ich środowiska Google Cloud.

Ogród Modeli kategoryzuje swoje 200+ modeli na trzy odrębne poziomy, pozwalając architektom na balansowanie wydajności, kosztów i kontroli:

- Pierwszorzędne (Google) Modele: Są to flagowe multimodalne modele dostępne w ramach Vertex AI, a Google oferuje je w różnych rozmiarach, od Pro z złożonym rozumowaniem po Flash z niską latencją i dużą objętością, umożliwiając developerom optymalizację modeli zgodnie z ich przypadkami użycia.

- Trzeciorzędne (Własne) Modele: Poprzez strategiczne partnerstwa, Vertex AI oferuje “Model-as-a-Service” (MaaS) dostęp do gigantów takich jak Anthropic (Claude 3.5) i Mistral AI. Zamiast zarządzać oddzielnymi fakturami i poświadczeniami zabezpieczeń dla pięciu różnych dostawców AI, zespół techniczny może uzyskać do nich dostęp za pośrednictwem swojego istniejącego projektu Google Cloud, używając zjednoczonego formatu API.

- Modele Open-Source & Open-Weight: Ten poziom obejmuje Meta’s Llama 3.2, Mistral, oraz własny Gemma Google. Są one idealne dla organizacji, które chcą samodzielnie wdrożyć modele w ramach własnej VPC (Virtual Private Cloud), aby zapewnić maksymalną izolację danych.

W niezjednoczonym środowisku wdrożenie modelu open-source, takiego jak Llama, wymaga ustawienia środowiska PyTorch, konfigurowania sterowników CUDA i zarządzania otoczką Flask lub FastAPI.

Ogród Modeli eliminuje tę “fazę mungowania” za pomocą Zjednoczonych Zarządzanych Punktów Końcowych:

- Jedno-kliknięcie wdrożenia: Dla wielu modeli kliknięcie “Wdrożyć” automatycznie przydziela niezbędne zasoby TPU/GPU, owija model w kontener gotowy do produkcji i zapewnia punkt końcowy REST API.

- Integracja z Hugging Face: Vertex AI pozwala teraz developerom wdrożyć modele bezpośrednio z Hugging Face Hub do punktu końcowego Vertex, zapewniając niemal nieskończoną ekspansję dostępnej inteligencji.

- Private Service Connect (PSC): Dla wysoko regulowanych branż, modele mogą być wdrożone przy użyciu Private Service Connect, zapewniając, że punkt końcowy modelu nie jest nigdy narażony na publiczny Internet – utrzymując ruch danych ściśle w ramach sieci korporacyjnej.

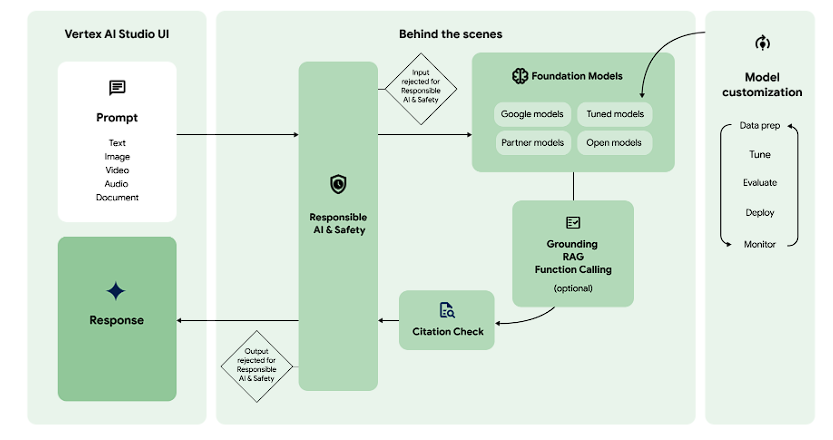

Vertex AI Studio: Place zabaw dla Eksperymentowania

Podczas gdy Ogród Modeli dotyczy wyboru, Vertex AI Studio dotyczy dokładności. Vertex AI Studio można porównać do kompilatorów i debuggerów, które spotyka się w tradycyjnym świecie oprogramowania. Vertex AI Studio to przestrzeń robocza, w której surowe modele są rzeźbione w konkretnych narzędziach biznesowych za pomocą kombinacji inżynierii promtu, testowania multimodalnego i zaawansowanego dostrajania hiperparametrów.

Prototypowanie Multimodalne: Poza Tekstem

Jedną z wyróżniających się funkcji Studia jest jego natywne wsparcie dla multimodalności. Podczas gdy inne platformy wymagają złożonego kodowania do obsługi nie-tekstowych danych, Vertex AI Studio pozwala na bezpośrednie upuszczanie plików do interfejsu w celu przetestowania Gemini 2.5 zdolności rozumowania.

- Inteligencja wideo: Można przesłać 45-minutowe techniczne wystąpienie i poprosić model o “zidentyfikowanie każdego przypadku, w którym odnosi się do określonego API i dostarczenie podsumowania z timestampem.”

- Analiza dokumentów: Zamiast po prostu czytać tekst, model może analizować układ wizualny 1000-stronicowego dokumentu PDF, rozumiejąc relację między wykresami, tabelami i otaczającym tekstem.

- Wykonanie kodu: Studio obsługuje teraz wykonanie kodu w place zabaw. Jeśli poprosisz model o rozwiązanie skomplikowanego problemu matematycznego lub analizę pliku CSV, model może napisać i wykonać kod Python w bezpiecznym, odizolowanym środowisku, aby dostarczyć zweryfikowaną odpowiedź.

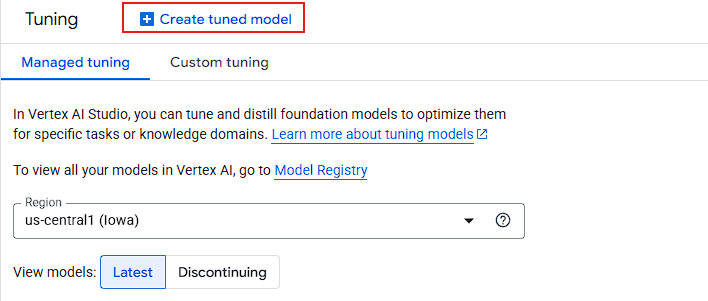

Zaawansowana personalizacja: Ścieżka dostrajania

Gdy inżynieria promtu (Zero-shot lub Few-shot) osiąga pułap, Vertex AI Studio zapewnia ciężką artylerię: Dostrajanie modelu.

- Dostrajanie w nadzorze (SFT): Deweloperzy dostarczają zestaw danych par “Promtu/Odpowiedzi” (idealnie 100+ przykładów). To uczy model, aby przyjąć określony głos marki, format wyjścia (jak specjalistyczny JSON) lub dziedzinowy slangu.

- Buforowanie kontekstu: Dla przedsiębiorstw zajmujących się ogromnymi, statycznymi zestawami danych (jak biblioteka prawnicza lub kod), Studio pozwala na buforowanie kontekstu. To pozwala “wstępnie załadować” milion tokenów danych do pamięci modelu, co znacznie redukuje opóźnienia i koszty dla kolejnych zapytań.

- Destylacja (Nauczyciel-Uczeń): To jest wysoki poziom architektoniczny. Można użyć ogromnego modelu (Gemini 2.5 Pro), aby “nauczyć” mniejszy, szybszy model (Gemini 2.0 Flash). Wynikiem jest model lekki, który działa na poziomie “Pro”, ale działa z prędkością i kosztem “Flash”.

Vertex AI Agent Builder: Fabryka dla Automatyzacji

Vertex AI Agent Builder to wysokopoziomowy framework orkiestracji, który pozwala developerom tworzyć te agenty, łącząc modele podstawowe z danymi przedsiębiorstwa i zewnętrznymi API.

Architektura “Prawdy”: Ugruntowanie i RAG

Główna techniczna bariery dla przedsiębiorstw AI to halucynacja. Agent Builder rozwiązuje to za pomocą zaawansowanego silnika ugruntowania.

- Ugruntowanie z Google Search: Dla zapytań wymagających aktualnej wiedzy świata (np. “Jaki jest obecny poziom stóp hipotecznych w Nowym Jorku?”), agent może przeprowadzić wyszukiwanie Google, wyodrębnić fakty i podać źródła.

- Vertex AI Search (RAG-as-a-Service): Zamiast ręcznego budowania bazy danych wektorowej (Pinecone, Weaviate), deweloperzy mogą użyć Vertex AI Search, aby zindeksować swoje własne dokumenty (PDF, HTML, BigQuery). Automatycznie obsługuje “chunking”, “embedding” i “retrieval”, zapewniając, że agent odpowiada tylko na podstawie własnego “Źródła Prawdy”.

- Vertex AI RAG Engine: Dla wyspecjalizowanych wdrożeń, usługa zarządzana ta pozwala na hybrydowe wyszukiwanie (łącząc wyniki oparte na wektorach i słowach kluczowych), aby poprawić dokładność o 30% w porównaniu z standardowymi wyjściami LLM.

Orkiestracja wielu agentów (A2A Protocol)

Zaawansowane przepływy pracy przedsiębiorstw często wymagają wielu wyspecjalizowanych agentów pracujących razem. Vertex AI wprowadza Agent-to-Agent (A2A) Protocol, otwarty standard, który pozwala:

- “Agent podróży” może rozmawiać z “Agentem finansowym”, aby upewnić się, że rezerwacja lotu jest w ramach budżetu korporacyjnego.

- Współpraca: Ponieważ używa otwartego protokołu, agenci zbudowani na Vertex mogą komunikować się z tymi zbudowanymi na innych frameworkach, takich jak LangChain lub CrewAI.

Stos deweloperski: ADK i Agent Engine

Dla “platformy technicznej” Agent Builder oferuje dwie odrębne ścieżki:

- Konsola bez kodu: Wizualny interfejs przeciągnij-i-upuść dla szybkiego prototypowania i konfiguracji użytkownika biznesowego.

- Agent Development Kit (ADK): Kodowy zestaw narzędzi dla inżynierów. Pozwala na “Promtu jako Kod”, integrację z kontrolą wersji i możliwość wdrożenia do Vertex AI Agent Engine— zarządzanego środowiska uruchomieniowego, które automatycznie obsługuje trwałość sesji, skalowanie i zarządzanie stanem.

Podsumowanie: Od “Co, jeśli” do “Co dalej”

Przejście od efektownej demonstracji AI do aplikacji przedsiębiorstwa gotowej do produkcji długo było “doliną śmierci” dla projektów transformacji cyfrowej. Jak już zbadaliśmy, Vertex AI jest zaprojektowany specjalnie, aby przezwyciężyć tę lukę. Poprzez zjednoczenie fragmentowanych silosów danych, infrastruktury i orkiestracji modeli, Google Cloud przeniósł dyskusję od surowej mocy dużych modeli językowych w kierunku dojrzałości operacyjnej cyklu życia sztucznej inteligencji.