Interfejs mózg–maszyna

Przełom w dziedzinie sztucznej inteligencji poprawia interfejsy mózg-komputer poprzez dekodowanie złożonych sygnałów mózgowych

Naukowcy z Chiba University w Japonii opracowali nową ramę sztucznej inteligencji, która jest w stanie dekodować złożoną aktywność mózgu z znacznie poprawioną dokładnością, co stanowi ważny krok w kierunku bardziej niezawodnych interfejsów mózg-komputer (BCI). Przełom ten może przyspieszyć rozwój technologii asystujących, które pozwalają ludziom z zaburzeniami neurologicznymi kontrolować urządzenia, takie jak protezy, wózki inwalidzkie i roboty rehabilitacyjne, za pomocą swoich myśli.

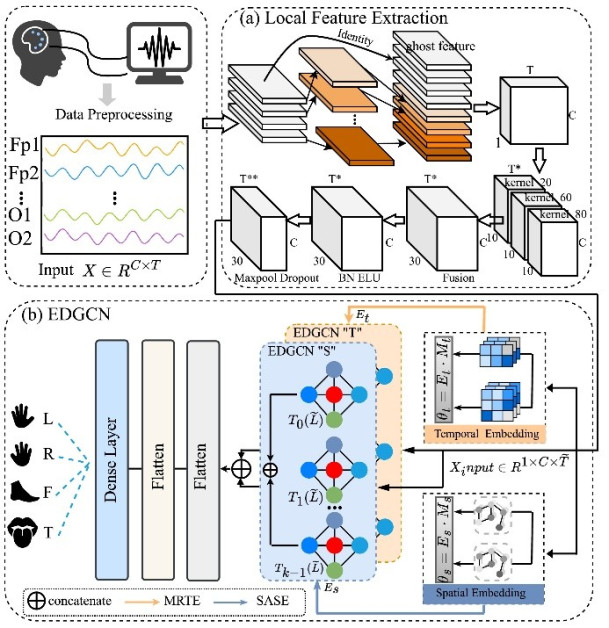

Badania, prowadzone przez studenta doktoranckiego Chaowena Shena i profesora Akio Namiki na Wydziale Inżynierii Uniwersytetu w Chiba, wprowadzają nową architekturę głębokiego uczenia się, znaną jako Embedding-Driven Graph Convolutional Network (EDGCN). System ten jest zaprojektowany do interpretacji złożonych sygnałów elektrycznych generowanych w mózgu, gdy osoba wyobraża sobie ruchy kończyn – proces znany jako wyobrażona motoryka.

Interfejsy mózg-komputer i wyobrażona motoryka

Interfejsy mózg-komputer mają na celu utworzenie kanału komunikacji między ludzkim mózgiem a zewnętrznymi maszynami. Zamiast polegać na ruchu mięśni, BCI interpretują sygnały neuronalne i konwertują je w polecenia dla systemów cyfrowych lub urządzeń fizycznych.

Jednym z najbardziej rozpowszechnionych podejść w badaniach nad BCI jest elektroencefalografia wyobrażonej motoryki (MI-EEG). W tych systemach użytkownicy wyobrażają sobie wykonanie ruchów – takich jak podniesienie ręki, chwycenie obiektu lub chodzenie. Nawet jeśli nie występuje żaden ruch fizyczny, mózg generuje charakterystyczne wzory aktywności elektrycznej związanej z wyobrażonym ruchem.

Sygnały te można przechwytywać za pomocą elektroencefalografii (EEG), nieinwazyjnej techniki, która rejestruje aktywność mózgu za pomocą elektrod umieszczonych na skórze głowy. EEG dostarcza wielokanałowych danych czasowych, reprezentujących aktywność neuronalną w różnych regionach mózgu.

Dokładne dekodowanie tych sygnałów pozwala komputerom tłumaczyć aktywność neuronalną na polecenia wykonalne. W praktyce mogłoby to umożliwić osobom z paraliżem lub ciężkim upośledzeniem ruchowym kontrolowanie technologii asystujących, po prostu wyobrażając sobie ruchy.

Jednak osiągnięcie niezawodnego dekodowania sygnałów MI-EEG pozostaje jednym z najtrudniejszych wyzwań w neurotechnologii.

Dlaczego sygnały mózgowe są trudne do dekodowania

Główną przeszkodą w rozwoju interfejsów mózg-komputer jest wrodzona złożoność sygnałów EEG.

Sygnały wyobrażonej motoryki wykazują wysoką zmienność przestrzenną i czasową, co oznacza, że różnią się zarówno w różnych regionach mózgu, jak i w czasie. Różnią się również znacznie między osobami i nawet w tej samej osobie między sesjami.

Tradycyjne modele uczenia maszynowego często mają trudności z tymi zmianami. Wiele istniejących systemów opiera się na predefiniowanych strukturach grafu lub parametrach stałych, które zakładają, że sygnały mózgowe zachowują się w sposób ciągły. W rzeczywistości sygnały neuronalne są o wiele bardziej dynamiczne i heterogeniczne.

Poprzednie metody często wykorzystywały techniki, takie jak analiza wspólnych wzorów przestrzennych lub konwolucyjne sieci neuronowe, do wyodrębniania cech z sygnałów EEG. Chociaż te podejścia mogą identyfikować niektóre wzory w aktywności neuronalnej, często nie są w stanie uchwycić głębszych interakcji między regionami mózgu lub ewoluujących wzorów w czasie.

W rezultacie wiele systemów BCI wymaga obszernego kalibrowania i szkolenia, zanim będą mogły funkcjonować skutecznie dla poszczególnych użytkowników.

Nowe podejście: Embedding-Driven Graph Convolutional Networks

Zespół badawczy z Uniwersytetu w Chiba rozwiązał te wyzwania, opracowując nową ramę głębokiego uczenia się, zaprojektowaną do lepszego uchwycenia złożoności aktywności mózgu.

Ich rozwiązanie – Embedding-Driven Graph Convolutional Network (EDGCN) – łączy kilka zaawansowanych technik, aby jednocześnie modelować strukturę przestrzenną i czasową sygnałów EEG.

W centrum ramy znajduje się mechanizm fuzji oparty na osadzaniu, który pozwala systemowi dynamicznie generować parametry używane do dekodowania sygnałów mózgowych. Zamiast polegać na stałych architekturach, EDGCN dostosowuje swoją wewnętrzną reprezentację, aby lepiej uchwycić zmienność między podmiotami i w czasie.

Architektura integruje wiele specjalistycznych komponentów:

Wieloskalowa reprezentacja czasowa (MRTE)

Ten moduł analizuje sygnały EEG w różnych skalach czasowych. Ponieważ sygnały neuronalne ewoluują szybko, ważne informacje mogą wystąpić w różnych rozdzielczościach czasowych. MRTE wyodrębnia cechy z wieloskalowych wzorów widmowych, umożliwiając systemowi identyfikację znaczącej aktywności neuronalnej, która mogłaby być pominięta w przeciwnym razie.

Przestrzenna reprezentacja świadoma struktury (SASE)

Sygnały mózgowe nie są izolowane; różne regiony mózgu interaktywnie oddziałują ze sobą. Mechanizm SASE modeluje te interakcje, włączając zarówno lokalne, jak i globalne struktury połączeń między elektrodami EEG. Pozwala to na reprezentowanie mózgu jako sieci, a nie jako niezależnych kanałów sygnałowych.

Generowanie parametrów świadomych heterogeniczności

Jednym z najbardziej innowacyjnych aspektów ramy EDGCN jest jej zdolność do dynamicznego generowania parametrów grafu konwolucyjnego z banku parametrów opartego na osadzaniu. Pozwala to modelowi dostosować się do unikalnych cech sygnałów mózgowych każdego podmiotu.

Aby wesprzeć ten proces, naukowcy wykorzystali konwolucyjną sieć neuronową Chebysheva, technikę, która efektywnie modeluje relacje w ramach złożonych sieci.

Jądra ortogonalne

Aby dalej poprawić wytrzymałość, model wprowadza ograniczenia ortogonalności w swoich jądrach konwolucyjnych. Zachęca to do różnorodności w nauczanych cechach i redukuje redundancję, pomagając systemowi wyodrębnić bogatsze reprezentacje sygnałów EEG.

Wszystkie te komponenty pozwalają EDGCN uchwycić zarówno lokalne wzory aktywności neuronalnej, jak i wielkoskalowe interakcje między regionami mózgu, co skutkuje bardziej dokładnym dekodowaniem sygnałów wyobrażonej motoryki.

Wyniki

Naukowcy przetestowali EDGCN, wykorzystując powszechnie stosowane zestawy danych z BCI Competition IV, które są standardowymi zestawami danych oceny w dziedzinie badań nad interfejsami mózg-komputer.

Model osiągnął:

- 90,14% dokładności klasyfikacji w zestawie danych BCIC-IV-2b

- 86,50% dokładności klasyfikacji w zestawie danych BCIC-IV-2a

Te wyniki przewyższają kilka istniejących metod dekodowania i demonstrują silną generalizację w różnych podmiotach.

Co ważne, system wykazał również poprawioną adaptacyjność przy zastosowaniu w scenariuszach międzypodmiotowych, co jest kluczowym wymogiem dla praktycznego wdrożenia BCI. Wiele istniejących modeli działa dobrze dla pojedynczego użytkownika przeszkolonego, ale zawodzi, gdy stosowane są do nowych osób. Architektura EDGCN oparta na osadzaniu pomaga przezwyciężyć tę ograniczenie, lepiej modelując indywidualną zmienność.

Implikacje dla rehabilitacji i technologii asystujących

Możliwość dekodowania sygnałów mózgowych z większą dokładnością może mieć głębokie implikacje dla technologii asystujących.

Interfejsy mózg-komputer oparte na wyobrażonej motoryce są już badane w aplikacjach, takich jak:

- Wózek inwalidzki sterowany myślami

- Protezy neuronalne

- Urządzenia rehabilitacyjne

- Systemy komunikacji dla pacjentów z paraliżem

Poprawiona dokładność dekodowania mogłaby uczynić te technologie znacznie bardziej niezawodnymi i łatwiejszymi w użyciu.

Naukowcy uważają, że systemy takie jak EDGCN mogą pomóc pacjentom z takimi schorzeniami, jak:

- Udar

- Urazy rdzenia kręgowego

- Stwardnienie zanikowe boczne (ALS)

- Pozostałe zaburzenia neuro-mięśniowe

Z bardziej niezawodną interpretacją sygnałów, pacjenci mogliby potencjalnie kontrolować urządzenia neurorehabilitacyjne za pomocą prostych ruchów wyobrażonych, umożliwiając bardziej naturalną interakcję z systemami asystującymi.

Według profesora Namiki, dekodowanie sygnałów wyobrażonej motoryki nie jest tylko wyzwaniem technologicznym, ale także okazją do lepszego zrozumienia, jak mózg organizuje ruch i połączenia neuronalne.

Ku interfejsom mózg-komputer dla konsumentów

Pomimo dziesięcioleci badań, większość systemów interfejsu mózg-komputer pozostaje ograniczona do laboratoriów lub specjalistycznych środowisk klinicznych. Niezawodność, adaptacyjność i łatwość użycia pozostają znaczącymi barierami dla szerszego zastosowania.

Postępy, takie jak EDGCN, mogą pomóc interfejsom mózg-komputer przesunąć się bliżej technologii neuro dla konsumentów.

Poprzez poprawę zdolności systemu do radzenia sobie z heterogenicznymi sygnałami mózgowymi, model redukuje potrzebę obszernego kalibrowania i ekspertowego dostosowania. Jest to kluczowy krok w kierunku uczynienia systemów BCI użytecznymi poza środowiskami badawczymi.

Przyszłe badania będą prawdopodobnie skupione na integracji takich modeli AI z przenośnymi systemami EEG i urządzeniami noszonymi. W połączeniu z postępami w technologii czujników i mocy obliczeniowej, te systemy mogą umożliwić bardziej dostępne i skalowalne interfejsy mózg-maszyna.

Krok ku głębszej integracji człowieka i maszyny

Rozwój EDGCN odzwierciedla szerszy trend w sztucznej inteligencji i neuronaukach: coraz częstsze wykorzystywanie sieci neuronowych grafowych do modelowania systemów biologicznych.

Ponieważ sam mózg działa jako złożona sieć połączonych regionów, sieci neuronowe grafowe zapewniają naturalny sposób reprezentowania jego struktury i dynamiki. Im te modele AI stają się bardziej zaawansowane, mogą odblokować głębsze spojrzenia na aktywność neuronalną i poznawczą.

Ostatecznie, poprawiona dekodowania sygnałów mózgowych może otworzyć drogę do nowej generacji technologii, które umożliwiają ludziom interakcję z maszynami w sposób bardziej bezpośredni niż kiedykolwiek wcześniej.

Jeśli postęp będzie kontynuowany w obecnym tempie, interfejsy mózg-komputer mogą wkrótce przejść z eksperymentalnych narzędzi badawczych do codziennych technologii asystujących, które będą w stanie przywrócić niezależność i mobilność milionom ludzi na całym świecie.