Kąt Andersona

Energooszczędne monitorowanie AI w klimacie lat 70.

Nowe badania pokazują, że większość wideo AI w ogóle nie potrzebuje koloru, włączając go tylko w kluczowych momentach i zmniejszając zużycie danych o ponad 90% przy niewielkiej utracie dokładności.

Zdalne kamery strumieniujące i inne bezprzewodowe, zasilane bateryjnie urządzenia wideo wymagają bardzo zoptymalizowanych konfiguracji monitorowania, ponieważ mogą polegać na niestabilnych źródłach zasilania – takich jak energia słoneczna – lub wymagać okresowego ładowania, czy innych form interwencji człowieka, w sytuacjach, w których idealnie nikt nie powinien być obecny.

Równolegle z tą linią badań, wzrosło również zainteresowanie noszonymi urządzeniami z kamerami (nawet jeśli takie urządzenia były już mocno ograniczone przez zasilanie i moc obliczeniową), ponieważ edge AI obiecuje teraz uczynić je znacznie bardziej użytecznymi.

Poza tymi rozważaniami, długoterminowa chęć redukcji kosztów edge AI i monitorowania (szczególnie w przypadkach, gdy oszczędności te nie muszą być przenoszone na klienta) stanowi przekonujący argument za innowacjami w podejściach do oszczędzania energii dla przypadków użycia na ‘krawędzi’.

Wyłącz dźwięk

W dziedzinie strumieniowego przetwarzania wideo, urządzenia monitorujące na krawędzi pozbawione zasobów muszą zużywać jak najmniej energii, jednocześnie wydając jej wystarczająco dużo, aby monitorować pod kątem ‘interesujących’ zdarzeń – w którym to momencie warto będzie wydać więcej zasobów.

W efekcie jest to podobny przypadek użycia jak w przypadku oświetlenia uruchamianego ruchem, które zapewnia światło tylko wtedy, gdy czujniki o niskim poborze mocy stwierdzą, że jest ktoś, kto może je docenić.

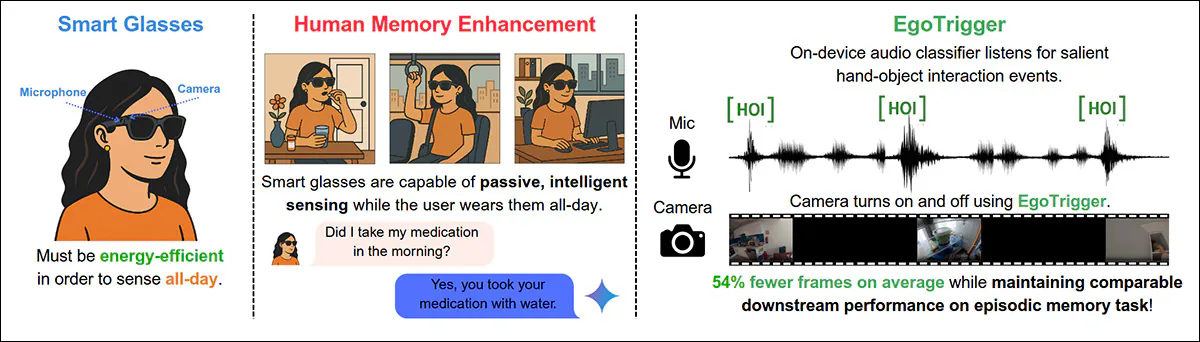

Ponieważ monitorowanie i kompresja audio są zauważalnie mniej zasobożerne niż wideo, kilka podejść w ostatnich latach próbowało używać wskazówek opartych na dźwięku, aby ‘włączyć’ uwagę w systemach o ograniczonych zasobach; frameworki takie jak Listen to Look i Egotrigger:

W systemie Egotrigger, wyzwalanie oparte na audio selektywnie aktywuje przechwytywanie obrazu na podstawie wskazówek z interakcji ręka-obiekt, redukując nadmiarowe klatki przy zachowaniu wydajności pamięci epizodycznej w systemach inteligentnych okularów o ograniczonych zasobach. Source

Oczywiście dźwięk nie jest idealnym medium do wyszukiwania zdarzeń wizualnych, ponieważ wiele istotnych takich zdarzeń może nie mieć powiązanego sygnału audio lub może występować poza zasięgiem mikrofonów na krawędzi.

Lekki śpioch

Jak sugeruje nowy artykuł, lepsze może być strumienie wideo, które może współpracować z AI, aby zwiększać zasoby zaraz po wystąpieniu obserwowanego zdarzenia. Poniższa symulacja* daje ogólne pojęcie o koncepcji – monitorowanie w niskiej rozdzielczości jest utrzymywane na minimalnym, niezbędnym poziomie sygnału, aby frameworki wykrywania obiektów mogły działać i poinformować system o zwiększeniu rozdzielczości z powodu wyzwolenia zdarzenia:

Symulacja pożądanego zachowania – że strumieniowanie i analiza działają domyślnie na najniższym poziomie zużycia zasobów; wystarczająco, aby wyzwolić większe zużycie zasobów, gdy w strumieniu w skali szarości zostaną wykryte ‘interesujące’ lub poszukiwane zdarzenia. Czarno-biały styl nadzoru może być dość ‘retro’, ale może być zapowiedzią tego, co nadejdzie. Ten film został stworzony przez autora wyłącznie w celach ilustracyjnych w odniesieniu do głównych idei nowego artykułu. Source:

Nowa praca, będąca współpracą akademicką różnych instytucji z Wielkiej Brytanii i Huawei, proponuje bezuczeniowy, wspomagany przez AI schemat zawsze w skali szarości, kolor na żądanie dla monitorowania na krawędzi – zaprojektowany do pracy przy niskim użyciu tokenów, gdy nie mają miejsca ‘kluczowe zdarzenia’, i do zwiększania zużycia tylko na czas trwania zdarzenia.

W testach porównawczych zrozumienia strumieniowego wideo, nowy system, nazwany ColorTrigger, był w stanie osiągnąć 91,6% wydajności bazowej w pełnym kolorze, używając tylko 8,1% klatek RGB w tych standardach:

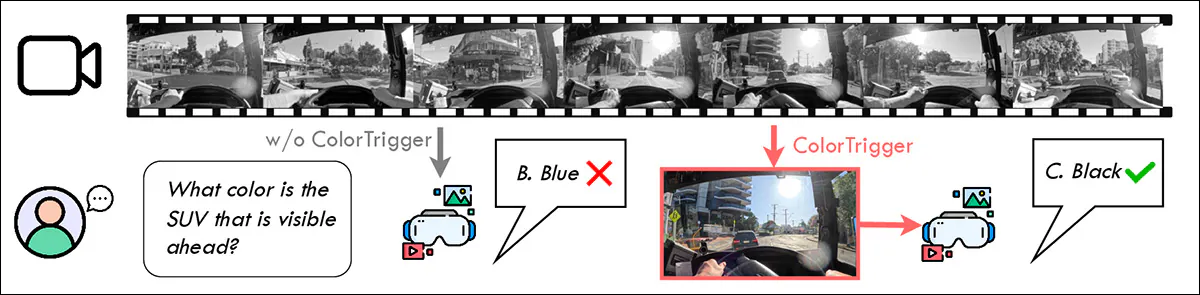

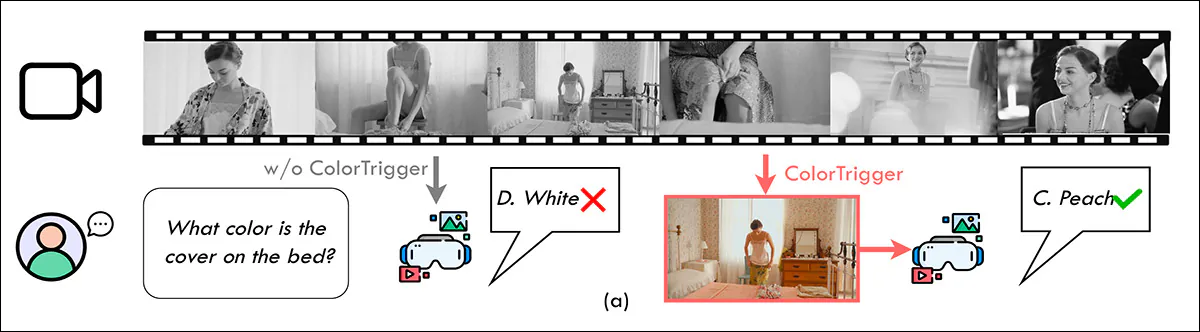

Gdy model widzi tylko wideo w skali szarości, myli kluczowe szczegóły i daje błędne odpowiedzi; ale wyzwolenie koloru we właściwych momentach rozjaśnia obraz i naprawia błędy wywołane zadaniami zależnymi od koloru. Source

Nowy artykuł nosi tytuł Color When It Counts: Grayscale-Guided Online Triggering for Always-On Streaming Video Sensing i pochodzi od ośmiu badaczy z Queen Mary University of London, Durham University, Imperial College London oraz Huawei Noah’s Ark Lab. Artykuł ma również stronę projektu.

Metoda

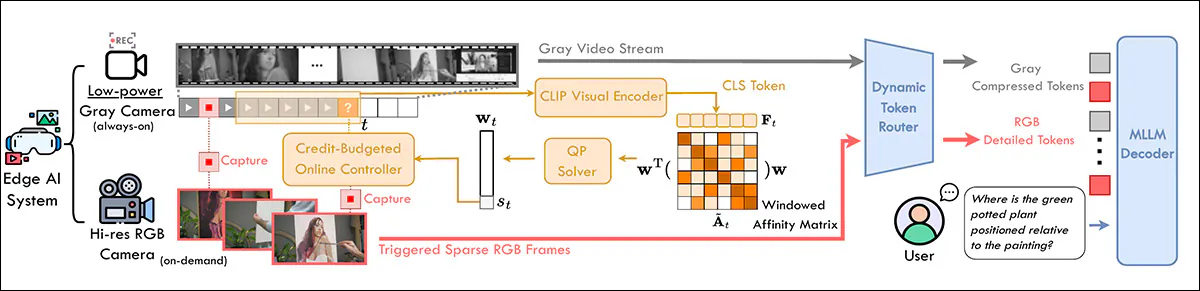

Aby zachować strukturę czasową w nowym systemie, ColorTrigger utrzymuje stały nadzór w skali szarości o niskiej przepustowości. Przyczynowy wyzwalacz online analizuje okno przesuwne (tj. elastyczny zakres klatek plus-minus wokół konkretnego czasu, takiego jak wykrycie wyzwalacza zdarzenia) strumienia o niskiej rozdzielczości:

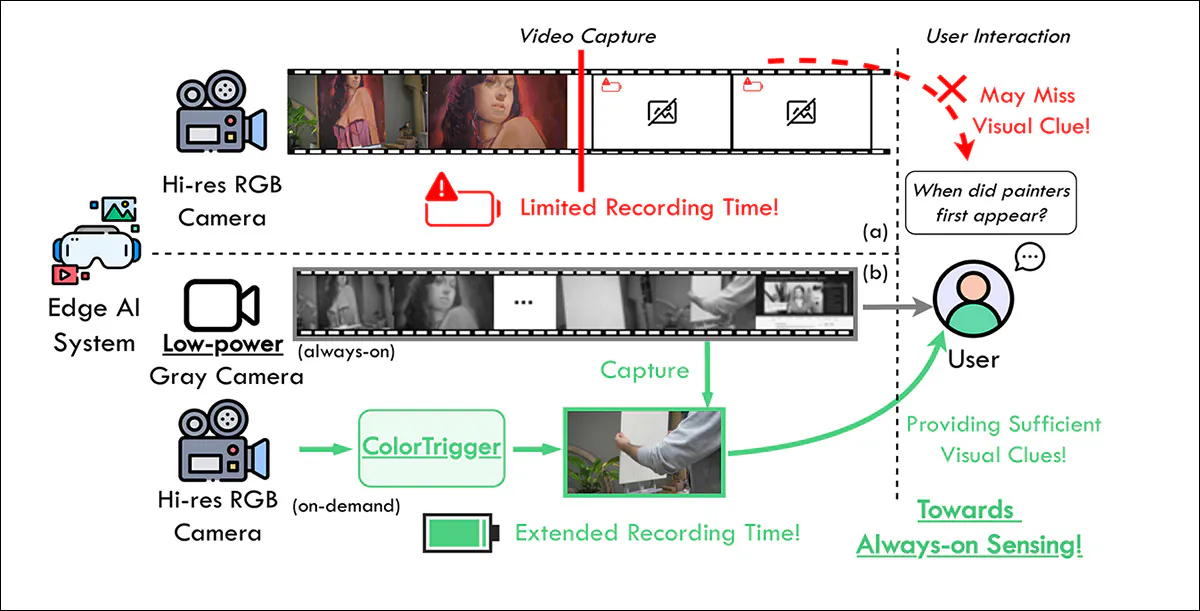

Ciągłe przechwytywanie RGB w wysokiej rozdzielczości szybko wyczerpuje moc, więc nagrywanie wcześnie się kończy i kluczowe momenty mogą zostać pominięte. Odwrotnie, ColorTrigger utrzymuje działający cały czas strumień w skali szarości o niskim poborze mocy i aktywuje kamerę RGB tylko w wybranych momentach – wydłużając czas nagrywania, jednocześnie przechwytując wizualne szczegóły potrzebne do odpowiedzi na późniejsze zapytania. Source

Gdy system jest w trybie ‘pasywnym’ (tj. nie zidentyfikował jeszcze zdarzenia wyzwalającego), jego dynamiczny router tokenów przydziela ograniczoną pojemność asymetrycznemu dekoderowi, cały czas szukając redundancji i zdarzeń wskazujących na nowość, w którym to momencie przepływ tokenów ponownie priorytetyzuje pojemność nad kompresją:

Schemat ColorTrigger. System monitoruje analizę przesuwnego okna ostatnich klatek, aby wykryć redundancję i zmianę, wyzwalając przechwytywanie RGB w wysokiej rozdzielczości tylko w razie potrzeby, w ramach budżetu opartego na kredytach. Dynamiczny router tokenów przydziela mniej tokenów wejściom w skali szarości, a więcej wybranym klatkom RGB, zachowując porządek czasowy dla późniejszego przetwarzania przez Wielojęzykowy Model Wielkogabarytowy (MLLM).

Na podstawie klatka po klatce, system musi zdecydować, czy obecna chwila zawiera nowe informacje warte kosztu przechwycenia koloru. Krótka, niedawna historia klatek w skali szarości w oknie przesuwnym pozwala ColorTrigger porównać bieżącą klatkę z jej bezpośrednio poprzedzającymi. Każda klatka jest konwertowana na zwartą reprezentację cech, a te cechy są porównywane ze sobą, aby zmierzyć, jak podobne lub różne są ich klatki źródłowe.

Ten proces porównania jest zorganizowany w strukturę, która podsumowuje jak bardzo każda klatka nakłada się na inne, skutecznie wychwytując, czy scena się powtarza, czy zmienia. Lekki krok optymalizacji przypisuje wynik ważności każdej klatce w oknie, faworyzując nowość.

Balans kolorów

Aby zapobiec nadmiernemu użyciu koloru, prosty ‘system kredytowy’ ogranicza, jak często kolor może być wyzwalany w czasie. Kredyty gromadzą się stopniowo i są wydawane, gdy kolor jest żądany, zapewniając, że nagłe wzrosty aktywności są dozwolone, ale ogólne użycie pozostaje kontrolowane. Klatka jest ‘ulepszona’ do koloru tylko wtedy, gdy jest zarówno informacyjna, jak i dostępnych jest wystarczająco dużo kredytów.

Dynamiczny Router Tokenów kontroluje, jak dużo szczegółów otrzymuje każda klatka, zamiast przetwarzać każdą klatkę w pełnej jakości. Gdy nic ważnego nie zostanie wykryte, klatka w skali szarości jest utrzymywana w niskiej rozdzielczości i zamieniana na mały, skompresowany zestaw tokenów. Gdy wykryty zostanie ważny moment, system przełącza się na kolor i przetwarza tę klatkę w wyższej rozdzielczości, oferując bogatszą i bardziej szczegółową reprezentację.

Oba typy klatek przechodzą przez ten sam model, ale klatki w skali szarości są przetwarzane w lżejszy sposób, podczas gdy wybrane klatki kolorowe otrzymują więcej uwagi. Wyniki są następnie łączone w ich oryginalnej kolejności i wysyłane do modelu jako ciągły strumień.

Ponieważ większość klatek pozostaje lekka, a tylko kilka jest ulepszanych, system oszczędza dużą ilość obliczeń, jednocześnie przechwytując kluczowe szczegóły, gdy mają znaczenie:

Z artykułu, kolejny przykład, w którym system jest wymagany do tymczasowego zwiększenia zasobów w celu rozróżnienia koloru.

Dane i testy

Aby przetestować system, badacze oceniali go na benchmarkach wideo StreamingBench i <a href="https://arxiv